【时间】2019.01.22

【题目】Batch Normalization 学习笔记与Keras中的BatchNormalization层

一、Batch Normalization基础知识

具体参考博文:Batch Normalization 学习笔记

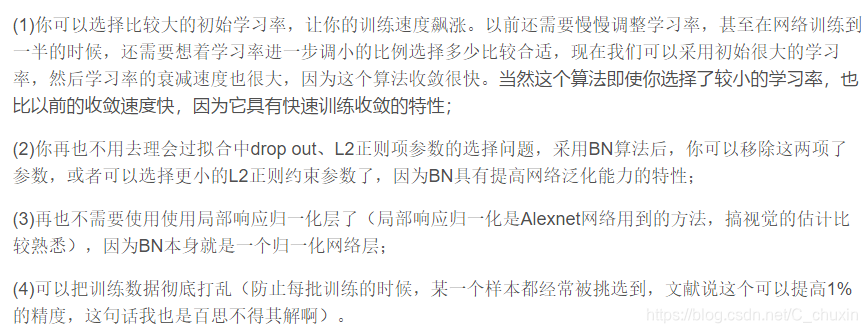

- 在博文中,介绍了Batch Normalization 的出现背景,即它要解决的问题:解决传统的神经网络训练需要我们人为的去选择参数,比如学习率、参数初始化、权重衰减系数、Drop out比例 的问题,并能提高算法的收敛速度。它的强大之处在于

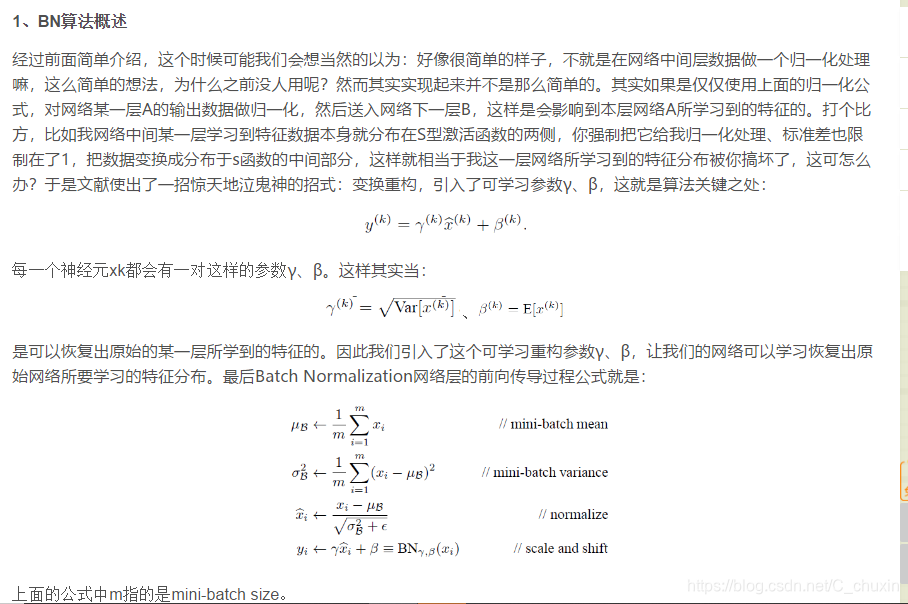

- BN算法的实现:

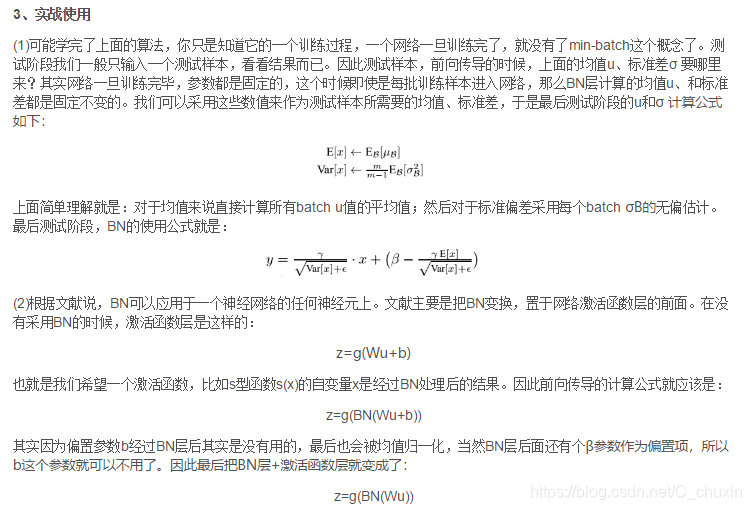

- test过程中:

PS:其实训练与测试过程中的y输出是同样的式子(将

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?