知识库对话初尝试

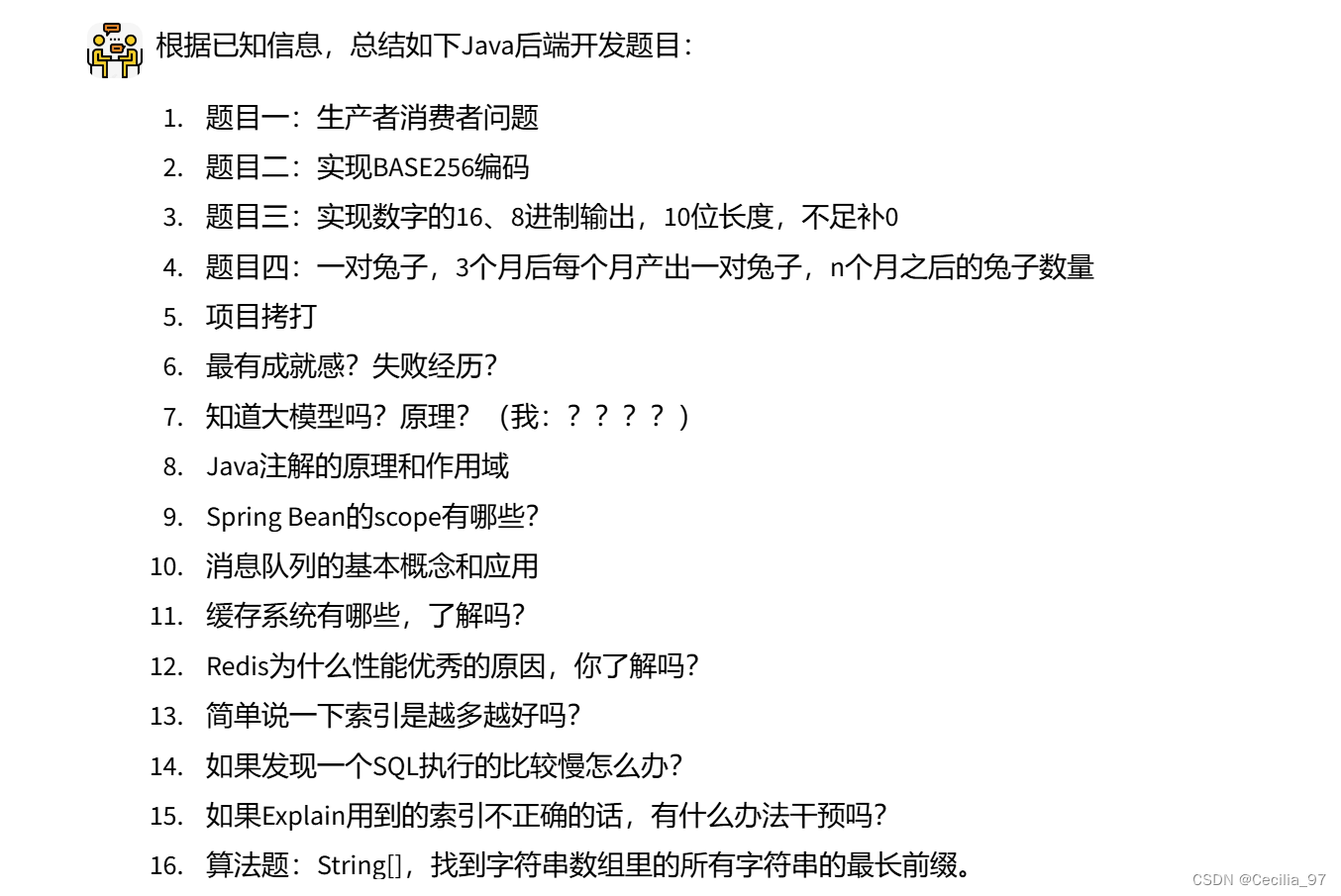

首先使用前端,进行一些知识库对话的prompt尝试

知识库总结质量并不太好:只有抽取原回答的能力,甚至不能修改

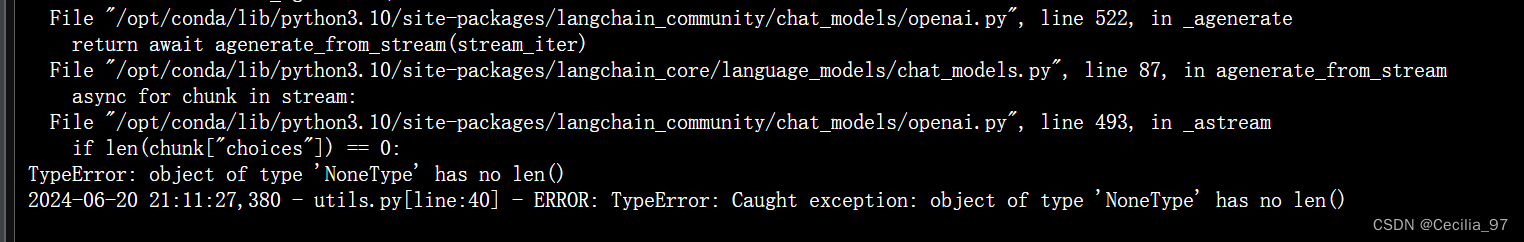

匹配知识条数如果过长,会输出失败

原本以为哪里有问题,在github上找到了同样问题,有人这样回答:[BUG] ERROR: TypeError: Caught exception: object of type ‘NoneType’ has no len() · Issue #3727 · chatchat-space/Langchain-Chatchat (github.com),看来暂时无法改变

除此之外,也需要清空历史内容,否则长度过长,输出失败

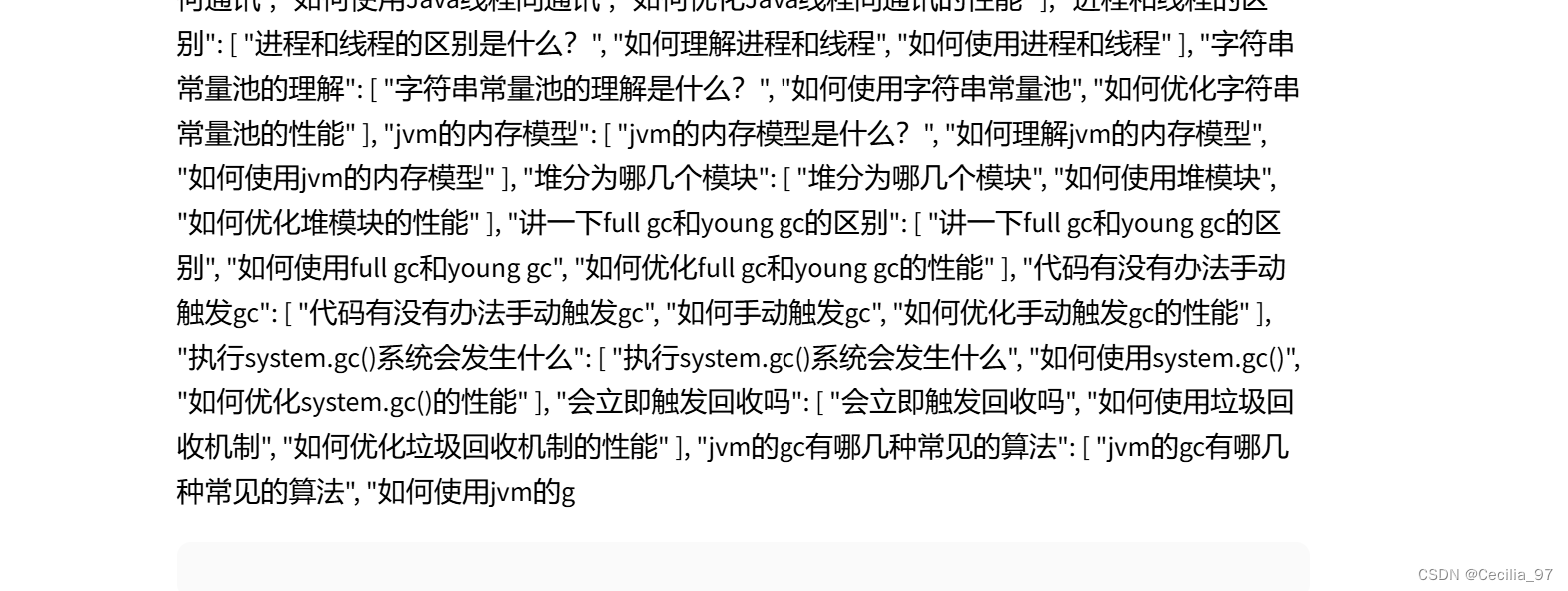

prompt1:你可以帮我总结一下java后端有什么常考的知识点吗?以json格式输出,key是知识点的名称,value是由问题组成的列表

结果:答案太长可能输出不完

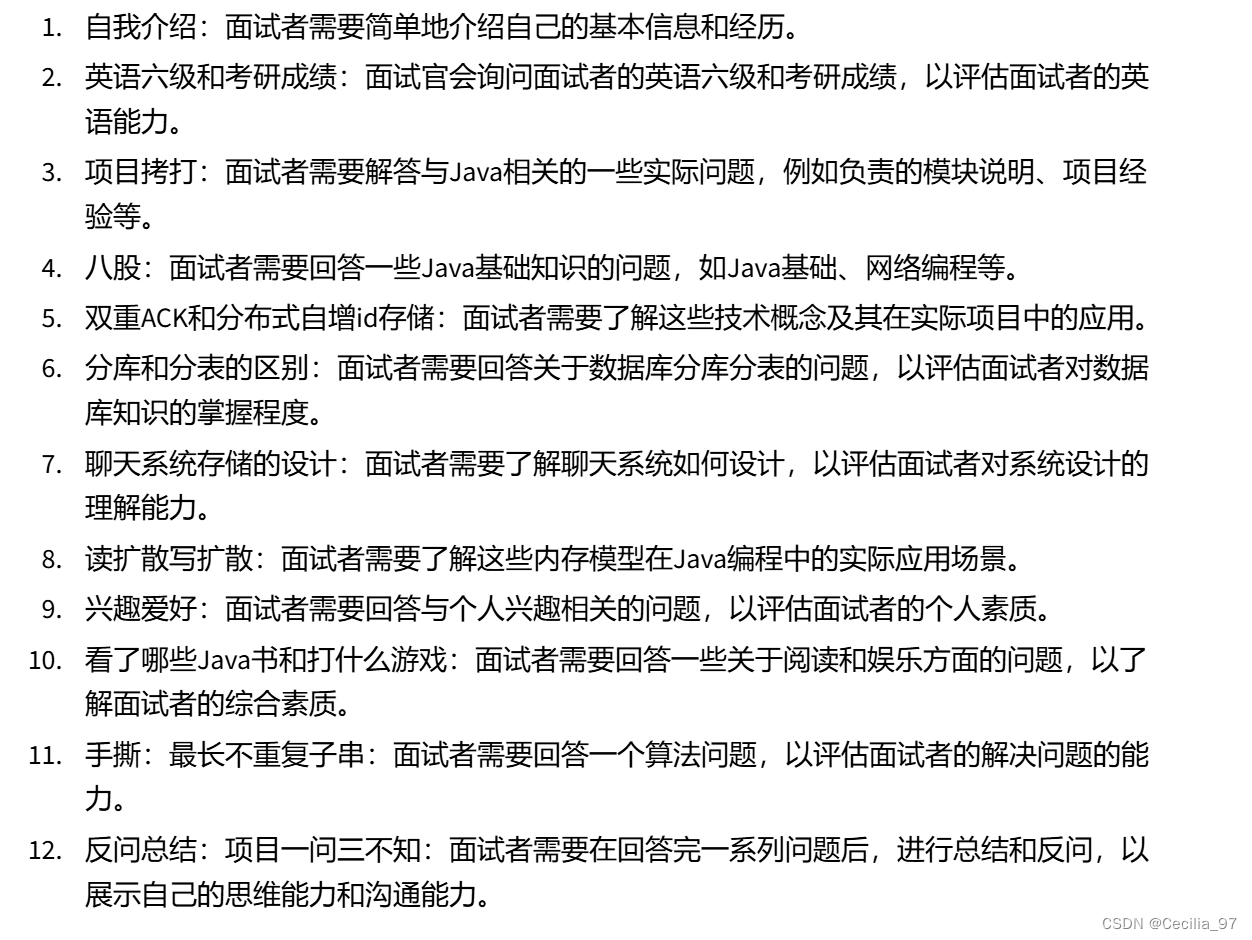

prompt2:请你总结一下阿里面试中的题目类型,并给出该类型下的所有题目

匹配知识条数3

匹配知识条数为10条

并不是匹配条数越多越好!当文档数量表少时,如果匹配条数多于6个,会提示如下:

显然,1个文档中可以返回多个“知识条数”

知识库对话中发生的问题

-

匹配知识条数、知识匹配分数阈值、知识库内文档条数等等参数,均会影响到结果的生成,可能情况如下:

无匹配结果、无法生成答案、答案质量差、答案质量好 -

只能从知识文档中匹配到一定量的文本:但我们的需求是查阅所有文本,并进行总结与提炼,如果只有部分的文本,会导致信息丢失

-

大模型的能力变差:当在知识库对话时,对大模型提出复杂的任务要求,会使得答案显著下降,而与大模型直接对话仍然可以有较高质量的输出结果。

经过资料查阅,发现RAG技术有一个显著缺点!!

当信息蕴含在较长的上下文时,基于片段的搜索召回,一定会丢失数据,导致最终无法正确的回答问题。

实际上复杂的问题,这里只是说问题本身倾向于从全文获取答案,而不仅仅是基于片段

来源于文章:RAG中如何解决上下文知识连贯性问题 || 如何更好的切分和组织非结构化的文档数据

根据文章提示,我们先走有两条可走的方向

- 按照文章中描述的:以树形结构,来组织数据的方式,来解决上述提到的上下文关联问题

- 回归传统的大模型使用,对大模型提示来生成总结文本,需要解决的问题是大量、长文本数据的输入问题。

可探索方向

虽然可以尝试用树或图的结构来组织知识库,但这需要较大的学习经历,相当于从零开始研究。由于时间限制,我决定先使用大模型来集成数据,在未来休闲的时间当中,我可以研究一下如何构建一个更层次化的知识库。

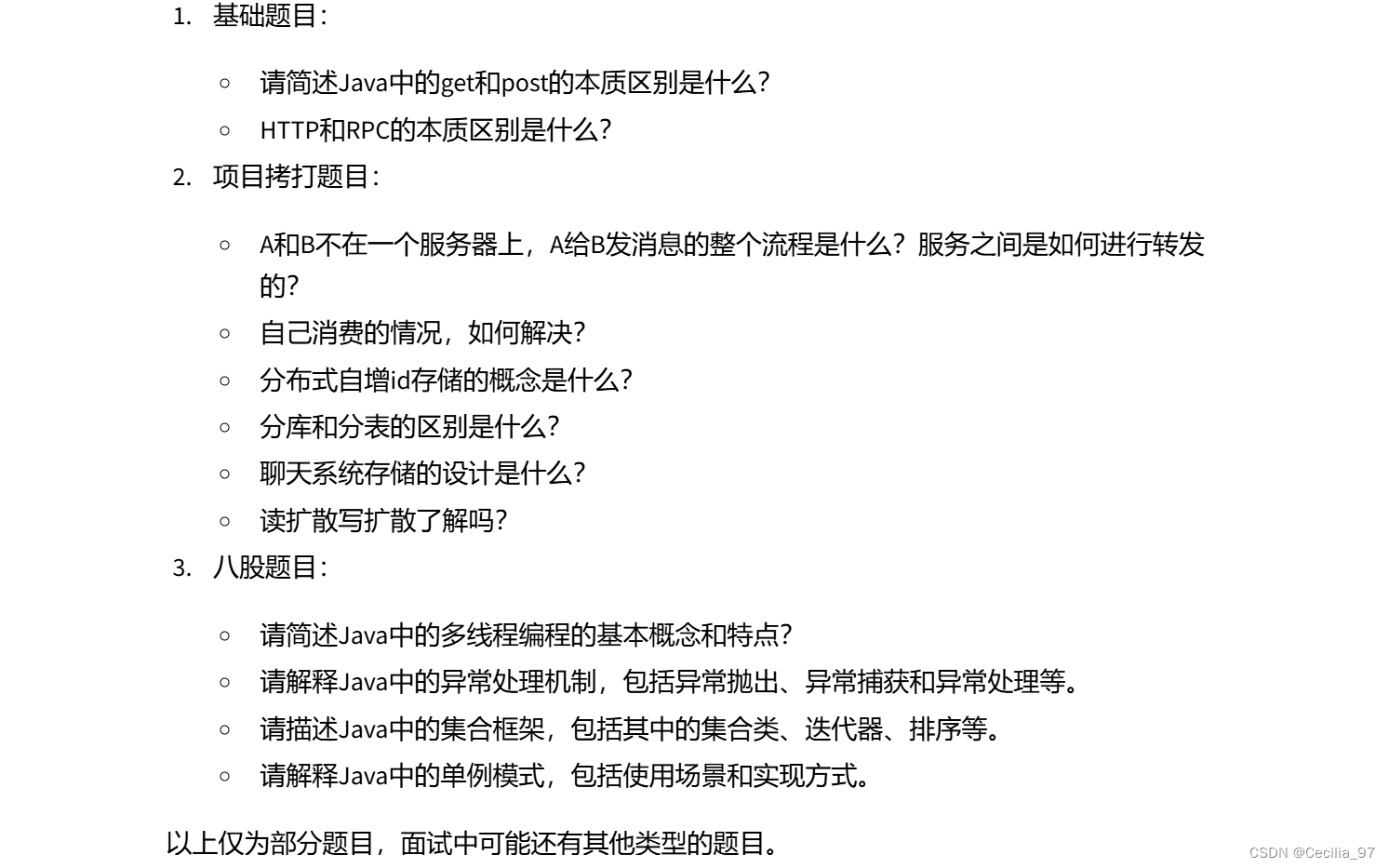

- 面试问题分类:总结面试问题的类型/分类,例如“技术知识”、“项目背景”、“科研学术”等等。

- 检索具体问题:遍历所有的问题,看将其分类到对应问题类型之下

- 问题合并:对每一个类别下的问题,在此之上进行数据总结,将相似的问题合并为一个问题

如何分类?我们没有标注数据,即我们事先并不知道有什么样子的题目,那就只能让大模型自己进行总结。总结出题目类别后,我们在对这些类别进行聚类。

1427

1427

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?