目录

前言

YOLO(You Only Look Once)作为一种高效、实时的目标检测算法,一直是计算机视觉领域中最受欢迎的技术之一。YOLOv7是YOLO系列中一款高效、精准且灵活的目标检测模型。目标检测任务中提供了更高的准确度、更强的实时性和更丰富的功能,是目标检测领域的强力工具。今天就跟着小编一起来全方面认识一下YOLOv7算法模型吧~

参考论文:YOLOv7: Trainable bag-of-freebies sets new state-of-the-art for real-time object detectors

论文链接:https://arxiv.org/abs/2207.02696

一、模型介绍

YOLOv7虽然在热度上不及YOLOv5或YOLOv8,但它在模型上的提升却是不容小觑的,特别是在精度、推理速度和多尺度特征融合等方面,YOLOv7推出即超过当时所有已知的目标检测器,YOLOv7各方面的优化让它特别适用于小物体和密集物体,这使得它非常适合实时性要求较高的应用场景,如视频监控、自动驾驶、无人机等。

二、架构设计

YOLOv7的架构继承了YOLO系列的优良传统,并在此基础上做出了多项创新。

1.Backbone(骨干网络)

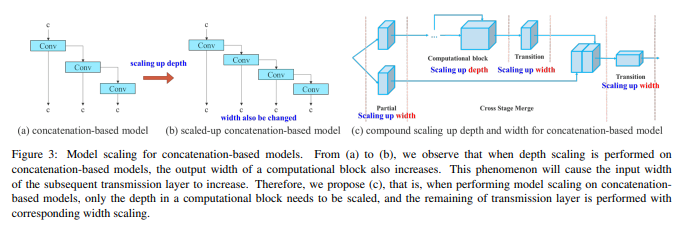

YOLOv7的 backbone采用了ELAN结构,在YOLOv7的研究中,研究团队提出了E-ELAN(Extended ELAN),这是对ELAN(Efficient Layer Aggregation Networks)的扩展版本,也是YOLOv7的重大创新,旨在优化网络结构以提升模型性能。

ELAN通过聚合不同层的特征来提高网络的表征能力,但研究团队发现其在特征利用率和网络学习能力上仍有提升空间。因此,E-ELAN通过使用组卷积增加特征基数,并通过shuffle和merge cardinality的方式组合不同组的特征,以更有效地利用特征并增强网络学习能力。

E-ELAN在计算块架构上进行了改进,采用了expand、shuffle、merge cardinality等操作,以连续增强网络的学习能力。

此外,研究团队还研究使用梯度流传播路径来分析如何重参数化卷积,以与不同的网络相结合。

2.Neck(颈部)

FPN(Feature Pyramid Network)和PAN(Path Aggregation Network)结构。FPN有助于从不同尺度的特征图中提取信息,而PAN进一步增强了跨层特征的融合。通过结合FPN和PAN,YOLOv7可以在不同分辨率下进行有效的目标检测,特别是在多尺度物体的检测上表现优异。

3.Head(输出层)

YOLOv7的头部网络负责输出最终的检测结果,包括物体类别、置信度和边界框坐标。其采用了双头结构,一个用于检测目标的分类,一个用于回归边界框。这使得YOLOv7能够更加精确地定位和分类物体。在标签分配策略方面,团队还展示了带和不带辅助训练头深度监督的目标检测器架构。

同时YOLOv7模型还引入Squeeze-and-Excitation模块、注意力机制(Attention Mechanisms)、自动学习率调度器(AutoLearning Rate Scheduler)等进一步提升了目标检测的精度和效率。

三、YOLOv7性能表现

研究团队在实验中使用了MS COCO数据集,并从头开始训练YOLOv7模型。他们评估了模型在不同硬件(如边缘GPU、普通GPU和云GPU)上的性能,并设计了针对不同服务需求的基本模型,如YOLOv7-tiny、YOLOv7和YOLOv7-W6。此外,他们还通过模型扩展获得了不同类型的模型,如YOLOv7-X、YOLOv7-E6和YOLOv7-D6等。

YOLOv7在速度范围从5FPS到160FPS内,超越了当时所有已知的目标检测器。在GPU V100上,YOLOv7以30FPS或更高的速度运行,并获得了最高的准确性56.8%AP。

研究团队比较了不同输入分辨率(640和1280)下,YOLOv7与其他模型的性能和准确性。他们还评估了不同模型大小(如YOLOv7-tiny、YOLOv7、YOLOv7-X等)对性能和准确性的影响。

四、YOLOv7使用详解

YOLOv7在CoovallyCPU平台上的使用非常便捷,Coovally开源社区为用户提供了多个YOLOv7版本,包括YOLOv7、YOLOv7x、YOLOv7tiny等在内的五个版本,支持快速下载和调用(无代码操作)。

1.添加模型

进入Coovally开源社区点击【全部模型】,可以根据应用需求下载或另存不同版本YOLOv7模型算法。

进入【模型集成】页面,进行安装。

2.创建数据集

进入Coovally平台的【图像数据】页面,点击创建数据集,上传图像数据,并根据需求划分训练集、验证集和测试集。

3.数据标注

在【辅助标注】页面,点击创建样本集,进入样本集详情页。

创建好标签进行数据标注。

Coovally提供智能标注工具,可以加速数据标注过程。

可以选择几组数据进行人工标注,标注完成后发布为数据集启动微调训练,剩余样本集数据即可全部自动化完成。

4.模型训练

在模型训练中选择自定义算法训练。

选择YOLOv7模型进行训练。

设置训练任务的参数,包括E-poch次数等。

5.模型预测

训练完成后,用户可以将训练好的YOLOv7模型应用于实际任务。平台支持模型的多种格式转换,包括ONNX、CoreML和TensorRT,方便在各种硬件设备上进行部署和预测。

Coovally平台提供了直观的预测结果展示工具,用户可以查看模型在测试数据集上的表现,帮助进一步优化模型或调整任务参数。

五、YOLOv7总结

YOLOv7在目标检测任务中表现出色,其设计结合了高效性、精度和实时性,适用于多种复杂场景和应用需求。

1.速度与精度并重

YOLOv7通过改进的网络架构,提升了检测速度和精度的高效平衡,在处理实时目标检测时依然能够保持,适用于工业、安防、自动驾驶等场景。支持多版本,满足不同需求 YOLOv7提供了多个版本,包括YOLOv7s、YOLOv7m、YOLOv7l和YOLOv7x,满足不同应用场景下对模型速度和精度的需求。

2.卓越的鲁棒性

YOLOv7能够在复杂环境下,如光线变化或视角振幅时,依然保持的目标检测,增强了模型在实际应用中的可靠性。数据增强技术 YOLOv7在数据增强方面采用了Mosaic增强、随机仿射变换、颜色抖动等方法,进一步提升了模型对小物体和稀疏目标的检测能力。

3.轻量化与多任务能力

YOLOv7不仅支持多任务检测(如分类、定位、分割等),还具备轻量化的设计,能够在低功耗设备上高效运行,非常适合边缘计算和嵌入式设备。

总结来说,YOLOv7不仅在速度和精度上取得了很大的突破,也让目标检测应用的可能性变得更加广泛。如果您有兴趣了解更多关于YOLOv7的使用方法和最佳实践,欢迎关注我们,我们将继续为大家带来更多干货内容!

985

985

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?