提示词、RAG、微调哪个会让大模型表现更好?

在大模型的应用中,提示词(Prompting)、检索增强生成(Retrieval-Augmented Generation, RAG)和微调(Fine-Tuning)是三种常见的技术手段。每种方法都有其独特的优点和适用场景,选择哪种方法取决于具体的应用需求和资源限制。下面是对这三种方法的详细比较:

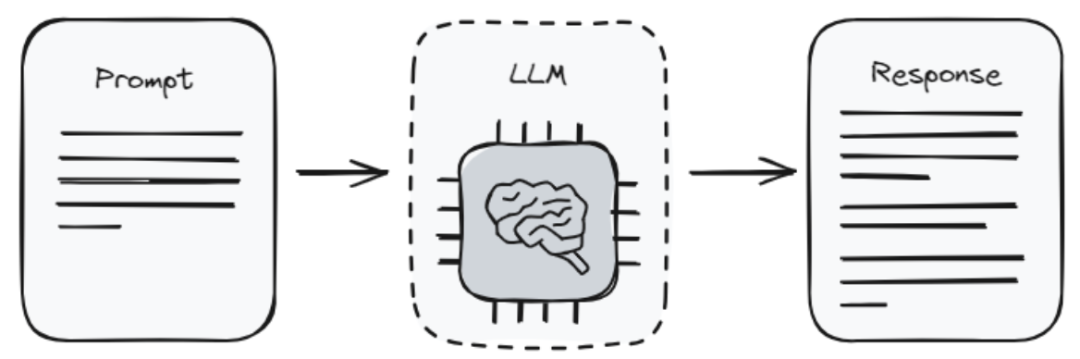

1. 提示词(Prompting)

优点

-

快速实现:只需要设计合适的提示词,无需训练模型。

-

灵活性高:可以快速调整提示词以适应不同任务。

-

资源友好:不需要额外的计算资源或数据集。

缺点

-

性能有限:提示词的效果取决于模型的预训练能力,可能无法达到最佳性能。

-

依赖技巧:设计有效的提示词需要一定的经验和技巧。

适用场景

-

快速原型:需要快速验证一个想法或原型时。

-

通用任务:模型已经在预训练过程中涵盖了相关任务。

2. 检索增强生成(RAG)

优点

-

信息丰富:通过检索相关文档,可以提供更丰富和准确的信息。

-

动态更新:可以动态更新检索库,以适应最新的信息和知识。

-

增强长尾知识:对长尾知识和罕见信息有较好的处理能力。

缺点

-

复杂性高:需要构建和维护检索系统,增加了系统复杂性。

-

延迟增加:检索过程会增加响应时间。

适用场景

-

信息密集型任务:如问答系统、知识图谱查询等,需要丰富的背景知识支持。

-

动态内容:需要频繁更新和扩展知识库的应用场景。

3. 微调(Fine-Tuning)

优点

-

高性能:通过在特定任务数据上微调模型,可以显著提升模型在该任务上的表现。

-

定制化:可以根据具体任务的需求定制模型,使其更适应特定的应用场景。

缺点

-

数据需求高:需要大量的高质量标注数据进行微调。

-

计算资源需求高:微调过程需要较大的计算资源,特别是对于大型模型。

-

时间成本高:微调过程可能需要较长时间。

适用场景

-

高性能要求:需要在特定任务上达到最佳性能的应用,如特定领域的文本分类、生成任务等。

-

数据充足:有足够的高质量标注数据可用于微调。

综合比较

-

提示词(Prompting):适合快速实现和灵活调整的场景,适用于已有模型能力较强的通用任务。

-

检索增强生成(RAG):适合需要丰富背景知识和动态更新的场景,适用于信息密集型任务。

-

微调(Fine-Tuning):适合对性能要求高且有足够数据和资源的场景,适用于需要最佳性能的定制化任务。

结论

在实际应用中,可以根据具体需求选择合适的方法。如果需要快速验证和灵活调整,可以优先考虑提示词。如果任务需要丰富的背景知识支持,可以考虑RAG。如果对特定任务的性能要求高且有足够的数据和资源,则微调是最佳选择。

有时,结合多种方法也可以取得更好的效果。例如,可以先通过提示词快速验证,再通过RAG增强模型的知识库,最后通过微调进一步提升特定任务的表现。

最后的最后

感谢你们的阅读和喜欢,我收藏了很多技术干货,可以共享给喜欢我文章的朋友们,如果你肯花时间沉下心去学习,它们一定能帮到你。

因为这个行业不同于其他行业,知识体系实在是过于庞大,知识更新也非常快。作为一个普通人,无法全部学完,所以我们在提升技术的时候,首先需要明确一个目标,然后制定好完整的计划,同时找到好的学习方法,这样才能更快的提升自己。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

大模型知识脑图

为了成为更好的 AI大模型 开发者,这里为大家提供了总的路线图。它的用处就在于,你可以按照上面的知识点去找对应的学习资源,保证自己学得较为全面。

经典书籍阅读

阅读AI大模型经典书籍可以帮助读者提高技术水平,开拓视野,掌握核心技术,提高解决问题的能力,同时也可以借鉴他人的经验。对于想要深入学习AI大模型开发的读者来说,阅读经典书籍是非常有必要的。

实战案例

光学理论是没用的,要学会跟着一起敲,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

面试资料

我们学习AI大模型必然是想找到高薪的工作,下面这些面试题都是总结当前最新、最热、最高频的面试题,并且每道题都有详细的答案,面试前刷完这套面试题资料,小小offer,不在话下

640套AI大模型报告合集

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

10万+

10万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?