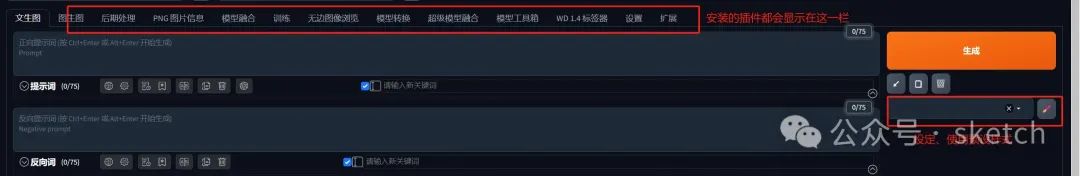

界面使用

文生图、图生图左侧

1迭代步数:相当于画家绘画步数与画面丰富度,步数越高绘画时间越长,推荐20~30即可;

2采样方式:相当于绘画方式,一般使用euler a或者dmp++;

3面部修复:任务面部在图画中的占比比较小的时候,ai容易产生畸形效果,勾选面部修复有助于面部细节处理,对三次元才比较有用噢!

4平铺图:一般可能生成纹理图的时候才会要用到;

5高分辨率修复:吃配置,可以进行图片放大以及分辨率调整

a放大算法:推荐R-ES4X++(三次元)、R-ES4X++Anime6B(二次元);

6高度,宽度:初始生成图片的分辨率,建议在720以下,太高会爆现存,而且效果还会不好!up买个坑,后续说原理

7总批次数:连续生成n张图片;

8单批数量:别改初始配置,太高会爆现存;

9CFG:贴合提示词——创意性,两者之间更倾向于哪边;

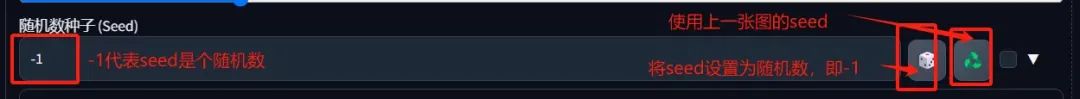

10随机数种子:种子数确定的时候,生成的图片会跟之前的种子数图片很像

11生成的图片下的图生图、重绘,与功能列表中的图生图、重绘的差别:

a功能列表中要上传图片、写描述词

b生成的图片下面点击的话,会自动填入图片和描述词

后期处理

图片的分辨率处理,推荐R-ES4X++(三次元)、R-ES4X++Anime6B(二次元);

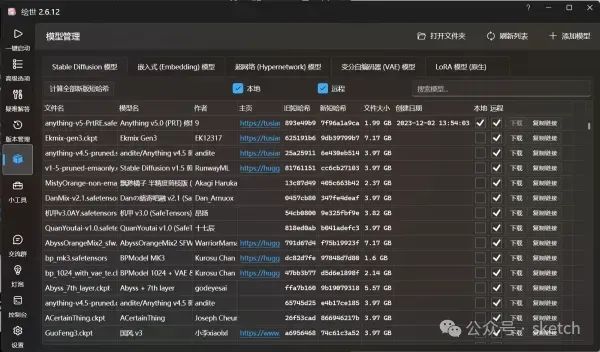

大模型

1管理器中可以下载,会自动同步到文件夹中,就不需要我们自己再做额外的操作了

2如果要看模型的预览图,就去civitai站,选中checkpoint之后筛选出大模型,下载之后,要自己进行同步,将下载的模型放入模型对应的文件夹中;国内网站liblib也可以下载模型;

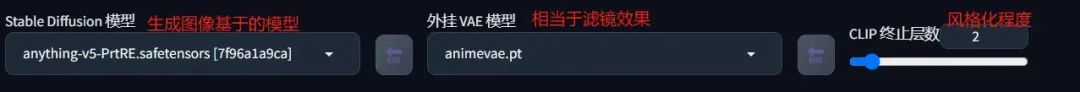

模型选择

checkpoint

相当于底层的引擎,不同的大模型对应不同的风格

lora

lora是特征模型,基于某个确定的角色、确定的风格、固定的动作训练而成的模型,可以使用权重控制;

lora模型可以混合叠加使用;

controlnet(控制网格)插件-神器

ControlNet使创作者能够轻松地控制AI图像和视频中的对象。它将根据边缘检测、草图处理或人体姿势等各种条件来控制图像生成。

使用前的操作

1.将ControlNet模型(.pt、.pth、.ckpt或.safetensors)放入models/ControlNet文件夹。2.打开“txt2img”或“img2img”选项卡,写下您的提示。3.按“刷新模型”,选择要使用的模型。(若没有出现,请尝试重新加载/重新启动webui)4.上传您的图像并选择预处理器,完成。

基本功能介绍

开启:选中此框以启用ControlNet。颜色反转:交换黑色和白色。例如,它可以在您上传涂鸦时使用。ControlNet 需要黑色背景和白色涂鸦。如果您使用白色背景的外部软件创建涂鸦,则必须使用此选项。如果您使用 ControlNet 的界面创建涂鸦,则不需要使用此选项。RGB转为BGR:用于检测用户导入图像中的颜色信息。有时图像中的颜色信息可能与扩展所期望的不同。如果您上传图像并使用预处理,则无需选中此框。低显存:这将减缓ETA进程,但有助于使用更少的计算空间(显存小于8 GB VRAM建议使用),检查您是否用完了 GPU 内存,或者想要增加处理的图像数量。推测模式:ControlNet自动识别图像(不需要提示和负面提示)与选定的预处理器。它强制 ControlNet 编码器遵循输入控制图(如深度、边缘等),即使没有提示也是如此。使用此模式时使用更高的步进,例如50,但是这个效果不一定好。

权重(Weight):代表使用 ControlNet 生成图片时被应用的权重占比。引导介入时机(Guidance Start):在理解此功能之前,我们应该先知道生成图片的 Sampling steps 采样步数功能,步数代表生成一张图片要刷新计算多少次,Guidance Start(T) 设置为 0 即代表开始时就介入,默认为 0,设置为 0.5 时即代表 ControlNet 从 50% 步数时开始介入计算。引导退出时机(Guidance End):和引导介入时机相对应,如设置为1,则表示在100%计算完时才会退出介入也就是不退出,默认为 1,可调节范围 0-1,如设置为 0.8 时即代表从80% 步数时退出介入。

调整大小模式提供了调整ControlNet大小和上传图像的纵横比。Just Resize:不保留纵横比的情况下,改变ControlNet图像的大小以匹配Txt2Img设置的宽度和高度。这包括拉伸或压缩图像以适应指定的尺寸。Scale to Fit (Inner Fit):调整ControlNet图像的大小以适应Txt2Image的尺寸。它将调整图像的大小,直到它能够适应Txt2Image设置的宽度和高度。Envelope (Outer Fit):调整Txt2Image的大小以适应ControlNet图像的尺寸。它将调整图像的大小,直到Txt2Image设置可以适合ControlNet图像。画布宽度 和 画布高度提供手动创建绘图或草图以,不上传任何图像(最好使用 Scribble 预处理器以获得良好的输出)。它会调整空白画布的大小来进行绘制,不会影响上传的原始图像。

预览图片处理结果:能够快速查看选择的预处理器是如何将上传的图像或绘图转换为 ControlNet的检测图。对在渲染输出图像之前尝试各种预处理器有用,可节省我们的时间。隐藏处理结果:删除预览图像。

预处理器和模型是ControlNet的主要选项。预处理器:用于对输入图像进行预处理,例如检测边缘、深度和法线贴图。None使用输入图像作为控制图。根据所需的输出,用户可以选择相应的控制方法。模型:如果您选择了预处理器,您通常会选择相应的模型。但是它并不限制你混合和匹配所有的预处理器和模型,但是混合多了就会产生负面效果,所以最好使用更加匹配的模型并且越少越好。ControlNet模型与在AUTOMATIC1111 GUI顶部选择的稳定扩散模型一起使用。

常用功能

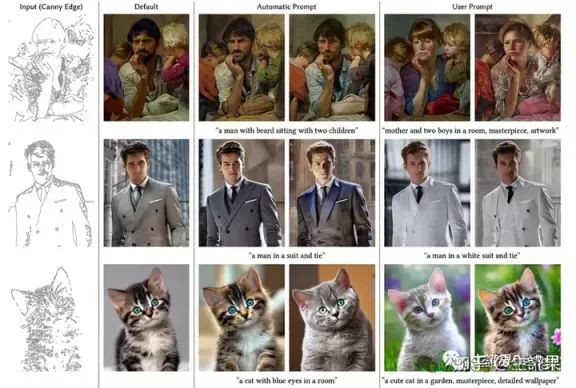

1Canny边缘检测

Canny通过使用边缘检测器创建高对比度区域的轮廓来检测输入图像。线条可以捕捉到非常详细的信息,但如果你的图像背景中有一些物体,它很可能会检测到不需要的物体。所以背景中物体越少效果越好。用于此预处理器的最佳模型是control_sd15_canny。

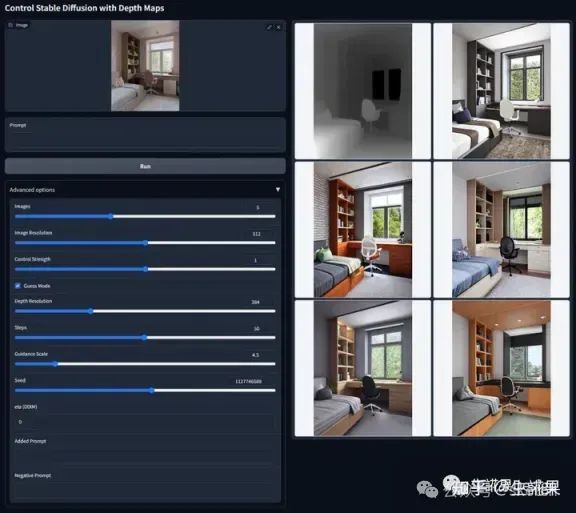

2Depth & Depth Leres

这个预处理器有助于生成输入图像的深度估计。深度通常用于控制图像内物体的空间定位。浅色区域意味着它离用户更近,而深色区域则离用户更远。在大图像时它可能会丢失图像内部的细节(面部表情等)。一般会与control_sd15_depth模型组合使用。Midas Resolution函数用于增加或减少detectmap中的大小和细节级别。它的级别越高,将使用更多的VRAM,但可以生成更高质量的图像,反之亦然。Depth Leres有与Depth 相同的基本概念,但在地图中包含更广泛的范围。但有时它会从图片中捕获了太多信息,可能会生成与原始图像略有不同的图像。所以最好先试用两种预处理器,然后决定哪一种。

3HED (Holistically-Nested Edge Detection)

Hed可以在物体周围创建清晰和精细的边界,输出类似于Canny,但减少了噪声和更柔软的边缘。它的有效性在于能够捕捉复杂的细节和轮廓,同时保留细节特征(面部表情、头发、手指等)。Hed预处理器可用于修改图像的风格和颜色。用于此预处理器的最佳模型是control_sd15_hed。

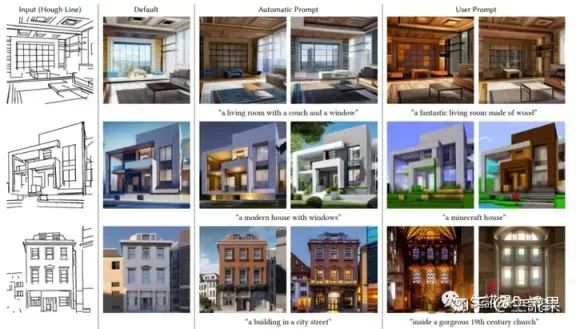

4MLSD ( Mobile Line Segment Detection)

MLSD Preprocessor 最适合生成强有力的线条,这些线条能够检测出需要独特和刚性轮廓的建筑和其他人造作品。但是它不适用于处理非刚性或弯曲的物体。MLSD适用于生成室内布局或建筑结构,因为它可以突出直线和边缘。用于此预处理器的最佳模型是control_sd15_mlsd。

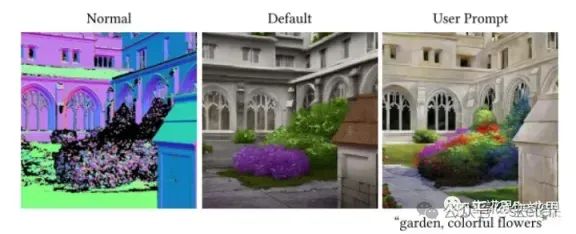

5Normal map

法线图使用了三种主要颜色(红、绿、蓝),通过不同的角度来精确定位物体的粗糙度和光滑程度。它生成法线图的基本估计,可以保留相当多的细节,但可能会产生意想不到的结果,因为法线图完全来自图像,而不是在3D建模软件中构建的。法线图有利于突出复杂的细节和轮廓,并且在定位对象方面也很有效,特别是在接近度和距离方面。“Normal Background Threshold”用于调整背景成分。设置一个更高的阈值可以移除背景的远处部分(将其混合成紫色)。降低阈值将命令AI保留甚至显示额外的背景元素。用于此预处理器的最佳模型是control_sd15_normal。

6OpenPose

这个预处理器生成了一个基本的骨骼火柴人形象。这种技术被广泛采用,因为多个 OpenPose骨架可以组合成一个图像,这有助于引导稳定扩散生成多个一致的主题。骨架图有很多关节点,每个点代表如下图所示。

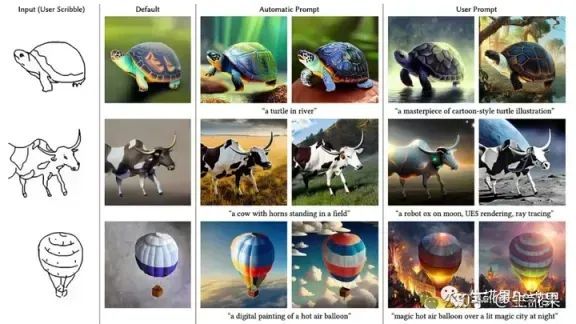

7Scribble

涂鸦的目的是从简单的黑白线条画和草图生成图像。用户也可以使用“Canvas”选项创建特定大小的空白画布,用于手动素描(也可以直接上传图像)。如果草图和绘图由白色背景上的黑线组成,则需要选中“Invert Input Color”复选框。用于这个预处理器的最佳模型是control_sd15_openpose。

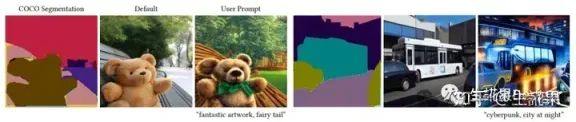

8Segmentation

分割预处理器检测并将上传的图像分割为同一图像内的段或区域。该模型在生成一组新的图像时,将detectmap图像应用于文本提示。用于此预处理器的最佳模型是control_sd15_seg。

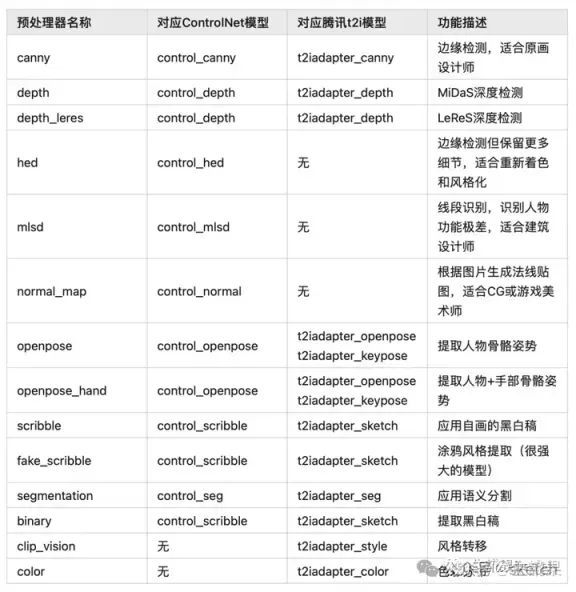

9附录:预处理器与对应模型清单

图生图使用技巧

1CLIP反推:不知道怎么写描述词,上传图片之后点击,会填充提示词

2DeepBooru反推:同上

3重绘幅度:如果设置的比较高的话,生成的图片跟上传的图片差异就会表较大噢【如果觉得生成的太像了,可以不断生成然后拿新生成的去继续迭代生成】

tip:图生图中,如果想要在原图的基础上,进行分辨率的调整,只是调整高宽或者缩放模式,是很容易发生变形的;so,在调整分辨率的基础上,还可以将重绘幅度适当调高,这样ai会对图片进行一定的扩展,从而图片就不会变形啦!

涂鸦、局部重绘

1涂鸦:根据涂鸦的形状、位置、颜色生成对应的东西+提示词对涂鸦处东西的描述

2局部重绘:重新绘制选中的位置,其他地方不变,提示词只正对蒙版内容!

a可以调整蒙版边缘

b重绘区域:整张图片(先画非蒙版区域,再画蒙版区域,针对整张图,所以畸变一般是不会被修复的),仅蒙版区域(重绘时相当于把蒙版区域放到了一个我们设置的重绘尺寸上进行重绘,重绘后再放入原本的图片,所以出来的图相当于一个精修图,这也是面部修复的一个办法)

上传重绘蒙版

AI绘画SD整合包、各种模型插件、提示词、AI人工智能学习资料都已经打包好放在网盘中了,无需自行查找,有需要的小伙伴文末扫码自行获取。

写在最后

AIGC技术的未来发展前景广阔,随着人工智能技术的不断发展,AIGC技术也将不断提高。未来,AIGC技术将在游戏和计算领域得到更广泛的应用,使游戏和计算系统具有更高效、更智能、更灵活的特性。同时,AIGC技术也将与人工智能技术紧密结合,在更多的领域得到广泛应用,对程序员来说影响至关重要。未来,AIGC技术将继续得到提高,同时也将与人工智能技术紧密结合,在更多的领域得到广泛应用。

感兴趣的小伙伴,赠送全套AIGC学习资料和安装工具,包含AI绘画、AI人工智能等前沿科技教程,模型插件,具体看下方。

一、AIGC所有方向的学习路线

AIGC所有方向的技术点做的整理,形成各个领域的知识点汇总,它的用处就在于,你可以按照下面的知识点去找对应的学习资源,保证自己学得较为全面。

二、AIGC必备工具

工具都帮大家整理好了,安装就可直接上手!

三、最新AIGC学习笔记

当我学到一定基础,有自己的理解能力的时候,会去阅读一些前辈整理的书籍或者手写的笔记资料,这些笔记详细记载了他们对一些技术点的理解,这些理解是比较独到,可以学到不一样的思路。

四、AIGC视频教程合集

观看全面零基础学习视频,看视频学习是最快捷也是最有效果的方式,跟着视频中老师的思路,从基础到深入,还是很容易入门的。

五、实战案例

纸上得来终觉浅,要学会跟着视频一起敲,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

若有侵权,请联系删除

若有侵权,请联系删除

905

905

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?