基于深度强化学习的混合动力汽车能量管理策略

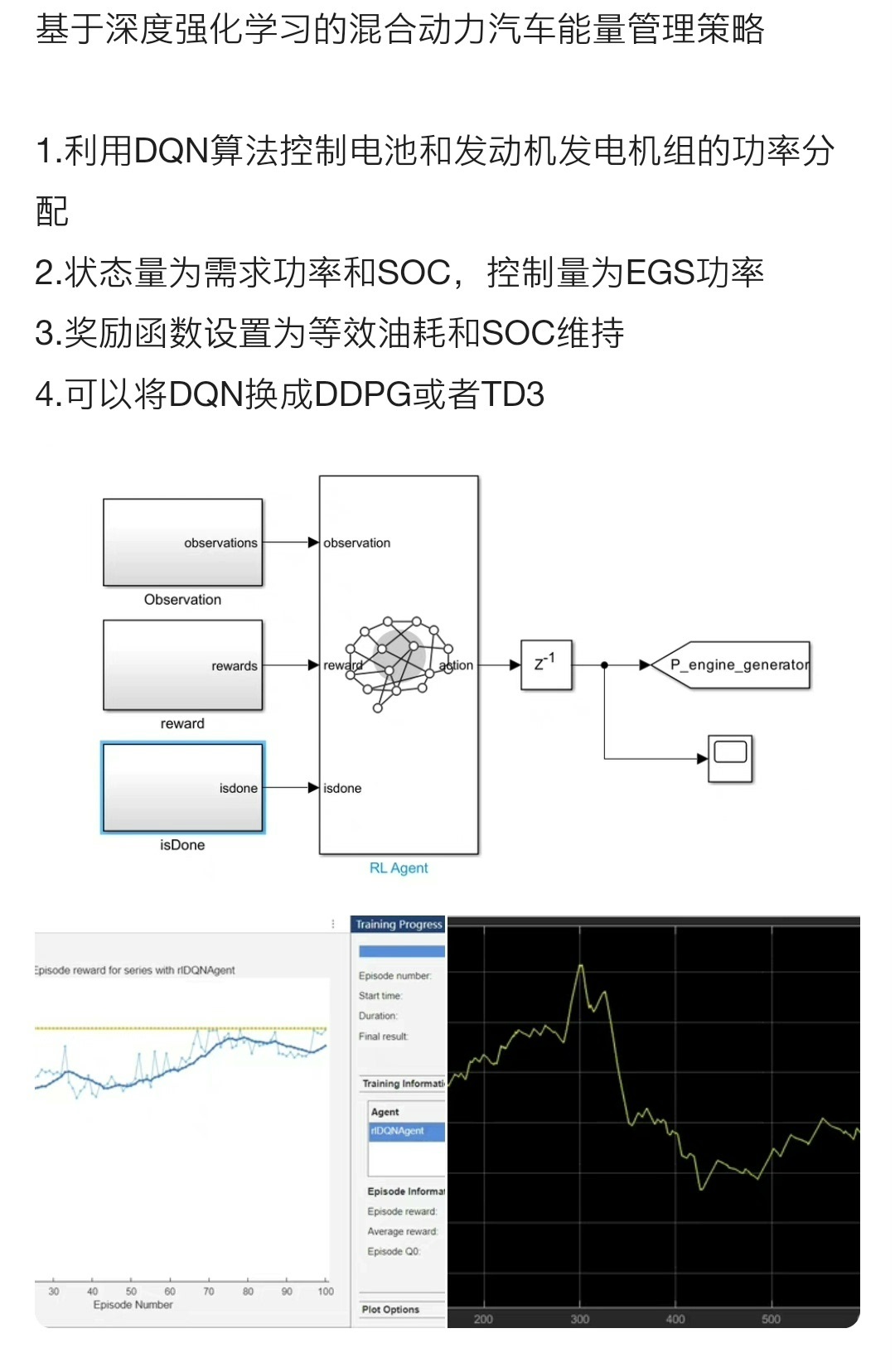

1.利用DQN算法控制电池和发动机发电机组的功率分配

2.状态量为需求功率和SOC,控制量为EGS功率

3.奖励函数设置为等效油耗和SOC维持

4.可以将DQN换成DDPG或者TD3

ID:4488766740418399

APTX4869

基于深度强化学习的混合动力汽车能量管理策略

摘要:随着能源危机的加剧和环境问题的日益突出,混合动力汽车作为一种能源效率高、环保节能的汽车技术逐渐受到关注。在混合动力汽车中,能量管理策略的优化对其性能和燃油经济性至关重要。本文基于深度强化学习算法,探讨了利用DQN算法控制电池和发动机发电机组的功率分配策略,以及状态量、控制量和奖励函数的设计方法。此外,还探讨了将DQN算法替换为DDPG或TD3算法的可行性。

-

引言

混合动力汽车通过电池和发动机发电机组的协同工作,实现了优化能量利用和减少排放的目标。能量管理策略决定了如何合理地分配电池和发动机发电机组的功率,从而实现汽车的高效运行。 -

基于DQN算法的功率分配策略

DQN算法是一种基于Q-learning和深度神经网络的强化学习算法。在混合动力汽车能量管理中,我们可以采用DQN算法来优化电池和发动机发电机组的功率分配策略。具体来说,我们可以将需求功率和电池剩余容量(SOC)作为状态量,将发动机发电机组的功率作为控制量,通过训练神经网络来获取最优的功率分配策略。 -

状态量、控制量和奖励函数设计

在混合动力汽车能量管理中,状态量、控制量和奖励函数的设计对于算法的效果起着至关重要的作用。在本文中,我们将需求功率和SOC作为状态量,将发动机发电机组的功率作为控制量。奖励函数的设计考虑了等效油耗和SOC维持两个方面,以实现最优的能量管理。 -

替代算法的可行性

除了使用DQN算法,我们还可以考虑使用其他的深度强化学习算法,如DDPG和TD3算法。这些算法在处理连续控制问题的能力较强,能够更好地应用于混合动力汽车能量管理中的功率分配问题。将DQN算法替换为DDPG或TD3算法可能会带来更好的控制效果,值得进一步的研究。 -

结论

本文提出了一种基于深度强化学习的混合动力汽车能量管理策略,利用DQN算法控制电池和发动机发电机组的功率分配。通过设置合适的状态量、控制量和奖励函数,能够实现优化能量管理和提高燃油经济性的目标。同时,本文还探讨了将DQN算法替换为DDPG或TD3算法的可行性,为混合动力汽车能量管理策略的进一步研究提供了思路和方法。

关键词:混合动力汽车;能量管理策略;深度强化学习;DQN算法;DDPG算法;TD3算法。

以上相关代码,程序地址:http://fansik.cn/766740418399.html

1428

1428

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?