1. CNN(卷积神经网络)

CNN:Convolutional Neural Networks

CNN特别擅长于图像分类,可以帮我们训练深度、多层的网络。目前,基于CNN的各种变化形式广泛应用于图像识别中。

CNN能很好地适应图像的平移不变性:例如稍稍移动一幅猫的图像,它仍然是一幅猫的图像。

1.1 CNN的基本概念

CNN的基本概念如下: 1)局部感受野(Local Receptive Fields)

2)共享权重和偏差(Shared Weights and Biases)

特征映射:共享权重和偏差、或卷积核、或滤波器

一个特征映射:可以检测一类局部特征。

共享权重:意味着卷积滤波器被强制从整个图像中学习,这使他们不太可能去选择在训练数据中的局部特质。于是对过拟合(overfitting)有很强的抵抗性,所以就没有必要来应用其它规范化,例如弃权(dropout)。

3)混合(Pooling)

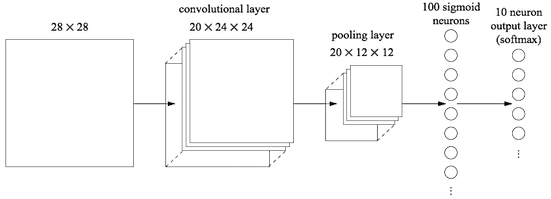

1.2 CNN的组成

CNN一般由以下两层组成:

1)卷积层(Convolutional Layer):根据特征映射生成的神经元。

2)混合层(Pooling Layer):一般紧跟在卷积层之后,简化从卷积层输出的信息。

- 最大混合值(Max-Pooling)

- L2混合值(L2-Pooling)

1.3 CNN的通用模式

2. RNN(递归神经网络)

RNN(Recurrent Neural Networks):就是一种随着时间而变化(时变特性)的神经网络。

即在前馈网络中, 隐层或输出神经元的激活值不完全由当前时刻的输入层决定,可能与之前的输入层相关或之前的其它隐层的激活值相关。

RNN特别擅长:语音识别(Speech Recognition)领域。

2.1 LSTM(长短期记忆单元)

影响RNN 的一个挑战是前期的模型会很难训练,甚至比前馈神经网络更难。原因就是梯度不稳定的问题,因为在RNN中,梯度不仅仅通过层间反向传播,还会根据时间进行反向传播。如果网络运行了很长一段时间,梯度就会变得特别不稳定,学不到东西。

LSTM(Long Short-Term Memory Units):就是为了解决这个梯度不稳定的问题而产生的。LSTM让RNN训练变得相当简单。

7363

7363

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?