YOLOv11交通信号灯识别检测项目扩展

交通信号灯识别是计算机视觉领域中的一个重要应用场景,广泛应用于自动驾驶、智能交通管理等领域。YOLOv11作为一种高效的目标检测算法,因其速度快、精度高的特点,非常适合用于交通信号灯的识别与检测。以下是对YOLOv11交通信号灯识别检测项目的详细扩展说明。

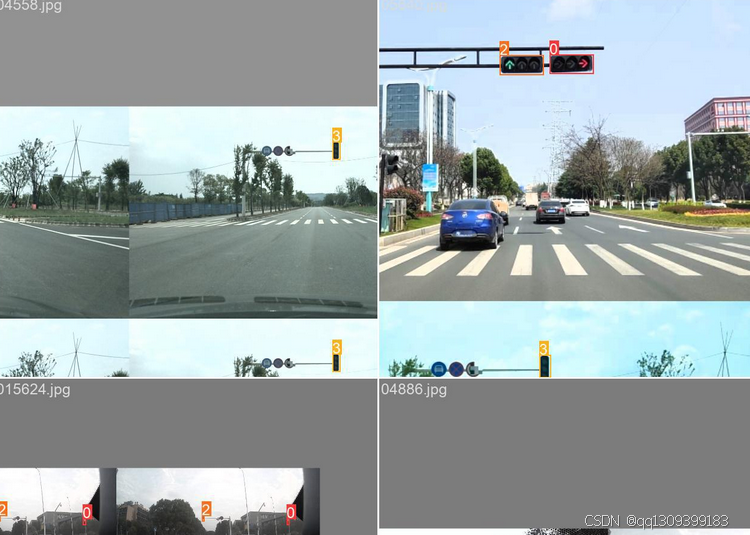

数据集配置

从你的配置文件来看,数据集的路径和类别信息已经基本定义清楚:

• 数据集根目录:path: light/

• train: 训练集路径,指向 light/train/images,包含4张图片。

• val: 验证集路径,指向 light/val/images,包含4张图片。

• test: 测试集路径未定义(可选)。

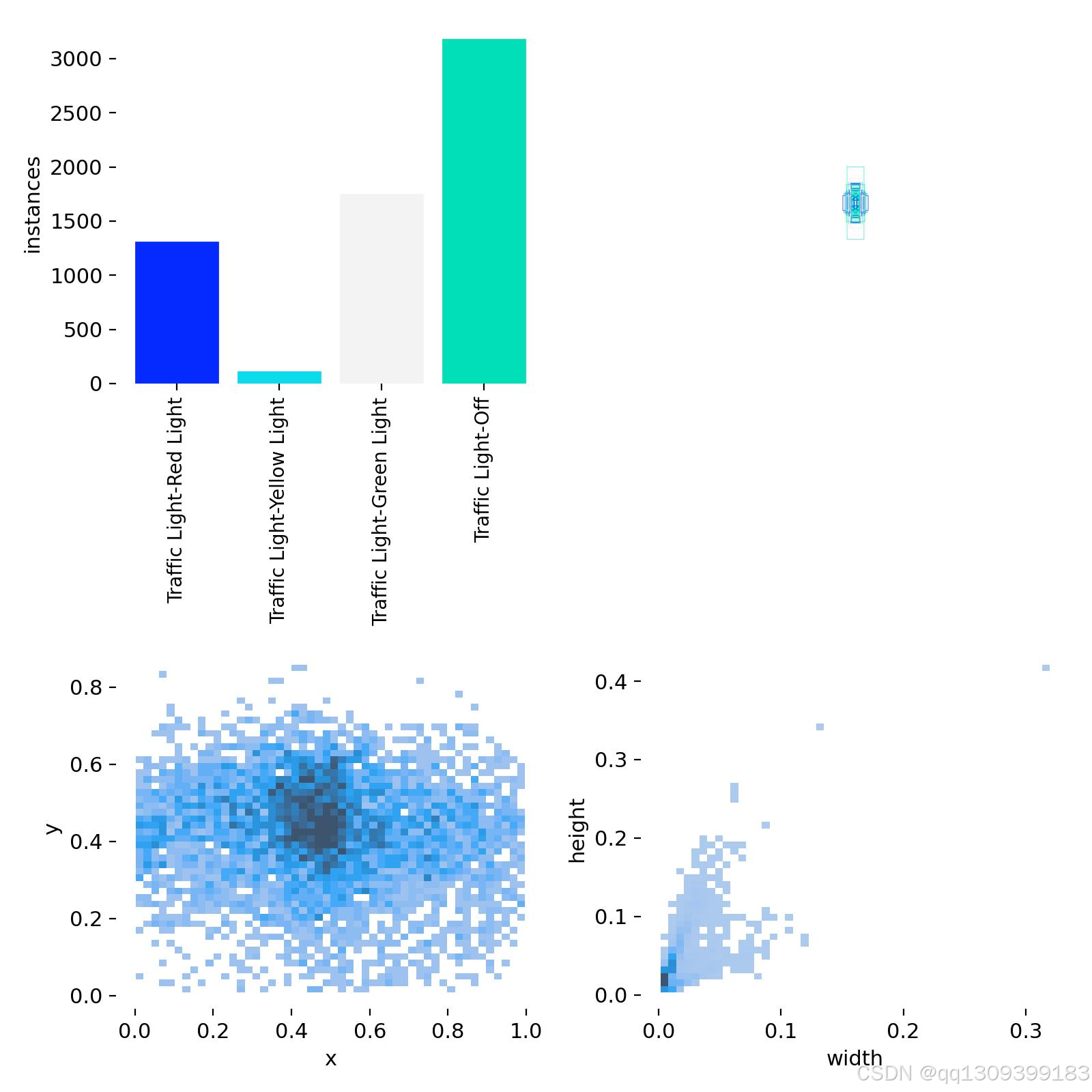

• 类别数量:nc: 4,表示数据集中有4个类别。

• 类别名称:

• Traffic Light-Red Light:红灯。

• Traffic Light-Yellow Light:黄灯。

• Traffic Light-Green Light:绿灯。

• Traffic Light-Off:信号灯熄灭状态。

从配置来看,这是一个小规模数据集,仅包含4张图片。为了训练一个高性能的YOLOv11模型,数据集的规模和多样性需要进一步扩展。

数据集扩展建议

-

数据收集:

• 收集更多交通信号灯的图片,建议从公开数据集中获取,例如:

◦ [KITTI 数据集](:包含多种交通场景的图片。

◦ [BDD100K 数据集]:包含10万张驾驶场景图片,其中有丰富的交通信号灯标注。

◦ [AI City Challenge]:专注于智能交通的竞赛数据集,包含交通信号灯检测任务。

• 如果条件允许,可以通过实地拍摄获取真实场景的图片。

-

数据增强:

• 使用数据增强技术扩充数据集,提升模型的泛化能力。常见的数据增强方法包括:

◦ 随机旋转、翻转、裁剪。

◦ 调整亮度、对比度、饱和度。

◦ 添加噪声或模糊处理。

• YOLOv11支持在训练时直接使用数据增强参数,例如:augmentations: - random_flip - random_brightness - random_contrast

-

数据标注:

• 使用标注工具(如LabelImg、CVAT)对图片中的交通信号灯进行标注,生成YOLO格式的标注文件(.txt文件)。

• 每个标注文件的内容格式如下:<class_id> <x_center> <y_center> <width> <height>其中,

<class_id>是类别编号(如0表示红灯,1表示黄灯等),<x_center>和<y_center>是目标框中心点的归一化坐标,<width>和<height>是目标框的归一化宽高。 -

数据集划分:

• 将数据集划分为训练集、验证集和测试集,建议比例为7:2:1。

• 确保每个类别的样本分布均匀,避免某些类别样本过少导致模型偏向某些类别。

模型训练

YOLOv11的训练过程相对简单,以下是一个示例命令:

python train.py --data your_data.yaml --weights yolov11n.pt --epochs 300 --batch-size 16 --img-size 640

• your_data.yaml:数据集配置文件。

• yolov11n.pt:YOLOv11的预训练权重。

• --epochs 300:训练300个epoch。

• --batch-size 16:每次训练的批量大小。

• --img-size 640:输入图片的分辨率为640x640。

如果数据集较小,可以适当减少batch-size,以避免显存不足的问题。

模型优化

-

学习率调整:

• 使用学习率调度器(如Cosine Annealing、ReduceLROnPlateau)动态调整学习率,提升模型的收敛速度和精度。 -

损失函数优化:

• YOLOv11默认使用CIoU损失函数进行目标框回归,可以尝试其他损失函数(如DIoU、GIoU)以进一步提升检测精度。 -

模型轻量化:

• 如果需要部署到嵌入式设备(如NVIDIA Jetson Nano),可以使用YOLOv11的轻量化版本(如YOLOv11n)以减少计算量。 -

多尺度训练:

• 在训练时启用多尺度训练(multi-scale training),使模型能够适应不同分辨率的输入图片。

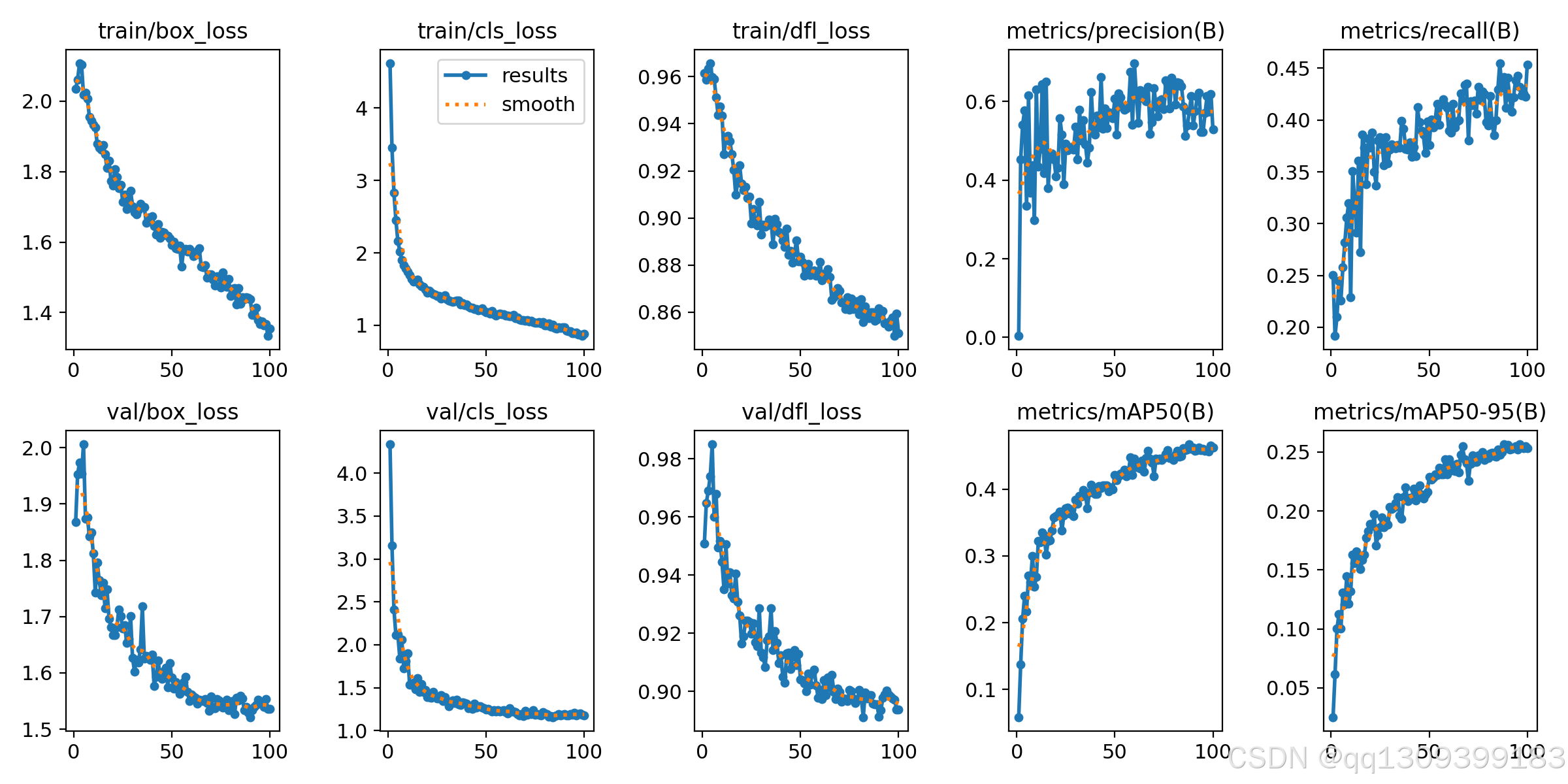

模型评估

-

评估指标:

• 使用YOLOv11提供的评估工具,计算模型的mAP(平均精度均值)、F1分数等指标。

• 重点关注小目标和复杂场景下的检测效果。 -

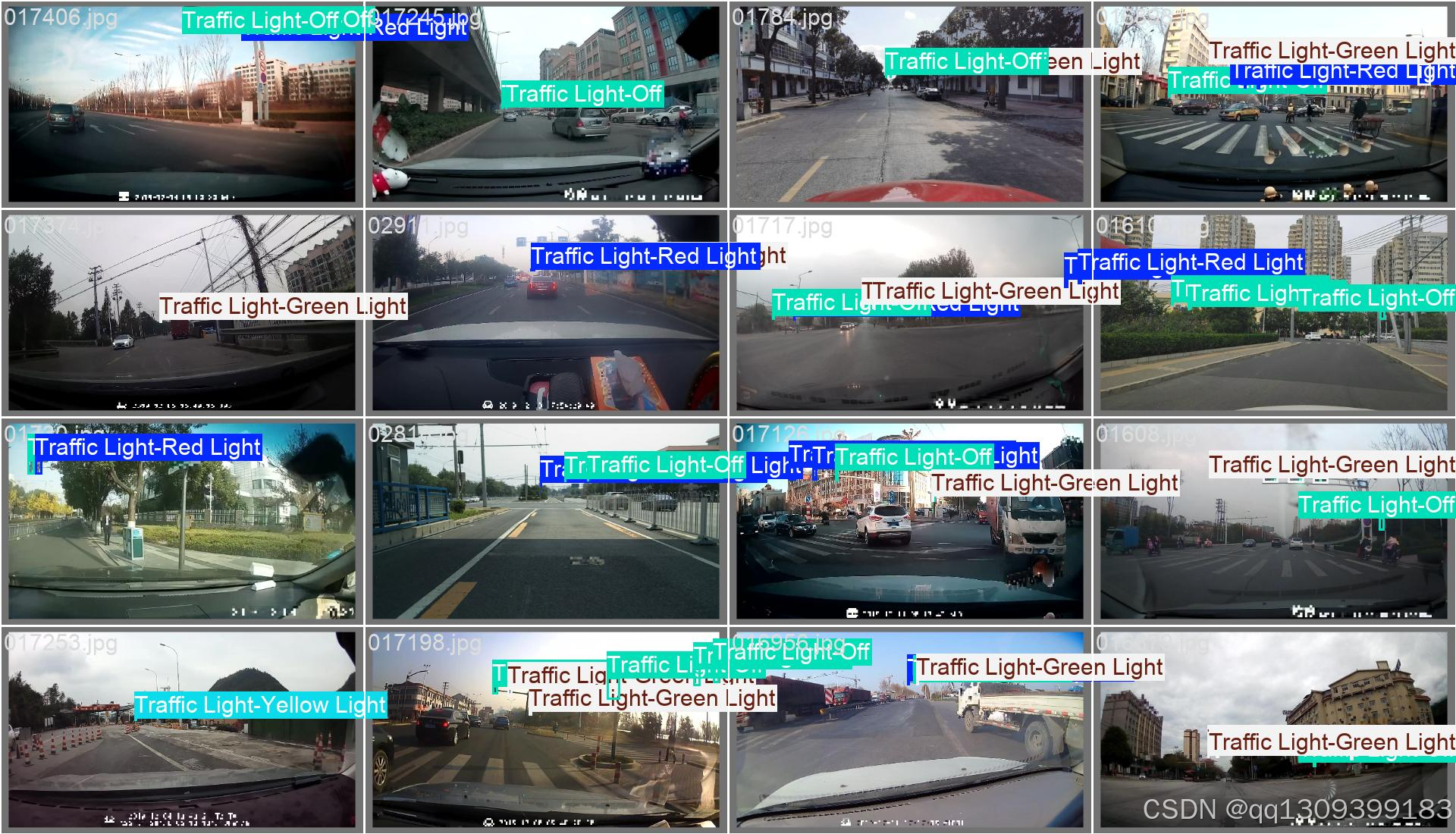

可视化结果:

• 使用YOLOv11的推理功能,对验证集或测试集进行预测,并将结果可视化:python detect.py --weights yolov11n.pt --source light/val/images• 可视化结果可以帮助发现模型在哪些场景下表现不佳。

部署与应用

-

模型导出:

• 将训练好的模型导出为ONNX或TensorRT格式,以提升推理速度。

• 示例命令:python export.py --weights yolov11n.pt --include onnx -

实时检测:

• 在嵌入式设备或移动设备上部署模型,实现实时交通信号灯检测。

• 结合OpenCV或其他图像处理库,对摄像头输入的视频流进行处理。 -

集成到智能交通系统:

• 将交通信号灯检测模块集成到自动驾驶系统或智能交通管理系统中,用于辅助驾驶或交通流量监控。

示例代码

以下是一个简单的YOLOv11推理代码示例:

from ultralytics import YOLO

# 加载模型

model = YOLO('light.pt')

# 推理

results = model.predict(source='light/val/images/001.jpg')

# 可视化结果

results[0].show()

总结

YOLOv11是一个非常适合交通信号灯检测的算法,其高效性和灵活性使其在智能交通领域具有广泛的应用前景。通过扩展数据集、优化模型训练和评估流程,可以进一步提升模型的性能。在实际应用中,结合嵌入式设备和智能交通系统,可以实现更高效的交通管理。

如果你有更多具体问题(如数据集不足、模型训练报错等),可以提供更多细节,我会尽力帮助你解决!

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?