论文作者:窦春柳,天津大学,研究方向:知识图谱

论文链接:http://arxiv.org/abs/2204.12111

代码地址:https://github.com/DOU123321/FAEA-FSRC

摘要

小样本关系分类(Few-shot Relations Classification, FSRC)旨在仅有少量样本下识别给定文本中两个实体间的语义关系。逆关系在小样本关系分类中普遍存在,其具有相似的语义和不同的语法结构,所以区分逆关系的关键是捕捉语法结构差异。现有工作采用语义级注意力机制关注表达语义的实词(例如,名词或动词),而表达语法结构的虚词大多被忽略,对逆关系分类的性能显著降低。我们提出了一个自适应增强虚词注意力的框架(Function words Adaptively Enhanced Attention Networks, FAEA)用于小样本逆关系分类。在FAEA中,设计了一个基于元学习的混合注意力模型来关注类别相关的虚词。由于虚词的引入带来了显著的类内冗余,因此设计了一种自适应消息传递机制在实例间捕获和传递类间差异信息和类内共性信息。最后,我们从理论上证明设计的信息传递机制有效消减虚词引入带来的类内冗余。在公开的小样本关系分类数据集 FewRel1.0 和 FewRel2.0 上的实验证明了我们提出的方法的有效性。

动机和思路

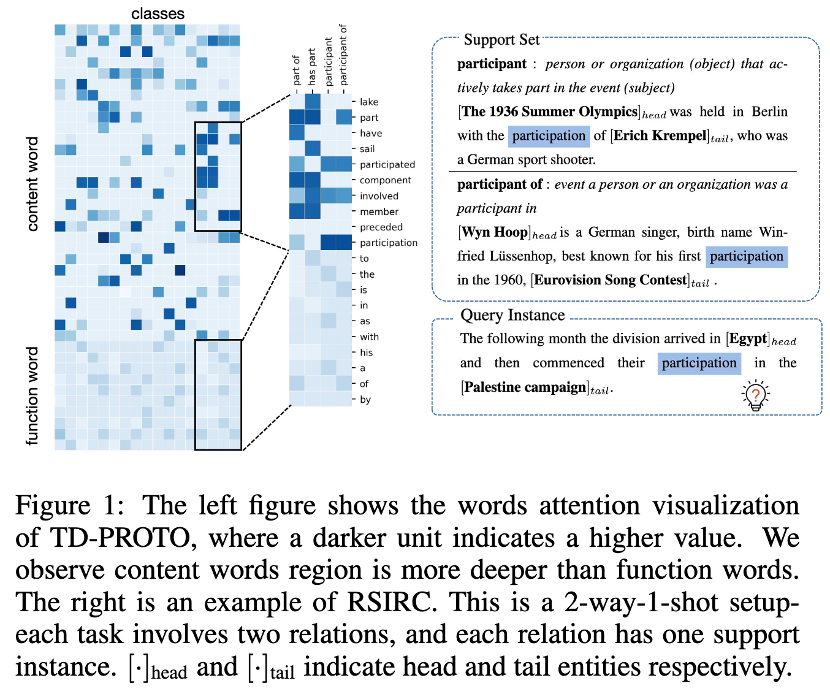

小样本关系分类模型已经取得了显著的成绩,性能已经达到人类水平。然而,通过实验发现,当输入的关系集包含逆关系时,现有的小样本关系分类模型的性能会显著降低,尤其在 1-shot 场景下分类准确率下降了 32.69% 左右。图1展示了一个小样本逆关系分类(Few-shot Inverse Relations Classification, FSIRC)任务,其中关系集包含两个关系‘participant’ 和 “participant of ’。从这两个支持实例中,可以看到 ‘participant’ 和 “participant of” 是逆关系。我们注意到,‘participant’ 和 “participant of” 有相同的实词 ‘participation’,但有不同的虚词 ‘of’ 和 ‘his’ 。图1左侧展示了FSRC模型的词注意力分布,可以看到现有的FSRC模型侧重于关注实词之间的差异,忽略了虚词间的差异。因此,当对逆关系进行分类时,这些模型的性能不佳。

为了解决丢失虚词表达的语法结构差异问题,我们提出了基于自适应增强虚词注意力的框架实现小样本逆关系分类。利用混合注意力模型捕获类别相关的虚词,同时通过自适应信息传递机制减少虚词对于类内信息带来的消极影响。

贡献

我们的贡献包括以下三点:

1.提出了小样本逆关系分类框架,设计混合注意力模型捕获类相关的虚词并设计自适应信息传递机制减少虚词引入带来的类内冗余,获得判别性关系表示。2.从理论上证明虚词的引入会增加类内差异信息,同时设计的信息传递机制有效消减这种冗余。3.在公开的小样本关系分类数据集 FewRel1.0 和 FewRel2.0 上进行的实验表明,我们的模型显著优于基线模型,尤其是在FSIRC任务中。消融实验证明了各模块的有效性。

模型

整体框架

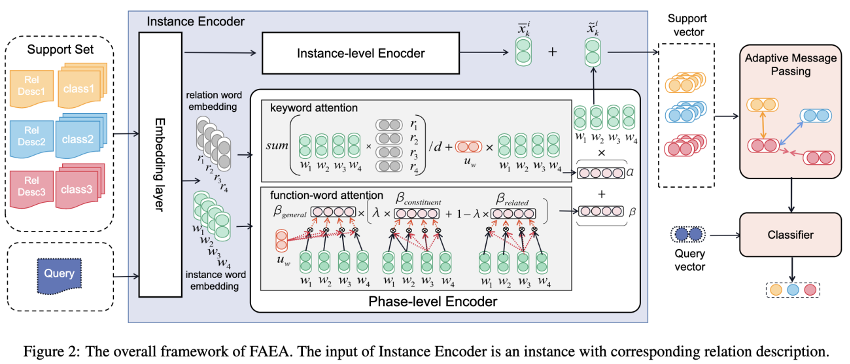

下面详细介绍我们提出的自适应增强虚词注意力网络的总体框架。如图2所示,我们的模型由三部分组成。

•实例编码器:给定一个实例和相应的实体对,我们使用实例级全局编码器和短语级局部编码器对实例编码。•虚词增强注意力:短语级局部编码器利用虚词增强注意力去捕捉实例中的重要虚词。•信息传递机制:在对实例编码之后,在同类实例之间传递共性信息,在异类实例之间传递差异信息。

实例编码器

对于输入的一个实例 ,包含l个单词。我们使用 BERT作为编码器以获得实例相应的上下文嵌入 。对于第 i 个关系 ,本文将关系名称与关系对应描述连接并输入 BERT,得到关系的词嵌入表示 ,关系特征 由 [CLS]标记对应的隐藏状态得到(本文通过设计一个线性变换转换为2d的表示)。对于实例 和查询实例 中,我们的模型生成全局实例嵌入和局部短语嵌入。下面以 为例进行说明。

实例级别全局编码器:全局特征 是通过连接头尾实体起始词牌位置对应的隐藏状态获得的。

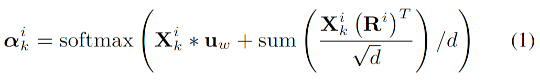

短语级别局部编码器:局部编码的主要过程包括学习一个关键实词注意向量 和一个虚词注意力向量 。关键实词注意向量计算如下所示:

其中记忆单元 是一个可训练参数, 帮助我们从实例中选择通用实词。

虚词增强注意力

在小样本下,直接学习每个类别的虚词重要性分布会产生过拟合现象。受元学习思想启发,我们利用通用虚词注意力模块先学习一个通用的虚词重要性分布,再利用具体类别虚词注意力模块通过少数样本对通用虚词分布微调获取每个类别的虚词重要性分布。其中,具体类别虚词注意力由和组成。

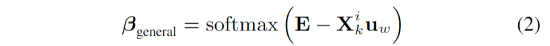

通用虚词注意力模块:我们通过降低与 相关的单词的重要性,提升 无关的单词的重要性,来计算通用虚词的重要性 ̃ ,其中 E 是一个全1矩阵:

具体类别虚词注意力模块:考虑到虚词的重要性会随类别的变化而变化,设计了一个具体类别虚词注意力模块,主要包括学习一个连续注意力矩阵 和语义相关注意力矩阵 ,并利用它们来加强与关键实词相近的虚词的注意力,最后得到具体类别下虚词注意力分布。

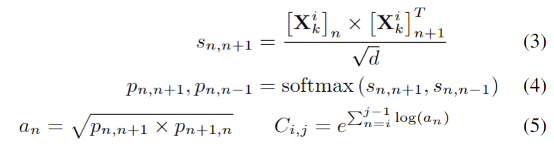

连续注意力矩阵的元素 表示单词 和单词 在实例 中属于同一短语的概率,计算如下所示:

首先,通过点积操作计算分数 ,它表示单词 和右邻居 属于同一短语的趋势。根据单词 或者与右邻居 属于同一短语,或者与左邻居 属于同一短语的事实,本文将 约束为或属于它的右邻居或左邻居。由于 和 可能有不同的取值,本文将其平均得到 。

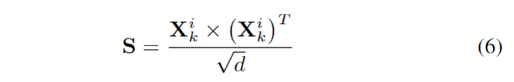

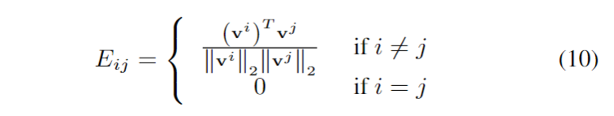

此外,使用自注意力机制计算语义相关矩阵S,去关注一些远离关键实词却必要的虚词:

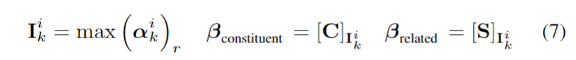

接下来,在实例 中找到关键实词索引 ,并根据索引从矩阵C和矩阵S中找到相应行的虚词注意力以加强相关虚词, 表示找到注意力前 r 大的关键实词的对应索引,r 为设定的关键实词的个数:

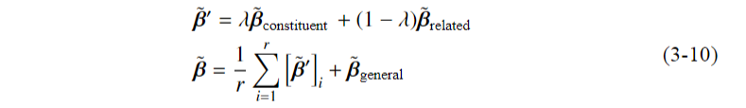

最后,模型利用三种注意权重形成短语级别注意力向量,其中 λ 为超参数:

自适应信息传递

自信息传递模型用于减少类内冗余,并自适应地控制类间消息的传输比例。首先, 构建并初始化一个有向图 G = (V, E), 是一组经过增强虚词模型编码的实例特征, 实例的个数 , 是一个邻接矩阵, 其中 [; ] 表示按行拼接, 表示 V 的第 i 行。

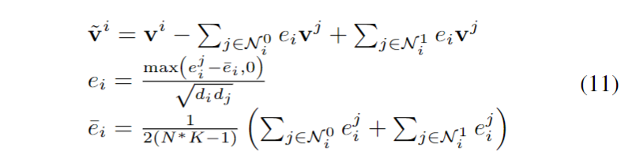

本文设计了一种新的节点方式,让相邻的类内节点传递类内相似信息,相邻的类间节点传递类间差异信息。

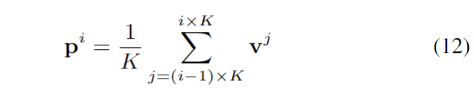

对于第 i 个关系 ,本文对相应的 K 个支持实例的节点表示进行求和平均形成关系原型表示 pi:

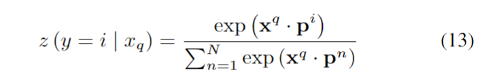

得到 N 个关系的原型表示后,模型计算查询实例 属于第 i 个关系的概率:

实验结果

•小样本关系分类

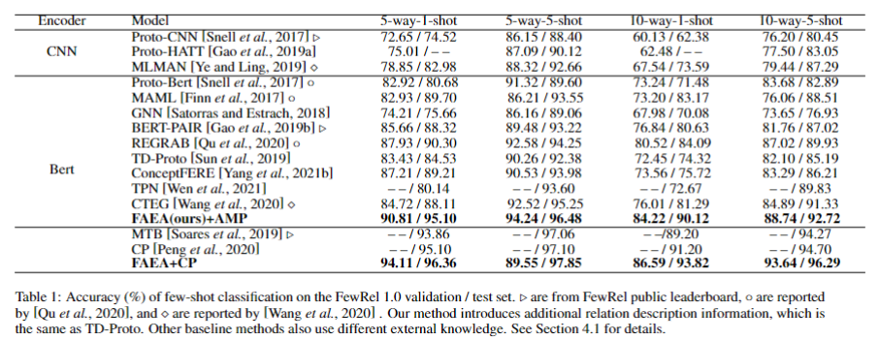

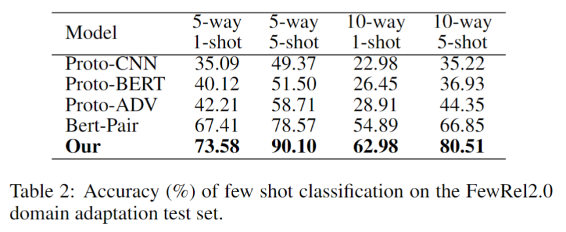

对于小样本关系分类任务,我们在公开的小样本关系分类数据集 FewRel1.0 和 FewRel2.0上对模型进行了评估,从四方面选择基线模型:仅考虑全局特征的模型、仅考虑实词特征的模型、引入外部知识的模型、预训练关系抽取模型。

实验结果如下几个表格,

当编码器使用 Bert 时,增强虚词的注意力网络模型 FAEA明显优于强基线模型,特别是在 1-shot 的场景。与第二优方法相比,在 5-way-1-shot 和 10-way-1-shot 设定下分类准确率分别提高 4.80% 和 6.06%,表明模型卓越的关系分类能力。此外,在不引入额外知识情况下模型的性能与关系分类预训练模型 MTB 的性能在 1-shot 场景下仅相差 0.15%。

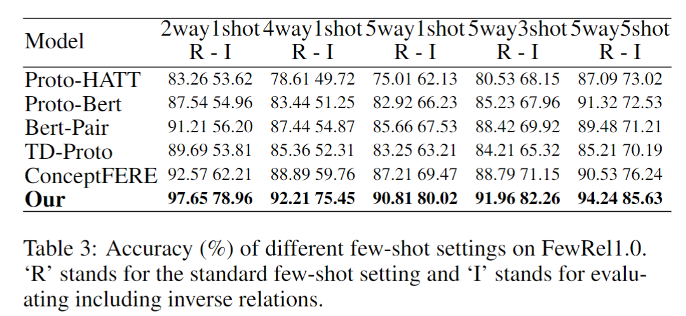

•小样本逆关系分类

为了进一步说明本文方法的有效性,特别是对细粒度的小样本逆关系分类任务,本文在FewRel1.0 验证集上设置不同场景评估模型处理逆关系分类的性能,如下表所示。‘R’表示从验证集中随机抽取指定数量的关系类别,是小样本关系分类一般的评估设定。‘I’表示从验证集中抽取指定数量的关系类别并且一定包含逆关系。评估模型在这两种场景下性能表现

ConceptFERE 基线模型在随机设定下准确率平均达到 89.59%,而在逆关系设定下准确率显著下降,特别是 1-shot 场景中平均下降 32.69%,说明现有模型在小样本下无法捕捉细粒度逆关系间语法结构的差异,小样本下学习这种细微差异变化是极具挑战性的。FEAE 在随机设定下准确率平均高达 92.32%,相较于第二优模型提升 2.73%。在逆关系设定下,FEAM 在 1-shot 场景中准确率平均下降 15.71%,相较于第二优模型提升 16.98%,证明 FEAM 模型能够捕获逆关系间的差异并处理小样本逆关系分类任务。

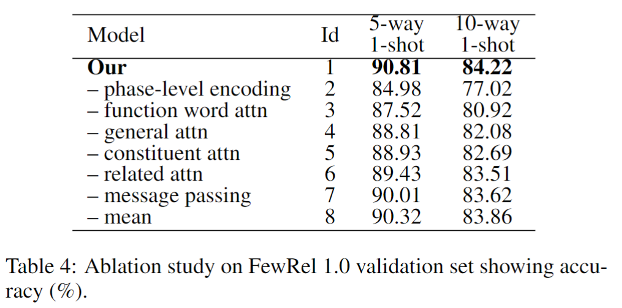

我们对模型各组件也进行了消融实验,证明了每个组件的有效性和必要性。消融实验结果如下:

更进一步的,我们对案例进行分析,结合注意力权重可视化说明虚词增强的效果。在FewRel数据集中证明了我们的模型有效增强虚词的注意力,对小样本逆关系有效分类,符合我们的动机。

总结

本文为解决小样本下忽略虚词丢失语法结构差异的问题,基于元学习设计一个获取具体类别的虚词重要性分布框架,思想是先学习虚词通用重要性分布,再通过少数样本微调通用分布。其次,在微调通用分布阶段由于虚词没有语义难以捕捉,利用实词与虚词的依赖关系学习具体类别的虚词重要性分布。此外,由于虚词的引入带来了显著的类内冗余,本文基于图网络提出了一种自适应信息传递机制。传统图网络更新方法的一个缺点是,经过一系列更新后,邻居节点会变得相似。为了克服这个缺点,本文设计了一种新的更新方法使相邻的类间节点能够传递差异信息。本文通过实验验证了所提出方法的有效性,实验结果表明该方法能有效地捕捉到关键虚词,并提高小样本逆关系分类任务下的性能。本文所提出增强虚词的方法不仅适用于关系分类任务,也可以广泛应用于其他NLP的任务上(如情感分类、意图识别),对小样本文本的语义理解类任务带来了新的思考方向,欢迎大家与我们探讨交流。

OpenKG

OpenKG(中文开放知识图谱)旨在推动以中文为核心的知识图谱数据的开放、互联及众包,并促进知识图谱算法、工具及平台的开源开放。

点击阅读原文,进入 OpenKG 网站

1466

1466

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?