如果做一个调查,大家心目中的无人车应该装配什么传感器、进行怎样的组合、使用何种策略,才能达到最优解,相信一万个人会有一万种不同的想法。

本期博闻驭识 U-Logue课堂就带大家走进无人车传感器的前世今生以及实际案例中的应用。

自动驾驶传感器概况

以下图的RoboTaxi为例,车上安装有激光雷达、摄像头、超声波雷达、毫米波雷达、轮速计/IMU、RTK等传感器。其中激光雷达、摄像头、超声波雷达、毫米波雷达被称为感知类传感器,相当于人类驾驶员的眼睛和耳朵。

谈到激光雷达就不得不说威力登(Velodyne)这个品牌,在2007年的美国国防部无人车竞赛上,6支完赛的车队,其中的5支都使用了他们家的激光雷达。从此以后,激光雷达一战成名,在江湖上名声大噪。

摄像头最早是由数码相机技术过渡而来,然后开始在手机和安防领域使用,逐渐发展壮大。汽车大概在2010年的时候开始安装使用摄像头,到现在已经非常普遍,比如大家经常使用的360环视系统、倒车影像等。

毫米波雷达在乘用车上使用较多,可以结合摄像头用于实现AEB自动紧急制动功能。超声波雷达主要用于倒车,在汽车上常作为倒车雷达使用。

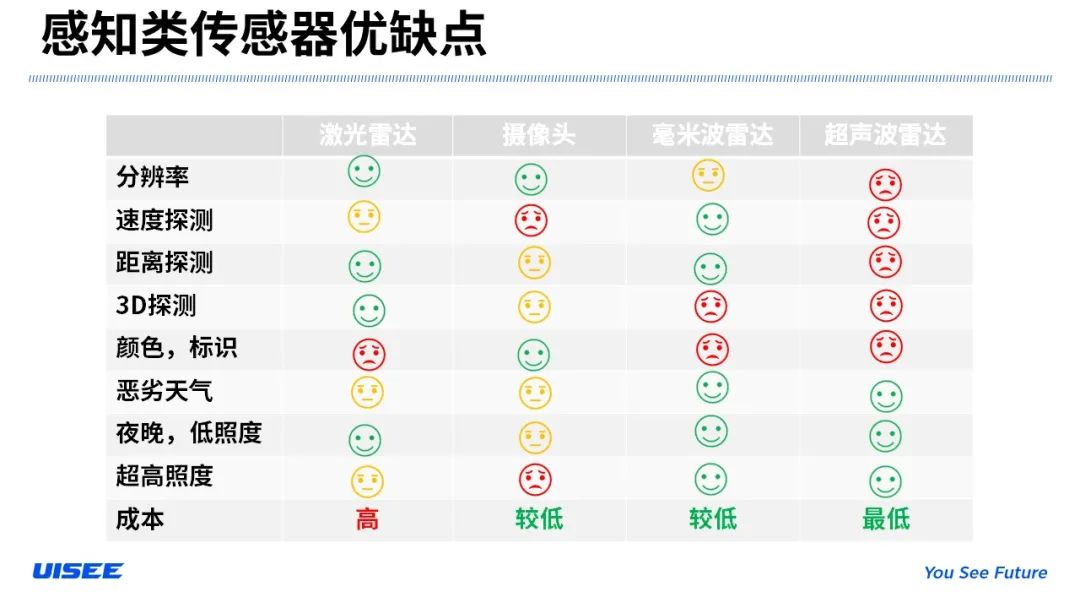

不同类型的传感器,都有各自的优缺点。从目前发展的阶段来看,激光雷达的测距远,毫米波雷达可穿透雨雪雾,摄像头的高像素和色彩信息,各种传感器优势互补,仍将长期共存。

在分辨率上,摄像头的分辨率是最高的,现在有100万、200万、800万甚至更高分辨率的摄像头。激光雷达从16线起步,现在已经出现了128线的激光雷达。两类波类传感器分辨率则相对较差。

在速度探测方面,毫米波最具优势,因为它可以通过多普勒效应,直接探测出速度。激光雷达同样可以测速,如果使用FMCW激光雷达的话,效果和毫米波是一样的。

在距离探测方面,激光雷达和毫米波性能是最好的。如果摄像头使用双目摄像头,测距性能也会有所提升。

在3D探测方面,激光雷达的点云是最好的。

在颜色和标识探测方面,摄像头有着得天独厚的优势,它是最接近人眼的传感器。

在恶劣天气下,超声波和毫米波基本不受影响。

在面对太阳直射或者远光灯的高照度时,激光雷达也会受到影响。

在成本方面,激光雷达的成本是最高的,超声波是最低的。

由此可见,完美的传感器并不存在,无人车所需要的是一个完善的传感器融合联动方案。

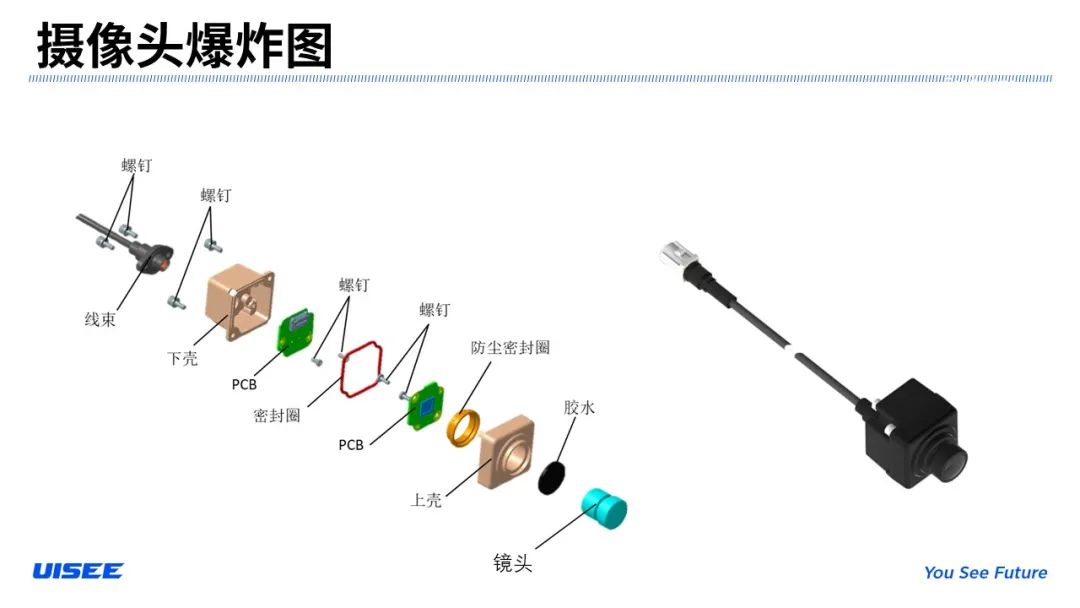

核心传感器之摄像头

摄像头是最接近人类视觉的传感器,无人车摄像头的硬件主要包括光学镜头、图像传感器、图像信号处理器ISP、串行器、连接器等器件。金属外壳和密封圈的存在极大提高了无人车摄像头的可靠性。安装在车外的车载摄像头防护等级需要满足IP69,运行温度区间则需要在-40~85°C之间,需要可靠稳定,抗震耐温以及低时延,高防护等的特性。

由于生产过程中存在工艺精度的限制,生产出来的摄像头不可能像人眼一样完美,每个摄像头总会有点“近视”或“远视”。生产工艺精度短期内难以改变,但是我们可以通过摄像头标定减小“近视”或“远视”的度数。通过标定能把生产的误差从+-10或+-5像素左右提高到+-2像素。

安装在无人车上的摄像头,每个都有一个序列号,相当于摄像头的身份证号码。它会对应内参的参数、图像的格式、触发的模式,还有摄像头的帧率以及它的版本。这样做的目的就是确保每一颗摄像头能够在整个生命流程中得到管控,随时实现对它的追溯。

每款摄像头都有距离和视野范围的短板,因此在配置时需要使用多颗不同焦距的摄像头进行组合。无人车上的摄像头也是如此,比如360环视摄像头用于观察车身周围较近的场景,也有用于建图和定位的摄像头和感知小目标或者高速运动物体的长焦距摄像头。

核心传感器之激光雷达

无人车激光雷达的原理主要源于光具有波粒二象性,TOF原理利用了光的粒子性,FMCW原理利用了光波的特性。雷达处理单元利用发射光和接收光的时间/相位差,频率差,可以计算出目标物距离,以及目标的3D点云,甚至直接输出速度。

激光雷达可以按照扫描方式、激光器驱动方式、探测器类别和波长进行分类。

按扫描方式:分为机械旋转式、半固态式、固态式和无扫描部件方式

按激光器驱动方式:分为EEL边发光激光器、VCSEL垂直发射激光器、光纤激光器

按探测器类别:分为雪崩光电二极管、单光子雪崩二极管、多通道光子计数器/硅倍增管

按波长:分为850nm、905nm、940nm、1550nm

从激光雷达的发展来看,可以分为1.0时代和2.0时代。

1.0时代的激光雷达为工规级别,优点包括可水平360度旋转、点云质量高、现有技术比较成熟,缺点在于体积大、重量大、不美观、使用寿命短、生产周期长。

2.0时代的激光雷达为车规级别,优点包括体积小、布置方便、质保可达3年,缺点是视角较小,通常是120度左右,通常需要在车身布置4-6个激光雷达。

传感器同步融合应用

由于摄像头和激光雷达的成像原理不同,前者采集的是图像数据,后者采集的是点云数据,两者的时间/空间记录也有一定差异,这就需要对不同传感器的数据在时间和空间维度进行 “融合”。

现在普遍的做法是 “后融合”,简单说是对不同传感器的硬件返回的数据,由各自独立的软件算法模块做处理得到目标感知的结果之后,再做一次目标级的融合。“前融合”则是要在点云和图像数据被算法处理前先做数据层面的前端融合,再进行算法处理,得到目标感知结果。它的优点是可以让不同传感器取长补短,对不同传感器之间的时间对齐精度也要求较高,误差需要保持在毫秒级甚至更高,以提升车辆的感知精度及鲁棒性。

做好传感器的“融合”有什么作用?

在高速行驶的无人车上,摄像头和激光雷达的硬同步融合就非常重要,融合后目标物一致,感知精度和置信度能够大幅提高,鲁棒性也会更强。

在许多实际的无人车运营场所,周围十分空旷,特征点太少,无法进行特征点定位,就必须依靠语义定位。而要做到高质量、高效率的语义建图,良好的摄像头和激光雷达同步就成为刚需。

核心传感器发展展望

对于摄像头来说,随着对无人车对高速度、感知距离需求的不断提升,一定会让摄像头继续向高像素、高帧率发展。从200万、800万到1200万,甚至现在已经有公司推出了1500万像素的摄像头。

同时无人车的摄像头会涉及到数据安全的问题,无人车高可靠、高安全的需求会推动功能安全、网络安全的发展。此外,公开路况也会推动高HDR、LFM、高SNR发展。

对于激光雷达来说,机械式和半固态/固态的激光雷达还会长时间共存,但半固态的激光雷达份额在乘用车上会越来越大。这也会推动它的生产工艺、生产效率的提升以及规模效应后成本的下降。

激光雷达终极方案一定会是芯片化和固态化。如果有一款产品,比如FMCW+OPA,它的激光发射器、扫描器件、感测器有一天可以完全集成在一个芯片上,这将会是一件令人非常期待的产品。

欢迎继续关注博闻驭识 U-Logue课堂,专家级讲师将带来更多关于自动驾驶的深度知识,带你一起驭见未来。

248

248

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?