学习率衰减的方法

如果在模型训练期间学习率是固定的,则loss可能会如下图所示波动。所以如何找到使学习率自适应的方法显得至关重要。

在实际训练中,根据epoch的次数降低学习率是一种比较直接的方法,下面是衰减的公式:

α

=

1

1

+

D

e

c

a

y

R

a

t

e

∗

E

p

o

c

h

N

u

m

b

e

r

∗

α

0

\alpha= \frac{1}{1+DecayRate*EpochNumber}*\alpha_0

α=1+DecayRate∗EpochNumber1∗α0

根据以上公式,下面举个例子,假设初始学习率α_0,衰减率为1,那么学习率随着epoch的增加效果如下:

| Epoch | α |

|---|---|

| 1 | 0.1 |

| 2 | 0.067 |

| 3 | 0.05 |

| 4 | 0.04 |

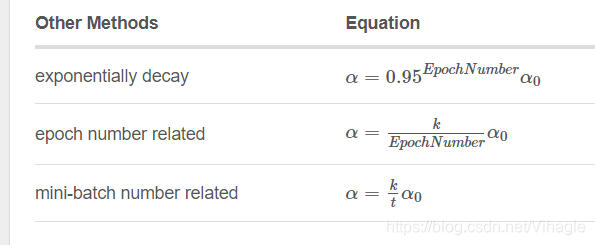

当然,我们这里还有一些别的衰减方法

349

349

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?