Transformer 与 CNN、RNN 一样属于深度学习模型。学习时将其看作是结构复杂的神经网络。

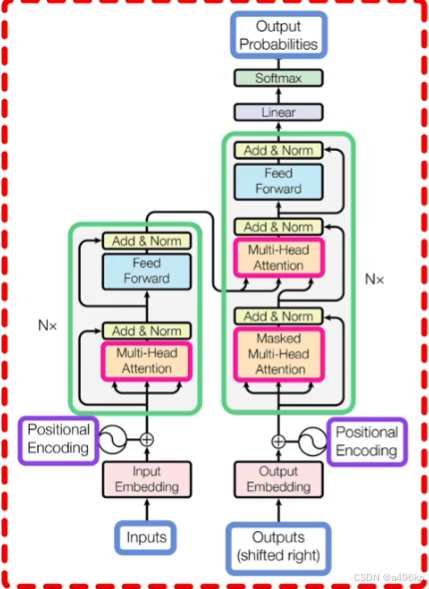

以上图片是tansformer的经典架构图。

整体包括:

模型的输入(input)和输出(output);

位置编码(PositioEncoding);

编码器-解码器结构(encoder-decoder);

多头注意力机制(Multi-head-Attention);

另外,模型中的子结构:

词向量(Embedding);

前馈神经网络(FeedForward);

残差连接(Add)和 层标准化(Norm);

线性层(Linear);

softmax层

这些子结构也会在文中顺带提及。

模型的输入和输出:

首先明确Transformer 的输入输出是什么。包含了架构图中的Input 与outputs。

输出则为架构图顶部的Output Probabilities。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?