上一节讲到的是对未知MDP的value function进行估计,这一节是对未知MDP的value function进行优化。估计这部分的东西可以用于预测,优化value function就可以用于控制。

使用Model-Free进行控制的例子:

On-Policy Learning:从经历过的样本中学习策略从

λ

中学习;

Off-Policy Learning:站在别人的经验上,从经历过的sample从

μ

中学习策略。

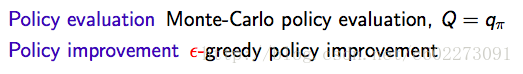

On-policy Monte-Carlo Control

在之前的学习中已经看到了policy evaluation和policy improvement的做法,但是把Monte-Carlo Policy加到里面就是:

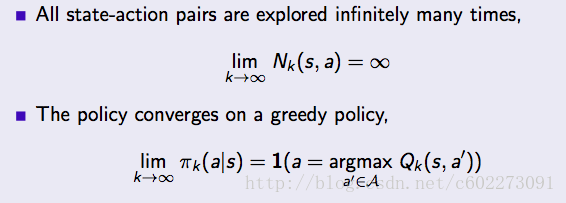

在进行policy优化的时候有一个叫做GLIE的概念,使得policy得以收敛。

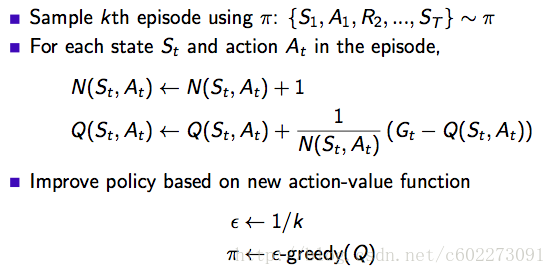

GLIE Monte-Carlo Control:

On-Policy Temporal-Difference Learning

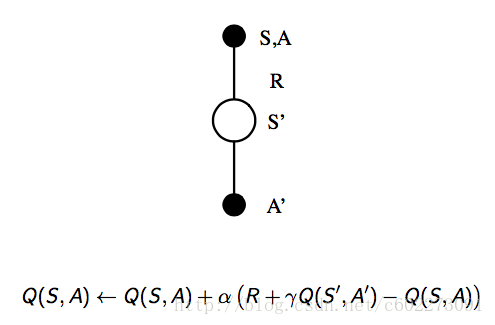

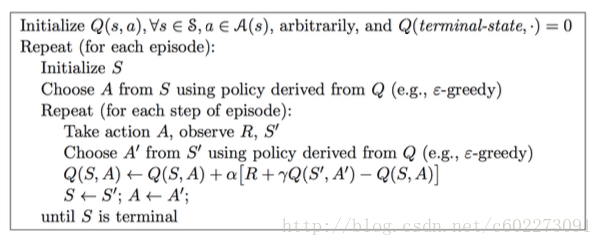

使用TD来进行控制,可以达到在线,每个时间戳都更新。使用Sarsa更新action-value function:

使用Sarsa算法在On-Policy Control上:

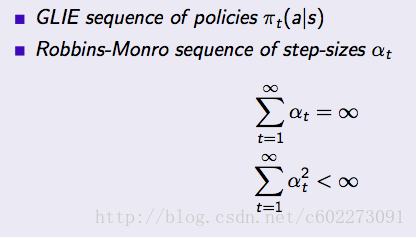

为了使得Sarsa收敛到优化的action-value函数,需要满足以下条件:

Off-Policy Learning

behavior policy定义:

使用Monte-Carlo对off-policy进行更新

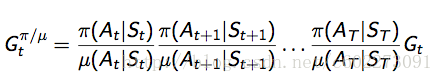

return reward:

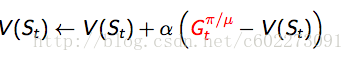

用来更新新的value:

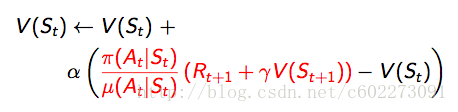

使用TD对off-policy进行更新

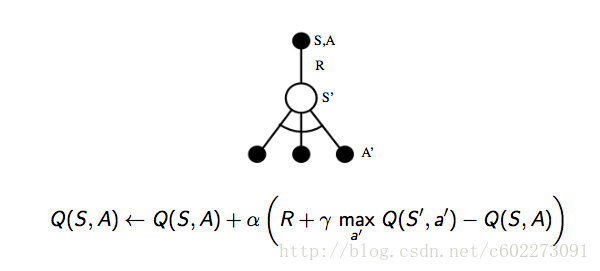

使用Q-learning进行off-policy的更新

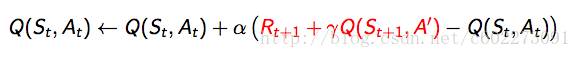

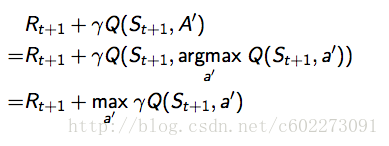

更新Q(st,At):

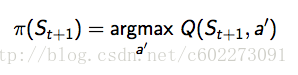

使用贪心算法获得policy:

用一个图表示:

Useful Links:

Video Lecture 5: https://www.youtube.com/watch?v=0g4j2k_Ggc4

Lecture 5 Slide: http://www0.cs.ucl.ac.uk/staff/d.silver/web/Teaching_files/control.pdf

4471

4471

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?