©PaperWeekly 原创 · 作者 | 李金膛

单位 | 中山大学博士生

研究方向 | 可信图学习

2020 年国家双碳战略的确立与实施,绿色低碳已经成为全社会的重要议题,也是科技从业者的重要使命和责任。有文献指出,从 2012 年到 2018 年,用于深度学习的计算资源消耗增长了 30 万倍,高能耗的特点使得深度学习广受诟病。在深度学习算法在工业届的应用日益增多的今天,算法效率和可扩展性成为制约其更加广泛应用的一个关键因素,如何构建鲁棒、有效、低能耗的预测模型,是一个重要的研究方向。

本文基于第三代人工神经网络——脉冲神经网络,聚焦于动态图表示学习场景,提出一种绿色高效的动态图表示学习方法。

论文题目:

Scaling Up Dynamic Graph Representation Learning via Spiking Neural Networks

论文链接:

https://arxiv.org/abs/2208.10364

代码链接:

https://github.com/EdisonLeeeee/SpikeNet

脉冲神经网络技术背景

随着深度学习技术的不断发展,模型算力得到了很大提升,但与此同时也面临着一个关键问题:神经网络涉及的计算成本和能耗究竟有多大?

如图 1 所示,根据马萨诸塞大学研究人员公布的最新研究 [1],训练一个常见的大型深度学习模型,该过程可排放超过 626,155 磅二氧化碳,相当于一辆普通汽车寿命周期碳排放量的 5 倍,一个普通人一生碳排放量的 57 倍。该研究结果揭示了目前 AI 领域面临的一个严峻问题:深度学习模型训练过程成本高昂,并且随着算力的提升,这一问题会日趋严重。

▲ 图1:二氧化碳排放量估计对比图[1]

尽管传统的人工神经网络在多项任务上取得了突破性的进展,但是能耗问题 却限制了其更加广泛的部署应用,为解决这一问题,脉冲神经网络(Spiking Neural Network,SNN)被提了出来。基于类脑计算框架下的 SNN 以脉冲神经元为基本计算单元,通过稀疏脉冲序列传递信息,被称为能耗更低的新一代绿色人工智能技术。

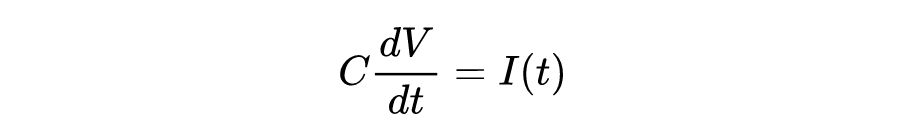

IF(Integrate-and-Fire)[2] 是一类经典的脉冲神经元模型,其假设脉冲神经元是一个理想的电容器,随着时间流逝逐渐累积电荷并且不存在任何泄露。因此,当施加在电容器上的电压越大,进入电容器的电荷就越多。这一关系可由公式 表示,其中 为电荷量, 为膜电压, 为电容常数。为描述神经元状态随时间变化情况,通过对时间进行微分,可以改写成如下的微分方程:

其中 为当前时刻 的输入电流。当膜电压积累的电荷超过阈值 时发射脉冲,并消耗神经元之前积累的电荷,电压下降至静息电位 ,神经元处于静息状态。然而,实际情况中,神经元并不是完美的电容器。相反,随着时间的推移,它们会慢慢地泄漏电流,将膜电压拉回到静息电位。

为了更好地模拟这一现象,研究人员提出了 LIF(Leaky Integrate-and-Fire)[3] 模型。LIF 通过额外引入一个衰减项,并将神经元的状态变化活动描述为电压输入和环境损耗的共同作用控制。

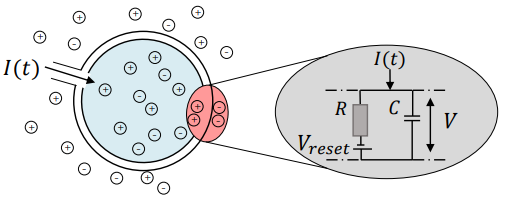

▲ 图2:LIF神经元的生物特性与电特性示意图

如图 2 所示,基于 LIF 模型的神经元可以看出是额外与一个电阻并联的电容器。因此,可以将上述的微分方程改写为:

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

5450

5450

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?