Dify 是一款开源的大语言模型(LLM)应用开发平台,融合 BaaS(后端即服务) 与 LLMOps(大模型运维) 理念,为开发者提供从原型设计到生产部署的全生命周期支持。通过模块化架构、可视化编排及多模型兼容性,Dify 显著降低了生成式 AI 应用的开发门槛。以下从技术架构、核心功能、部署实践及未来演进等维度展开解析。

一、Dify 架构设计与技术栈

1. 分层架构:模块化与可扩展性

Dify 采用分层架构,确保功能解耦与灵活扩展:

- 数据层:

- 数据集管理:支持结构化数据(CSV/Excel)与非结构化文档(PDF/PPT)的 ETL 处理,自动构建向量索引。

- RAG Pipeline:通过混合检索(关键词+语义)增强知识库查询,支持动态更新与版本控制

- 模块化增强:针对解析能力短板,可替换 HTML/Markdown 解析模块(如基于

html_text优化结构化信息保留),提升分片质量

- 开发层:

- Prompts IDE:可视化提示词编排工具,支持变量注入与多模型对比测试。

- Agent DSL:通过领域特定语言定义工具调用逻辑(如结合 Stable Diffusion 生成图片)

- 编排层:

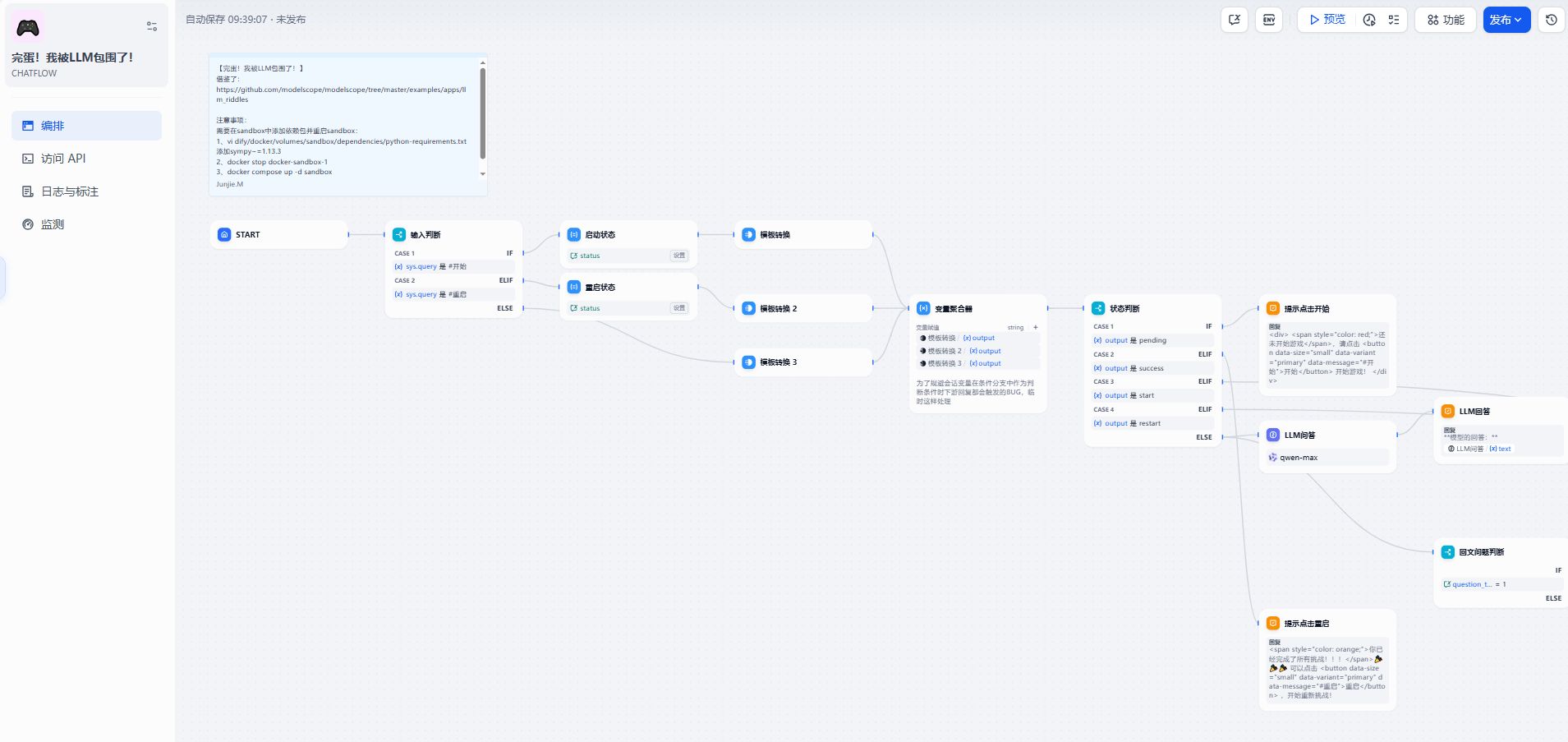

- 工作流引擎:基于 ReactFlow 实现可视化流程设计,集成审核系统(Moderation)与缓存机制(Redis),保障高并发稳定性

- LLMOps 监控:实时追踪 API 调用日志、模型响应延迟及 Token 消耗,支持性能调优

- 基础层:

- 依赖 PostgreSQL(元数据存储)、Weaviate(向量数据库)、Redis(缓存),支持分布式部署

2. 核心技术栈

- 后端:Python + Flask 提供 RESTful API,Celery 处理异步任务(如文档解析、模型推理)。

- 前端:React + TypeScript 构建交互界面,ReactFlow 实现工作流画布。

- AI 核心能力:

- RAG 引擎:支持 PDF/PPT 解析、表格转 Markdown、多模态文档处理

- Agent 框架:内置 50+ 工具(谷歌搜索、DALL·E),支持 ReAct 推理与函数调用链

二、核心功能与应用场景

1. 功能组件

- RAG 管道:

- 文档分片策略:基于

\n\n自动切分,保留上下文连贯性 - 混合检索:结合 BM25(关键词)与向量相似度,提升召回精度

- 文档分片策略:基于

- LLMOps 工具:

- 性能看板:统计模型调用成功率、响应时间分布,支持阈值告警

- 数据标注:人工标注生成结果,迭代优化提示词与检索策略

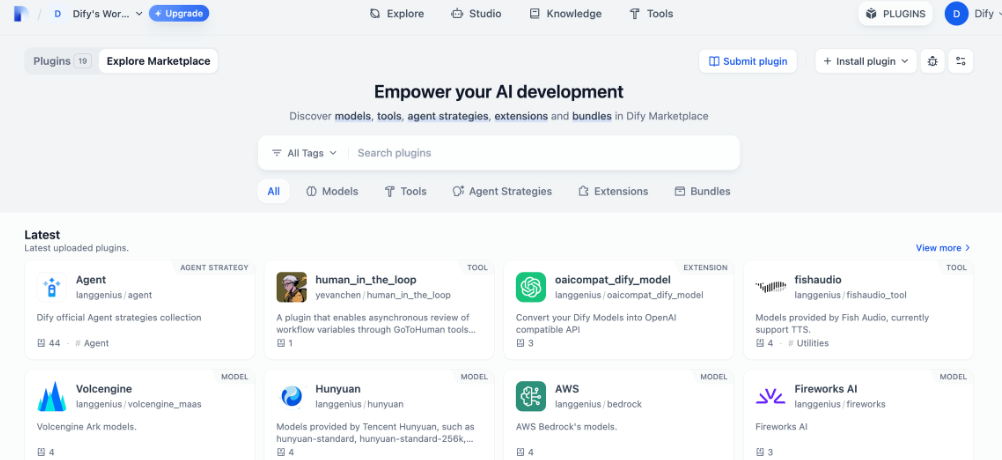

- 插件生态:

- 第三方工具集成:如 Ollama 本地模型推理、Stable Diffusion 文生图

2. 典型场景与实战案例

- 智能客服:

- 多轮对话优化:通过 语义相似度判断 动态补充历史上下文,解决 RAG 检索信息缺失问题

- 示例代码:基于 FastAPI 实现缓存 Agent,存储优化后的提问要素

- SEO 分析自动化:

- 工作流设计:集成 LLM(GPT-3.5)分析博客内容,输出关键词建议与元数据优化方案

- API 集成:通过 Dify 提供的 REST 接口嵌入企业系统,实现自动化 SEO 报告生成

- 深度研究助手:

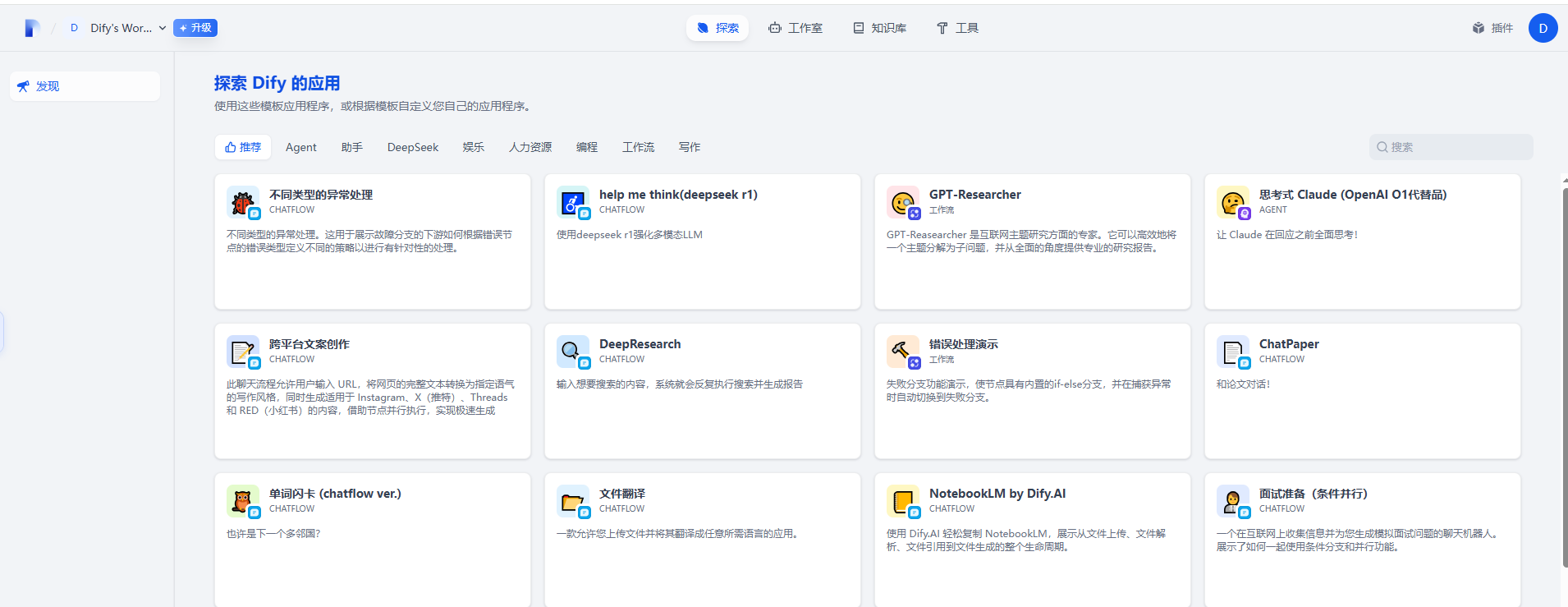

- 多步搜索与摘要:基于 DeepResearch 工作流,自动执行关键词扩展、信息聚合与报告生成

三、Dify 本地部署与线上体验指南

1. 本地部署(推荐私密场景)

优势:

- 数据完全本地化,无需上传至云端,保障隐私安全。

- 支持本地模型(如Ollama),避免依赖第三方API。

部署步骤:

1)克隆代码库

git clone https://github.com/langgenius/dify.git

cd dify/docker2)配置环境变量

cp .env.example .env # 复制默认配置- 端口调整(可选):若默认端口 80/443 冲突,编辑

.env修改EXPOSE_NGINX_PORT和EXPOSE_NGINX_SSL_PORT

3)启动 Docker 容器

docker compose up -d # Compose V2 命令- 检查容器状态:

docker compose ps # 确保所有容器状态为 "running"

4)访问系统与初始化

- 浏览器访问

http://localhost或http://本机IP - 首次进入需设置管理员账号(邮箱、用户名、密码)

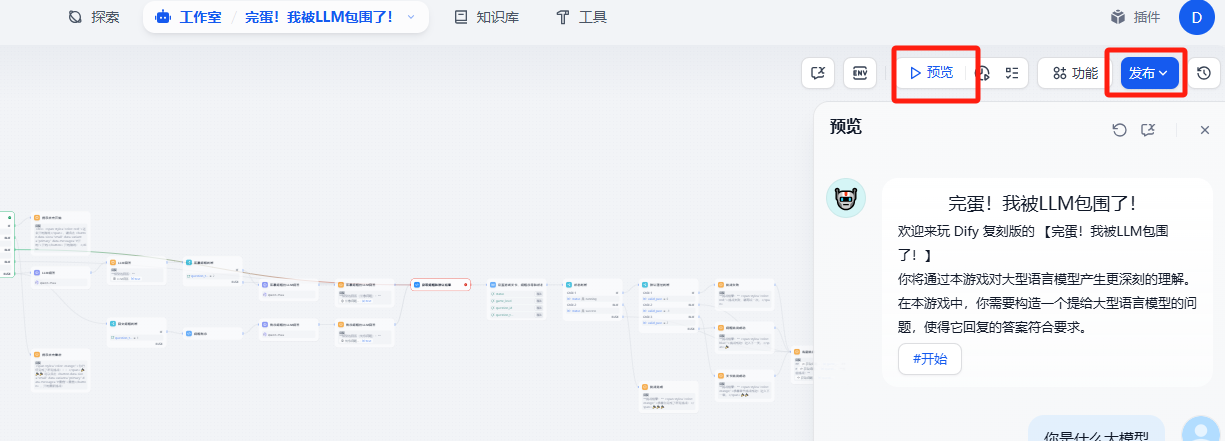

2. 线上快速体验(适合新手)

步骤详解:

- 注册账号:

- 访问 Dify官方平台,使用Gmail注册并登录。

- 访问 Dify官方平台,使用Gmail注册并登录。

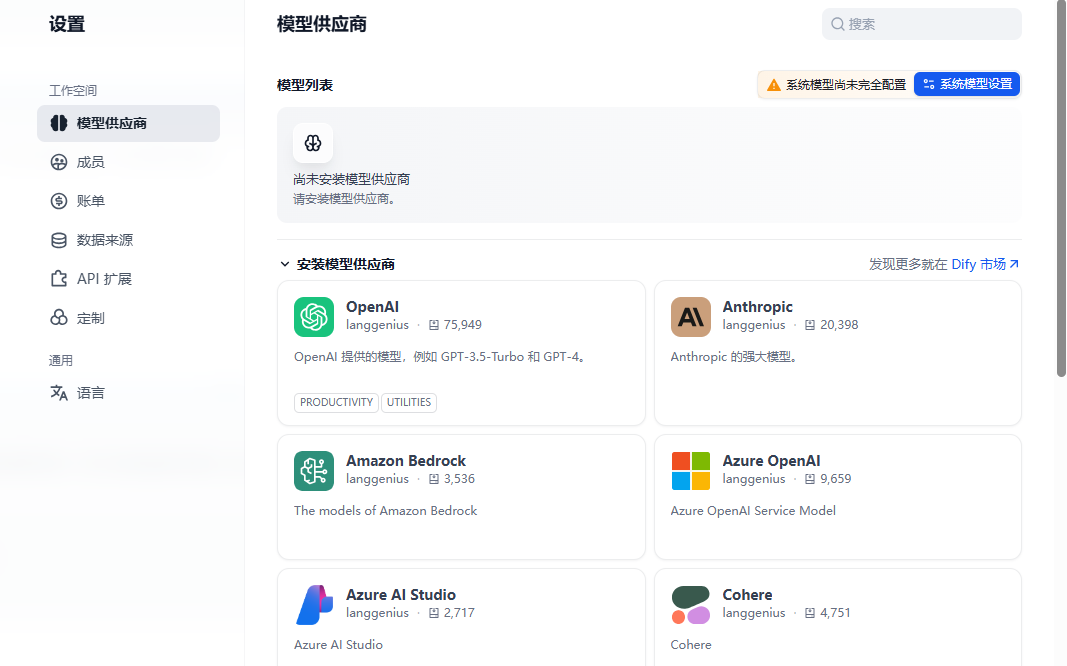

- 添加模型:

- 进入工作室,从模型库选择或添加自定义模型。

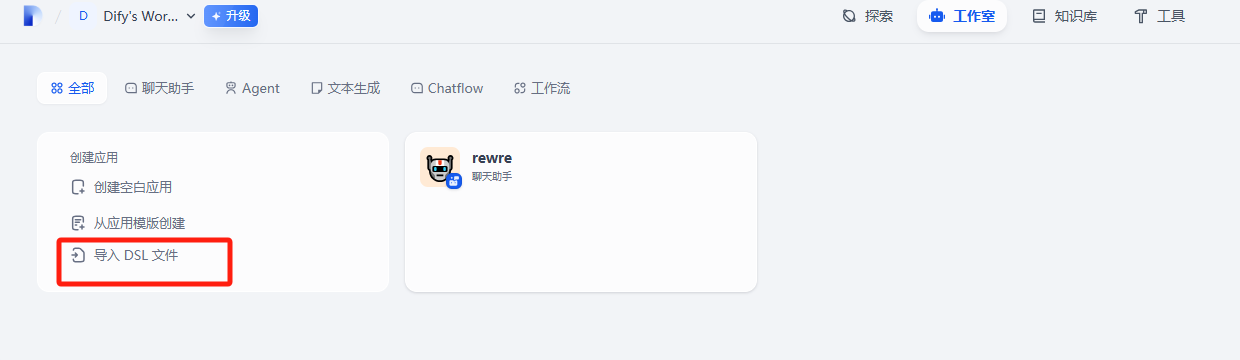

- 导入工作流:

- 点击“导入DSL文件”,上传从GitHub下载的YML文件(如

Agent工具调用.yml)。 - 注意:若提示模型不兼容(黄色叹号),可切换为其他支持的模型(如GPT-4)。

- 点击“导入DSL文件”,上传从GitHub下载的YML文件(如

- 运行与调试:

- 输入测试内容,点击“运行”。若代码节点报错,可直接将错误信息抛给AI修复。

- 发布应用:

- 成功后保存至工作室,后续可随时调用或分享。

- 成功后保存至工作室,后续可随时调用或分享。

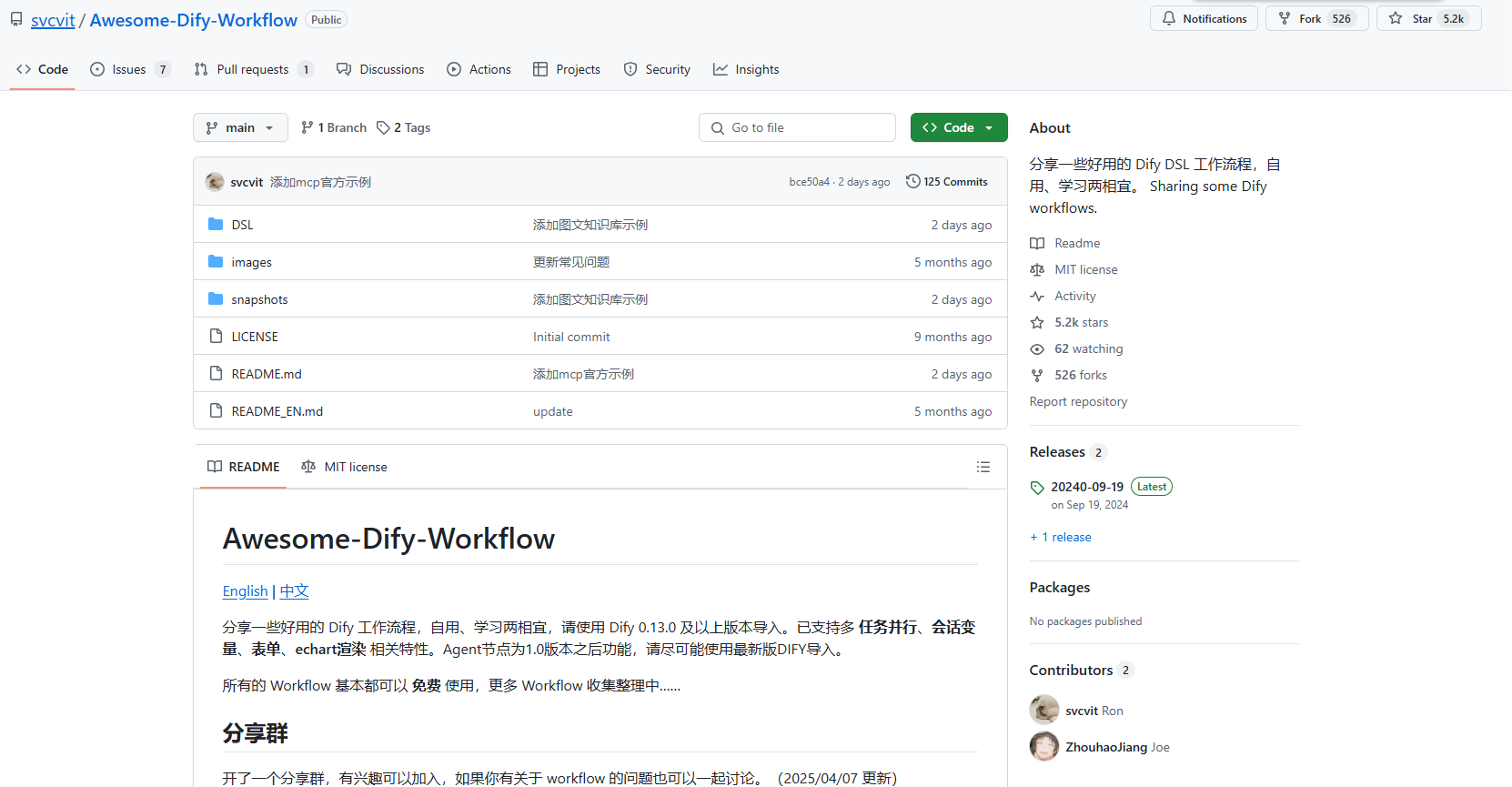

四、Dify工作流模板:Awesome-Dify-Workflow 项目概览

项目地址:https://github.com/svcvit/Awesome-Dify-Workflow

核心功能:分享可复用的 Dify DSL 工作流模板,支持多任务并行、会话变量、表单交互、图表渲染等特性,适用于个人学习与生产环境。

1. 工具类工作流

适用场景:多平台内容创作、SEO优化、自动化运营。

- 多平台发布:

Dify 运营一条龙.yml:一键生成跨平台(小红书/抖音/B站等)的封面图与文案。Text to Card Iteration.yml:迭代生成图文卡片,适配内容更新需求。

- 效率工具:

SEO Slug Generator.yml:为博文生成搜索引擎友好的URL短链。Document_chat_template.yml:基于知识库的客服问答模板。

- 自媒体辅助:

标题党创作.yml:生成高点击率标题。文章仿写-单图_多图自动搭配.yml:自动匹配图文内容。

2. 翻译类工作流

技术亮点:结合传统翻译引擎与AI模型,提升质量与效率。

- 高质量翻译:

宝玉的中译英.yml:通过“直译→反思→意译”三步骤优化译文。DuckDuckGo 翻译+LLM 二次翻译.yml:传统引擎初翻+AI润色,节省Token消耗。

- 进阶功能:

translation_workflow.yml:支持多参数(目标语言/国家等)的精细化翻译。全书翻译.yml(官方示例):长文本分块翻译后合并。

3. 聊天机器人类

智能交互:上下文记忆、意图识别、主动触达。

- 意图驱动:

根据用户的意图进行回复.yml:动态选择回复路径并风格化输出。

- 记忆增强:

mem0ai:支持上下文关联的连贯对话。记忆测试.yml:集成短期记忆与思维链(CoT),提升应答相关性。

4. 代码类工作流

开发者工具:快速生成与优化代码。

Python Coding Prompt.yml:通过自然对话生成Python代码片段。Claude3 Code Translation.yml:跨编程语言的代码转换工具。

五、总结

Dify 通过 低代码开发、全栈 LLMOps 与 开放生态,成为 LLM 应用开发的事实标准。开发者可快速构建智能客服、内容生成、研究助手等场景应用,同时通过模块化改造满足企业级需求。未来,随着多模态与性能优化的推进,Dify 有望进一步降低 AI 应用开发与运营成本。

1041

1041

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?