1、构建检索问答链

基于之前构建的数据库,结合大模型测试知识库在问答中的作用。

当利用知识库辅助大模型回答时:

persist_directory = '../data_base/vector_db/chroma'

embedding = QianfanEmbeddingsEndpoint(model="bge-large-zh")

vectordb = Chroma(persist_directory=persist_directory, embedding_function=embedding)

print(f"向量库中存储的数量:{vectordb._collection.count()}")

llm = QianfanLLMEndpoint(streaming=True)

template = """使用以下上下文来回答最后的问题。如果你不知道答案,就说你不知道,不要试图编造答

案。最多使用三句话。尽量使答案简明扼要。总是在回答的最后说“谢谢你的提问!”。

{context}

问题: {question}

"""

QA_CHAIN_PROMPT = PromptTemplate(input_variables=["context","question"],

template=template)

qa_chain = RetrievalQA.from_chain_type(llm,

retriever=vectordb.as_retriever(search_type="mmr"),

return_source_documents=True,

chain_type_kwargs={"prompt":QA_CHAIN_PROMPT})

question_1 = "什么是南瓜书?"

question_2 = "王阳明是谁?"

result1 = qa_chain({"query": question_1})

result2 = qa_chain({"query": question_2})

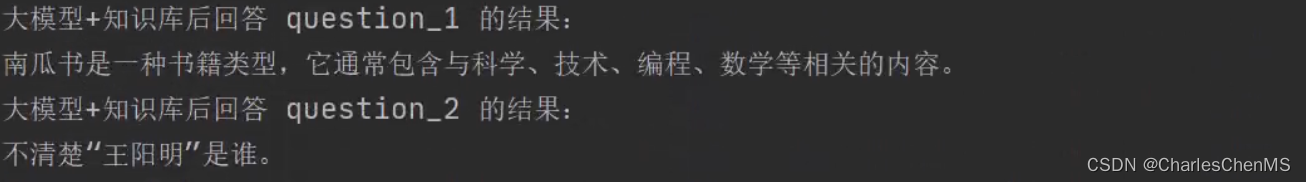

print("大模型+知识库后回答 question_1 的结果:")

print(result1["result"])

print("大模型+知识库后回答 question_2 的结果:")

print(result2["result"])

结果如下:

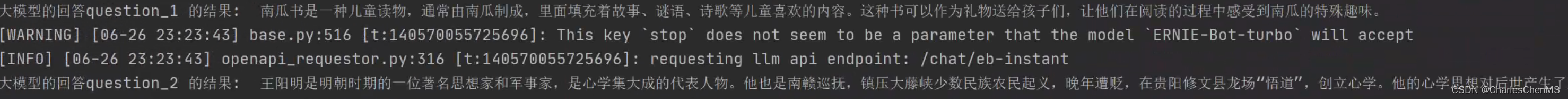

只利用大模型进行回答时:

prompt_template = """请回答下列问题:

{}""".format(question_1)

print("大模型的回答question_1 的结果: ", llm.invoke(prompt_template))

prompt_template = """请回答下列问题:

{}""".format(question_2)

print("大模型的回答question_2 的结果: ", llm.invoke(prompt_template))

结果如下:

可以看出在知识库的加持下,可以使大模型的回答更佳稳定并且符合预期。

可以看出在知识库的加持下,可以使大模型的回答更佳稳定并且符合预期。

1082

1082

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?