motivation:第一DP会降低模型的性能,第二个就是梯度对训练数据具有不均匀敏感性。因为敏感性的不均衡会导致在隐私保护中对于敏感度低的梯度添加大噪声,敏感度高的梯度添加小噪声,这将会直接影响模型的好坏。所以文章提出了一种自适应的,快速收敛的一种差分隐私方法。

methods:主要方法有两个,一个是通过自适应学习速率提高收敛速度来降低隐私损失,另一个是通过引入自适应噪声来减轻差分隐私对模型精度的负面影响。

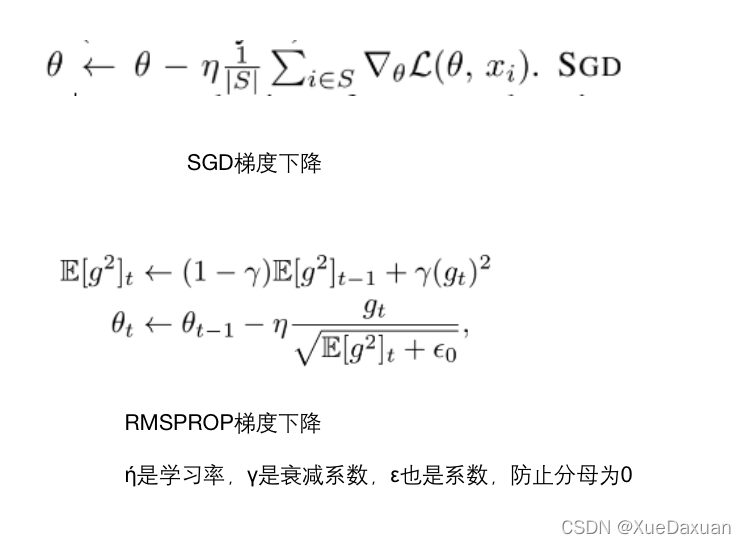

上面这个图是SGD算法,他的学习率是固定的所以对于模型收敛来说不够好,下面的这个是RMSPROP优化算法,E[g2]t是累计梯度的平方的均值,gamma是衰减系数,gt是原始梯度,eta是学习率,ADADP算法就是把原始梯度gt加上高斯噪声,用分母去自适应的调整学习率。 然后文章对于自适应噪声提出了一个定理,就是右边这个图,当满足红色框条件情况下,机制M和M’满足(epsilon,delta)-DP。后续也证明了自适应噪声也是满足差分隐私的,其中Si为f '(·)的第i维的l2灵敏度。

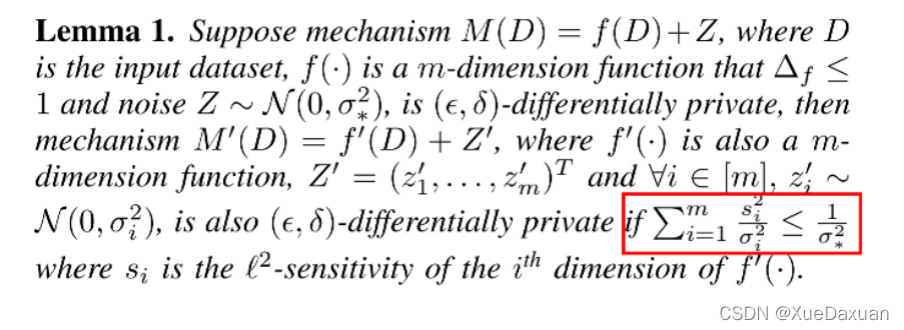

然后文章对于自适应噪声提出了一个定理,就是右边这个图,当满足红色框条件情况下,机制M和M’满足(epsilon,delta)-DP。后续也证明了自适应噪声也是满足差分隐私的,其中Si为f '(·)的第i维的l2灵敏度。

然后文章对于自适应噪声提出了一个定理,就是右边这个图,当满足红色框条件情况下,机制M和M’满足(epsilon,delta)-DP。后续也证明了自适应噪声也是满足差分隐私的,其中Si为f '(·)的第i维的l2灵敏度。

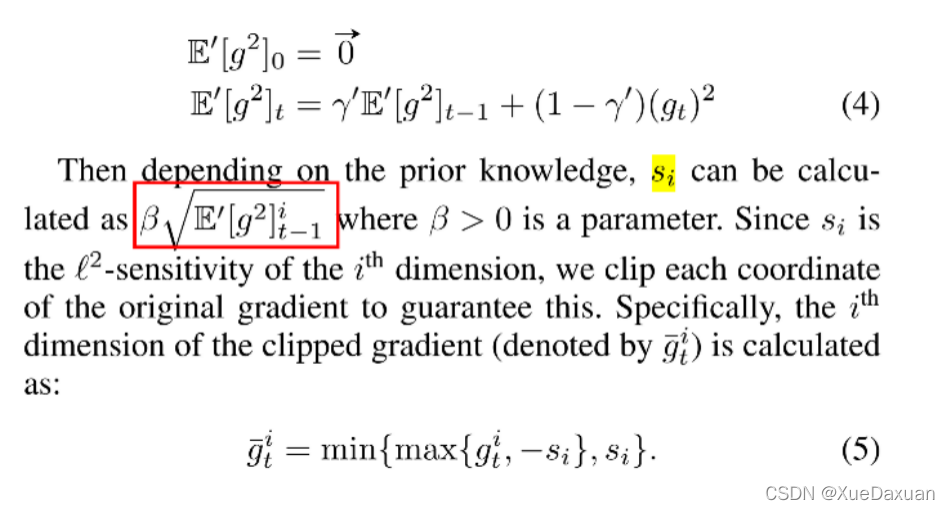

从之前的优化算法可以知道,通过累计梯度平方的平均可以预估当前的梯度,所以文章用E′[g2]代表了先验知识。根据先验知识,可以计算出Si,就是红框部分,代表第i维的l2敏感度,然后根据公式5对原始梯度进行裁剪得到裁剪后的梯度。

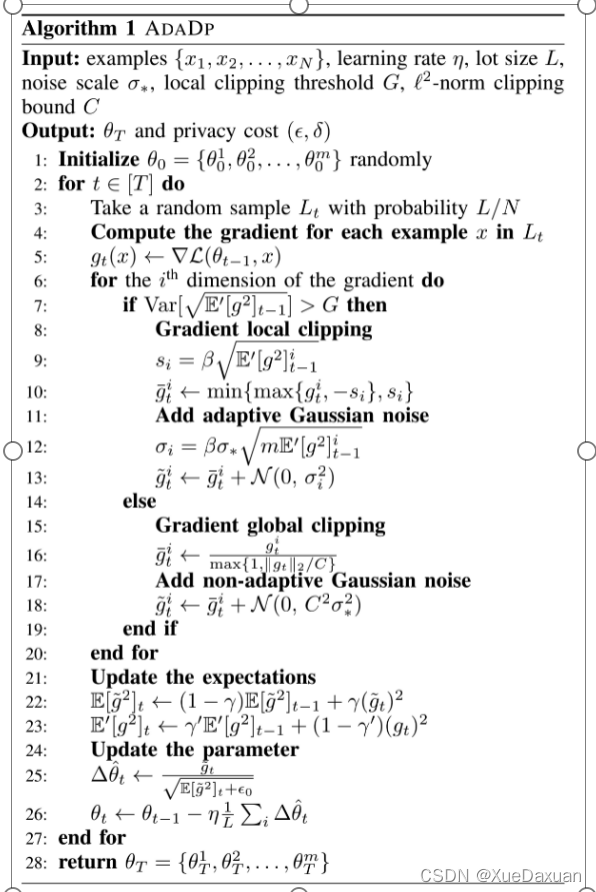

右边是他的整个的一个ADADP算法,因为在第一次迭代中,算法把先验知识设置为0,这个值不能用于剪辑梯度,将导致si = 0。所以又设置了一个局部裁剪阈值G,当E′[g2]>G才进行局部裁剪。 当大于G时,利用先验知识和参数贝塔计算i维的敏感度Si,然后进行裁剪,根据定理一的条件,可以计算出对应的sigma,之后进行自适应的加噪声,如果小于G的话就是进行全局的裁剪,然后加噪,然后更新自适应的学习率和噪声,最后更新累计梯度均值和先验知识,根据E[g2]t计算出∆ˆθt来控制学习率,最后进行梯度下降。

603

603

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?