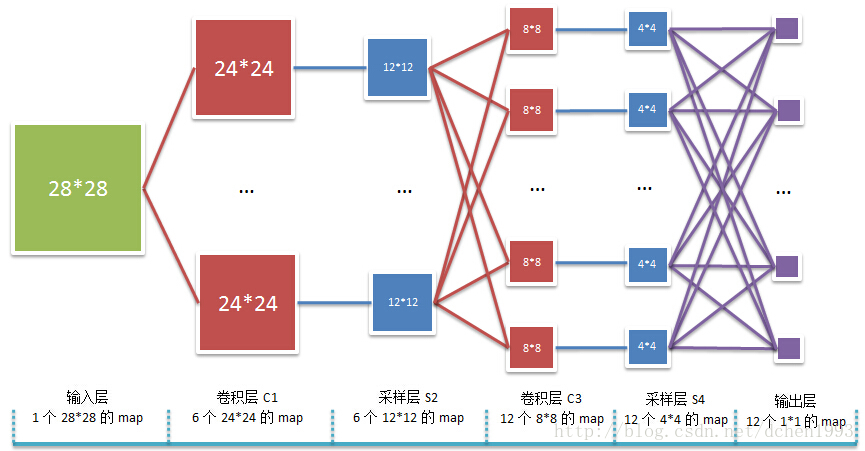

卷积-池-卷积-池-全连接-softmax

前向传导

C1层:卷积神经网络的输入是28×28的矩阵

A

,经过

C1i=conv2(A,K1i,′VALID′)+b1i

u1i=C1i

a1i=f(u1i)

S2层:窗口为2x2,输出为12x12的pool maps:

S2i=β2idown(a1i)+b2i

u2i=S2i

a2i=f(u2i)

C3层:卷积神经网络的输入是12x12的矩阵

A

,经过

C1i=conv2(A,K1i,′VALID′)+b1i

u1i=C1i

a1i=f(u1i)

S4层:窗口为2x2,输出为4x4的pool maps:

S4i=β4idown(a3i)+b4i

u4i=S4i

a4i=f(u4i)

全连接层:将 a4i 展开,作为全连接层的输入

反向传播

全连接层

卷积层

假设前一层

l−1

为池化层,当前层

l

为卷积层,后一层

up运算为:

其中, (∗)st 遍历 ∗ 的所有元素,

池化层

其中, (∗)st 遍历 ∗ 的所有元素,

解释一下为什么

δ(l)i

公式中有conv2:

其中与 ali,(jk) 相关联的feature maps中的 δ(l+1) 和卷积核参数 K(l+1) 可以由卷积操作完成。例子参考 http://www.cnblogs.com/tornadomeet/p/3468450.html 最好手算一遍体会。

Reference

http://www.cnblogs.com/tornadomeet/p/3468450.html

http://tech.youmi.net/2016/07/163347168.html?utm_source=tuicool&utm_medium=referral

681

681

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?