问题:深度的神经网络很难训练

解决方法:我们通过残差学习网络,训练更深的网络,实验显示深度残差网络很容易收敛并且通过加深网络更容易提升准确率。

问题由来:

网络的深度对于计算机视觉任务非常重要,很多事实证明更深的网络能获得更好的效果。

但是训练很深的网络并不容易,原因如下:

1、梯度消失:这个问题通过normalized initialization和Batch normalization,使得网络能够通过sgd反向传播算法进行训练。

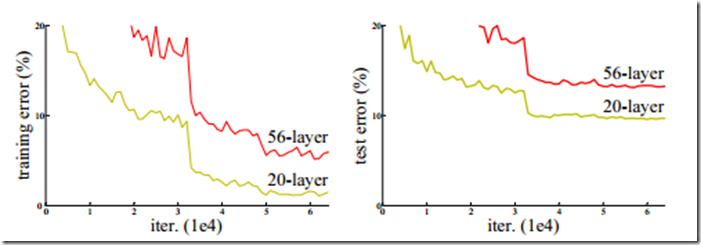

2、degradation退化问题:当网络深度增加时,准确率接近饱和,然后迅速退化。退化并不是由于过拟合造成,增加更多的层去训练更深的网络会导致更高的训练误差。

解决问题的想法:

1、但是如果所增加的层都是一样的,都是浅层模型的复制,那么深度的模型不应该产生更高的训练误差,但是这样的方法很难实现。

2、在这片文章中通过deep residu

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

494

494

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?