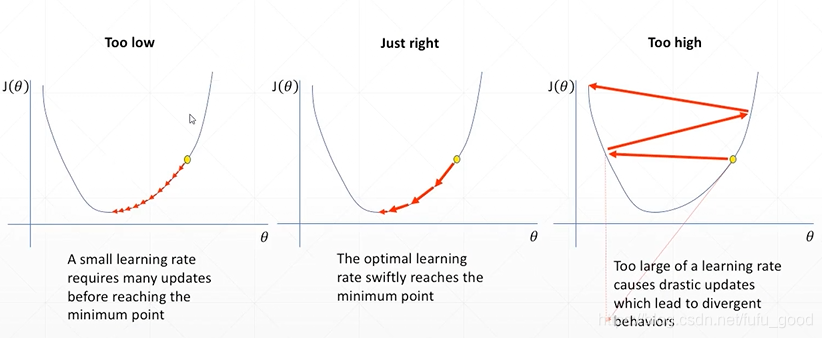

在实验过程中我们可能都对learning rate的选取而苦脑过

- learning rate过小:loss降低过慢

- learning rate过大:loss可能达不到最优,而可能在最优值范围震动

其比较如下图所示

解决办法

1. 使用ReducLROnPlateau

1.1 介绍

该类是torch.optim.lr_scheduler.ReduceLROnPlateau()

使用方法如下:

class torch.optim.lr_scheduler.ReduceLROnPlateau(optimizer, mode='min', factor=0.1, patience=0,

verbose=False, threshold=0.0001

本文探讨了在深度学习中如何解决学习率选取的问题,重点介绍了Pytorch中两种常用的学习率衰减策略:ReducLROnPlateau和StepLR。ReducLROnPlateau根据监控量停止改善时调整学习率,而StepLR则按固定步长定期降低学习率。两者使用时需注意更新学习率的方式。

本文探讨了在深度学习中如何解决学习率选取的问题,重点介绍了Pytorch中两种常用的学习率衰减策略:ReducLROnPlateau和StepLR。ReducLROnPlateau根据监控量停止改善时调整学习率,而StepLR则按固定步长定期降低学习率。两者使用时需注意更新学习率的方式。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

455

455

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?