随着Manus的出圈也让MCP(Model Context Protocol,模型上下文协议) 重新引起了大家的重视,说起MCP就不得不提另一个技术概念Function Call(函数调用),上一篇文章主要针对MCP进行全面的讲解,今天针对Function Call(函数调用)和MCP(Model Context Protocol,模型上下文协议),分别从功能、定位、技术实现、适用场景等多个维度进行剖析,让大家能更好的理解和使用。

一、功能定位上区别

MCP Server

MCP Server(Model Context Protocol Server)是一种基于标准化协议的服务端程序,主要为大语言模型(LLM)提供外部数据和能力支持。例如,Fetch MCP Server可以抓取网页内容,Google Drive MCP Server可以读取文件。它的核心定位是“被动服务”,仅响应调用请求,不参与决策或推理。

MCP Server就像一个工具箱,里面装满了各种工具(如信息抓取、数据库查询、天气查询),但它不会主动使用这些工具,而是等待别人来挑选。MCP Server的功能相对单一,专注于提供数据和工具接口。例如,它可以抓取网页、读取文件或调用API,但不具备推理能力

优势:模块化设计,便于独立开发和扩展。

局限性:只能被动响应,无法主动解决问题。

Function Call

Function Call是指大模型直接调用预定义函数的能力,允许模型生成请求参数并整合结果。例如,模型可以通过Function Call查询天气或执行简单的数学计算。它的本质是“代码级工具”,通常与模型绑定部署。

Function Call就像一把瑞士军刀,虽然小巧但功能多样,可以直接嵌入模型中完成轻量级任务。适合处理简单、低延迟的任务,例如实时翻译、情感分析等。它与模型紧密集成,能够在推理过程中快速调用。

优势:高效便捷,无需额外通信开销。

局限性:受模型运行时资源限制,无法执行耗时任务。

二、交互方式

MCP Server

MCP Server采用被动服务模式,仅在接收到请求时返回数据。例如,当模型需要抓取网页内容时,会通过HTTP/SSE协议发送请求,MCP Server获取数据后返回。

Function Call

Function Call由模型运行时环境直接执行,开发者需预先定义函数并将其打包到模型服务中。这种方式适用于高频轻量任务。

三、技术实现

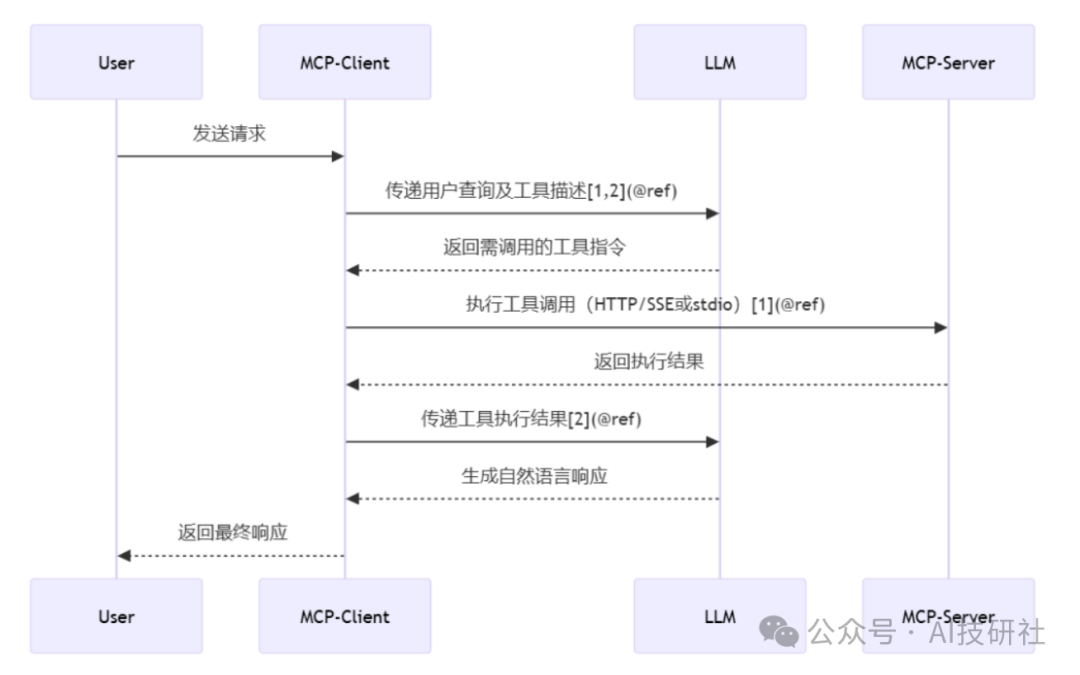

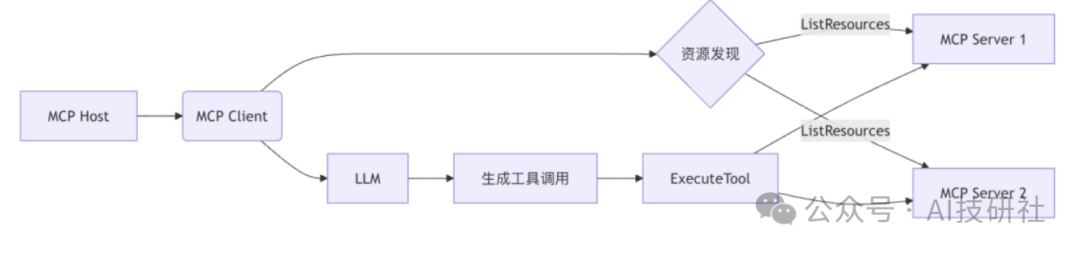

MCP工作流

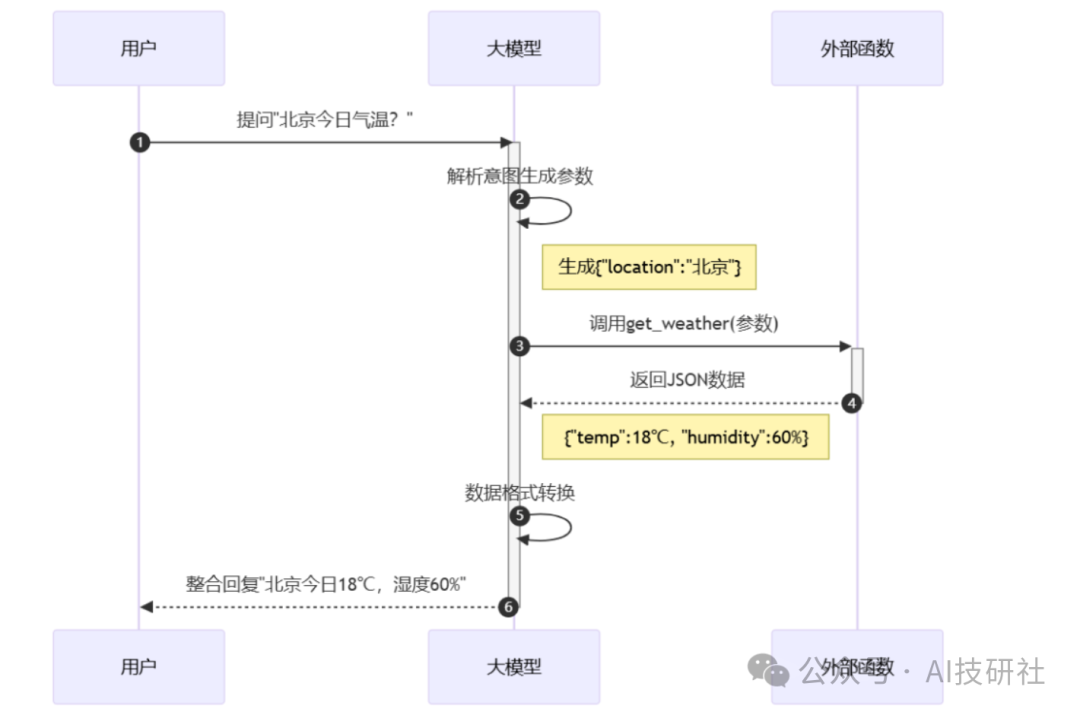

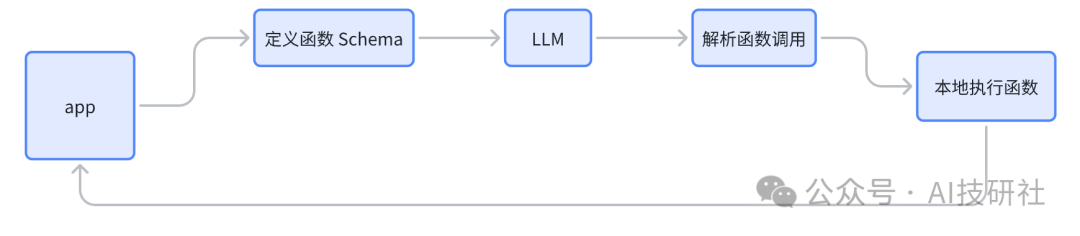

Funtion Call 工作流

技术特性

| 维度 | Function Call | MCP Server |

| 协议标准 | 厂商自定义(如 OpenAI 的 JSON 格式),无统一标准 | 提供开放标准(遵循 JSON-RPC 2.0) |

| 扩展性 | 受限于厂商接口,新增工具需重新适配 | 支持即插即用,新增数据源/工具只需符合协议即可接入 |

| 适用层级 | 面向单次函数调用的“微操”层面 | 面向系统级协作的“架构”层面,管理上下文和流程 |

| 安全与访问 | 开发者需自行管理安全 | 标准化处理认证和授权 |

| 性能 | 结构化输出快于解析文本 | 依赖MCP服务器实现,设计为高效 |

| 社区与生态 系统 | 依赖各AI提供商生态系统,增长中 | 开放源代码,社区驱动,工具和服务器丰富 |

四、应用场景

MCP Server

-

需要多步骤协作和上下文维护的场景

机票预订全流程:拆解为“意图解析→航班查询→用户选择→支付确认”,通过 MCP 协调各步骤的上下文传递

企业级智能客服:实现“问题分类→知识库检索→工单生成→反馈跟踪”的闭环流程

-

需统一通信协议和数据结构的需求

强制模型输出 JSON/XML 格式数据,与 ERP 系统对接

规范金融交易场景的订单字段结构和验证规则(如金额、账户校验)

-

多工具并行或串联调用的场景

智能家居控制:通过 MCP 协调“语音识别→设备控制→状态反馈”的跨系统协作企业数据分析:同时调度本地数据库、云存储和可视化工具生成报告

Function Call

-

通过预定义函数直接触发外部服务

实时数据查询:调用

get_weather()获取天气数据、get_stock_price()查询股价等。简单指令执行:用户说“发邮件给客户”时,直接触发

send_email()函数。厂商专属功能:例如 OpenAI 的 GPT-4 调用 DALL·E 生成图片。

-

对上下文管理要求较低的场景

单次问答中调用计算器工具完成数学运算。

通过

search_flights接口直接返回航班列表。 -

依赖特定厂商接口的场景

基于 OpenAI Function Call 开发封闭生态工具。

快速实现模型与私有 API 的对接(无需标准化协议)。

总结

MCP Server和Function Calling代表着两种不同的AI交互范式,它们各有优势,适用于不同的应用场景.对于开发者而言,关键是要理解这两种方案的本质区别,根据任务复杂度、团队协作需求和安全隔离性综合选择。通过合理搭配,可以构建出高效、灵活的AI系统,释放大模型的最大潜力。

410

410

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?