开始今天的教程之前,先解决昨天遇到的一个问题,docker安装Dify的时候有个报错,进入Dify面板的时候会出现“Internal Server Error”的提示,log日志报错:S3_USE_AWS_MANAGED_IAM to S3UseAwsManagedIam: converting ‘’ to type bool.。

报错

代码语言:javascript

代码运行次数:0

运行

docker logs docker-plugin_daemon-1

如下的报错

goroutine 1 [running]:

github.com/langgenius/dify-plugin-daemon/internal/utils/log.writeLog({0x1857285, 0x5}, {0x1896127?, 0xc00016d408?}, 0x1, {0xc0004cdf28, 0x1, 0x1})

/app/internal/utils/log/log.go:40 +0x305

github.com/langgenius/dify-plugin-daemon/internal/utils/log.Panic(...)

/app/internal/utils/log/log.go:66

main.main()

/app/cmd/server/main.go:19 +0x9f

2025/04/09 09:48:27 main.go:19: [PANIC]Error processing environment variables: envconfig.Process: assigning S3_USE_AWS_MANAGED_IAM to S3UseAwsManagedIam: converting '' to type bool. details: strconv.ParseBool: parsing "": invalid syntax

panic: [PANIC]Error processing environment variables: envconfig.Process: assigning S3_USE_AWS_MANAGED_IAM to S3UseAwsManagedIam: converting '' to type bool. details: strconv.ParseBool: parsing "": invalid syntax

goroutine 1 [running]:

github.com/langgenius/dify-plugin-daemon/internal/utils/log.writeLog({0x1857285, 0x5}, {0x1896127?, 0xc0001f8008?}, 0x1, {0xc00019df28, 0x1, 0x1})

/app/internal/utils/log/log.go:40 +0x305

github.com/langgenius/dify-plugin-daemon/internal/utils/log.Panic(...)

/app/internal/utils/log/log.go:66

main.main()

/app/cmd/server/main.go:19 +0x9f

解决方法

进入 dify 源代码的 docker 目录,按顺序执行以下命令:

代码语言:javascript

代码运行次数:0

运行

vi .env

把下面三行都删掉。

S3_USE_AWS_MANAGED_IAM: ${PLUGIN_S3_USE_AWS_MANAGED_IAM:-}

S3_ENDPOINT: ${PLUGIN_S3_ENDPOINT:-}

S3_USE_PATH_STYLE: ${PLUGIN_S3_USE_PATH_STYLE:-}

再重启docker

docker compose down

docker compose up -d

docker ps查看是否还有报错

代码语言:javascript

代码运行次数:0

运行

docker ps

CONTAINER ID IMAGE COMMAND CREATED STATUS PORTS NAMES

8a02ec3bcbb7 langgenius/dify-plugin-daemon:0.0.7-local "/bin/bash -c /app/e…" About an hour ago Up About an hour 0.0.0.0:5003->5003/tcp, :::5003->5003/tcp docker-plugin_daemon-1

终于正常了,也不会有报错了。

安装好了

前期准备

1.本地安装ollama或者获取到第三方的deepseek的接口

本地安装ollama可以参考:https://mp.weixin.qq.com/s/kJ7JCgFUNKWtPtp8r5mR_A

2.安装Dify可以参考:https://mp.weixin.qq.com/s/HYDBOXmkXGypGl3IpXqiCw

Dify模型设置

1. 访问Dify

浏览器输入IP或者localhost,访问Dify

输入账号密码登录成功。

2. 添加模型

点击 Dify 平台右上角头像

设置

以此点击:

设置

模型供应商

选择 Ollama ,如果没有安装点击安装。

添加模型。

查看我的ollama的大模型有哪些

代码语言:javascript

代码运行次数:0

运行

C:\Users\Administrator>ollama list

NAME ID SIZE MODIFIED

deepseek-v2:16b 7c8c332f2df7 8.9 GB 13 days ago

nomic-embed-text:latest 0a109f422b47 274 MB 4 weeks ago

qwq:32b-q4_K_M cc1091b0e276 19 GB 4 weeks ago

deepseek-r1:32b 38056bbcbb2d 19 GB 8 weeks ago

qwen2.5:14b 7cdf5a0187d5 9.0 GB 8 weeks ago

llama3-cn-8b:latest d710bb08d58c 6.6 GB 2 months ago

llama2-chinese:latest cee11d703eee 3.8 GB 2 months ago

deepseek-r1:14b ea35dfe18182 9.0 GB 2 months ago

qwen2.5:latest 845dbda0ea48 4.7 GB 2 months ago

deepseek-r1:7b 0a8c26691023 4.7 GB 2 months ago

llama3:latest 365c0bd3c000 4.7 GB 2 months ago

我这里选择 deepseek-r1:7b

模型名称填写: deepseek-r1:7b

基础URL填:http://192.168.1.18:11434 (如果你的本机的ollama 则可以填写: http://host.docker.internal:11434 )

其他可保持默认,点击保存

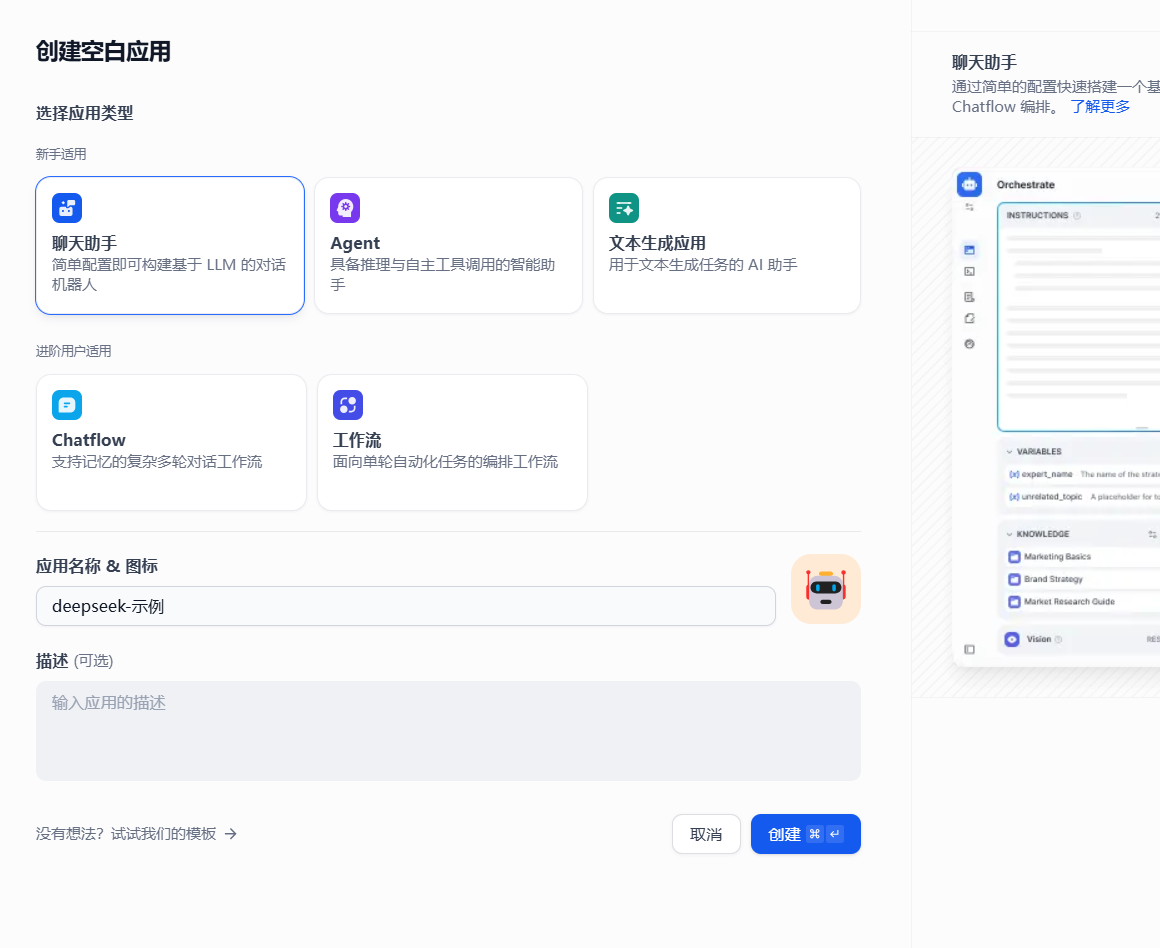

3.创建聊天应用

返回主页,进入“工作室-聊天助手”,创建空白应用。

选择聊天助手

填写应用名称、图标。

点击“创建”。

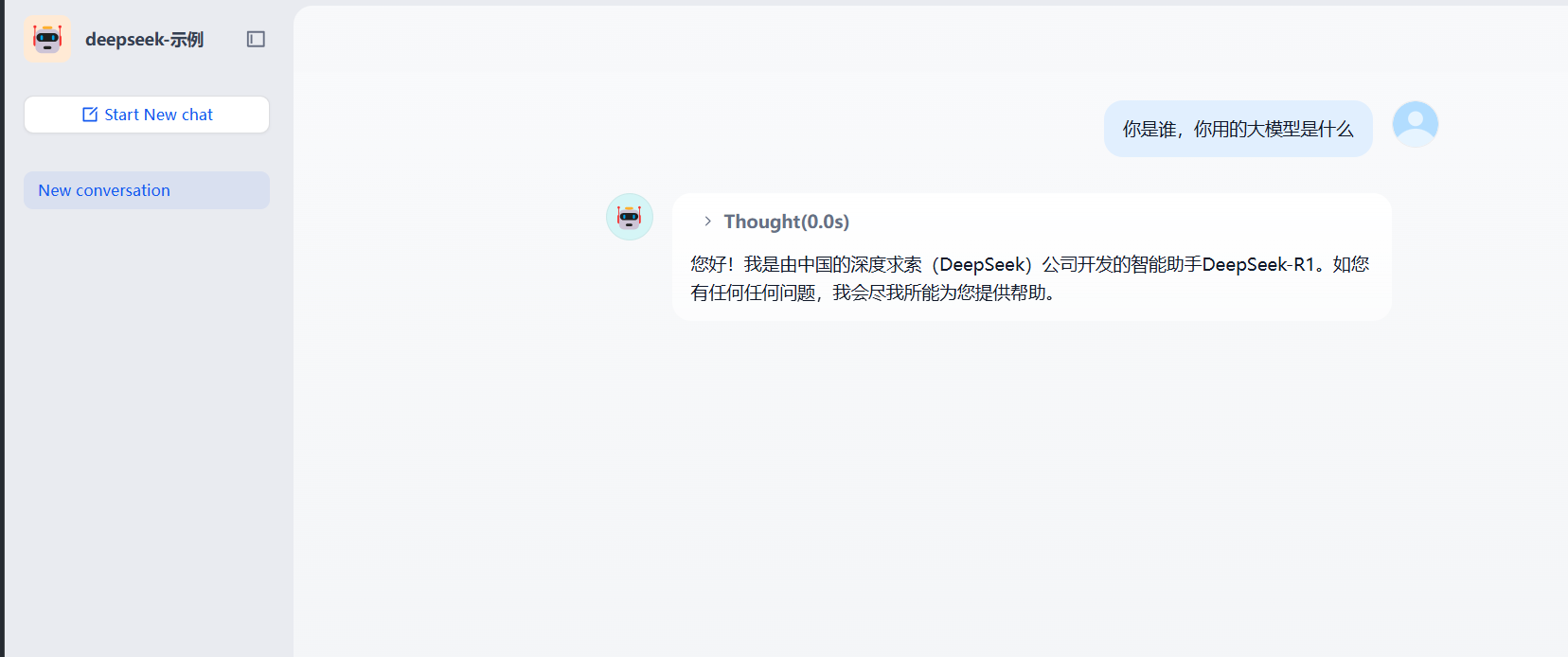

编排聊天助手

提示词,变量、知识库都可以按照实际需求填写

点击右侧发布。

点击运行可以看到实际效果

到这里,我们就完成了第一个应用:聊天助手 的搭建

结尾

Dify与DeepSeek的深度集成,通过本文的介绍和案例分析,我们可以看到,普通人借助Dify和DeepSeek,无需深厚的编程基础,就能轻松开发出功能强大的AI应用。

如何系统的去学习大模型LLM ?

大模型时代,火爆出圈的LLM大模型让程序员们开始重新评估自己的本领。 “AI会取代那些行业?”“谁的饭碗又将不保了?”等问题热议不断。

事实上,抢你饭碗的不是AI,而是会利用AI的人。

继科大讯飞、阿里、华为等巨头公司发布AI产品后,很多中小企业也陆续进场!超高年薪,挖掘AI大模型人才! 如今大厂老板们,也更倾向于会AI的人,普通程序员,还有应对的机会吗?

与其焦虑……

不如成为「掌握AI工具的技术人」,毕竟AI时代,谁先尝试,谁就能占得先机!

但是LLM相关的内容很多,现在网上的老课程老教材关于LLM又太少。所以现在小白入门就只能靠自学,学习成本和门槛很高。

基于此,我用做产品的心态来打磨这份大模型教程,深挖痛点并持续修改了近70次后,终于把整个AI大模型的学习门槛,降到了最低!

在这个版本当中:

第一您不需要具备任何算法和数学的基础

第二不要求准备高配置的电脑

第三不必懂Python等任何编程语言

您只需要听我讲,跟着我做即可,为了让学习的道路变得更简单,这份大模型教程已经给大家整理并打包,现在将这份 LLM大模型资料 分享出来:包括LLM大模型书籍、640套大模型行业报告、LLM大模型学习视频、LLM大模型学习路线、开源大模型学习教程等, 😝有需要的小伙伴,可以 扫描下方二维码领取🆓↓↓↓

一、LLM大模型经典书籍

AI大模型已经成为了当今科技领域的一大热点,那以下这些大模型书籍就是非常不错的学习资源。

二、640套LLM大模型报告合集

这套包含640份报告的合集,涵盖了大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。(几乎涵盖所有行业)

三、LLM大模型系列视频教程

四、LLM大模型开源教程(LLaLA/Meta/chatglm/chatgpt)

五、AI产品经理大模型教程

LLM大模型学习路线 ↓

阶段1:AI大模型时代的基础理解

-

目标:了解AI大模型的基本概念、发展历程和核心原理。

-

内容:

- L1.1 人工智能简述与大模型起源

- L1.2 大模型与通用人工智能

- L1.3 GPT模型的发展历程

- L1.4 模型工程

- L1.4.1 知识大模型

- L1.4.2 生产大模型

- L1.4.3 模型工程方法论

- L1.4.4 模型工程实践

- L1.5 GPT应用案例

阶段2:AI大模型API应用开发工程

-

目标:掌握AI大模型API的使用和开发,以及相关的编程技能。

-

内容:

- L2.1 API接口

- L2.1.1 OpenAI API接口

- L2.1.2 Python接口接入

- L2.1.3 BOT工具类框架

- L2.1.4 代码示例

- L2.2 Prompt框架

- L2.3 流水线工程

- L2.4 总结与展望

阶段3:AI大模型应用架构实践

-

目标:深入理解AI大模型的应用架构,并能够进行私有化部署。

-

内容:

- L3.1 Agent模型框架

- L3.2 MetaGPT

- L3.3 ChatGLM

- L3.4 LLAMA

- L3.5 其他大模型介绍

阶段4:AI大模型私有化部署

-

目标:掌握多种AI大模型的私有化部署,包括多模态和特定领域模型。

-

内容:

- L4.1 模型私有化部署概述

- L4.2 模型私有化部署的关键技术

- L4.3 模型私有化部署的实施步骤

- L4.4 模型私有化部署的应用场景

这份 LLM大模型资料 包括LLM大模型书籍、640套大模型行业报告、LLM大模型学习视频、LLM大模型学习路线、开源大模型学习教程等, 😝有需要的小伙伴,可以 扫描下方二维码领取🆓↓↓↓

533

533

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?