做大模型相关的项目,会有这样的情形:领导交给你一个任务,说我们要微调出一个 70B 的领域大模型,需要多少硬件资源,并且预估一下训练时间,xxx 你来列一个清单,我去汇报。

要回答这个问题,就需要弄明白 train 这个模型到底需要多少张 GPU 卡?今天我们就来聊聊:如何估计 LLM 的训练资源?

首先来看第一个问题,在大模型的过程中,占用显存的大头主要分为四部分:

- 模型参数

- 前向计算过程中产生的中间激活

- 后向传递计算得到的梯度

- 优化器状态

这里着重分析参数、梯度和优化器状态的显存占用,中间激活的显存占用后面会详细介绍。

训练大模型时通常会采用 AdamW 优化器,并用混合精度训练来加速训练,基于这个前提分析显存占用。

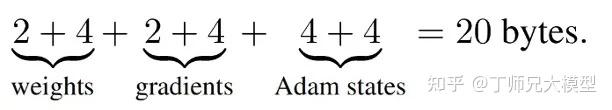

在一次训练迭代中,每个可训练模型参数都会对应 1 个梯度,并对应 2 个优化器状态(Adam 优化器梯度的一阶动量和二阶动量)。

设模型参数量为 Φ,那么梯度的元素数量为 Φ,AdamW 优化器的元素数量为 2Φ。float16 数据类型的元素占 2 个 bytes,float32 数据类型的元素占 4 个 bytes。

在混合精度训练中,会使用 float16 的模型参数进行前向传递和后向传递,计算得到 float16 的梯度;在优化器更新模型参数时,会使用 float32 的优化器状态、float32 的梯度、float32 的模型参数来更新模型参数。

因此,对于每个可训练模型参数,占用了:

所以,模型参数、梯度和优化器状态的显存占用为 20 Φ bytes。

除了模型参数、梯度、优化器状态外,占用显存的大头就是前向传递过程中计算得到的中间激活值了,需要保存中间激活以便在后向传递计算梯度时使用。

这里的激活指的是:前向传递过程中计算得到的,并在后向传递过程中需要用到的所有张量。

假设中间激活值是以 float16 或 bfloat16 数据格式来保存的,每个元素占了 2 个 bytes。

唯一例外的是,dropout 操作的 mask 矩阵,每个元素只占 1 个 bytes。在下面的分析中,单位是 bytes,而不是元素个数。

每个 transformer 层包含了一个 self-attention 块和 MLP 块,并分别对应了一个 layer normalization 连接。

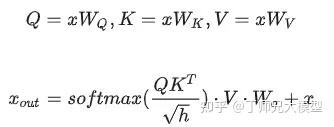

先分析 self-attention 块的中间激活。self-attention 块的计算公式如下:

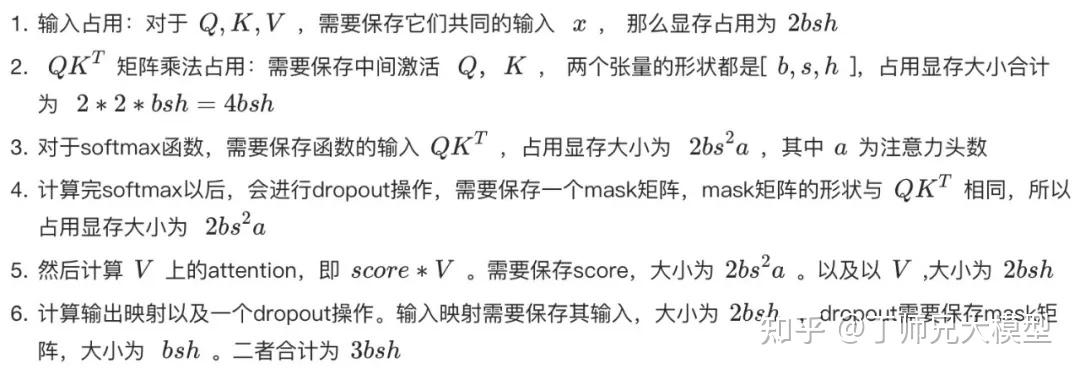

假设输入的形状是 [b,s,h],那么可以分为这几步来看:

因此,self-attention 块的中间激活占用显存大小为 11bsh+5s²α。

接下来看 MLP 块的中间激活。MLP 块的计算公式如下:

其中:

- 第一个线性层需要保存其输入,占用显存大小为 2bsh

- 激活函数需要保存其输入,占用显存大小为 8bsh

- 第二个线性层需要保存其输入,占用显存大小为 8bsh

- 最后有一个 dropout 操作,需要保存 mask 矩阵,占用显存大小为 bsh

对于 MLP 块,需要保存的中间激活值为 19bsh,另外,self-attention 块和 MLP 块分别对应了一个 layer normalization。

每个 layer norm 需要保存其输入,大小为 2bsh,2 个 layer norm 需要保存的中间激活为 4bsh。

综上,每个 transformer 层需要保存的中间激活占用显存大小为 34bsh+5bs²α。

因此,对于 l 层 transformer 模型,中间激活占用的显存大小可以近似为:(34bsh+5bs²α)*l。

最后,我们用一个实例来验证一下,以 GPT3 为例,我们来计算一下训练一个 GPT3 需要占用多少显存。

GPT3 的参数如下:

GPT3 的模型参数量为 175B,首先是模型参数、梯度和优化器状态的显存占用为 20 Φ bytes,即:

然后来看下中间激活占用的显存大小,GPT3 的序列长度 s 为 2048。

按 batch size 最小的来算,当 b=1 时:

所以总的显存是 350GB + 275GB=625GB。

我们用 Nvidia 的 A100 80GB 来算,需要用 625/80,约等于 8 张 GPU 卡,才能按最小资源把 GPT3 模型训练跑起来。

当 b=64 时:

同样用 A100 80GB 来算,这时候需要用到 17950/80 约 224 张 GPU 卡,可以看到随着批次大小 b 的增大,中间激活占用的显存远远超过了模型参数显存。

通常会采用激活重计算技术来减少中间激活,代价是增加了一次额外前向计算的时间,本质上其实就是“时间换空间”。

相信看到这里,对于其他任何尺寸的大模型,你都可以得心应手的预估所需的资源,也不用盲目抓瞎去试了。

大模型岗位需求

大模型时代,企业对人才的需求变了,AIGC相关岗位人才难求,薪资持续走高,AI运营薪资平均值约18457元,AI工程师薪资平均值约37336元,大模型算法薪资平均值约39607元。

掌握大模型技术你还能拥有更多可能性:

• 成为一名全栈大模型工程师,包括Prompt,LangChain,LoRA等技术开发、运营、产品等方向全栈工程;

• 能够拥有模型二次训练和微调能力,带领大家完成智能对话、文生图等热门应用;

• 薪资上浮10%-20%,覆盖更多高薪岗位,这是一个高需求、高待遇的热门方向和领域;

• 更优质的项目可以为未来创新创业提供基石。

可能大家都想学习AI大模型技术,也想通过这项技能真正达到升职加薪,就业或是副业的目的,但是不知道该如何开始学习,因为网上的资料太多太杂乱了,如果不能系统的学习就相当于是白学。为了让大家少走弯路,少碰壁,这里我直接把全套AI技术和大模型入门资料、操作变现玩法都打包整理好,希望能够真正帮助到大家。

读者福利:如果大家对大模型感兴趣,这套大模型学习资料一定对你有用

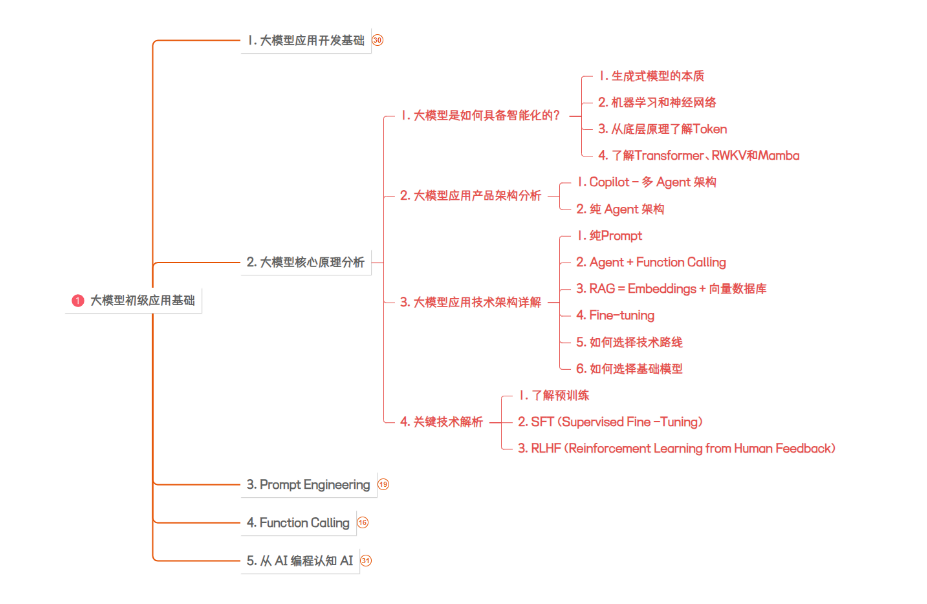

零基础入门AI大模型

今天贴心为大家准备好了一系列AI大模型资源,包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

有需要的小伙伴,可以点击下方链接免费领取【保证100%免费】

1.学习路线图

如果大家想领取完整的学习路线及大模型学习资料包,可以扫下方二维码获取

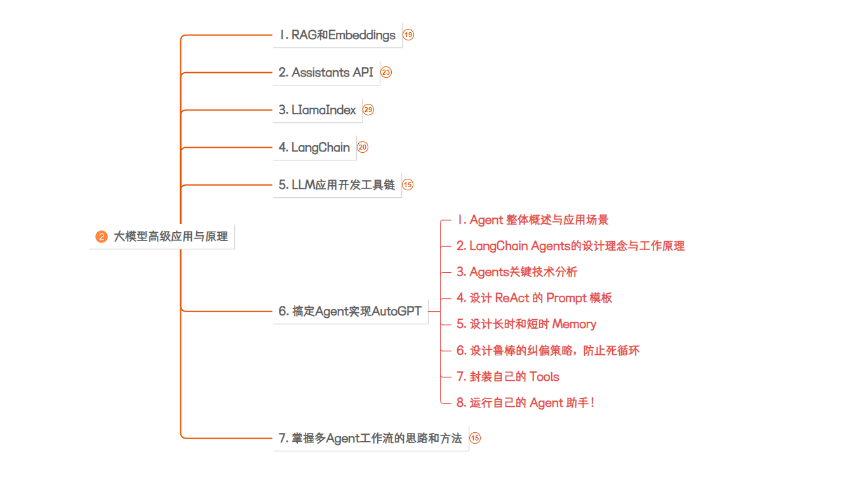

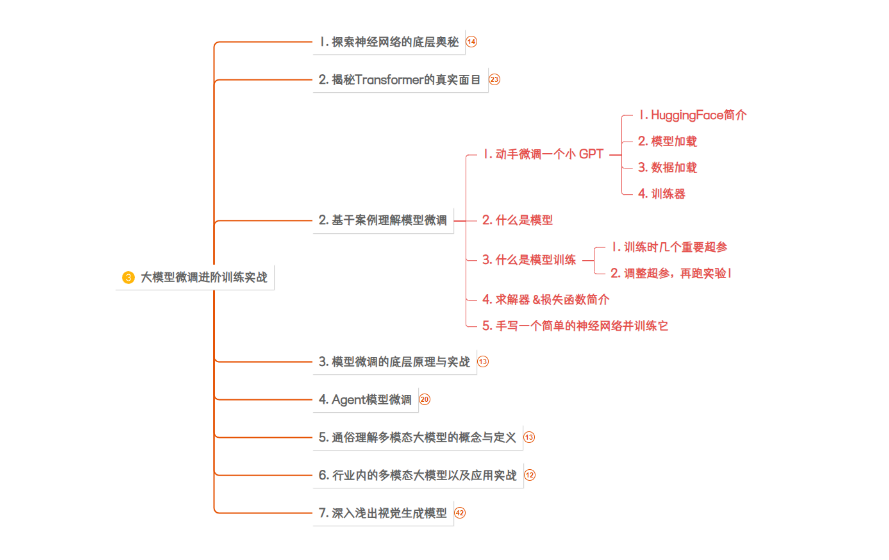

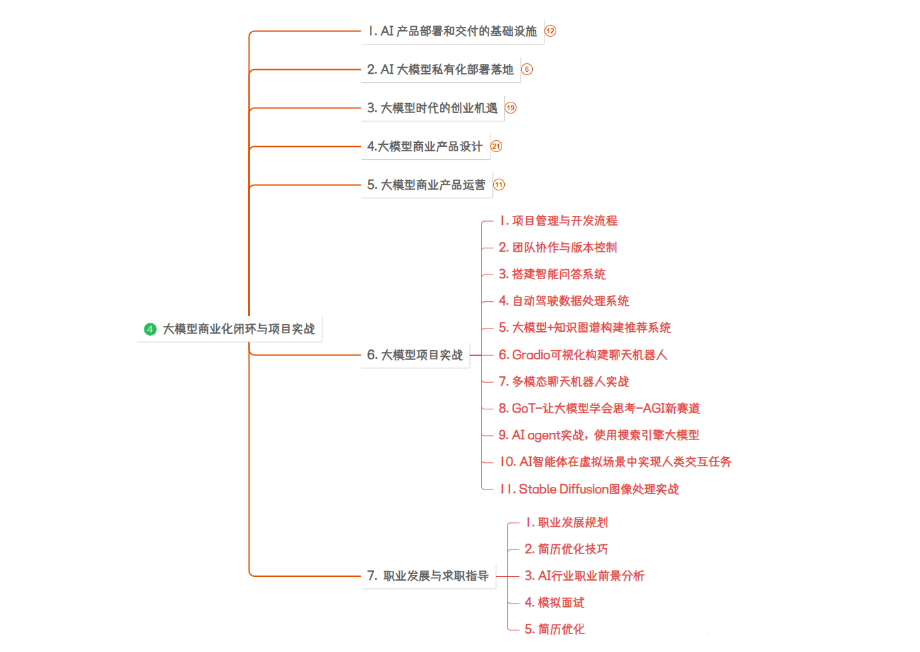

👉2.大模型配套视频👈

很多朋友都不喜欢晦涩的文字,我也为大家准备了视频教程,每个章节都是当前板块的精华浓缩。(篇幅有限,仅展示部分)

大模型教程

👉3.大模型经典学习电子书👈

随着人工智能技术的飞速发展,AI大模型已经成为了当今科技领域的一大热点。这些大型预训练模型,如GPT-3、BERT、XLNet等,以其强大的语言理解和生成能力,正在改变我们对人工智能的认识。 那以下这些PDF籍就是非常不错的学习资源。(篇幅有限,仅展示部分,公众号内领取)

电子书

👉4.大模型面试题&答案👈

截至目前大模型已经超过200个,在大模型纵横的时代,不仅大模型技术越来越卷,就连大模型相关的岗位和面试也开始越来越卷了。为了让大家更容易上车大模型算法赛道,我总结了大模型常考的面试题。(篇幅有限,仅展示部分,公众号内领取)

大模型面试

**因篇幅有限,仅展示部分资料,**有需要的小伙伴,可以点击下方链接免费领取【保证100%免费】

**或扫描下方二维码领取 **

9208

9208

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?