概念区分

网络上关于大模型“微调”的各种解释五花八门,都不太系统,个人系统梳理了一下,并在本篇文章对指令微调从代码层面进行详细解释,供各位参考。

1.按方法分

主要分为全量微调和参数高效微调 (PEFT) 两大类,其中 PEFT 包含众多具体技术 (LoRA, Adapter, Prompt Tuning 等)。

2.按目标分

可以分为指令微调、特定任务微调、领域自适应微调和对齐微调等。

3.具体参考表格:

| 维度 | 大类 | 子类/代表方法 |

|---|---|---|

| 参数更新范围 | 全量微调 (FFT) | - |

| 参数高效微调 (PEFT) | LoRA/QLoRA、Adapter、Prompt Tuning、P-Tuning、Prefix-Tuning、Selective Fine-tuning、(IA)³等 | |

| 目标任务类型 | 指令微调 (SFT) | 通常结合PEFT实现 |

| 任务/领域微调(文本分类、命名实体识别、问答、摘要、翻译) | 通常结合PEFT实现 | |

| 对齐微调 | RLHF、DPO、RLAIF、KTO等 | |

| 数据利用方式 | 监督微调 | 标准标注数据 |

| 半监督/自监督 | 对比学习、数据增强 |

指令微调介绍

大模型指令微调(Instruction Tuning)是让通用预训练语言模型(如GPT、LLaMA等)适应具体任务或人类指令的核心技术。核心思想是,通过制作’指令-输入(可选)-输出’格式的数据,对预训练模型进行二次训练,使其能够理解并执行自然语言指令,而非仅依赖预训练阶段的文本补全能力。

通过代码解释原理

代码演示如何使用中文数据集对预训练语言模型进行指令微调,将模型从"只会预测下一个词"转变为"能够理解并执行指令"的助手。

第一步:导入相关包

from datasets import Dataset

from transformers import AutoTokenizer, AutoModelForCausalLM, DataCollatorForSeq2Seq, TrainingArguments, Trainer

import torch

import matplotlib.pyplot as plt

import numpy as np

第二步:加载数据集

指令微调需要特定格式的数据集,通常包含:指令(instruction)、输入(input)和输出(output)。

- instruction: 告诉模型要做什么的指令;

- input: 需要处理的具体内容(可选);

- output: 期望模型生成的回答;

ds = Dataset.load_from_disk("./alpaca_data_zh/")

# 展示数据集的前3个样本,帮助理解数据格式

print("加载后的数据集:\n", ds)

print("数据集前三个样本:\n", ds[:3])

数据示例:

模型输入(包含Human和Assistant部分):

Human: 解释为什么以下分数等同于1/4

输入:4/16

Assistant: 4/16等于1/4是因为我们可以约分分子分母都除以他们的最大公约数4,得到(4÷4)/ (16÷4)=1/4。分数的约分是用分子和分母除以相同的非零整数,来 表示分数的一个相同的值,这因为分数实际上表示了分子除以分母,所以即使两个数同时除以同一个非零整数,分数的值也不会改变。所以4/16 和1/4是两种不同的书

写形式,但它们的值相等。

模型学习目标(只有Assistant部分):

4/16等于1/4是因为我们可以约分分子分母都除以他们的最大公约数4,得到(4÷4)/ (16÷4)=1/4。分数的约分是用分子和分母除以相同的非零整数,来表示分数的一个相同的值,这因为分数实际上表示了分子除以分母,所以即使两个数同时除以同一个非零整数,分数的值也不会改变。所以4/16 和1/4是两种不同的书写形式,但它

们的值相等。

第三步:数据集预处理

数据预处理 - 将数据转换为模型可学习的格式:指令微调的关键是构建

Human: [指令+输入] - Assistant: [输出]格式,并进行编码。

[关键步骤]:

1.将指令和输入组合为"Human: [指令+输入]“;

2.将输出标记为"Assistant: [输出]”;

3.创建labels,使模型只学习生成Assistant部分。

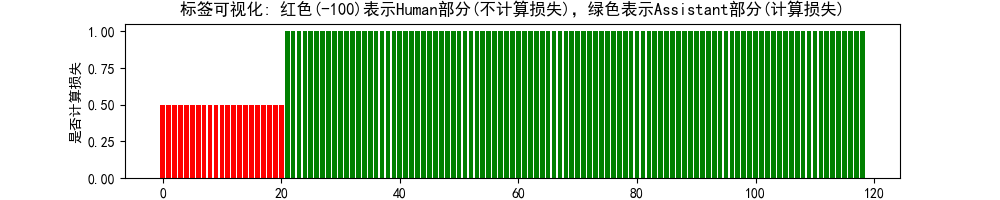

如下图所示,红色部分是Human提问,模型不需要学习生成;绿色部分是Assistant回答,模型需要学习生成。

# 加载分词器,用于将文本转换为模型可理解的token ID

tokenizer = AutoTokenizer.from_pretrained("D:\\git\\model-download\\bloom-389m-zh")

# 定义一个函数,将数据集转换为训练所需的格式

defprocess_func(example):

MAX_LENGTH = 256# 限制序列最大长度

# 构建输入部分:"Human: 指令 + 输入"

instruction_text = "\n".join(["Human: " + example["instruction"], example["input"]]).strip() + "\n\nAssistant: "

instruction_tokens = tokenizer(instruction_text)

# 构建输出部分:"输出 + 结束标记"

response_text = example["output"] + tokenizer.eos_token

response_tokens = tokenizer(response_text)

# 合并输入和输出的token

input_ids = instruction_tokens["input_ids"] + response_tokens["input_ids"]

attention_mask = instruction_tokens["attention_mask"] + response_tokens["attention_mask"]

# 创建labels: 对于Human部分使用-100(忽略不计算损失),对于Assistant部分使用实际token_id

# 这确保模型只学习生成Assistant部分,而不是复述Human部分

labels = [-100] * len(instruction_tokens["input_ids"]) + response_tokens["input_ids"]

# 截断过长序列

iflen(input_ids) > MAX_LENGTH:

input_ids = input_ids[:MAX_LENGTH]

attention_mask = attention_mask[:MAX_LENGTH]

labels = labels[:MAX_LENGTH]

return {

"input_ids": input_ids,

"attention_mask": attention_mask,

"labels": labels

}

# 应用处理函数到整个数据集

tokenized_ds = ds.map(process_func, remove_columns=ds.column_names)

print("\n数据预处理完成,转换为token ID格式:")

print(tokenized_ds)

# 可视化处理后的数据

print("\n===== 数据处理可视化 =====")

example_idx = 1# 选择第2个样本进行展示

# 解码输入序列,展示模型看到的内容

print("\n模型输入(包含Human和Assistant部分):")

print(tokenizer.decode(tokenized_ds[example_idx]["input_ids"]))

# 解码标签序列,展示模型需要学习生成的内容

print("\n模型学习目标(只有Assistant部分):")

filtered_labels = [idforidin tokenized_ds[example_idx]["labels"] ifid != -100]

print(tokenizer.decode(filtered_labels))

# 可视化标签中的-100位置,展示损失计算的机制

plt.rcParams['font.sans-serif'] = ['SimHei'] # Windows系统使用黑体

plt.rcParams['axes.unicode_minus'] = False# 解决负号显示问题

labels = tokenized_ds[example_idx]["labels"]

plt.figure(figsize=(10, 2))

colors = ['red'if x == -100else'green'for x in labels]

plt.bar(range(len(labels)), [1if x != -100else0.5for x in labels], color=colors)

plt.title("标签可视化: 红色(-100)表示Human部分(不计算损失),绿色表示Assistant部分(计算损失)")

plt.xlabel("Token位置")

plt.ylabel("是否计算损失")

plt.show()

第四步:创建模型

指令微调是在预训练模型基础上进行的,此处使用BLOOM中文模型。

model = AutoModelForCausalLM.from_pretrained("D:\\git\\transformers-code-master\\model-download\\bloom-389m-zh")

print(f"模型参数量: {model.num_parameters():,}")

第五步:配置训练参数

指令微调通常只需要少量数据和训练步骤,因为我们只是教会模型理解指令格式。

# 训练参数说明:小批次大小(4) + 梯度累积(8) = 有效批次大小(32)"),适用于低算力设备训练。

args = TrainingArguments(

output_dir="./chatbot", # 模型保存路径

per_device_train_batch_size=4, # 每个设备的批次大小

gradient_accumulation_steps=8, # 梯度累积步数,相当于使用了32的有效批次大小

logging_steps=10, # 每10步记录一次日志

num_train_epochs=1, # 训练1个epoch

save_strategy="epoch", # 每个epoch保存一次

learning_rate=2e-5, # 学习率

warmup_ratio=0.03, # 预热比例

# weight_decay=0.01, # 权重衰减,防止过拟合

)

第六步:创建训练器

使用Transformers的Trainer API简化训练流程。

trainer = Trainer(

model=model, # 预训练模型

args=args, # 训练参数

tokenizer=tokenizer, # 分词器

train_dataset=tokenized_ds, # 训练数据集

data_collator=DataCollatorForSeq2Seq(tokenizer=tokenizer, padding=True) # 数据整理器,处理不同长度序列

)

第七步:模型训练

开始指令微调训练,在训练过程中,模型学习如何根据Human的指令生成Assistant的回答。

trainer.train()

第八步:模型推理

测试模型是否学会了遵循指令回答问题。

from transformers import pipeline

# 创建文本生成pipeline

pipe = pipeline("text-generation", model=model, tokenizer=tokenizer, device=0 if torch.cuda.is_available() else -1)

# 构建测试输入,遵循训练时的格式

test_instruction = "考试有哪些技巧?"

test_input = ""

ipt = "Human: {}\\n{}".format(test_instruction, test_input).strip() + "\n\nAssistant: "

print("\n测试输入:")

print(ipt)

print("\n模型生成的回复:")

response = pipe(ipt, max_length=256, do_sample=True, temperature=0.7)

print(response[0]['generated_text'])

总结

- 指令微调是让模型学习 [Human提问 - Assistant回答] 的交互模式;

- 通过标签设计(-100),让模型只学习生成Assistant部分的内容;

- 指令微调使预训练模型从[预测下一个词]转变为[理解并执行指令];

- 少量数据和训练步骤,就能让模型学会按照指定格式回答问题;

那么,如何系统的去学习大模型LLM?

作为一名从业五年的资深大模型算法工程师,我经常会收到一些评论和私信,我是小白,学习大模型该从哪里入手呢?我自学没有方向怎么办?这个地方我不会啊。如果你也有类似的经历,一定要继续看下去!这些问题啊,也不是三言两语啊就能讲明白的。

所以我综合了大模型的所有知识点,给大家带来一套全网最全最细的大模型零基础教程。在做这套教程之前呢,我就曾放空大脑,以一个大模型小白的角度去重新解析它,采用基础知识和实战项目相结合的教学方式,历时3个月,终于完成了这样的课程,让你真正体会到什么是每一秒都在疯狂输出知识点。

由于篇幅有限,⚡️ 朋友们如果有需要全套 《2025全新制作的大模型全套资料》,扫码获取~

👉大模型学习指南+路线汇总👈

我们这套大模型资料呢,会从基础篇、进阶篇和项目实战篇等三大方面来讲解。

👉①.基础篇👈

基础篇里面包括了Python快速入门、AI开发环境搭建及提示词工程,带你学习大模型核心原理、prompt使用技巧、Transformer架构和预训练、SFT、RLHF等一些基础概念,用最易懂的方式带你入门大模型。

👉②.进阶篇👈

接下来是进阶篇,你将掌握RAG、Agent、Langchain、大模型微调和私有化部署,学习如何构建外挂知识库并和自己的企业相结合,学习如何使用langchain框架提高开发效率和代码质量、学习如何选择合适的基座模型并进行数据集的收集预处理以及具体的模型微调等等。

👉③.实战篇👈

实战篇会手把手带着大家练习企业级的落地项目(已脱敏),比如RAG医疗问答系统、Agent智能电商客服系统、数字人项目实战、教育行业智能助教等等,从而帮助大家更好的应对大模型时代的挑战。

👉④.福利篇👈

最后呢,会给大家一个小福利,课程视频中的所有素材,有搭建AI开发环境资料包,还有学习计划表,几十上百G素材、电子书和课件等等,只要你能想到的素材,我这里几乎都有。我已经全部上传到CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

相信我,这套大模型系统教程将会是全网最齐全 最易懂的小白专用课!!

6151

6151

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?