大模型——用LM Studio本地运行大模型

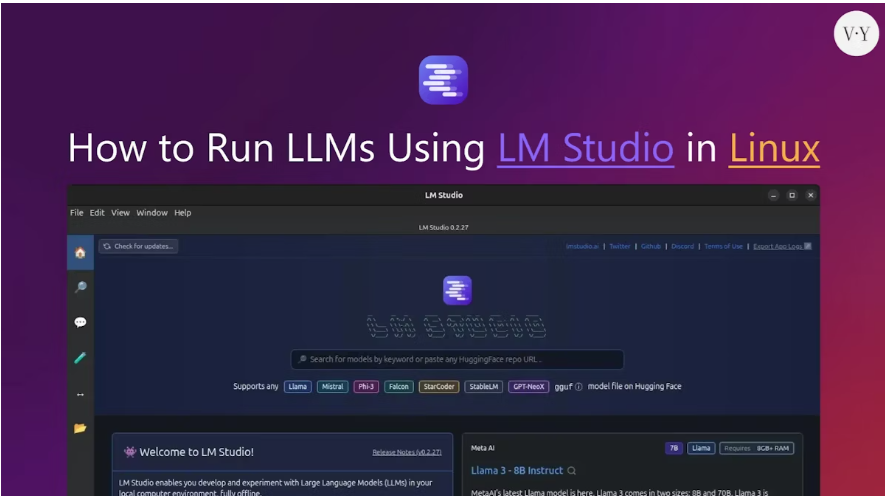

LM Studio 是一款流行的 GUI 应用程序,它允许具有基本计算机知识的用户在其 Linux 机器上轻松下载、安装和运行大型语言模型 (LLM)。

LM Studio 是一款流行的 GUI 应用程序,它允许具有基本计算机知识的用户在其 Linux 机器上轻松下载、安装和运行大型语言模型 (LLM)。

可以使用 LM Studio 聊天界面轻松安装、设置和访问流行的 LLM 模型,例如 Llama 3、Phi3、Falcon、Mistral、StarCoder、Gemma 等。

这样,你就不会被 OpenAI 的 ChatGPT 等专有的基于云的 AI 所困扰,并且可以轻松地在离线状态下私下运行自己的 LLM,而无需为完整功能支付任何额外费用。

在本文中,我将向你展示如何在 Linux 上安装 LM Studio、下载并使用 GPT-3 模型。

系统要求

在 PC 上本地运行 LLM 模型需要满足某些最低要求才能确保获得良好的体验。确保你至少拥有…

- 具有至少 8 GB VRAM 的 NVIDIA 或 AMD 显卡。

- 20 G

订阅专栏 解锁全文

订阅专栏 解锁全文

7934

7934

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?