https://zhuanlan.zhihu.com/p/622314514

作者:yougeii 编辑:CVer

Github(已开源):

https:// https://github.com/ttengwang/Caption-Anything

Hugging Face Demo:

https://huggingface.co/spaces/TencentARC/Caption-Anything

清明上河图demo

近日南方科技大学和腾讯ARC Lab开源了一款交互式图像描述工具, 基于Segment Anything, BLIP-2 Captioning和chatGPT实现, 通过视觉控制(鼠标点击)获取特定区域的object, 并以多样化的语言风格描述出来.

传统图像描述或密集描述通常以解析全图为目的, 如果遇到清明上河图等场景丰富且object交互特别复杂的图像, 一个简单的句子或非常长的段落, 对用户阅读很不友好. Caption Anything想看哪里即点击哪里, 根据用户需求定制化地关注局部区域, 进行细节描述及后续推理任务. 同时具有速度优势.

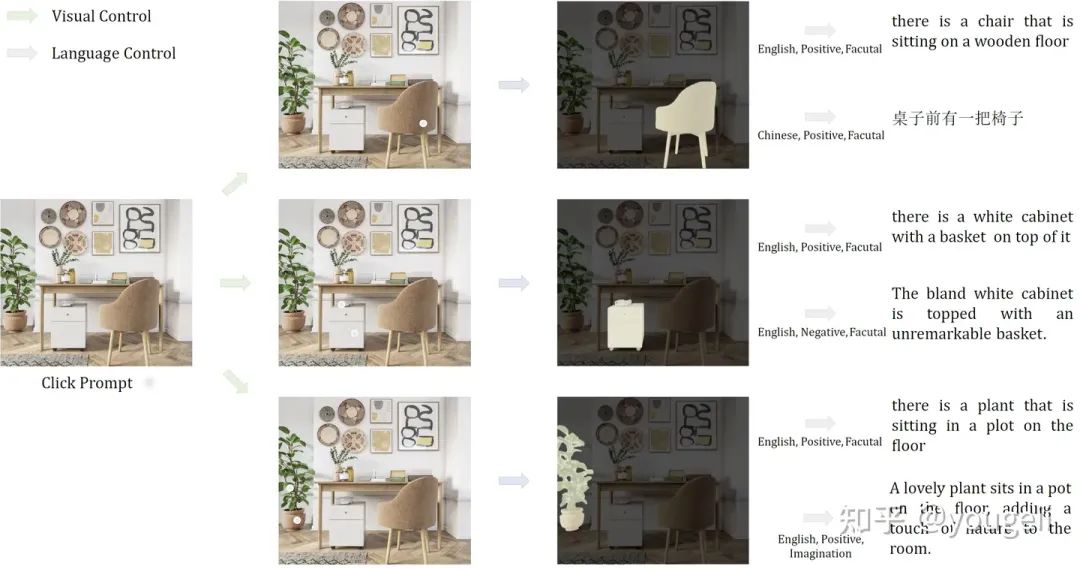

描述一幅图是一对多的映射, 不同用户对图像区域关注重点不同, 语言风格需求也不同. 面对如此多样的文本输出空间, 交互式控制模型输出可以与用户的需求更加对齐. 如下图所示, Caption Anything提供了视觉控制和语言控制.

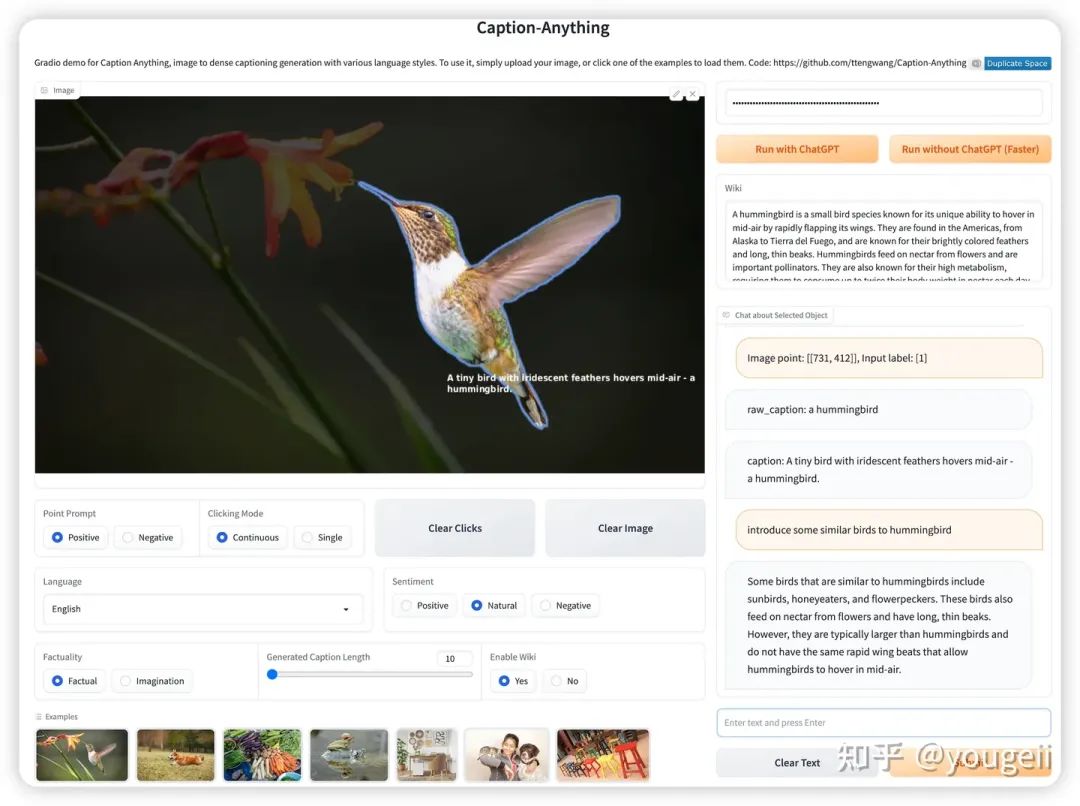

用户界面: 支持鼠标点击(连续或单次点击), 输出描述的语言风格控制(情感, 语种, 想象), 利用chatGPT输出物体对应的wiki知识, 同时支持chatGPT进行对话. 代码同时支持Linux和Windows平台.

Github(已开源):

https:// https://github.com/ttengwang/Caption-Anything

猜您喜欢:

深入浅出stable diffusion:AI作画技术背后的潜在扩散模型论文解读

深入浅出ControlNet,一种可控生成的AIGC绘画生成算法!

最新最全100篇汇总!生成扩散模型Diffusion Models

附下载 |《TensorFlow 2.0 深度学习算法实战》

《礼记·学记》有云:独学而无友,则孤陋而寡闻

点击 一顿午饭外卖,成为CV视觉的前沿弄潮儿!,领取优惠券,加入 AI生成创作与计算机视觉 知识星球!

418

418

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?