1 毫米波雷达与自动驾驶系统

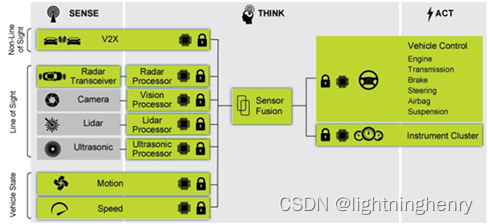

4D毫米波雷达与车载自动驾驶系统的关系紧密,聊4D毫米波雷达,肯定抛不开自动驾驶系统。自动驾驶系统分为感知层(sense)、决策层(think)和执行层(act)。

- 感知层用来完成对车辆周围环境的感知识别。感知层用到了各种各样的传感器,其中包括毫米波雷达、激光雷达、摄像头等,以及用于定位和导航的GPS(全球定位系统)和IMU(惯性测量单元)。此外,还有协同式全局数据辅助,包括高精度地图、V2X车联网技术等,扩展智能车的环境感知能力。

- 决策层包括几个功能,一是分析感知层收集的信息,对车辆自身精确定位,对车辆周围环境准确理解。二是对未来一段时间内的可能发生情况进行准确预测。三是规划合理行动和路径达到目标。决策层用到了DC也或DCU。

- 执行层是由车辆底层控制系统执行决策控制信息,通过线控技术完成执行机构的电控化,达到电子制动、电子驱动和电子转向,实现决策层对行为和路径的规划。

4D毫米波雷达属于自动驾驶系统的感知层,它主要输出周围目标的高精度点云信息(距离、方位、速度、高度)给决策层。

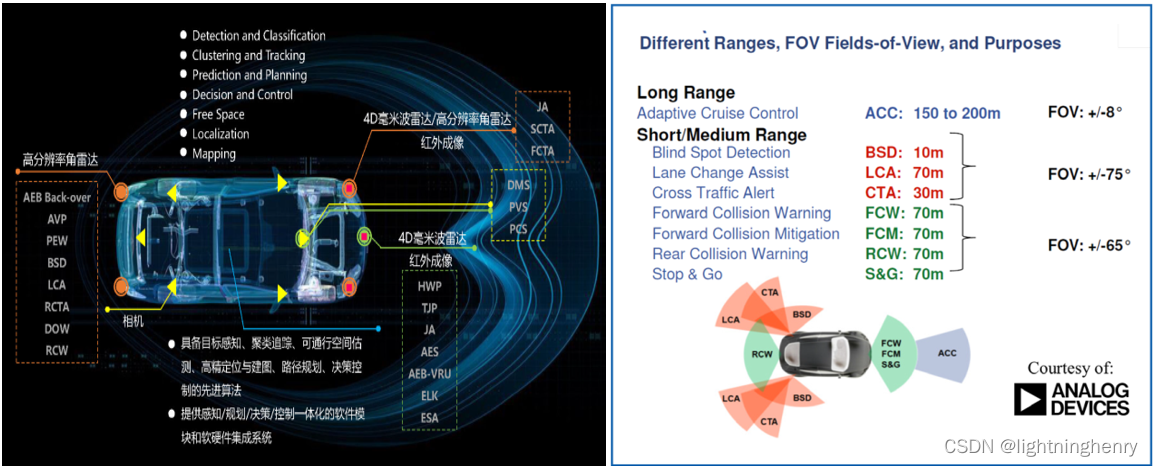

那么4D毫米波雷达位于汽车哪个部位呢?看下图

4D毫米波雷达一般布在在汽车车头灯、车正前方和车尾灯这三个位置。根据布局的位置不同,毫米波雷达的功能也不同。

车头灯位置的毫米波雷达叫做前向角雷达,一般是短距,用于前向碰撞预警(FCW)、交通拥挤辅助(JA)、前/侧向交通警报(F/SCTA)等。

正前方的毫米波雷达叫做前向雷达,一般是中、长距,用于(自适应巡航)ACC、交通拥挤辅助(JA)、自动紧急转向(AES)、行人自动紧急制动(AEB-VRU)和紧急转向辅助(ESA)等。

车尾灯的毫米波雷达叫做后向角雷达,一般是短距,用于自动紧急制动(AEB back-over)、盲区检测(BSD)、变道辅助(LCA)、后向交通警报(RCTA)、车门开启预警(DOW)和追尾碰撞预警(RCW)等。

以后的趋势是前向角雷达和前向雷达都将采用4D毫米波雷达,以提高分辨率,提升目标和环境的点云质量。目前MIMO技术只应用于单部雷达上,还没有应用于多部雷达,因为当前的自动驾驶系统只做数据级融合,还不能做信号级融合(类似分布式MIMO),主要是因为数据传输量太大,信号融合算法太过复杂。

上面介绍了4D毫米波雷达与自动驾驶汽车的关系,下面正式介绍4D毫米波雷达的硬件架构:

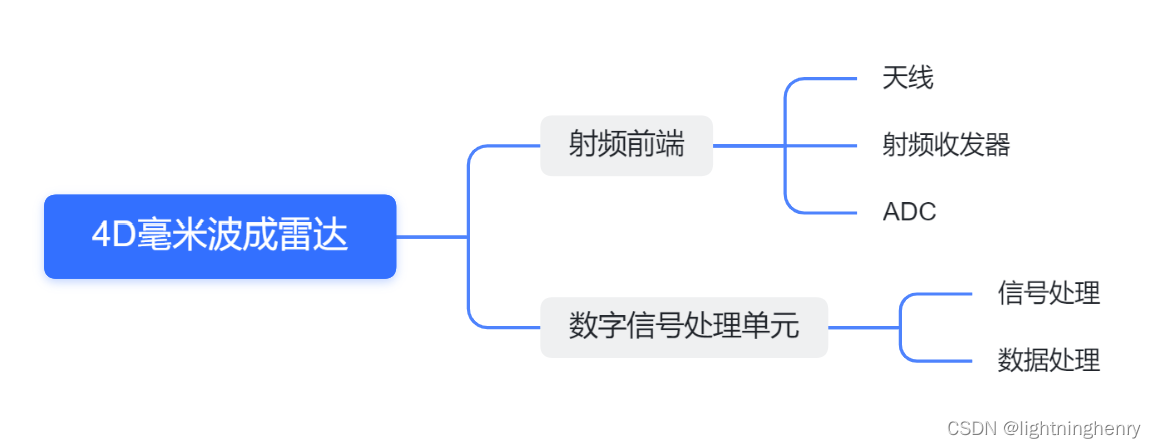

2 4D毫米波雷达硬件架构

4D毫米波雷达包括射频前端和数字信号处理模块两个部分。以大陆ARS540为例:

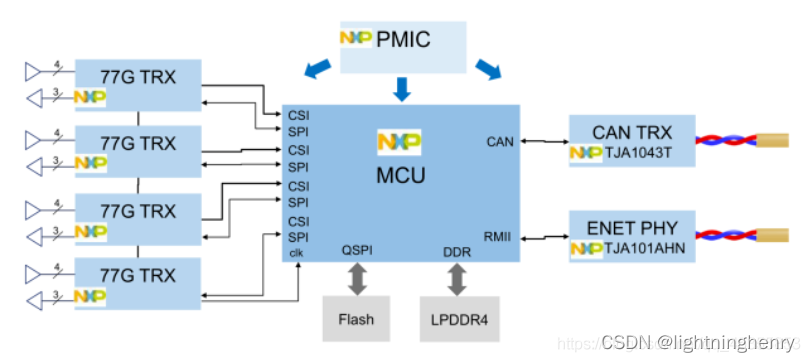

图中左侧为4片NXP公司77GHz3发4收的毫米波雷达收发器MR3003级联组成射频前端,图中央是以MCU为核心的信号处理模块,附带QSPI、DDR、CAN等外围。

(1)射频前端

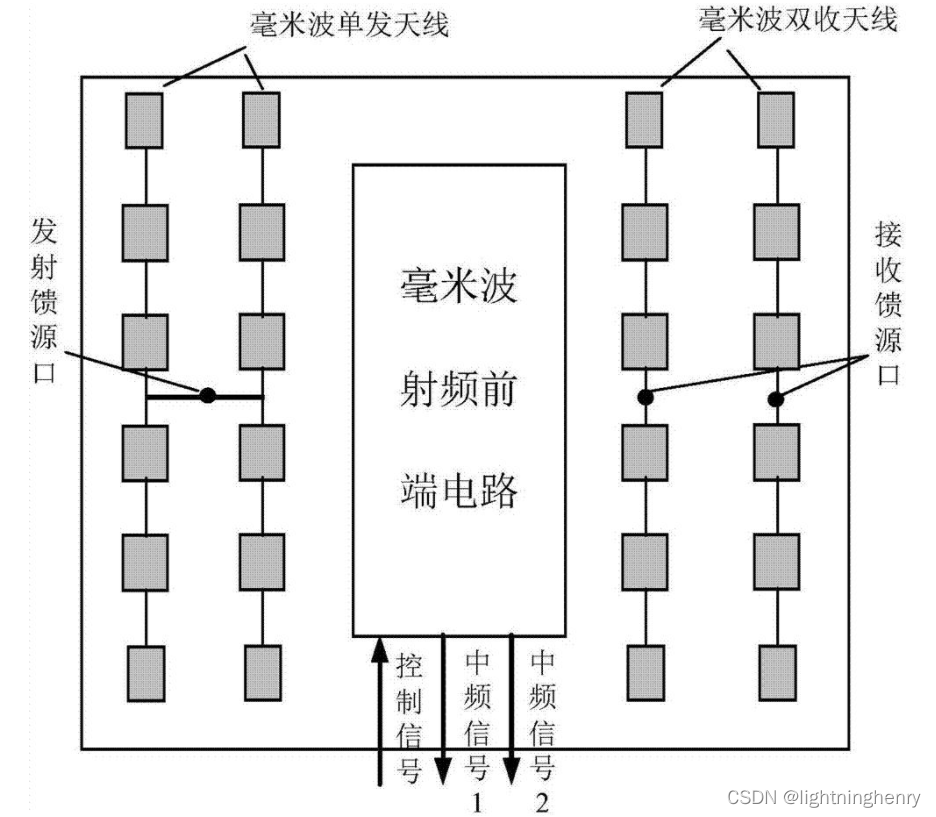

射频前端包括俯仰方位两维天线阵列以及功率器件等。射频前端用来发射和接收毫米波。

当前毫米波雷达射频前端主要为平面集成电路,有混合微波集成电路(HMIC)和单片微波集成电路(MMIC)两种形式。

其中,MMIC形式的射频前端成本低,成品率高,适合于大规模生产。在生产工艺上,一般采用的是外延MESFET、HEMT和HBT等器件工艺。基于GaAs基的HEMT工艺最为成熟,具有优秀的噪声性能。基于SiGe的HBT BiCMOS工艺能够实现超宽带频率调谐范围。

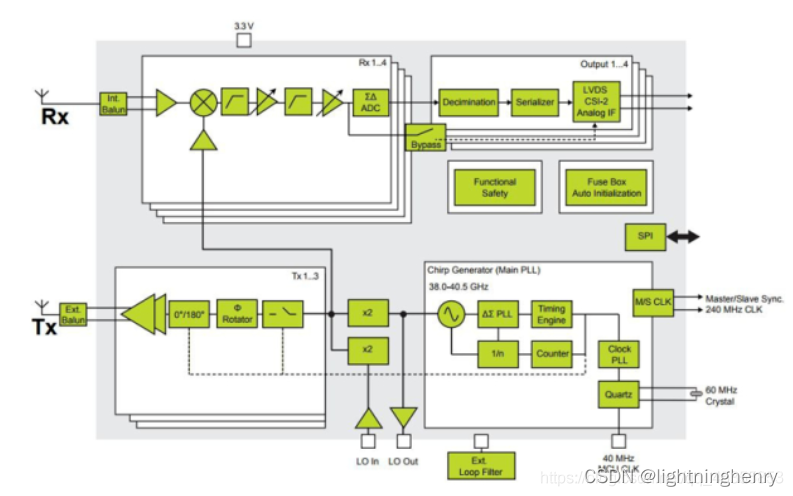

ARS540射频前端MR3003就是采用微波集成电路(MMIC)技术,如上图所示。MR3003集成了ADC模数转换,采用MIPI CSI2或LVDS输出,能够传输大带宽信号,提高信号的信噪比,保证了信号分辨率和数据精度。此外还集成了功能安全模块和PLL锁相环电路,降低了成本,提升了可靠性。最后,MR2001是4发3收天线设计,MR3003是3发4收天线设计。

(2)数字信号处理单元

数字信号处理单元是毫米波雷达重要的组成部分,主要分为信号处理与数据处理两块。

- 信号处理通过嵌入不同的信号处理算法,满足从中频信号处理,到获取目标、场景三维点云信息(距离、方位、俯仰、速度等)整个流程中的所有处理需求。信号处理系统一般以MCU、SOC、DSP和FPGA等,实现复杂的数字信号处理算法,满足实时应用需求。

- 数据处理是整个毫米波雷达中难度最大的一块,主要包括目标跟踪与目标识别两个任务,涉及到点云聚类融合、航迹处理、目标类型识别与行为预测等。

下面以ARS540为例介绍数字信号处理单元的硬件架构:

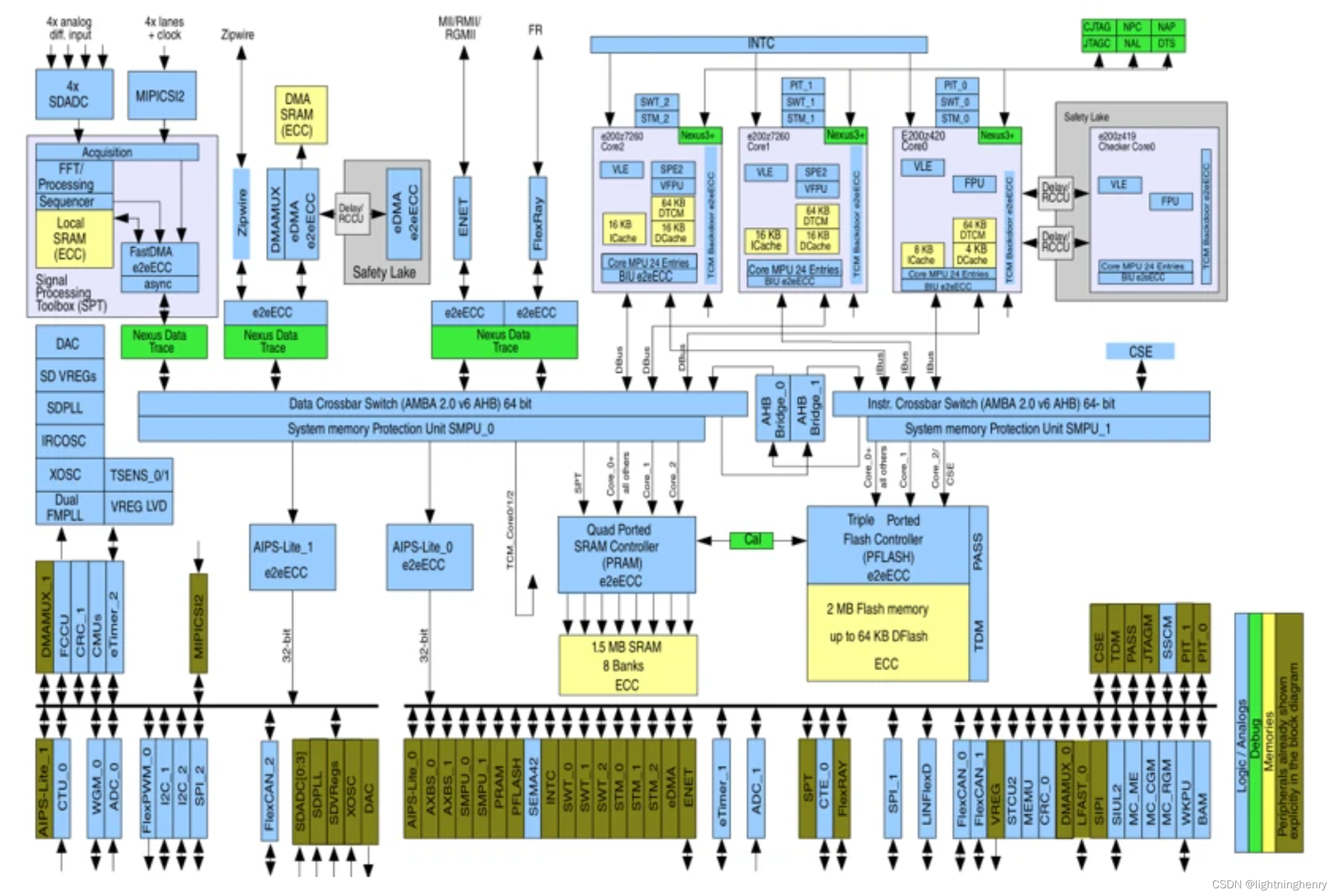

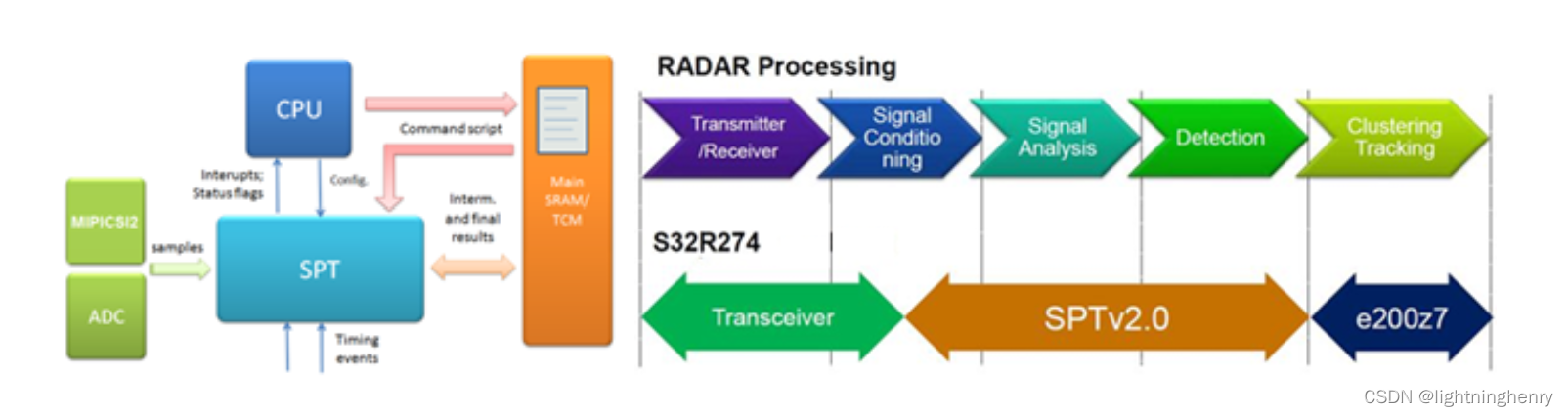

ARS540的MCU采用S32R274(如下图所示)。它主要包含1个SPT(signal processing toolbox)、2个e200z7260用于通用计算和1个e200z420负责安全管理。SPT模块集成了FFT、DOA和CFAR等诸多常用信号处理算法。

ARS540的MCU采用基于32位Power Architecture架构的S32R274。它主要包含1个SPT(signal processing toolbox)、2个e200z7260核、1个e200z420核和1个e200419核。e200z7260和e200z420负责通用计算,两种核集成了VLE、FPU实时计算单元,e200z7260核额外增加了SPE2 APU单元,支持信号处理中所需的实时单指令多数据流(SIMD)的定点单精度数字运算。e200419是一个锁步核,它只能和e200z420同步执行相同的指令流,不能单独使用。SPT和4个Z7核通过1.5Mb的SRAM交互数据。

S32R274的SPT模块通过4路ADC接收MR3003传输的ADC采样数据,通过4路MIPICSI接口接收帧起始、信号起始和接收窗信号等参数。根据SRAM中的指令利用硬件加速器,对数据做向量数值计算、直方图计算、FFT、峰值搜索等基本信号分析处理,完成CFAR检测、DOA估计、多普勒估计等处理,检测结果存入SRAM。

e200z7260、e200z420从SARM提取SPT模块的检测结果,利用本身集成的融合、提取、选择等数据操作功能,完成目标跟踪、目标融合聚类识别等雷达数据处理。最后S32R274通过FlexCAN和ENET将处理结果传输给车载系统。

最后附赠一张经典雷达信号处理流程图:

本文详细介绍了4D毫米波雷达在自动驾驶系统中的作用,特别是在感知层提供高精度点云信息。4D毫米波雷达硬件由射频前端和数字信号处理单元组成,其中MR3003作为关键组件,采用MMIC技术。数字信号处理单元以S32R274 MCU为核心,结合SPT和多个e200z核,完成信号处理和数据处理任务,确保实时目标跟踪和识别。

本文详细介绍了4D毫米波雷达在自动驾驶系统中的作用,特别是在感知层提供高精度点云信息。4D毫米波雷达硬件由射频前端和数字信号处理单元组成,其中MR3003作为关键组件,采用MMIC技术。数字信号处理单元以S32R274 MCU为核心,结合SPT和多个e200z核,完成信号处理和数据处理任务,确保实时目标跟踪和识别。

4748

4748

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?