YOCO:基于共面的全自动lidar-camera外参标定

附赠自动驾驶最全的学习资料和量产经验:链接

如何让标定更准确

lidar-camera标定主要分为基于靶标和无靶标的方法。

-

基于目标的方法:能提供较高的校准精度和鲁棒性,允许对校准误差进行追踪,这对于在受控环境中实现精确校准非常有用。但是需要人工干预、有特定的数据采集要求、标定过程复杂且耗时。

-

无目标的方法:旨在尽量减少人工干预,从而提高校准过程的效率。可以在不同场景中使用,而无需特定的校准目标,使它们在不同环境中更加灵活。但是缺点是泛化挑战、精度问题、实时评估挑战

建立对应关系和配准对应点都是极具挑战性的任务。在建立对应关系时,主要方法包括识别相机和激光雷达传感器之间的对应特征。以前的研究集中在几何特征和人工特征上。通常,检测二维图像中的特征相对简单,但在激光雷达点云中识别和提取相应的三维特征点更为复杂。这是因为二维图像包含丰富的语义和颜色信息,而点云通常仅由三维空间中的坐标组成。这些稀疏分布的点云使得找到合适的特征变得困难。为了解决这个问题,通常的方法是手动选择对应点。一旦在图像中检测到特征点,便手动选择和提取激光雷达点云中的匹配点。对于手动选择的对应点,点云配准相对简单,常见的方法包括点对点、点对线、线对线和线对面配准。由于手动选择的对应点相对准确,通过点云配准可以获得高精度的外部参数。然而,手动选择对应点需要大量的人工干预,导致校准过程复杂、繁琐且耗时。

精度相关的挑战在于:

-

自动提取的对应特征点可能无法保证完全准确,这会导致影响校准精度的错位问题

-

点云配准过程中对输入数据的广泛需求进一步导致了用于配准的错位点增加,从而最终影响精度。

尽管已经提出了几种方法来优化点云提取和配准的过程,但它们仍无法从根本上解决这个问题。

本文介绍的YOCO是一种新颖的标定方法,该方法通过创新的外参计算自动提取对应点并绕过点云配准过程,解决了时间和精度上的挑战。该方法最大限度地利用点云信息,减少校准输入数据的需求,提高了精度和速度。所提出的方法易于实现,仅需少量数据即可实现高精度校准且无需人工干预。主要贡献总结如下:

-

提出了一种新的外部参数计算方法,消除了在相机和 LiDAR 传感器之间配准对应点的必要性,为传统的配准过程提供了新的视角和技术解决方案。

-

引入了一种新的平面提取方法,用于检测和提取对应的平面点云,为涉及空间几何先验知识的平面提取场景提供了有价值的见解。

-

提出了一个完全自动化的 LiDAR 和相机系统标定流程。该过程对标定数据的采集要求简单,可用于各种 LiDAR 和相机配置的离线标定。

源代码将在 GitHub 上发布:https: //http://github.com/louiszengCN/lidar camera auto calibration

具体方法

方法流程如图2

相机标定

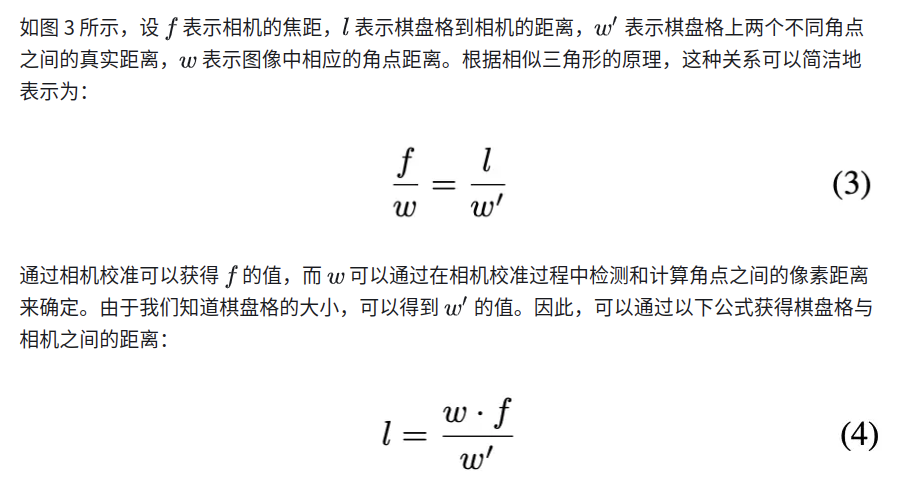

完成相机校准后,可以通过针孔相机模型估算棋盘格与相机之间的距离。

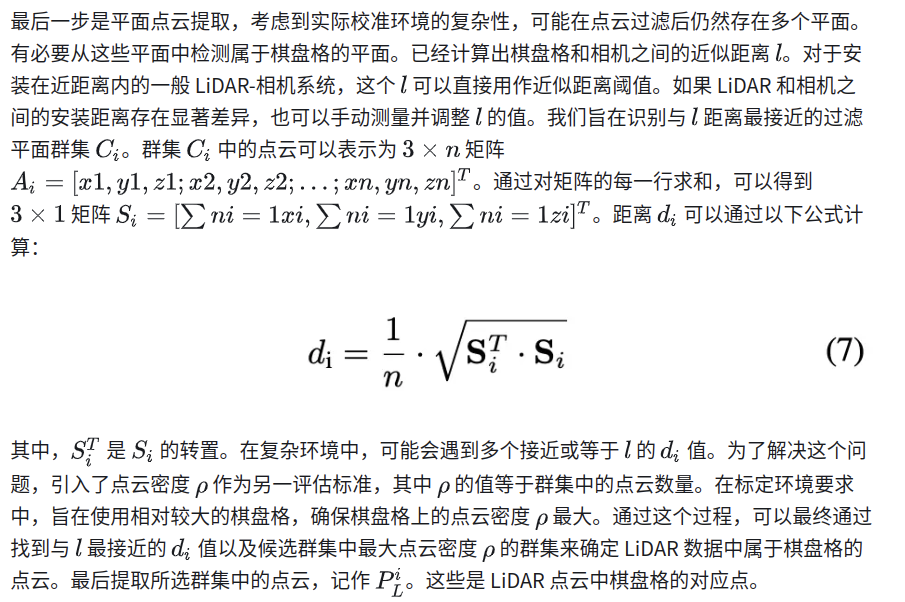

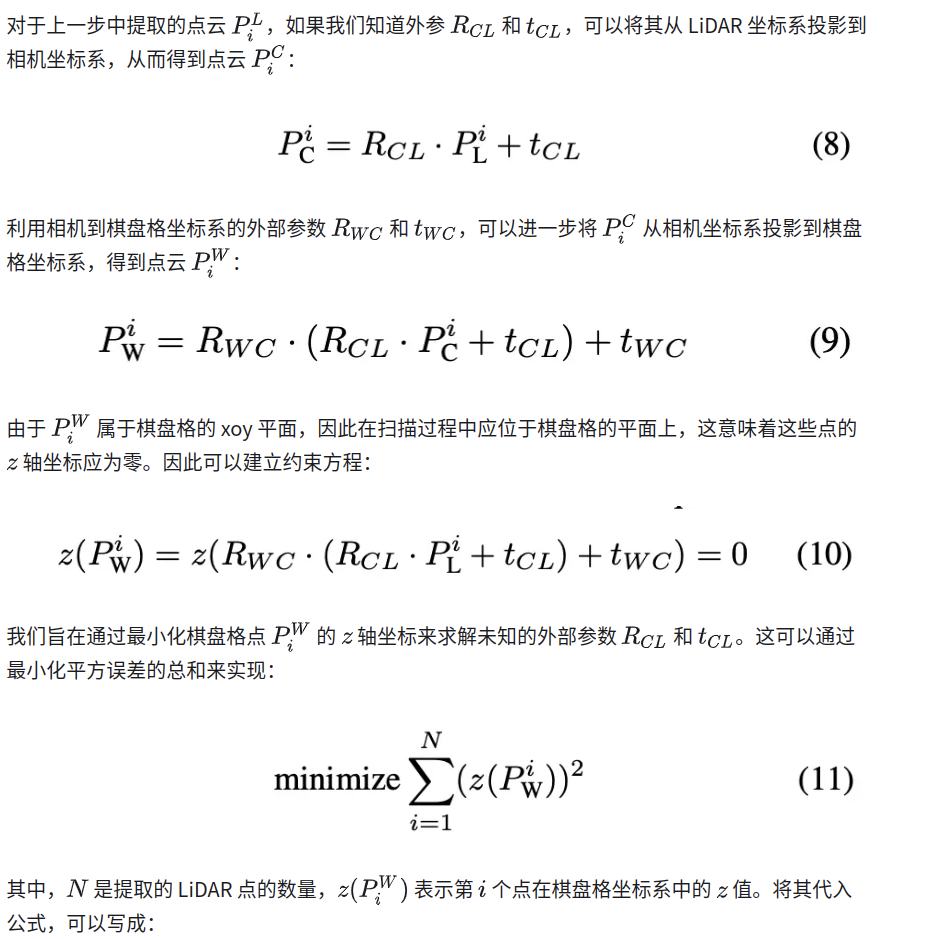

LiDAR 点云处理

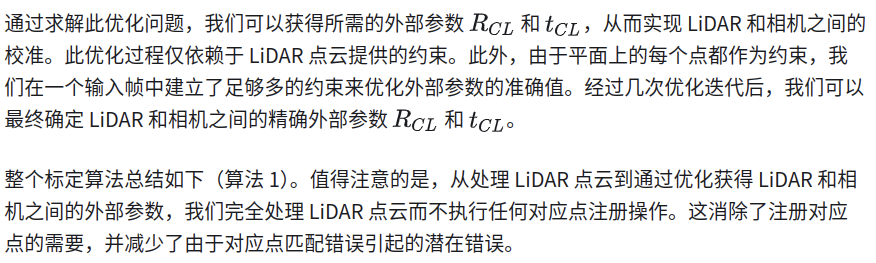

共面约束与外部参数计算

实验效果

总结一下

YOCO是一种新颖的 LiDAR-相机校准方法,易于实现且不依赖于人工干预。关键创新在于避免了当前大多数校准方法中使用的对应点配准。这是通过一种能够在复杂环境中提取平面点云并构建共面约束的算法来实现的。这一过程避免了配准方法中由于对应点匹配错误引入的误差,并最大化了点云信息的利用,从而减少了所需的校准输入数据。大量仿真和实际数据实验表明,与当前方法相比,该方法在外参中具有较高的精度。

改进空间:在复杂场景中,该方法中提取平面点云的算法可能难以准确提取类似于棋盘格的平面。当棋盘格放置得距离 LiDAR-相机系统过远时,其平面的稀疏点云可能导致共面约束不够严格,从而影响校准参数的准确性。未来的工作包括进一步增强平面点云提取方法在复杂场景中的有效性和鲁棒性,并将该算法扩展到更普遍的场景。

参考

[1] YOCO: You Only Calibrate Once for Accurate Extrinsic Parameter in LiDAR-Camera Systems

246

246

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?