本文对比了大模型微调的两种主流方法:全量微调更新所有参数,性能最优但成本高昂;LoRa微调仅训练少量低秩矩阵,参数效率高、成本低、速度快,适合多任务并行。全量微调适合资源充足、追求极致性能的场景;LoRa微调适合资源有限、需要快速迭代或多任务并行的场景。随着大模型生态成熟,参数高效微调技术正成为主流,LoRa凭借其灵活高效的特点,成为大多数团队的首选。

前排提示,文末有大模型AGI-CSDN独家资料包哦!

在大模型(Large Language Models, LLMs)飞速发展的今天,如何高效地让模型适应特定任务或领域,成为每个AI开发者和企业关注的核心问题。微调(Fine-tuning)作为提升模型性能的重要手段,近年来衍生出多种技术路径。其中,全量微调(Full Fine-tuning) 和 LoRa微调(Low-Rank Adaptation) 成为讨论最热烈的两种方案。

本文将深入浅出地对比这两种微调方式,帮助你在实际项目中做出更明智的选择。

一、什么是微调?

微调,简单来说,就是在预训练大模型的基础上,使用特定领域的数据对模型参数进行进一步训练,使其在特定任务(如客服问答、法律文本生成、医疗诊断等)上表现更优。

大模型(如LLaMA、ChatGLM、Qwen等)通常在海量通用语料上预训练,具备广泛的语言理解能力,但要“专业”起来,还得靠微调。

二、全量微调:传统但昂贵

全量微调,顾名思义,就是对模型的所有参数进行更新。它沿袭了传统深度学习的训练方式,效果通常非常显著。

✅ 优点:

-

性能上限高

:所有参数可调整,模型能深度适配目标任务,效果往往最好。

-

灵活性强

:适用于各种复杂任务,尤其适合数据量大、任务差异大的场景。

❌ 缺点:

-

计算成本极高

:以7B参数的模型为例,全量微调需要多张高端GPU(如A100),训练成本动辄数千甚至上万元。

-

存储开销大

:每微调一次,就生成一个完整的模型副本,难以管理多个任务的模型版本。

-

训练周期长

:需要大量时间和资源,不适合快速迭代。

📌 举个例子:你训练一个7B模型用于金融客服,全量微调后模型性能提升了15%,但你花了3天时间和2万元成本,且无法同时维护法律、医疗等多个领域的模型。

三、LoRa微调:轻量高效的“外挂式”升级

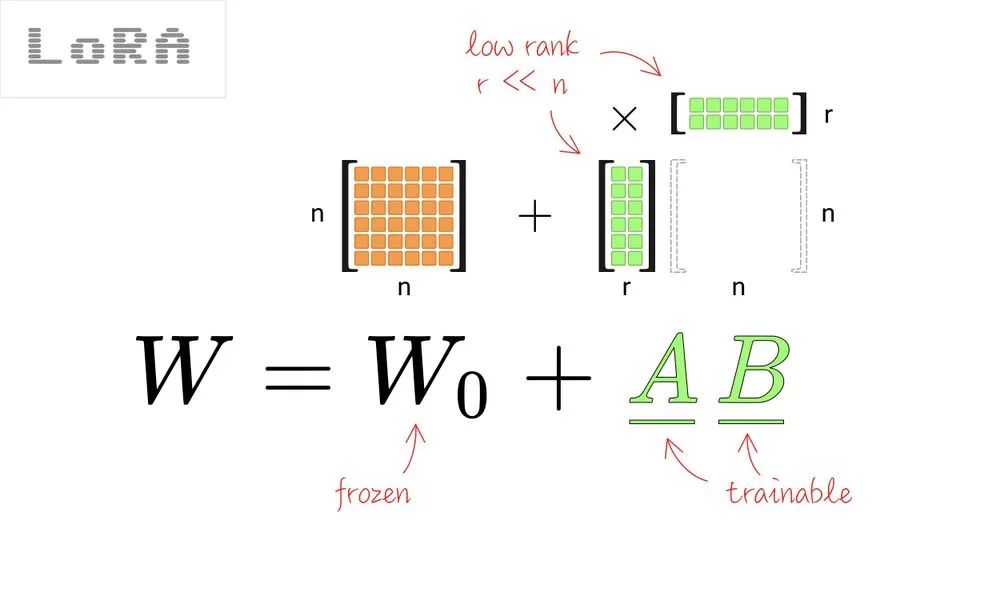

LoRa(Low-Rank Adaptation) 是一种参数高效的微调方法,由微软在2021年提出。它的核心思想是:不直接修改原始模型参数,而是引入少量可训练的低秩矩阵,作为“外挂模块”来调整模型行为。

✅ 优点:

-

参数效率高

:仅需训练0.1%~1%的参数(如7B模型只需训练几十万到几百万参数),大幅降低计算资源需求。

-

训练速度快

:通常在单卡(如3090/4090)上几小时即可完成。

-

存储成本低

:只保存LoRa权重(通常几十MB),可与原始大模型“组合使用”,节省大量存储空间。

-

支持多任务并行

:同一基础模型可加载不同LoRa模块,实现“一模多用”。

❌ 缺点:

-

性能略逊于全量微调

:在某些复杂任务上,可能达不到全量微调的上限。

-

依赖基础模型质量

:如果预训练模型本身不强,LoRa提升有限。

📌 同样是7B模型用于金融客服,使用LoRa微调,你可能只花了800元和6小时,获得了90%的性能提升,且还能轻松切换到法律或电商场景。

四、核心对比:一张表看懂差异

| 维度 | 全量微调 | LoRa微调 |

|---|---|---|

| 训练参数量 | 100% | 0.1% ~ 1% |

| 显存需求 | 高(多卡A100) | 低(单卡3090/4090) |

| 训练时间 | 数天 | 数小时 |

| 存储成本 | 高(每个模型数GB) | 极低(LoRa权重几十MB) |

| 性能表现 | 最优 | 接近最优 |

| 多任务支持 | 需多个完整模型 | 一套基础模型 + 多个LoRa模块 |

| 适合场景 | 数据量大、任务复杂、追求极致 | 快速迭代、资源有限、多任务并行 |

五、如何选择?根据场景决策

✅ 推荐使用 全量微调 的场景:

- 你的任务非常复杂(如代码生成、多跳推理)

- 有充足的标注数据和计算资源

- 追求极致性能,愿意为效果投入成本

✅ 推荐使用 LoRa微调 的场景:

- 中小企业或个人开发者,预算有限

- 需要快速验证多个业务方向

- 要支持多个垂直领域(如客服、营销、教育)

- 希望实现“模型即服务”(Model as a Service)的轻量化部署

六、趋势:LoRa正在成为主流

随着大模型生态的成熟,参数高效微调(PEFT) 技术(如LoRa、Adapter、Prefix-tuning)正成为主流。Hugging Face、阿里云、百度等平台均已原生支持LoRa训练。

LoRa不仅降低了AI应用的门槛,也让“大模型+小数据”的落地成为可能。未来,我们可能会看到更多“基础模型+插件化微调”的架构,真正实现AI的模块化和可组合性。

七、结语:没有最好,只有最合适

全量微调和LoRa微调,并非对立,而是互补。

全量微调是“重装部队”,追求极致性能;

LoRa微调是“特种兵”,灵活高效,以小博大。

在资源有限、节奏飞快的今天,LoRa微调无疑是大多数团队的首选。但当你真正需要“拼性能”的时候,全量微调依然是终极武器。

选择哪种方式,取决于你的目标、资源和节奏。

关键是:让技术服务于业务,而不是被技术绑架。

,以小博大。**

在资源有限、节奏飞快的今天,LoRa微调无疑是大多数团队的首选。但当你真正需要“拼性能”的时候,全量微调依然是终极武器。

选择哪种方式,取决于你的目标、资源和节奏。

关键是:让技术服务于业务,而不是被技术绑架。

文章来自网上,侵权请联系博主

读者福利:倘若大家对大模型感兴趣,那么这套大模型学习资料一定对你有用。

针对0基础小白:

如果你是零基础小白,快速入门大模型是可行的。

大模型学习流程较短,学习内容全面,需要理论与实践结合

学习计划和方向能根据资料进行归纳总结

包括:大模型学习线路汇总、学习阶段,大模型实战案例,大模型学习视频,人工智能、机器学习、大模型书籍PDF。带你从零基础系统性的学好大模型!

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

👉AI大模型学习路线汇总👈

大模型学习路线图,整体分为7个大的阶段:(全套教程文末领取哈)

第一阶段: 从大模型系统设计入手,讲解大模型的主要方法;

第二阶段: 在通过大模型提示词工程从Prompts角度入手更好发挥模型的作用;

第三阶段: 大模型平台应用开发借助阿里云PAI平台构建电商领域虚拟试衣系统;

第四阶段: 大模型知识库应用开发以LangChain框架为例,构建物流行业咨询智能问答系统;

第五阶段: 大模型微调开发借助以大健康、新零售、新媒体领域构建适合当前领域大模型;

第六阶段: 以SD多模态大模型为主,搭建了文生图小程序案例;

第七阶段: 以大模型平台应用与开发为主,通过星火大模型,文心大模型等成熟大模型构建大模型行业应用。

👉大模型实战案例👈

光学理论是没用的,要学会跟着一起做,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

👉大模型视频和PDF合集👈

这里我们能提供零基础学习书籍和视频。作为最快捷也是最有效的方式之一,跟着老师的思路,由浅入深,从理论到实操,其实大模型并不难。

👉学会后的收获:👈

• 基于大模型全栈工程实现(前端、后端、产品经理、设计、数据分析等),通过这门课可获得不同能力;

• 能够利用大模型解决相关实际项目需求: 大数据时代,越来越多的企业和机构需要处理海量数据,利用大模型技术可以更好地处理这些数据,提高数据分析和决策的准确性。因此,掌握大模型应用开发技能,可以让程序员更好地应对实际项目需求;

• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模型部署)一站式掌握;

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习框架等技术,这些技术的掌握可以提高程序员的编码能力和分析能力,让程序员更加熟练地编写高质量的代码。

👉获取方式:

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

9923

9923

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?