softmax回归

softmax其实是一个分类问题

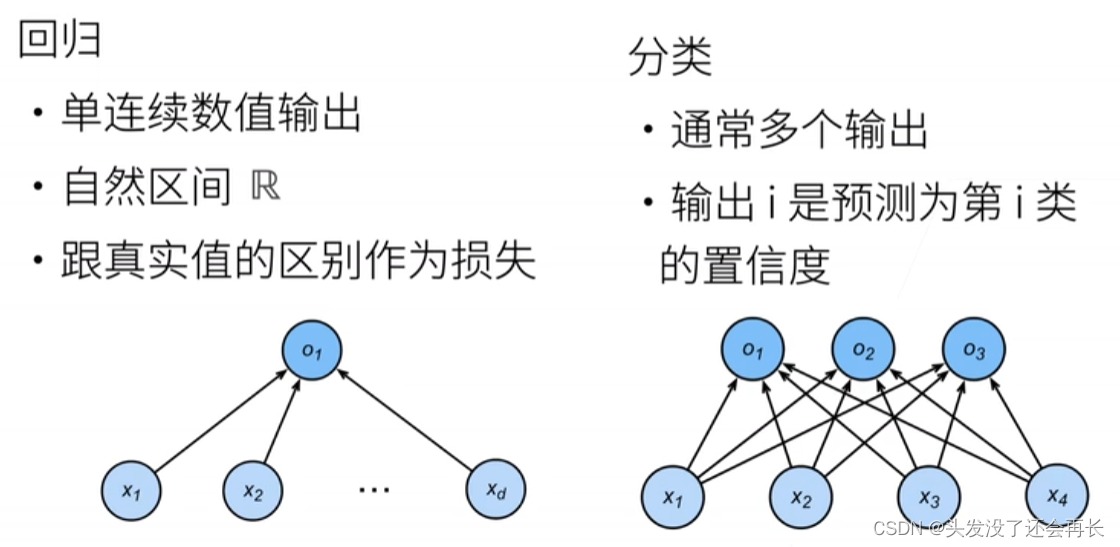

回归和分类的区别

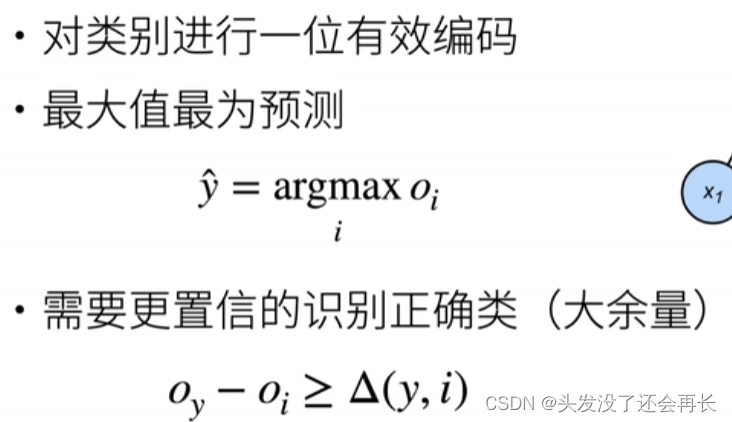

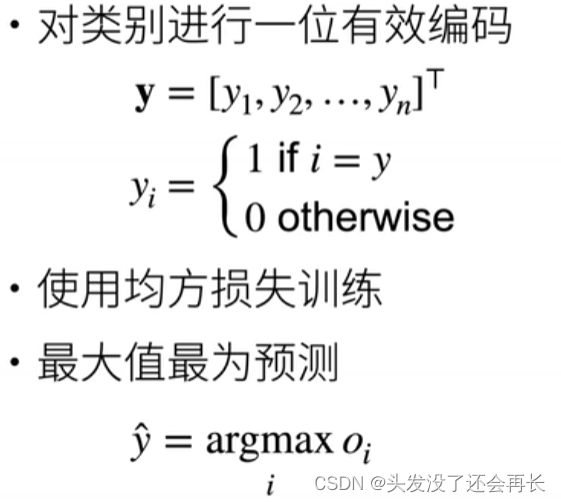

从回归到多类分类

均方损失

一位有效编码是:对于n个yi,只有一个是1,其他全为0,最大值取所有输出预测oi最大的

无校验比例

校验比例

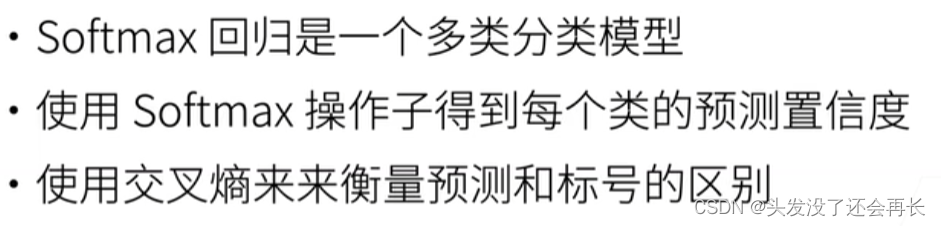

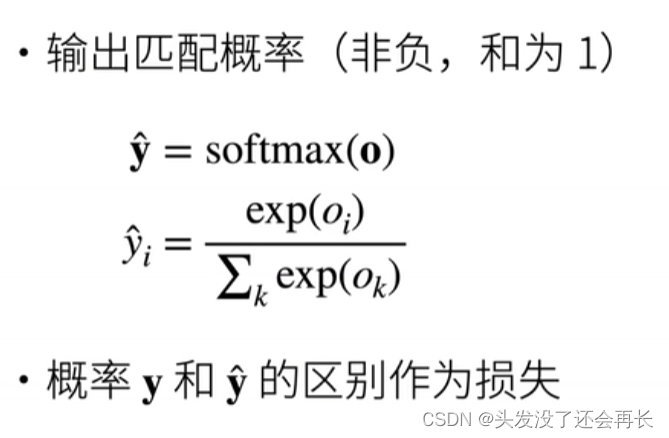

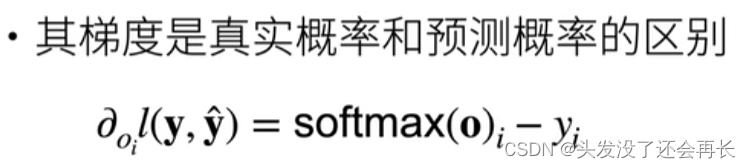

在输出之后加一个softmax层,所有的输出值o经过softmax得到y hat,和为1,这个softmax计算得到yi hat的公式如下:

这样的好处就是输出值yi hat就为一个概率了

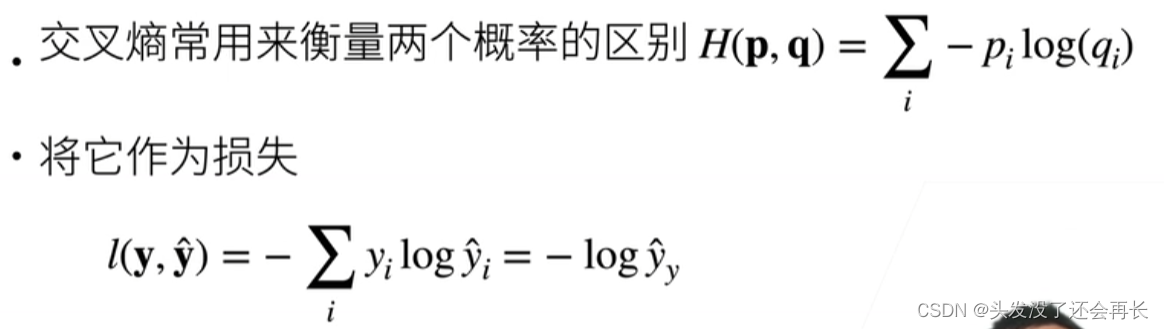

交叉熵损失

因为y的取值只有一个为1,所以损失l求和就变成-logy hat,这个y hat对应的是y为1的那一个类别的预测值,所以这个loss只关心正确的预测的概率,而不关心其他的预测

图像分类数据集

MNIST数据集 [LeCun et al., 1998] 是图像分类中广泛使用的数据集之一,但作为基准数据集过于简单。 我们将使用类似但更复杂的Fashion-MNIST数据集 [Xiao et al., 2017]。

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?