基于sklearn的机器学习应用平台 v2.0

链接:https://pan.baidu.com/s/1nvHMTrtBmtPLT4oNXdw74A

提取码私信博主获取

关于作者

作者:小白熊

作者简介:精通python、matlab、c#语言,擅长机器学习,深度学习,机器视觉,目标检测,图像分类,姿态识别,语义分割,路径规划,智能优化算法,数据分析,各类创新融合等等。

联系邮箱:xbx3144@163.com

科研辅导、知识付费答疑、个性化定制以及其他合作需求请联系作者~

一、概述

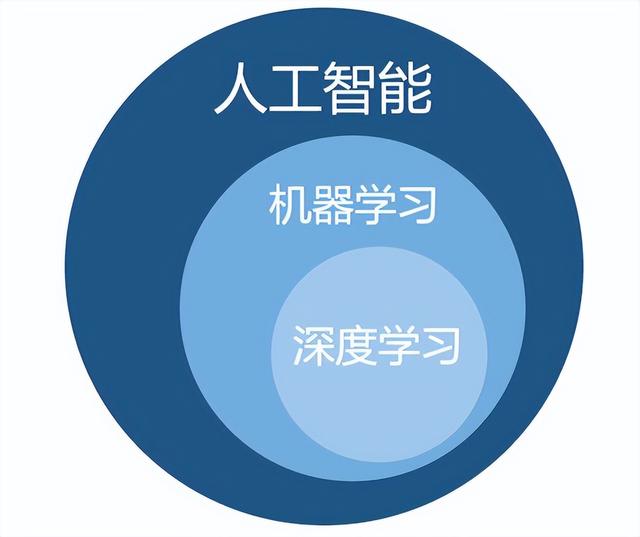

机器学习(Machine Learning)是人工智能的重要分支,近年来在各个领域得到了广泛应用。它通过自动化处理和分析大量数据,提高了工作效率,支持数据驱动的决策,推动个性化体验的实现,并在医疗、金融、交通等领域促进了创新与发展。随着技术的进步,机器学习在自动驾驶、语音识别等多种应用中展现了巨大潜力,推动了社会和经济的进步,成为现代科技发展的核心组成部分。

当我们获得一组数据时,常常会困惑选择哪种机器学习模型能够取得最佳效果。并且希望尝试各种流行的机器学习模型,以确保找到最适合的解决方案,但这一过程往往伴随着巨大的时间成本和繁琐的操作。因此作者基于PyQt5开发了这款机器学习平台,旨在简化模型选择和应用的过程。通过直观的界面和高效的算法集成,用户可以轻松地尝试多种机器学习模型,快速评估其性能,从而有效提高工作效率。这款平台不仅帮助用户节省时间,还使得机器学习的应用变得更加便捷和高效,满足了不同需求的用户。

该机器学习应用平台是一款集成多种机器学习模型的工具,旨在为用户提供一个友好的图形界面,以便轻松进行模型选择、训练、评估和预测。该平台支持分类和回归任务,拥有多种流行的机器学习模型可供选择,具备较为全面的模型训练能力和可视化效果,能够帮助用户快速获得所需的分析结果。

二、界面展示

模型训练模块

模型预测模块

三、主要功能

1. 数据处理与标准化

在机器学习中,数据预处理是关键的一步。用户可以指定数据的标签列,根据需要进行标准化处理,并将数据集以一定比例划分为训练集和验证集,训练集用于训练机器学习模型,算法通过学习训练集中的输入特征和对应的输出标签来调整其内部参数,从而使模型能够在该数据上做出准确的预测。而验证集则用于评估训练好的模型的性能,评估结果为用户提供了有关模型在实际应用中的表现。

2. 模型训练

用户可以选择不同的分类或回归模型进行训练。训练过程中会实时记录日志,以便用户追踪训练进度。

3. 性能评估

在模型训练完成后,平台计算训练集和验证集的多个评估指标,包括:

-

分类任务指标:

- 准确率 (Accuracy):表示模型正确预测的样本占总样本的比例,反映模型的整体性能。

- 精确率 (Precision):表示被正确预测为正类的样本占所有被预测为正类样本的比例,评估模型在正类预测上的准确性。

- 召回率 (Recall):表示被正确预测为正类的样本占所有实际正类样本的比例,评估模型对正类样本的捕捉能力。

- F1 值 (F1-Score):精确率和召回率的调和平均数,综合反映模型在正类预测上的表现,尤其适用于类别不平衡的数据。

-

回归任务指标:

-

均方误差 (MSE):表示预测值与实际值差异的平方的平均值,反映模型的预测准确性。

-

平均绝对误差 (MAE):表示预测值与实际值差异的绝对值的平均值,易于理解,适合对误差进行直观分析。

-

均方根误差 (RMSE):MSE 的平方根,提供与实际值的同一单位的误差度量。

-

决定系数 (R²):反映模型对数据变异性的解释能力,数值越接近 1 表示模型越能解释数据。

-

4. 可视化结果

平台生成混淆矩阵热力图(用于分类任务)和回归图(用于回归任务),以直观展示模型的预测效果。用户可以在界面内直接查看这些可视化结果,方便进行后续分析。

5. 模型保存与加载

训练完成后,平台会将模型及其相关参数保存为 .pkl 文件,便于后续加载和使用。

四、可选择模型

在机器学习应用平台 v2.0 中,用户可以选择多种模型进行分类或回归任务:

1. 自适应增强 (AdaBoost)

- 分类/回归:可用于分类和回归任务。

- 简介:AdaBoost(Adaptive Boosting)是一种集成学习方法,通过将多个弱分类器(如决策树)组合在一起,形成一个强分类器。其核心思想是对分类错误的样本赋予更大的权重,从而使后续的分类器更关注这些难以分类的样本。

- 优点:对噪声和过拟合的鲁棒性较强,适用于处理复杂数据。

2. 人工神经网络 (ANN)

- 分类/回归:可用于分类和回归任务。

- 简介:人工神经网络模拟人脑的神经元网络,由输入层、隐藏层和输出层组成。它们适用于捕捉复杂的非线性关系,能有效处理高维数据。

- 优点:具备强大的拟合能力,适合于模式识别、时间序列预测等任务。

3. 决策树 (DT)

- 分类/回归:可用于分类和回归任务。

- 简介:决策树通过构建树形结构来进行决策,每个节点表示特征,分支表示特征值的结果,叶子节点表示最终的预测结果。它们直观易懂,便于解释。

- 优点:处理非线性关系时表现良好,能够处理缺失值。

4. 额外树 (ET)

- 分类/回归:可用于分类和回归任务。

- 简介:额外树与决策树类似,但在构建过程中随机选择特征和样本。通过极大地降低模型的方差来提高预测性能。

- 优点:训练速度快,鲁棒性强,适用于大规模数据集。

5. 梯度增强机 (GBM)

- 分类/回归:可用于分类和回归任务。

- 简介:GBM通过逐步构建新的模型来减少预测误差,每个新模型关注前一个模型错误的样本。它适合处理大规模数据和复杂关系。

- 优点:强大的预测能力和灵活性,可以通过调整超参数进一步优化。

6. k 近邻增强机 (KNN)

- 分类/回归:可用于分类和回归任务。

- 简介:KNN是基于实例的学习方法,通过计算测试样本与训练样本之间的距离,预测测试样本的标签或值。它简单直观,易于实现。

- 优点:对局部模式的捕捉能力强,适合小规模数据集,但对大规模数据的计算复杂度较高。

7. 轻梯度增强机 (LightGBM)

- 分类/回归:可用于分类和回归任务。

- 简介:LightGBM是一种基于梯度提升算法的高效实现,适合大规模数据集的训练。它通过分桶算法和直方图优化来加速模型训练。

- 优点:速度快、内存占用少,适合处理大数据场景,效果良好。

8. 逻辑回归 (LR)

- 分类/回归:主要用于分类任务,但也可用于线性回归。

- 简介:逻辑回归是一种线性模型,使用sigmoid函数将线性组合的输入映射到概率值,适用于二分类和多分类问题。

- 优点:简单且高效,易于解释,特别适合处理线性可分的数据。

9. 随机森林 (RF)

- 分类/回归:可用于分类和回归任务。

- 简介:随机森林由多棵决策树组成,通过集成学习来提高模型的稳定性和准确性。每棵树都基于随机选取的特征和样本进行训练,最终通过投票或平均得到预测结果。

- 优点:具有较强的抗过拟合能力,适用于大规模数据集,且能够处理缺失值和异常值。

10. 支持向量机 (SVM)

- 分类/回归:可用于分类和回归任务。

- 简介:SVM通过最大化分类间隔来进行分类,适合高维数据。其回归版本(SVR)使用类似的原理来进行回归预测。

- 优点:在高维空间中表现良好,能够有效处理线性和非线性分类问题。

11. 极限梯度增强 (XGBoost)

- 分类/回归:可用于分类和回归任务。

- 简介:XGBoost是GBM的一种高效实现,具备分布式训练和自定义目标函数的能力,广泛应用于Kaggle竞赛中。

- 优点:速度快、性能强大,能有效防止过拟合,适合处理复杂数据。

五、主要结构

该平台的核心结构包括以下几个部分:

-

数据输入模块:用于接收用户输入的特征和标签信息,并进行预处理。

-

模型选择模块:提供多种模型选择,包含分类和回归模型。

-

训练模块:负责模型的训练和评估。

-

可视化模块:利用 Matplotlib 和 Seaborn 库生成训练和验证结果的可视化图表。

-

日志管理模块:记录训练过程中的重要信息,帮助用户实时监控训练状态。

-

预测模块:负责利用训练好的模型进行预测。

六、结束语

综上所述,该机器学习平台通过集成多种流行的分类和回归模型,为用户提供了便捷而高效的工具,以应对日益复杂的数据分析需求。平台的设计理念旨在降低机器学习模型选择和评估的门槛,使得即用户能够轻松上手。无论是学术研究、商业分析还是工程应用,该平台都为用户提供了强大的支持,帮助他们在数据的海洋中快速找到最佳解决方案。

1694

1694

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?