Deep image prior阅读笔记

论文:《 Deep image prior 》

项目主页:https://dmitryulyanov.github.io/deep_image_prior

1. Introduction(介绍)

- CNN在图像生成和图像复原任务中应用广泛,效果好

- 有种解释是因为CNN能从大量数据中学到真实图像的先验知识,强调的是大量数据和学习能力,但是这种解释并不充分

- 作者认为网络的泛化能力要求网络结构应该契合数据结构

- 与普通解释中将CNN的效果归结于学习能力不同,本文表明大量的图像先验知识是由卷积网络的结构获取的,而不是通过大量数据的学习!

##2. 方法

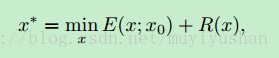

在传统的图像复原方法中,常常是一个附加正则项的优化问题,目标函数如下:

其中,E(x;x0)是与任务无关的数据项,比如MSE等,描述生成(或复原)图像与目标图像的差距,R(x)是正则项,是根据图像先验知识对解空间的约束。这些图像先验一般人为设计(hand-crafted),比如图像梯度重尾分布,total variation等。本文则提出使用卷积网络结构替换具有先验知识的正则项R(x),公式如下:

本文深入探讨了CNN在图像生成和复原中的作用,指出CNN的结构而非学习能力是其效果的关键。论文提出了使用CNN结构作为图像先验,替代传统图像复原中的手动设计正则项。通过优化网络参数,不依赖大量训练数据,能够从退化图像中恢复自然图像。这种方法在去噪、超分辨率和图像修复等方面表现出色,尤其适用于缺乏训练数据或难以建模退化过程的场景。然而,它对参数调优和计算量的要求较高。

本文深入探讨了CNN在图像生成和复原中的作用,指出CNN的结构而非学习能力是其效果的关键。论文提出了使用CNN结构作为图像先验,替代传统图像复原中的手动设计正则项。通过优化网络参数,不依赖大量训练数据,能够从退化图像中恢复自然图像。这种方法在去噪、超分辨率和图像修复等方面表现出色,尤其适用于缺乏训练数据或难以建模退化过程的场景。然而,它对参数调优和计算量的要求较高。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

8389

8389

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?