论文:

https://arxiv.org/abs/1612.00137

github:

https://github.com/MVIG-SJTU/RMPE

https://github.com/MVIG-SJTU/AlphaPose

RMPE出自2017ICCV,RMPE: Regional Multi-Person Pose Estimation,是上海交大,卢策吾老师组的作品。

主流的姿态识别通常2个思路,

(1)two-step framework,就是先进行行人检测,得到边界框,然后在每一个边界框中检测人体关键点,连接成一个人形,缺点就是受检测框的影响太大,漏检,误检,IOU大小等都会对结果有影响,代表方法就是RMPE。

(2)part-based framework,就是先对整个图片进行每个人体关键点部件的检测,再将检测到的部件拼接成一个人形,缺点就是会将不同人的不同部位按一个人进行拼接,代表方法就是openpose。

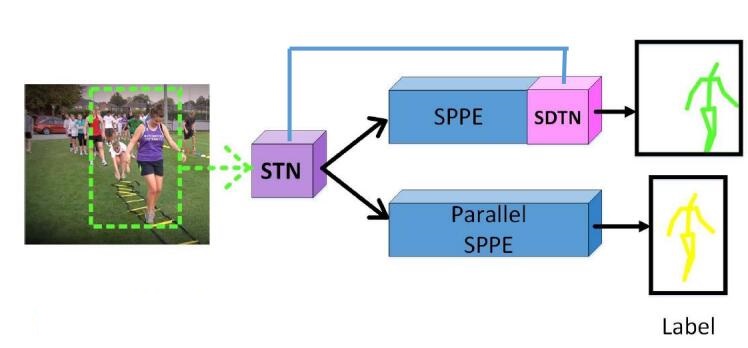

整个框架包括3个部分,

SSTN(Symmetric Spatial Transformer Network),对称空间变换网络,由STN,SDTN两部分组成,STN负责接收人体候选框,SDTN产生候选姿态,

PNMS (Parametric PoseNonMaximum-Suppression),负责过滤掉多余的姿态估计

PGPG(Pose-Guided Proposals Generator),就是SPPE这一部分,可以产生各种姿态图片,供训练过程使用。

安装步骤:

git clone https://github.com/MVIG-SJTU/RMPE.git

cd RMPE

cp Makefile.config.example Makefile.config

make all -j8

make pycaffe -j8

测试:

python examples/rmpe/demo.py

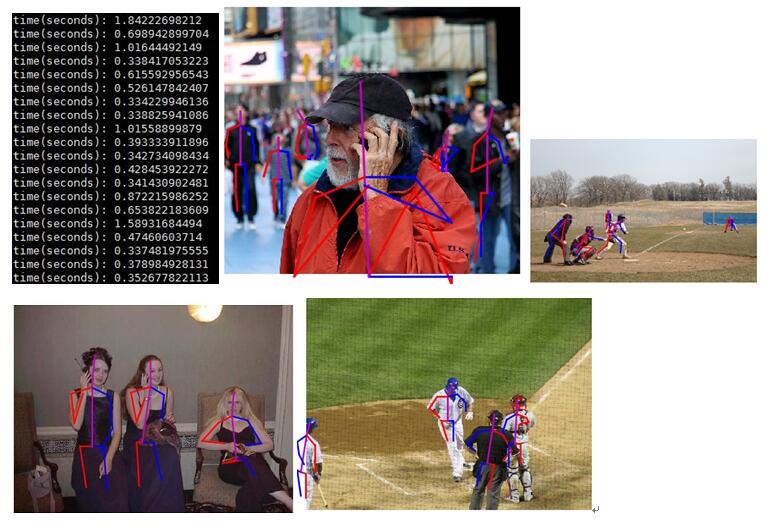

这里使用COCO数据集中的图片进行测试,从测试效果来看,没有openpose效果好,原因可能是这里的model并不是最新的Torch训练的模型吧。测试显卡1050TI。

reference:

https://github.com/MVIG-SJTU/RMPE

4898

4898

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?