A DRL-Based Service Offloading Approach Using

DAG for Edge Computational Orchestration

一种基于DRL的DAG边缘计算业务分流方法

一、摘要 Abstract

I、内容 Content

边缘基础设施和工业4.0所需的服务由具有不同计算能力的边缘服务器(ESs)提供,以基于租赁价格的方法运行社交应用的工作负载。社交物联网(SIoT)应用的使用日益增加,这使得社交平台非常受欢迎,同时需要一个有效的计算系统来实现高服务可靠性。在这方面,根据有向无环图(DAG)在时间槽内进行高要求计算社交服务请求(SRs)的卸载是一个NP完全问题。大多数最新方法关注网络的能源保存,但忽视了计算和资源共享过程中的资源共享成本和动态子服务执行时间(SET)。本文提出了一种基于两步深度强化学习(DRL)的服务卸载(DSO)方法,通过DRL影响的资源和SET分析(RSA)模型来减少边缘服务器成本。在第一级别,考虑服务卸载期间的服务和边缘服务器成本。在第二级别,采用R-报复方法评估资源因素以优化资源共享和SET波动。模拟结果表明,所提出的DSO方法通过简化动态服务完成和传输时间、服务器成本和截止日期违规率属性,实现了低执行成本。与最新技术方法相比,我们提出的方法实现了高资源利用率和低能源消耗。

II、总结 Summarize

背景介绍:边缘基础设施和工业4.0服务需要通过具有不同计算能力的边缘服务器(ESs)来提供,以基于租赁价格的方法运行社交应用的工作负载。

问题描述:社交物联网(SIoT)应用的使用量日益增加,使得社交平台变得非常流行,并且同时需要一个有效的计算系统来实现高服务可靠性。将高需求的计算社交服务请求(SRs)在一个基于时间段的有向无环图(DAG)中进行离载是一个NP完全问题。

现有方法的局限性:大多数最新方法侧重于网络的能源保存,但忽视了计算和资源共享过程中的资源共享成本和动态子服务执行时间(SET)。

提出的方法:本文提出了一个两步骤的深度强化学习(DRL)-基于服务离载(DSO)的方法,通过DRL影响的资源和SET分析(RSA)模型减少边缘服务器成本。在第一级别,考虑了服务和边缘服务器成本在服务离载过程中。在第二级别,R-报复方法评估资源因素以优化资源共享和SET波动。

模拟结果:模拟结果表明,所提出的DSO方法通过优化动态服务完成和传输时间、服务器成本和截止日期违规率属性,实现了低执行成本。与最新的方法相比,我们提出的方法实现了高资源利用率和低能耗。

III、关键词 Keywords

Adaptive quality-of-service (QoS), deep reinforcement learning (DRL) method, edge computing, optimal measurement analysis, service offloading (SO) and scheduling.

自适应服务质量(QoS)、深度强化学习(DRL)方法、边缘计算、最优测量分析、服务卸载(SO)和调度。

二、介绍 Introduction

总结概括:

1. 社交边缘服务(SES)是社交物联网(SIoT)编排中的新兴服务机制,旨在实现用户中心的可靠通信和计算。

2. 基于深度强化学习(DRL)的服务卸载(DSO)方法旨在优化边缘计算中的服务卸载策略,以减少资源利用率、执行时间成本和等待队列长度。

3. DSO方法利用深度强化学习技术测量资源提供率,并通过预测服务执行时间方法调整服务卸载决策,从而优化服务执行过程中的资源利用率和成本。

4. 该方法还包括开发R-报复分析模型来优化资源利用率、服务截止日期违规率和执行时间波动,以及开发预测执行成本方法来调节服务执行时间波动,进一步提高边缘计算系统的效率和性能。

三、相关工作 Related Works

服务分配问题被视为NP完全问题,因为任务被递归地分配给多台机器。在一些先前的研究中,研究者们集中在这个问题上,并提出了全面的研究方法,但由于大量具有各种资源的服务,这是一个复杂的机制。

在一些研究中,智能卸载方法(IOM)被设计用于有效的服务调度,但最初评估的服务执行时间和资源利用率值并不是最优的。

一些研究尝试通过质量感知的云框架来解决任务调度的问题,但它们相对于传统方法而言执行时间不足。

另一些研究着眼于移动边缘计算中的任务卸载决策,但长时间的服务可能被错误地映射到资源容量较低的边缘服务器,从而影响系统的执行时间和成本。

还有一些研究尝试设计更有效的服务分配算法,例如基于成本有效的资源使用分析的随机在线栈中心调度算法和基于图论的偏好启发式协同演化算法,但它们可能存在一些缺陷,比如无法重新提交失败的任务等。

一些研究也考虑了工作负载调度中由于机器可用性不确定性而引起的问题。

最后,有研究着眼于服务分配方法,试图减少影响服务卸载比率和系统性能的重复服务。而我们文章的主要目标是通过考虑服务执行时间、能源利用率和资源利用率来发展一种自适应的服务卸载策略,以实现负载的平衡。

四、系统模型和问题表述

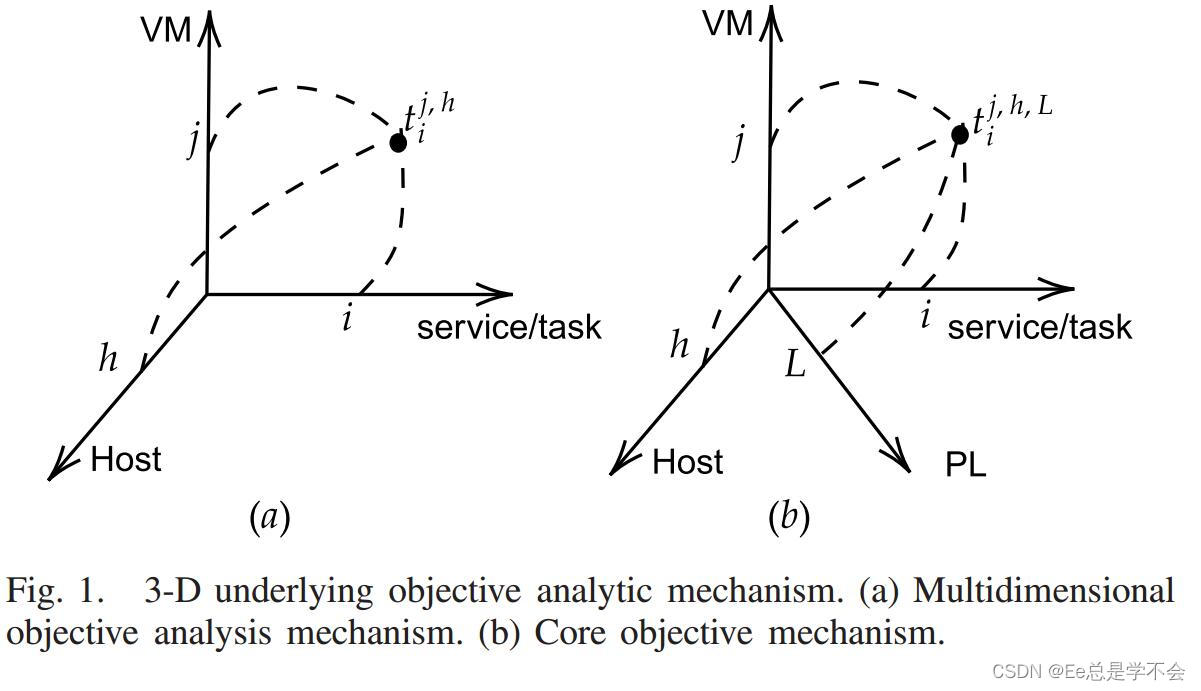

图1展示了一个具有多维坐标的任务映射系统。将服务卸载到合适的服务器对满足服务质量(QoS)至关重要,这一点可以从图1(a)中观察到。来自各个平台的服务到达率可能需要多个计算资源来满足其执行的截止日期,这正如图1(b)所示。例如,

表示来自工作负载(L)的服务,必须将第j个边缘服务器分配给它以实现有效执行。

A. DAG模型

- 租用的边缘服务器表示为

,其中

表示第

个边缘服务器。服务器成本及其资源容量率

是相互成比例的。

- 在成本评估中,服务提供商会对存储服务收取费用,但由于我们的资源整合方案集中在SO上,因此未考虑存储实例。因此,在我们的机制中忽略了存储空间成本。

- 在ES资源整合过程中考虑了传输数据的通信成本。调度高等级的ES可能会减少系统的响应时间,但会导致租户成本上升。为了解决这个问题,下面的计算模型考虑了ES的等级和总体权重率。

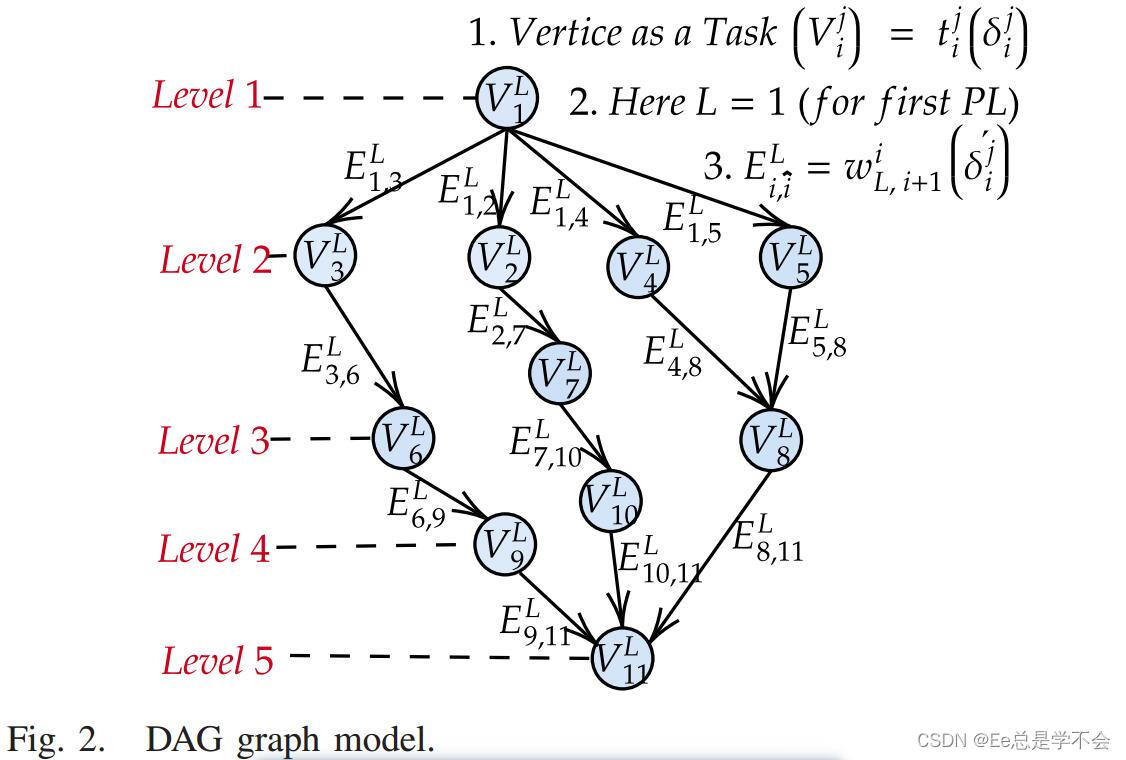

- 权重因子减少了ES的执行周期。应用工作负载(PLs)需要不同大小的计算资源和不同等级的边缘服务器来满足QoS和服务级别协议(SLA)的限制范围。图2展示了一个包含11个服务的DAG图,其中

是入口服务请求,

是已存在的服务请求。

表示数据传输时间的权重。服务请求的前驱和后继通过

和

表示。

B、问题公式化

- 提出的系统旨在实现SLA的目标截止日期,并在此过程中调节PL的成本。

- 通过计算PL的最大执行时间和到达时间之间的差来估计PL的最大执行时间,以便了解服务的执行情况。

- 在整合过程中,需要考虑每个ES接收一个服务请求以进行有效执行,且所有边缘设备(ED)的容量之和不应超过其服务器的容量。

- PL的最大执行时间和到达时间的总和应小于各自PL的截止日期,以确保服务在规定时间内完成。

- 权重值

用于确保服务请求状态,并且其总和必须小于或等于1。

- 服务请求由具有充足完成时间和起始时间的ES执行,并且服务执行时间和数据传输时间的总和必须小于或等于服务开始时间,以保证服务按时开始执行。

五、DSO的方法

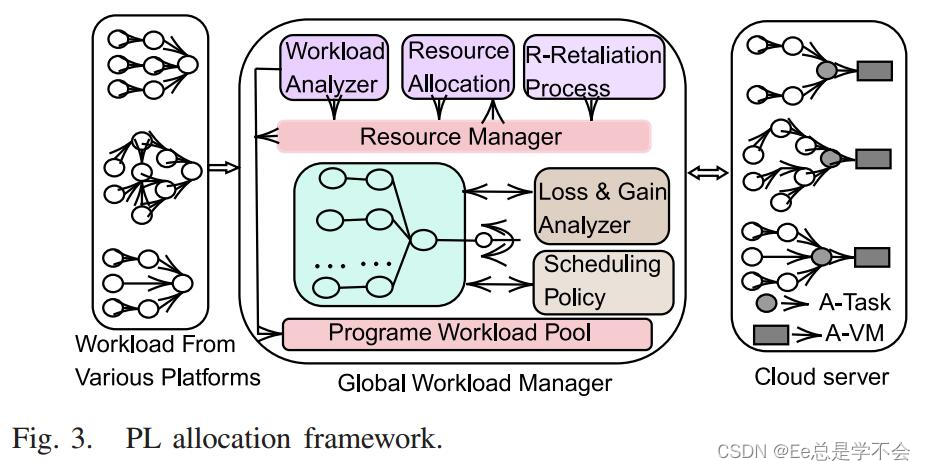

A. PL分配框架

- DSO方法集中于向ES提供执行PL所需的资源。用户可以在其他现有PL正在执行的过程中提交带有不同截止日期的服务请求。

- 提出的框架包括工作负载、资源、服务管理器和PL池等部分。

- 工作负载分析器集中于服务请求实体之间的依赖关系。

- 程序工作流池部分用于存放未分配的服务请求。

- 资源管理器(RM)负责动态调节计算资源,以解放机器的资源,并使其符合工作负载的要求。

- 服务请求管理器负责通过成本分析模型在服务请求和ES之间制定卸载策略,并与RM协调。

- SO过程分为三个步骤,即资源提供(RP)、工作负载分析和R-报复方法。

- 如果触发了到达信号,则开始预估步骤,通过到达时间来估计优先级。子工作负载截止日期(s-deadlines)基于先前结果进行评估,不得违反PL的截止日期。

- m/m/1模型根据RM分析的资源使用情况将服务请求分配给适当的ES。

- 未分配的服务请求将存储在程序工作流池中。

- RP分析步骤通过RM的推荐最终确定适当的ES。这个过程影响减少ES的SET波动,除了在同一ES上等待时间外;因为每次只分配一个服务请求,这是因为ES的等待时间成本低于ES的SET波动成本。

- R-报复方法根据资源需求率和资源使用率评估服务请求的优先级,对减轻SET起着重要作用。

B. 服务请求资源度量方法

定理1:预测执行时间等于两个因素的乘积,即ES的权重和执行权重。通过分析资源可用性和执行时间的关系得出结论。

推论2:合格的ES必须满足条件:首先,服务请求的执行成本必须较低,同时满足SLA约束条件;其次,在满足条件的情况下,选择剩余空闲时间较少的ES以平衡系统的资源利用率。选择ES的过程通过限制执行成本来提高资源利用率,资源管理器根据服务请求截止日期开始为所有活动ES分配资源,如果有多个ES符合条件,则选择另一个ES。这不违反个别服务请求的截止日期,而是等同于违反整个PL的截止日期。

C. 预估与R-报复机制

这一部分是框架的核心,因为它专注于评估主要属性,特别是估算单个服务请求的截止时间(s-deadline),这对于决策至关重要。以下是该部分的要点:

- S-deadline的估算:

- 使用包括初始和最终服务完成时间的方程来估算服务请求的s-deadline。

- 原始完成时间:

- 根据初始完成时间和使用函数φ(δ j i,c)估算的完成时间确定服务的原始完成时间。

- 原始开始时间:

- 使用以下方程估算服务的原始开始时间,基于初始完成时间和预计完成时间,以及数据传输时间。

D. 服务能力计算方法

服务请求数据获取时间:

- 在执行服务请求时,评估预期资源率和SET(Service Execution Time)对于降低成本至关重要。分配因子需要考虑每个ES的带宽和RAM容量。数据传输时间通过以下方程评估:

服务提供商的服务请求评估成本:

- 服务提供商基于“按需付费”模式共享资源。成本估算为:

ES的服务请求评估成本:

- SET描述了每个服务大小和ES计算能力的速率。根据成本估算现象,服务提供商将每个ES的成本估算为:

服务请求排队模型:

- 通过控制服务请求队列时间,队列长度计算方法简化了SO过程。通过等待模式维护满足套餐政策的服务请求。等待队列长度的优化公式为:

有界阈值因子:

- 服务请求完成时间描述了服务请求容量和连接ES计算能力的平均速率,并评估为:

六、DSO算法

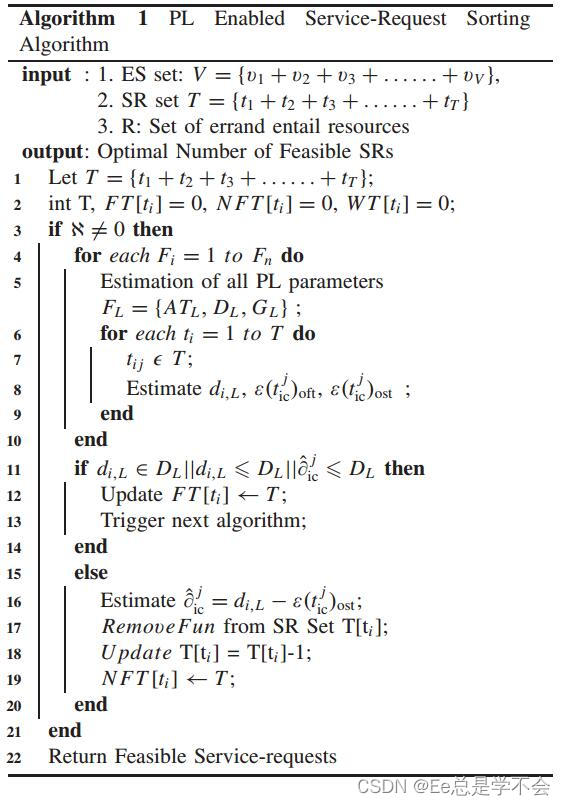

A. 算法1——PL启用服务请求排序算法

算法1旨在估算所有初步参数。步骤如下:

- 初始化:在PL不等于零时,初始化所有集合。

- 参数估算:通过循环遍历PL参数集合,估算每个服务请求的S-deadline(服务请求截止时间)、原始开始时间和唯一完成时间以及DAG元素。

- 评估可行的服务请求列表:根据S-deadline和截止时间变化率的条件,确定可行的服务请求列表。若截止时间被违反,则激活第二个算法;否则,更新活动服务请求集合并将未满足条件的服务请求转发到NFT[ti]集合。

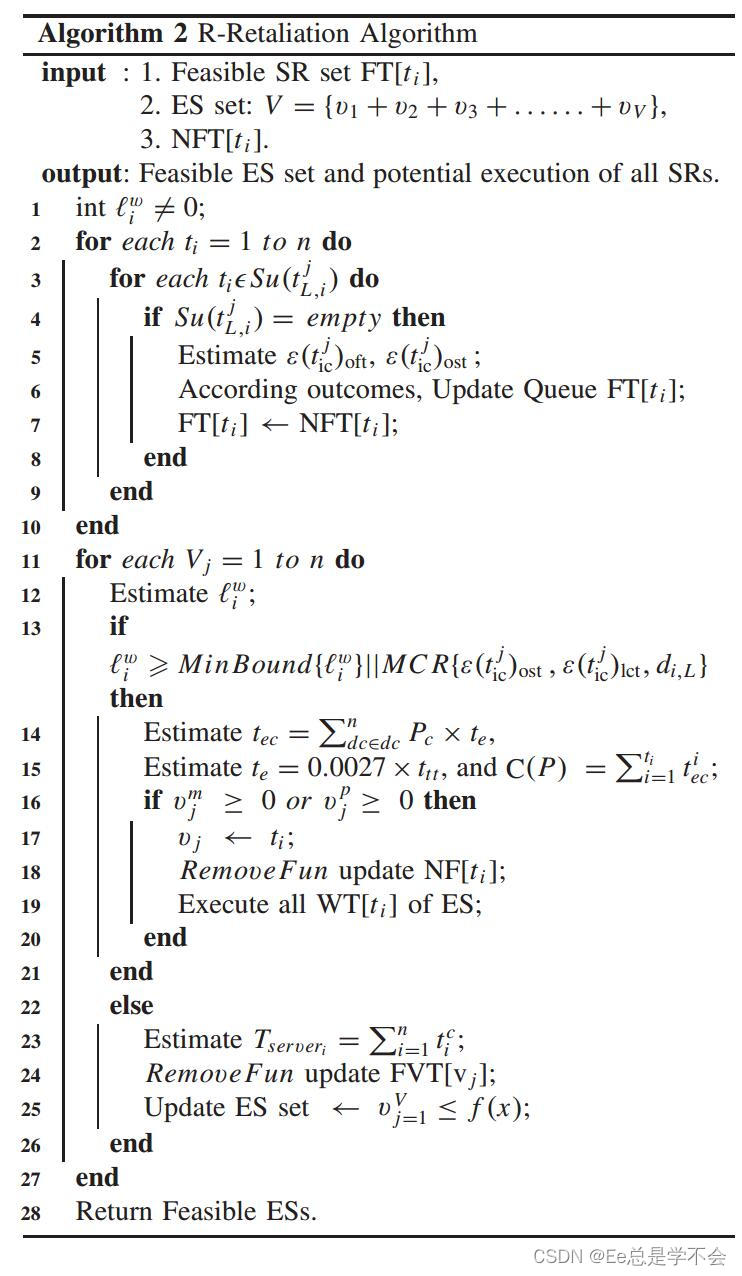

B. 算法2——R-报复算法

算法2用于实现R-Retaliation算法。步骤如下:

弹出任务: 对于每个时间段

,遍历其中的每个

,如果

为空,则估算

,并更新队列

。

估算ES容量: 对于每个

,估算

。如果

满足条件

,则执行以下步骤:

- 估算

和

,其中

表示ES的成本,

表示预计的服务请求完成时间;

- 如果

≥ 0或

≥ 0,则将

设置为

,更新

并执行ES的所有

;

- 否则,更新

,更新ES集合。

返回可行的ES集合。

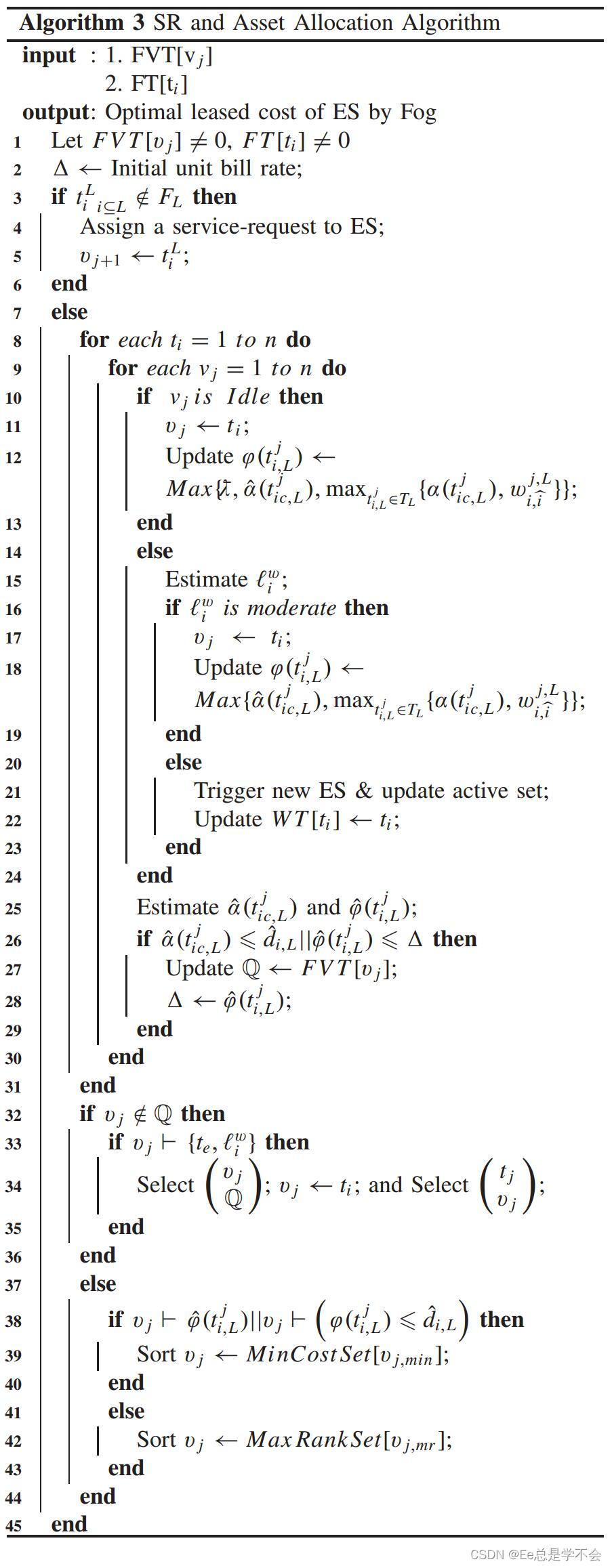

C. 算法3——SR 与资源分配算法

算法3用于基于ES容量实例和算法1和算法2的结果,对队列中的服务请求进行调度。步骤:

检查服务请求所属PL: 对于每个服务请求,检查它是否属于同一个PL。如果不属于,则根据其容量和服务请求截止时间将其分配给新的ES。否则,执行以下基本步骤。

根据ES状态分配服务请求: 对于每个ES,如果其处于空闲状态,则将服务请求分配给它。否则,根据ES容量和其他条件决定是否将服务请求分配给它。

更新ES集合: 基于任务完成情况和时间变化率,更新可行的ES集合。如果ES不属于ES集合,则根据特定条件对ES进行排序。然后选择适当的ES来执行服务请求,以实现目标。

七、实验结果

A. 性能指标

在实验结果部分,使用以下性能指标来评估所提算法与基准现有系统的准确性:

平均响应时间:用于评估雾节点ES的响应时间。根据其容量和分配的工作量,计算每个ES的响应时间。其计算公式如下:

平均响应时间 = Min(开始时间 + 完成时间) / ES容量,对所有ES取平均值。

资源使用率:用于计算雾节点上每个ES的资源使用率。根据在一段时间内总活动时间和总处理时间来评估。计算公式如下:

资源使用率 = 总处理时间 / 总活动时间,对所有ES取平均值。

截止时间违规率:用于计算每个PL的截止时间违规率。通过计算每个PL的截止时间与实际完成时间之间的差异来评估。计算公式如下:

截止时间违规率 = (实际完成时间 - 截止时间) / 截止时间,对所有PL取平均值。

B. 仿真模拟

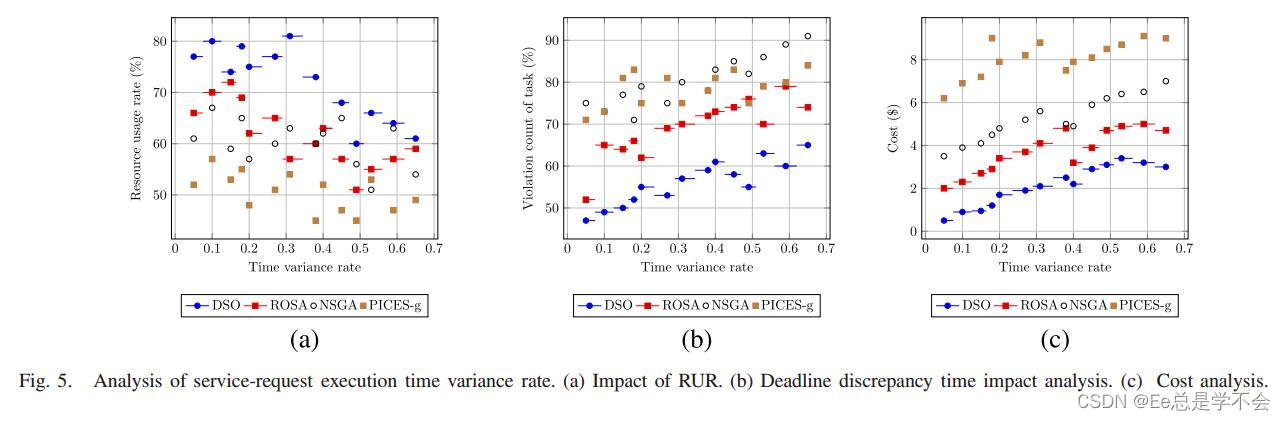

图5显示了服务请求执行时间方差率的分析结果。其中,(a)图展示了资源利用率的影响,(b)图展示了截止时间差异的影响分析,(c)图展示了成本分析结果。

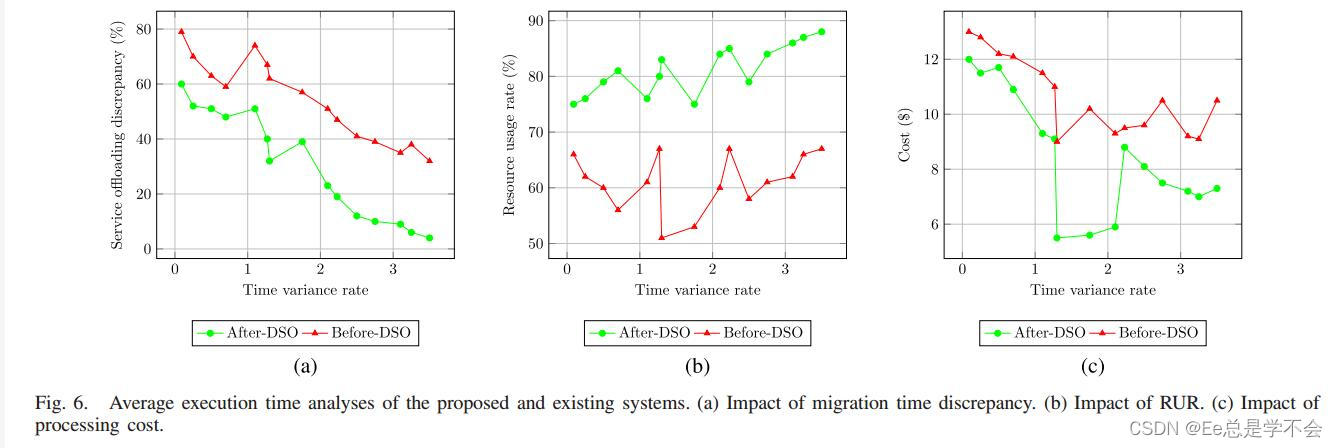

图6展示了所提算法与现有系统的平均执行时间分析结果。其中,(a)图展示了迁移时间差异的影响,(b)图展示了资源利用率的影响,(c)图展示了处理成本的影响。

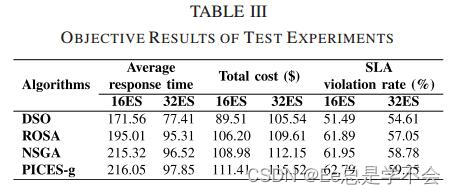

表III呈现了测试实验的客观结果。该表比较了不同方法的租用成本、平均响应时间以及SLA违规率,分别在16个ES和32个ES的两种情况下进行了分析。结果表明,我们提出的系统在所有三个方面表现出了准确的性能。实验表明,R-报复算法对DSO方法的影响要比现有算法更大,因为它提前估计了服务执行时间和相关参数。

八、结论 Conclusion

本文的两步骤DSO方法通过优化随机的服务分配,实现了强大的服务可靠性,以满足边缘基础设施和工业4.0服务的需求。

工作负载分析器根据S-截止时间和预测完成时间因素,准确地估计了PL的权重,实现了资源的有效共享,减少了单个服务的截止时间违规率和服务器的成本。

ES容量权重因子的选择避免了执行中断,从而提高了系统的稳定性,并降低了服务器的成本。

R-报复模型通过评估最有利的资源和服务分配策略,实现了SO数据的执行和工作负载截止时间违规率之间的平衡。

本方法在QoS方面取得了良好的表现,为服务提供商提供了降低成本、减少截止时间违规率的机会。

未来的研究方向包括设计一个量子集成的边缘编排,以进一步提高SO的可靠性和性能。

375

375

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?