OSVOS单目标单帧处理

项目主页

http://people.ee.ethz.ch/~cvlsegmentation/osvos/

git

https://github.com/kmaninis/OSVOS-PyTorch

https://github.com/scaelles/OSVOS-TensorFlow

论文

https://segmentfault.com/a/1190000009651558

https://blog.csdn.net/qq_20657717/article/details/81868182

特点

半监督:只给出第一帧分割,FCN来进行前景和背景的分割

数据集:DAVIS 2016。处理DAVIS(480X854像素)一帧需要102ms,准确度71.5%。

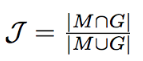

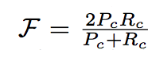

J是区域重合判断标准,F是轮廓重合判断标准,为两个度量分割准确率的主要标准:

1.区域相似度(Region Similarity):区域相似度是掩码 M 和真值 G 之间的 Intersection over Union。

2.轮廓精确度(Contour Accuracy):将掩码看成一系列闭合轮廓的集合,并计算基于轮廓的 F 度量,即准确率和召回率的函数。

直观上,区域相似度度量标注错误像素的数量,而轮廓精确度度量分割边界的准确率。

J是区域重合判断标准,F是轮廓重合判断标准,T是时间稳定性。-BS是没有获取边界,-PN是没有在父网络上预训练,-OS是没有学习第一帧。

总体思路

先在 ImageNet 训练一个图像分类模型,得到的网络称之为 Base Network,接着我们 在 DAVIS 训练一个分割网络,得到 Parent Network,最后我们在目标视频上微调,得到 Test Network。前两个网络的训练都是 offline, 最后一个网络的训练是 online,这个online 时间越长效果越好

训练过程

1 选择一个网络(比如 VGG-16)在 ImageNet 上进行分类预训练。

2将其转换为全连接卷积网络(FCN),从而保存空间信息,训练结束时删去 FC 层。嵌入一个新的损失函数:像素级 sigmoid 平衡交叉熵(pixel-wise sigmoid balanced cross entropy,曾用于 HED)。

现在,每一个像素都可以被分类成前景或背景。

3在 DAVIS-2016 训练集上训练新的全连接卷积网络。

4单次训练:在推断的时候,给定一个新的视频输入进行分割并在第一帧给出真实标注(记住,这是一个半监督问题),创建一个新模型,使用 [3] 中训练的权重进行初始化,并在第一帧进行调整。

这个流程的结果,是适用于每一个新视频的唯一且一次性使用的模型,由于第一帧的标注,对于该新视频而言,模型其实是过拟合的。由于大多数视频中的目标和背景并不会发生巨大改变,因此这个模型的结果还是不错的。自然,如果该模型用于处理随机视频序列时,则它的表现得就没那么好了。

MaskTrack考虑时序信息

git

https://github.com/omkar13/MaskTrack

Video Object Segmentation with Re-identification and Lucid Data Dreaming etc in DAVIS 2017 challenge were based on the MaskTrack method.

MaskTrack 的 Mask 传播模块

每一个帧将前一帧的预测掩膜作为额外输入馈送给网络:现在输入有四个通道 (RGB+前一帧的掩膜)。使用第一帧的真实标注初始化该流程。

该网络原本建立在 DeepLab VGG-16(模块化)基础上,现在在语义分割和图像显著性数据集上从头开始进行训练。通过将每一张静态图像的真实标注稍微转换,人工合成前一帧的掩膜通道输入。

基于光流场输入增加一个相同的第二流网络。模型的权重和 RGB 流的权重相同。通过将两个结果取平均融合两个流的输出。

在线训练:用第一帧的真实标注合成额外的、针对特定视频的训练数据。

论文提出引导式实体分割的思路:视频序列中,对一个新的帧像素级分割时,引入上一帧已经完成像素级标注的图片。论文的整体模型是基于DeepLabv2架构。如上图所示,整个架构的输入是4通道(RGB3通道+前一帧掩码图像),使用第一帧的真实标注初始化该流程,主要通过Learning to segment instances offline+online两种策略实现。

Video Object Segmentation with Re-identification

主页

https://liuziwei7.github.io/projects/VSReID.html

git

https://github.com/lxx1991/VS-ReID

论文

https://zhuanlan.zhihu.com/p/32364792

774

774

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?