1、sigmoid函数

主要作用是让x等于0时等于0.5,x无穷大时无限接近于1,x无穷小时无线接近于0,这样来使模型表达出概率的意义

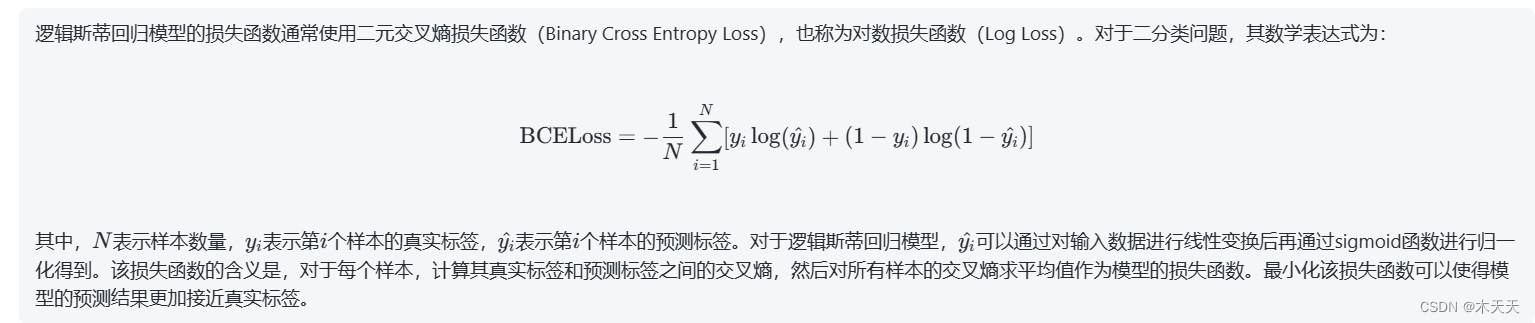

2、逻辑斯蒂函数的损失函数

import numpy as np

import torch.nn.functional as F

import torch

from matplotlib import pyplot as plt

# 定义数据集

x_data = torch.tensor([[1.0], [2.0], [3.0], [4.0]])

y_data = torch.tensor([[0.0], [0.0], [1.0], [1.0]])

# 定义模型

class LogisticRegressionModel(torch.nn.Module):

def __init__(self):

super(LogisticRegressionModel, self).__init__()

self.linear = torch.nn.Linear(1, 1)

def forward(self, x):

# 先进行线性变换然后通过sigmoid归一化,使其取值范围为[0-1]

y_pred = F.sigmoid(self.linear(x))

return y_pred

model = LogisticRegressionModel()

# 定义一个交叉熵损失函数

criterion = torch.nn.BCELoss(size_average=False)

# 使用随机梯度下降

optimizer = torch.optim.SGD(model.parameters(), lr=0.01)

for epoch in range(1000):

# 对x_data的每个值求出y hat,这里的y_pred对应x中每个值计算后的value

y_pred = model(x_data)

# 计算均方误差

loss = criterion(y_pred, y_data)

print(epoch, loss.item())

# 梯度归零方便更新新的梯度

optimizer.zero_grad()

loss.backward()

# 更新模型参数

optimizer.step()

x_test = torch.Tensor([[5.0]])

y_test = model(x_test)

x = np.linspace(0, 10, 200)

# 将x转换为torch.Tensor类型,并通过view方法将其形状改变为(200, 1),以便输入到模型中进行预测。

x_t = torch.Tensor(x).view((200, 1))

y_t = model(x_t)

# 将模型在x上的预测结果y_t转换为numpy数组类型,以便后续使用matplotlib库进行可视化。

y = y_t.data.numpy()

plt.plot(x, y)

# 画一条中间的红线

plt.plot([0, 10], [0.5, 0.5], c='r')

plt.xlabel("Hours")

plt.ylabel("Probavility of Pass")

# 在绘制的图形上添加网格线,方便观察数据点的位置和模型的拟合情况。

plt.grid()

plt.show()

8078

8078

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?