论文介绍:

《Joint Extraction of Entities and Relations Based on a Novel Decomposition Strategy》[1]

《A Novel Cascade Binary Tagging Framework for Relational Triple Extraction》[2]

《Entity-Relation Extraction as Multi-turn Question Answering》[3]

《TPLinker: Single-stage Joint Extraction of Entities and Relations Through Token Pair Linking》[4]

ETL-span: Joint Extraction of Entities and Relations Based on a Novel Decomposition Strategy

方法:

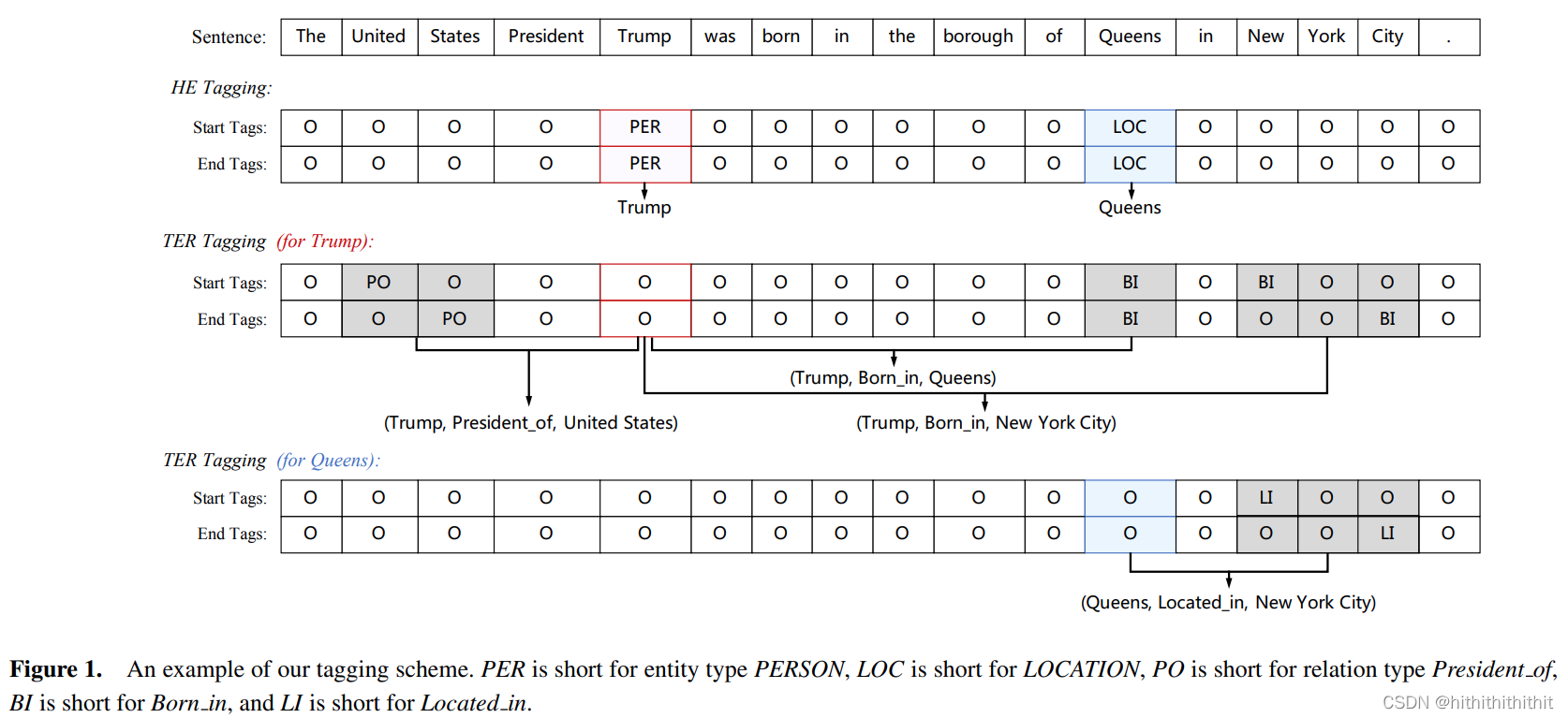

标记方案(Tagging Scheme)

本文使用了联合抽取的方法,使用了标记策略对实体和关系进行抽取。本方法分为两个阶段,第一个阶段抽取头实体(HE),第二个阶段抽取尾实体和关系(TER)。作者将第一个阶段的头实体抽取分解成两个独立的子任务,第一个任务标注HE的第一个词,第二个任务标注HE的最后一个词。对于已经抽取出来的HE,对其进行尾实体(TE)和对应关系抽取。例如下图,对于抽取出来了的实体“Trump”,我们对其进行尾实体和关系类型抽取,这一阶段本质上类似于命名实体识别,即第一阶段。这里可以注意到已经解决了SEO问题,但是没有解决EPO问题且没有识别客体的实体类型。

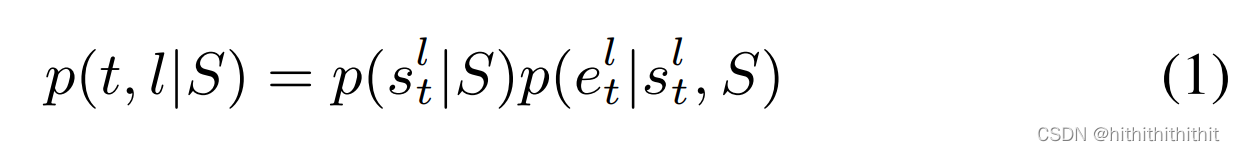

总的来说,就是第一阶段抽取头实体及其类型,第二阶段抽取客实体及其关系类型。我们使用表示抽取的目标,

表示抽取的类型(第一阶段是实体类型,第二阶段是关系类型),下面的公式表示抽取目标。其中

表示抽取目标的开始位置,

表示抽取目标的结束位置。

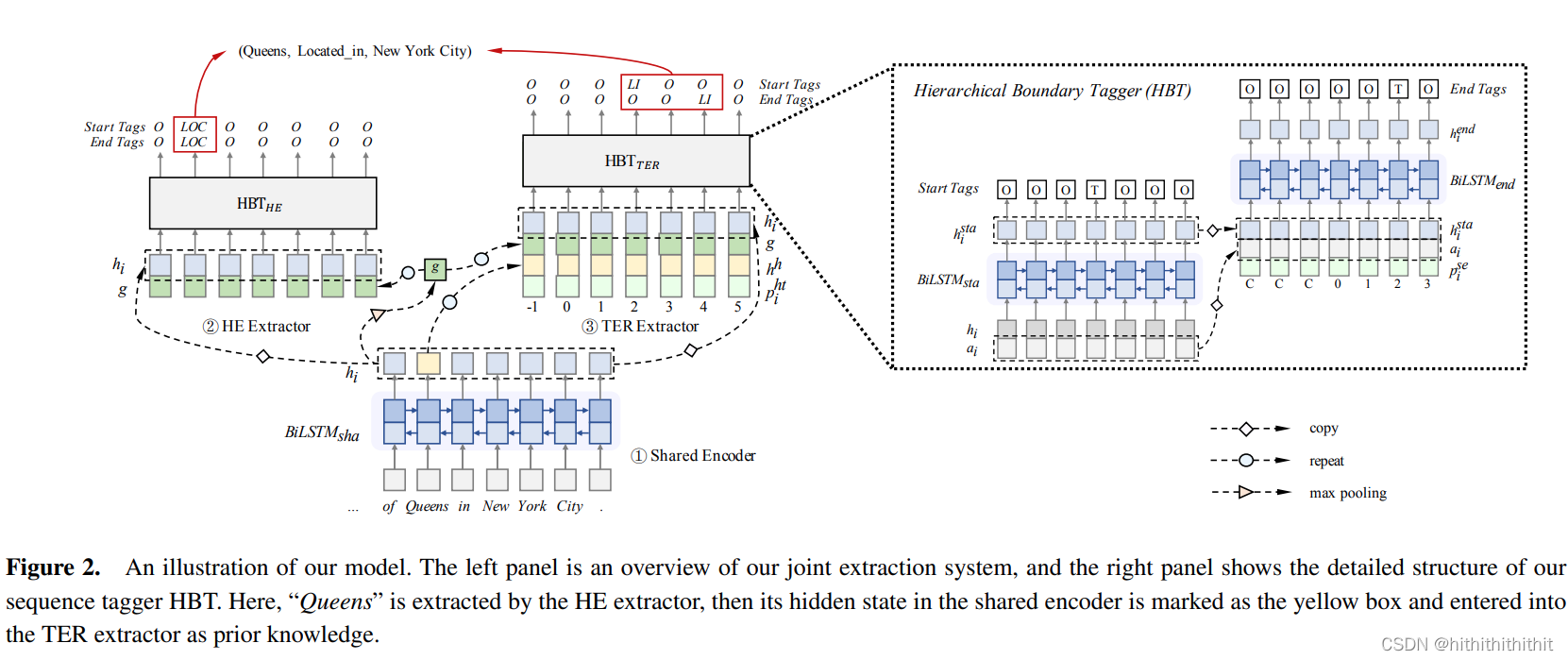

层级边界标记器(Hierarchical Boundary Tagger, HBT)

在具体的实现部分,使用了一个BiLSTM编码器来编码信息,得到了每个token的表征,公式如下

HE Extractor

在头实体抽取部分,把训练得到的token隐向量和全局向量g串联起来作为HE部分的embedding(即),输入到HE抽取器中,得到最终所需要的实体位置,如下图左边的左半部分,其中公式中的

。

TER Extractor

对于尾实体和关系抽取部分,作者仍然把token embedding和全局向量g串联作为表征,但是简单的串联不足以检测实体和关系。所以作者把上一步中的得到的头实体的头向量和尾向量串联起来作为头实体特征。此外,还融入了token位置信息

。具体公式如下。

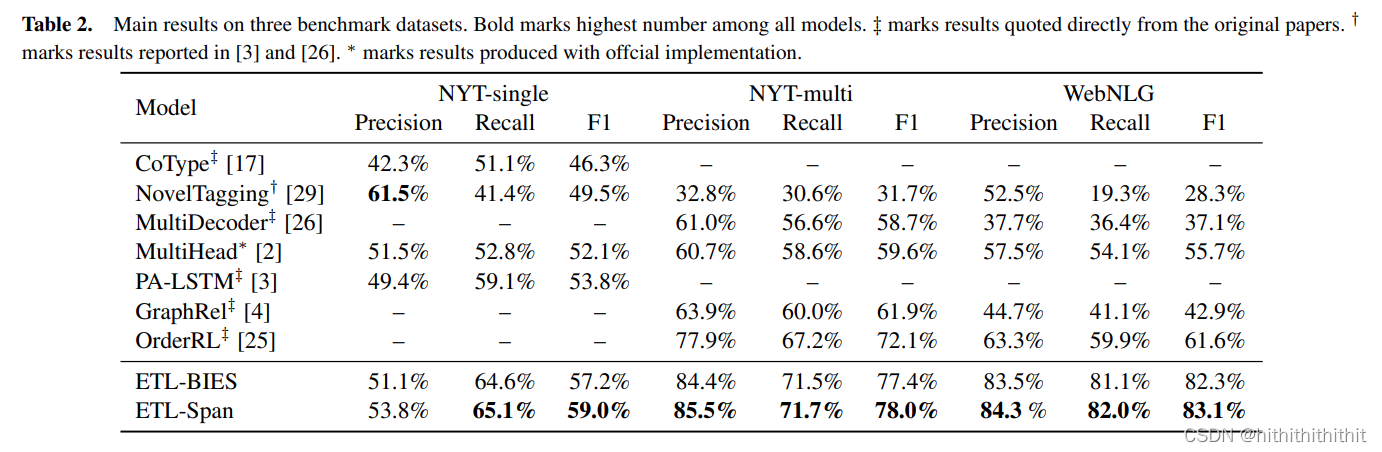

实验结果

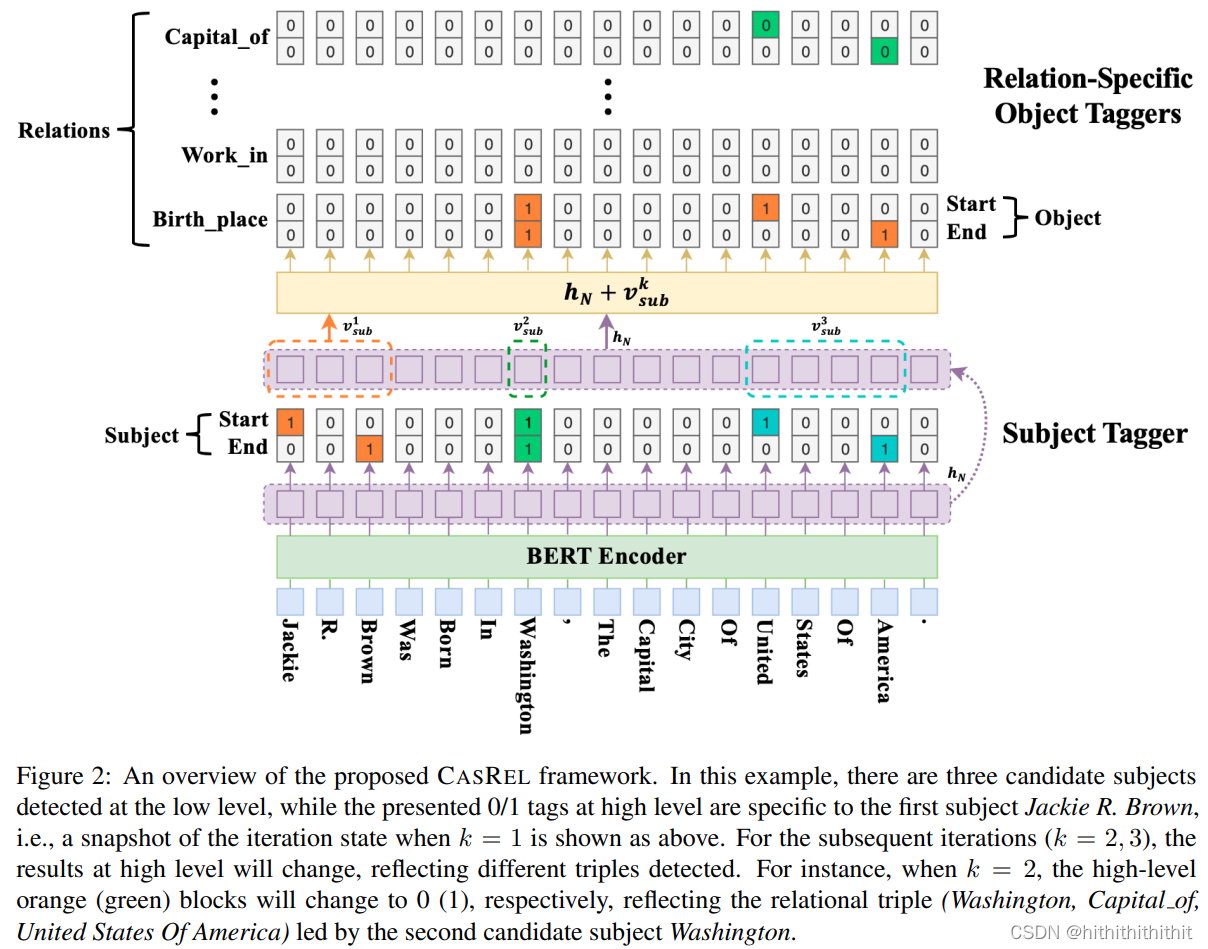

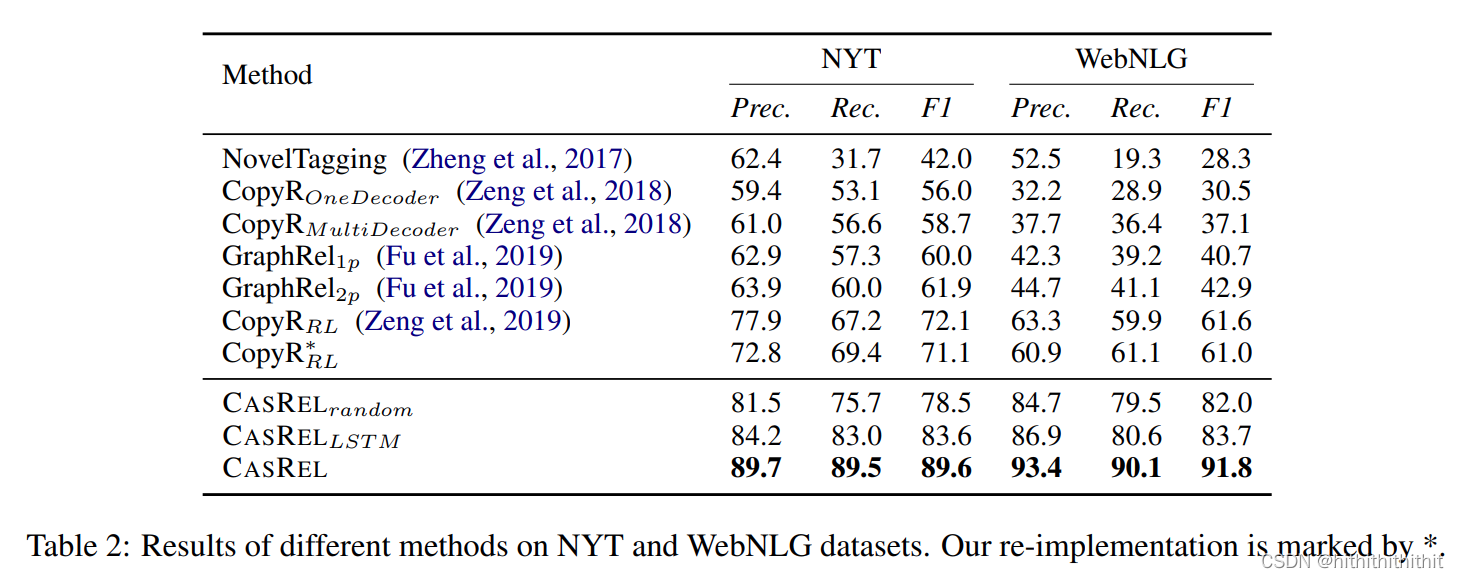

A Novel Cascade Binary Tagging Framework for Relational Triple Extraction

方法

本文采用了联合抽取,对句子首先抽取主体词,然后根据主体词和关系去找客体词。作者提出了一种关系函数,将提取出的主体词作为因变量,去输出客体词。

主体词标记器(Subject Tagger)

本文采用了Bert Encoder,对于Bert训练得到每个token的表示,对每个token进行两次变换,得到每个token为实体开始位置和实体结束位置的概率,公式如下。

其中,p表示概率,如果概率超过了某个阈值,那么那个token的tag会被标记为1,反之标记为0。表示sigmoid激活函数。

客体关系标记器(Relation-specific Object Taggers)

在客体抽取部分,作者对每个抽取出的主体,进行不同关系的客体抽取,和主体抽取不同的是,客体部分融入了上一阶段抽取出的主体表征,具体公式如下。

其中,p表示概率,表示上一阶段抽取出的第k个主体表征

实验结果

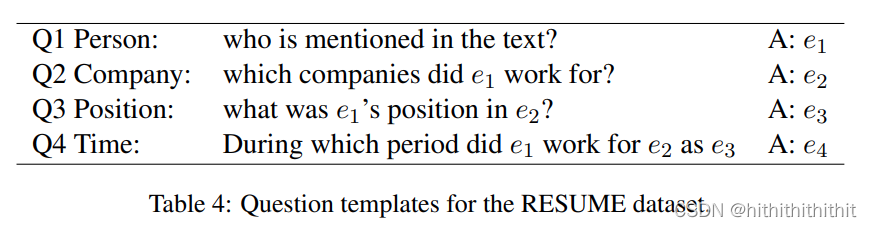

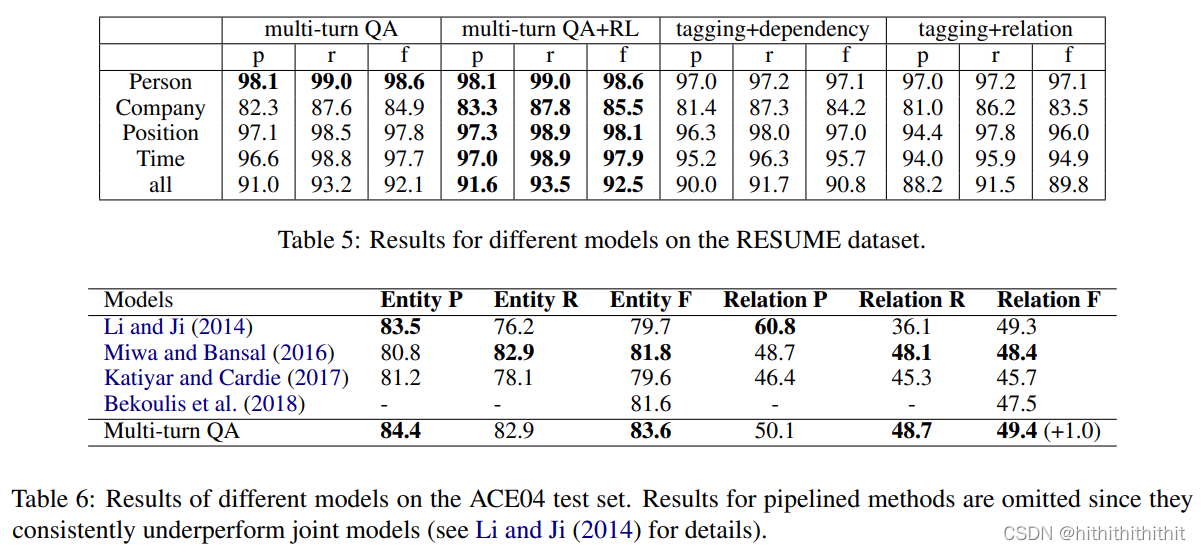

Entity-Relation Extraction as Multi-turn Question Answering

方法

本文使用了基于阅读理解的方法,将实体关系抽取转化成多轮问答,抽取实体和关系被转化成识别答案片段的形式。

本文主要使用了两个问题模板来抽取,分别是实体问题模板和关系链式模板。实体问题模板用于从文本中找出所有可能在关系中的实体,接着对每个被找出来的实体进行关系提问。具体算法如下图。

问题模板设计如下

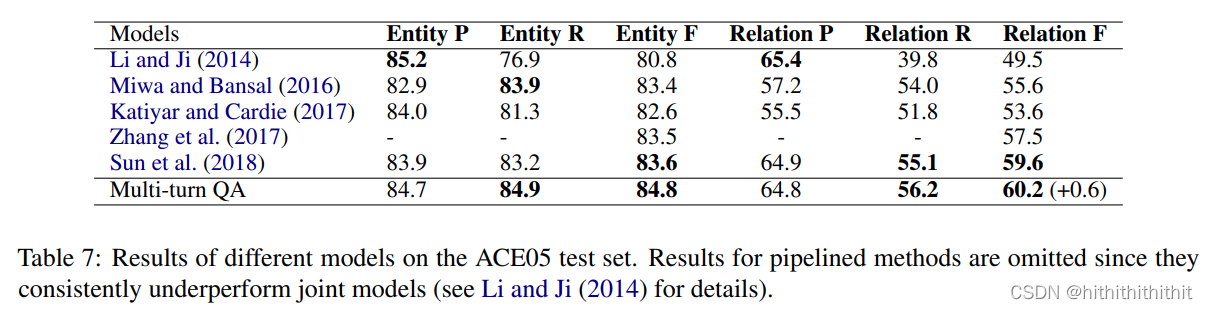

实验结果

TPLinker: Single-stage Joint Extraction of Entities and Relations Through Token Pair Linking

方法

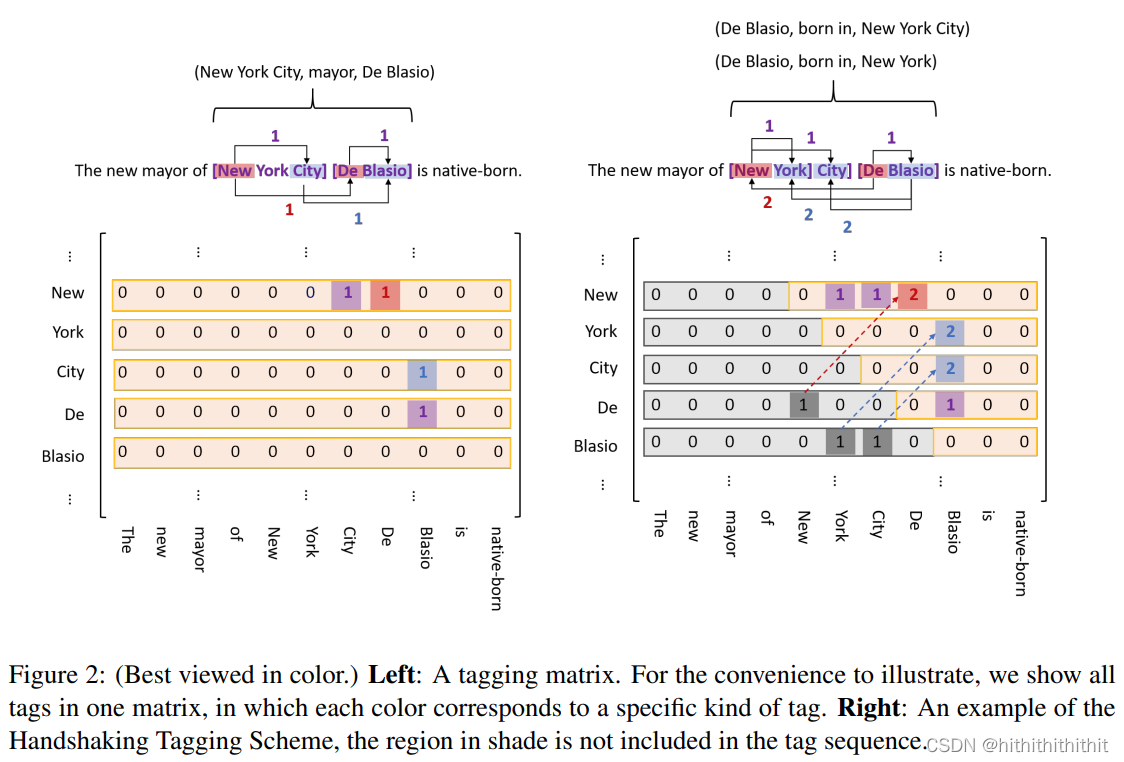

本文将实体和关系抽取进行统一编码,主要策略是对所以token pair进行打标签。

References:

[1] Bowen, Yu, Zhenyu Zhang, Jianlin Su, Yubin Wang, Tingwen Liu, Bin Wang and Sujian Li. “Joint Extraction of Entities and Relations Based on a Novel Decomposition Strategy.” ArXiv abs/1909.04273 (2020): n. pag.

[2] Zhepei Wei, Jianlin Su, Yue Wang, Yuan Tian, and Yi Chang. 2020. A Novel Cascade Binary Tagging Framework for Relational Triple Extraction. In Proceedings of the 58th Annual Meeting of the Association for Computational Linguistics, pages 1476–1488, Online. Association for Computational Linguistics.

[3]Xiaoya Li, Fan Yin, Zijun Sun, Xiayu Li, Arianna Yuan, Duo Chai, Mingxin Zhou, and Jiwei Li. 2019. Entity-Relation Extraction as Multi-Turn Question Answering. In Proceedings of the 57th Annual Meeting of the Association for Computational Linguistics, pages 1340–1350, Florence, Italy. Association for Computational Linguistics.

[4] Yucheng Wang, Bowen Yu, Yueyang Zhang, Tingwen Liu, Hongsong Zhu, and Limin Sun. 2020. TPLinker: Single-stage Joint Extraction of Entities and Relations Through Token Pair Linking. In Proceedings of the 28th International Conference on Computational Linguistics, pages 1572–1582, Barcelona, Spain (Online). International Committee on Computational Linguistics.

6228

6228

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?