记录了从零开始跑一遍3dgs实验的所有流程和细节。

1.软硬件环境

显卡A800

linux 系统

输入nvcc --version查询到Cuda compilation tools, release 11.8, V11.8.89

Anaconda3

注意其他系统可能步骤不同

2.下载代码,安装环境

要求有较好的网络环境,才能成功git clone里面包括的子模块submodules

git clone https://github.com/graphdeco-inria/gaussian-splatting --recursive

cd /path/to/your/project

conda create -n gs python=3.8

conda activate gs

输入nvcc --version查询到Cuda compilation tools, release 11.8, V11.8.89,在github的issue里搜cu118,然后找到的一种别人的安装方式,有部分修改:

pip install torch==2.0.0+cu118 torchvision==0.15.0+cu118 torchaudio==2.0.0+cu118 -f https://download.pytorch.org/whl/torch_stable.html

pip install submodules/diff-gaussian-rasterization/

pip install submodules/simple-knn/

pip install plyfile

pip install tqdm

3.下载别人准备好的数据集

在repo里作者提供了一些数据集,我下载了这个数据集,下载完毕后传到服务器,然后unzip

4.训练

一次训练一个场景,挑一个数据集,train(火车),把路径写到下面

python train.py -s /path/to/your/project/data/tandt/train

运行,等待13min

在ouput文件夹下得到结果,点开,有ply文件,还有camera.json文件。

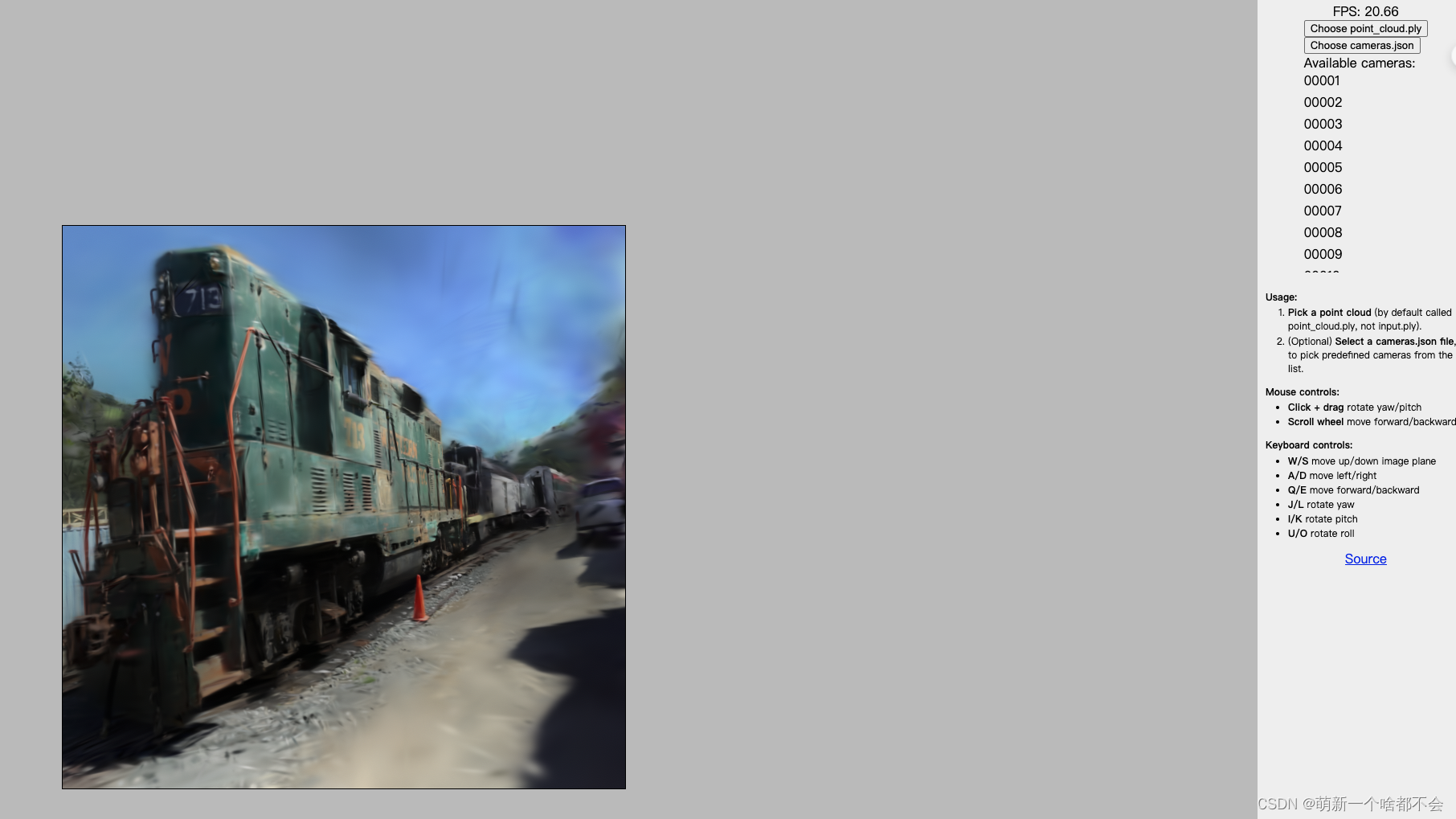

5.看结果

一个简单的可视化方法:3dgs可视化网页,把ply文件传入到上面,等待几秒即可查看结果,用鼠标/键盘操作。也可以把json传到上面,点相机位置可以直接看渲染效果。

本文详细记录了从硬件配置、软件环境设置(包括显卡驱动、Python环境和PyTorch版本)到下载代码、安装依赖、数据集获取、模型训练及结果可视化的完整过程,适合对3DGS实验感兴趣的开发者参考。

本文详细记录了从硬件配置、软件环境设置(包括显卡驱动、Python环境和PyTorch版本)到下载代码、安装依赖、数据集获取、模型训练及结果可视化的完整过程,适合对3DGS实验感兴趣的开发者参考。

1771

1771

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?