1.理解过拟合问题

在训练集的基础上用模型去拟合,得到的假设可能能够非常好地适应训练集(代价函数可能几乎为0,即最小化

J

(

θ

)

J(\theta)

J(θ)几乎为0),但是可能会不能推广到新的数据。

举例1,线性回归问题:

第一个模型是一个线性模型,欠拟合,在后期仍

过分执著于面积对房价影响的这个属性,不能很好地适应我们的训练集;

第三个模型是一个四次方的模型,过于强调拟合原始数据,几乎对每一个数据都完美拟合,可以看出,若给出一个新的值使之预测,它将表现的很差,是过拟合,虽然能非常好地适应我们的训练集但在新输入变量进行预测时可能会效果不好,故而丢失了算法的本质

对比来看,中间的模型似乎最合适

举例2,分类问题:

以拟合的多项式,x的次数越高,拟合的越好,但相应的预测的能力就可能变差。

对于过拟合问题的处理措施

1.丢弃一些不能帮助我们正确预测的特征。可以是手工选择保留哪些特征,或者使用一些模型选择的算法来帮忙(例如PCA)

2.正则化。 保留所有的特征,但是减少参数的大小(magnitude)

2.代价函数

正则化思想方法:

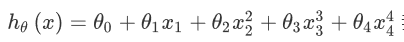

以上面的回归问题为例,若我们的模型是

思考:

思考:

我们可以从之前的事例中看出,正是那些高次项导致了过拟合的产生,所以如果我们能让这些高次项的系数接近于0的话,我们就能很好的拟合了。

措施:

所以我们要做的就是在一定程度上减小这些参数

θ

\theta

θ的值,这就是正则化的基本方法

方法:

修该代价函数,增加参数惩罚

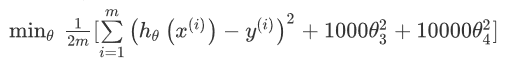

举例:

例如我们要减少

θ

3

\theta_3

θ3和

θ

4

\theta_4

θ4的大小,我们便可在

θ

3

\theta_3

θ3和

θ

4

\theta_4

θ4设置惩罚,这样做的话,我们在尝试最小化代价时也需要将这个惩罚纳入考虑中,并最终导致选择较小一些的

θ

3

\theta_3

θ3和

θ

4

\theta_4

θ4,这样

θ

3

\theta_3

θ3和

θ

4

\theta_4

θ4对预测结果的影响就会小的多,修改后的代价函数如下:

综述

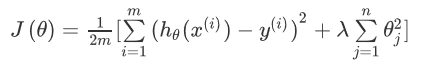

1.当我们有非常多的特征,我们并不知道其中哪些特征我们要惩罚,我们将对所有的特征进行惩罚,并且让代价函数最优化的软件来选择这些惩罚的程度。这样的结果是得到了一个较为简单的能防止过拟合问题的假设:

其中

λ

\lambda

λ为正则化参数

根据惯例,我们不对 θ 0 \theta_0 θ0进行惩罚,惩罚项 θ j \theta_j θj从j=1到j=n

2.经过正则化处理的模型与原模型的可能对比:

3.注意:

λ

\lambda

λ不可过大,否则会将除却

θ

0

\theta_0

θ0之外的其他参数最小化趋于0,导致模型成为一条平行x轴直线,而变成欠拟合

因此我们需要取得合理的

λ

\lambda

λ值,从而好的应用正则化

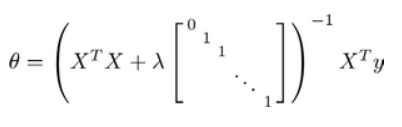

3.正则化线性回归

线性回归的求解两种算法:1.基于梯度下降 2.基于正规方程

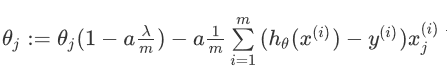

1.梯度下降

由于未对

θ

0

\theta_0

θ0正则化,故梯度下降算法分情况:

θ

0

:

=

θ

0

−

a

1

m

∑

i

=

1

m

(

(

h

θ

(

x

(

i

)

)

−

y

(

i

)

)

x

0

(

i

)

)

{\theta_0}:={\theta_0}-a\frac{1}{m}\sum\limits_{i=1}^{m}{(({h_\theta}({{x}^{(i)}})-{{y}^{(i)}})x_{0}^{(i)}})

θ0:=θ0−am1i=1∑m((hθ(x(i))−y(i))x0(i))

θ

j

:

=

θ

j

−

a

[

1

m

∑

i

=

1

m

(

(

h

θ

(

x

(

i

)

)

−

y

(

i

)

)

x

j

(

i

)

+

λ

m

θ

j

]

{\theta_j}:={\theta_j}-a[\frac{1}{m}\sum\limits_{i=1}^{m}{(({h_\theta}({{x}^{(i)}})-{{y}^{(i)}})x_{j}^{\left( i \right)}}+\frac{\lambda }{m}{\theta_j}]

θj:=θj−a[m1i=1∑m((hθ(x(i))−y(i))xj(i)+mλθj]

j

=

1

,

2

,

.

.

.

n

j=1,2,...n

j=1,2,...n

进一步化简

j

=

1

,

2

,

.

.

.

n

j=1,2,...n

j=1,2,...n情况得

可以看出,正则化线性回归的梯度下降算法的变化在于,前面的项每次都在原有算法更新规则的基础上令

θ

\theta

θ值减少从而小化更新后的

θ

\theta

θ值

2.正规方程求解

其中矩阵大小(n+1)*(n+1)

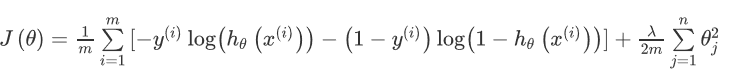

4.正则化逻辑回归

解决逻辑回归问题得多参数过度拟合问题同样可以正则化逻辑回归模型

对逻辑回归正则化也需要给代价函数增加一个正则化的 表达式,得到代价函数如下:

python代码:

import numpy as np

def costReg(theta, X, y, learningRate):

theta = np.matrix(theta)

X = np.matrix(X)

y = np.matrix(y)

first = np.multiply(-y, np.log(sigmoid(X*theta.T)))

second = np.multiply((1 - y), np.log(1 - sigmoid(X*theta.T)))

reg = (learningRate / (2 * len(X))* np.sum(np.power(theta[:,1:theta.shape[1]],2))

return np.sum(first - second) / (len(X)) + reg最小化该代价函数,通过求导,得出梯度下降算法为:

θ

0

:

=

θ

0

−

a

1

m

∑

i

=

1

m

(

(

h

θ

(

x

(

i

)

)

−

y

(

i

)

)

x

0

(

i

)

)

{\theta_0}:={\theta_0}-a\frac{1}{m}\sum\limits_{i=1}^{m}{(({h_\theta}({{x}^{(i)}})-{{y}^{(i)}})x_{0}^{(i)}})

θ0:=θ0−am1i=1∑m((hθ(x(i))−y(i))x0(i))

θ

j

:

=

θ

j

−

a

[

1

m

∑

i

=

1

m

(

h

θ

(

x

(

i

)

)

−

y

(

i

)

)

x

j

(

i

)

+

λ

m

θ

j

]

{\theta_j}:={\theta_j}-a[\frac{1}{m}\sum\limits_{i=1}^{m}{({h_\theta}({{x}^{(i)}})-{{y}^{(i)}})x_{j}^{\left( i \right)}}+\frac{\lambda }{m}{\theta_j}]

θj:=θj−a[m1i=1∑m(hθ(x(i))−y(i))xj(i)+mλθj]

j

=

1

,

2

,

.

.

.

n

j=1,2,...n

j=1,2,...n

注意:

1.虽然看起来与线性回归一样,但是同样注意

h

θ

(

x

)

=

g

(

θ

T

X

)

h_\theta(x)=g(\theta^TX)

hθ(x)=g(θTX),因此实际是不同的;

2.

θ

0

\theta_0

θ0不参与正则化

4659

4659

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?