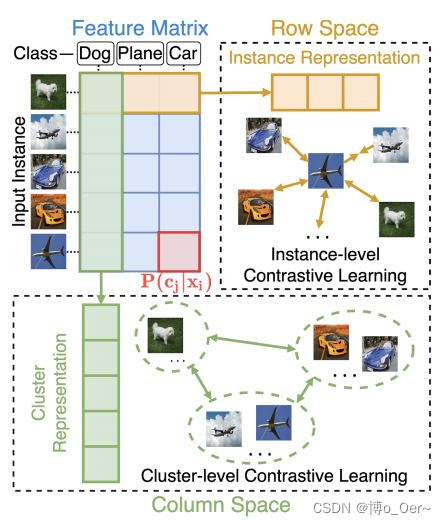

本文提出了一种称为对比聚类(CC)的单阶段在线聚类方法,该方法采用实例级和聚类级的对比学习。具体来说,对于给定的数据集,正实例对和负实例对是通过数据扩充构建然后投影到特征空间中。其中,实例级和聚类级对比学习分别在行和列空间中进行,通过最大化正对的相似性,最小化负对的相似性进行对比聚类。得出的结论为,特征矩阵的行可以被视为实例的软标签,相应地,列可以被视为聚类表示。通过同时优化实例和聚类级对比损失,该模型以端到端的方式联合学习表示和聚类分配。

主要贡献

基于“标签即表示”的思想,即特征矩阵的行和列本质上分别对应于实例和集群表示,将聚类任务统一到表示学习框架下,对每个样本学习其聚类软标签作为特征表示

该方法不仅在实例层面上进行对比学习,而且在聚类层面上进行对比学习,这种双重对比学习框架可以产生聚类偏好表征

该模型采用单阶段、端到端的工作方式,只需批量优化,因此可以应用于大规模数据集,并且该方法可以在不访问整个数据集的情况下及时预测每个新数据点的聚类分配,适合在线场景

相关工作

对比学习

实例级和聚类级的含义

构造输入样本和聚类标签的特征矩阵,矩阵的每一行代表样本属于每个类的概率,每一列代表每个样本属于当前类的概率。即行表示当前样本的标签,列表示分布在数据集上的聚类表示。因此,可以同时在矩阵的行空间和列空间中进行实例级和聚类级的对比学习。

提出的方法

模型结构

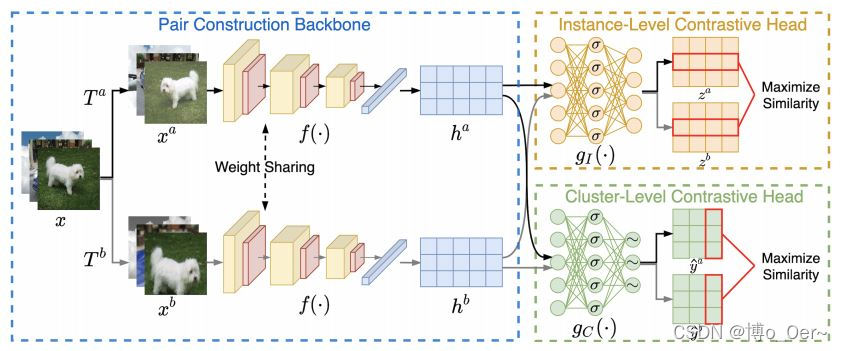

模型分为三个模块样本对构建模块(PCB)、实例级对比模块(ICH)、聚类级对比模块(CCH)。简而言之,PCB通过数据扩充来构造数据对,并从扩充样本中提取特征,然后ICH和CCH分别在特征矩阵的行和列空间中应用对比学习。训练后,可以通过CCH预测的软标签轻松获得簇分配。

- PCB

给定一个样本 xi ,两个数据增强方式 Ta,Tb ,则增强后样本 xia=Ta(xi),xib=Tb(xi) 。本任务中可选择的增强方式有:ResizedCrop(随机裁剪图片并resize到原图大小),ColorJitter(改变亮度,对比度等), Grayscale(转为灰度图), HorizontalFlip(水平翻转),GaussianBlur(高斯模糊)。像SimCLR一样,每个增强方式都会分配一个概率使用

本文使用ResNet作为backbone提取增强数据的特征 hia=f(xia),hib=f(xib)

- ICH

最终模型loss如下

L=Lins+Lclu

CC的伪代码如下

损失构建

ICH和CCH的优化是一个单阶段和端到端的过程。同时优化两个头,整体目标函数由实例级和簇级对比损失组成,即:

实践中,发现简单地添加两个损失已经很有效,并不需要取设置两个损失的权重。

基于观察到特征矩阵的行和列可以分别实现为实例和簇的表示,我们提出了对比聚类(CC)方法,该方法在一个统一的框架下,在实例和簇级别双重进行对比学习

引:

127

127

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?