二分类问题:

之前我们谈到垃圾文件的分类和肿瘤的良性和恶性的判断问题,还有网上交易等,在这些问题中,我们所预测的变量y都是可以有两个取值的变量,0或1,垃圾邮件或非垃圾邮件,恶性或阳性

我们用0来表示负类,用1来表示正类,所以0可以用来表示良性肿瘤,而1可以用来表示恶性肿瘤,而在问题中,哪个是正类,哪个是负类,表示什么,哪个是0哪个是1是任意的,没有什么区别,但往往用负类表示没有哪样东西,我们先讨论只包含0和1两类的分类问题,后面会讨论多分类的东西,其中y的取值可以分为1,2,3等

Logistic Regression(逻辑回归)

在二分类问题中使用线性回归,拟合数据的效果不会很好,所以我们来谈谈逻辑回归,逻辑回归的输出或者是预测值只会在0到1之间,并不会大于1或者小于0,如下图所示

当z为实数时,g(z)就是Sigmoid函数,也称Logistic函数,这两个是同义词,接下来来解释一下这个模型,以肿瘤的例子为例,如下图所示,如果假设输出为0.7,那就等于y等于1的概率为0.7

决策界限:

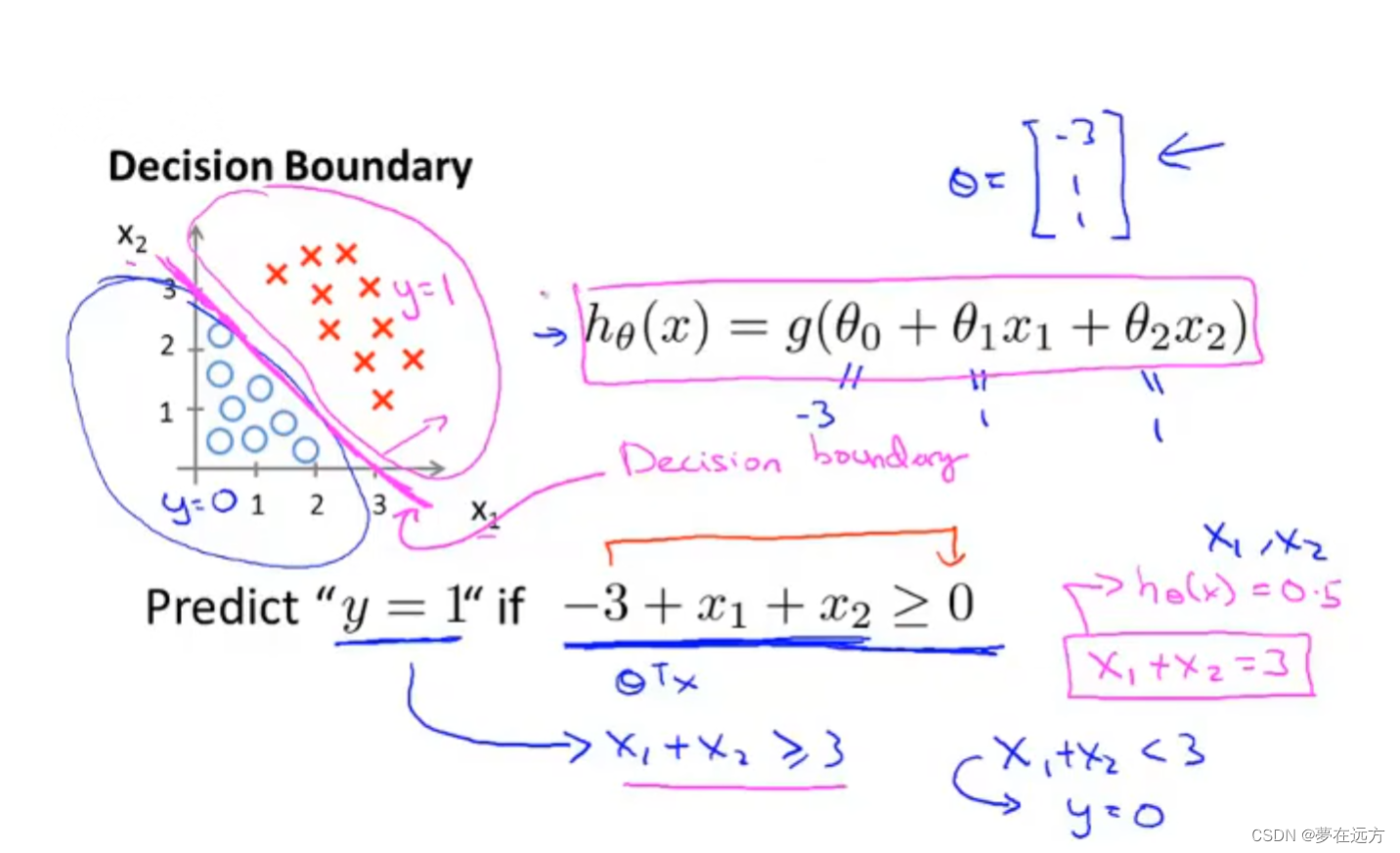

在下图的数据集中,有如图所示的假设函数,参数如何得出暂且不论,当-3+x1+x2大于等于0的时候,y=1的概率就会更大甚至等于1,-3+x1+x2等于0的时候就会定义一条直线,将图像正类和负类分为了两部分,而这条直线就叫做决策界限,如果逻辑函数变量为更高阶多项式,那么得到的决策界限会更复杂

拟合逻辑回归模型参数的方法:

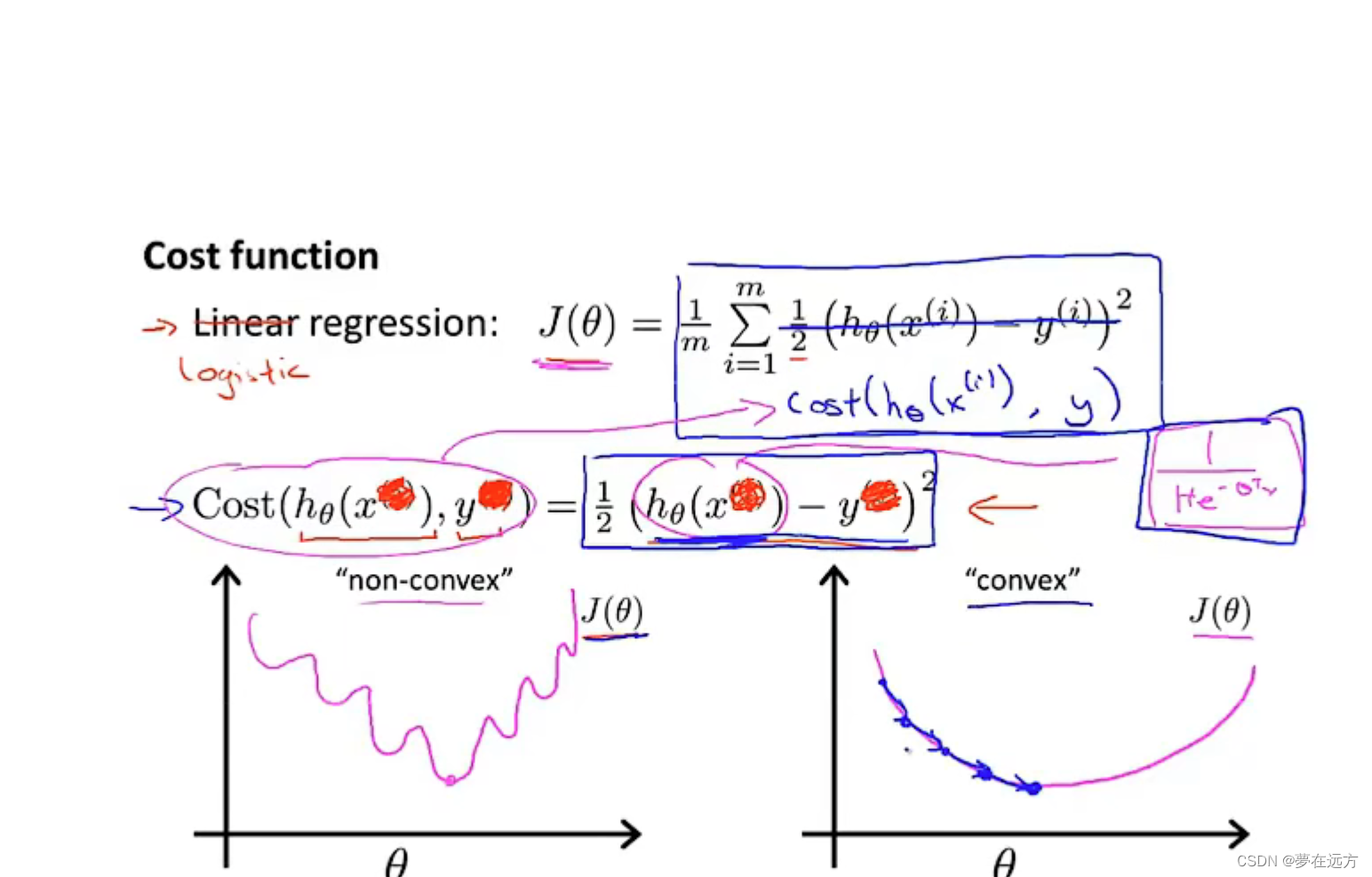

拟合参数就要用到代价函数,代价函数的写法跟线性回归时的有所不同,将进行一定的改写,如下图所示

经过改写的cost函数的取值分为这几种情况

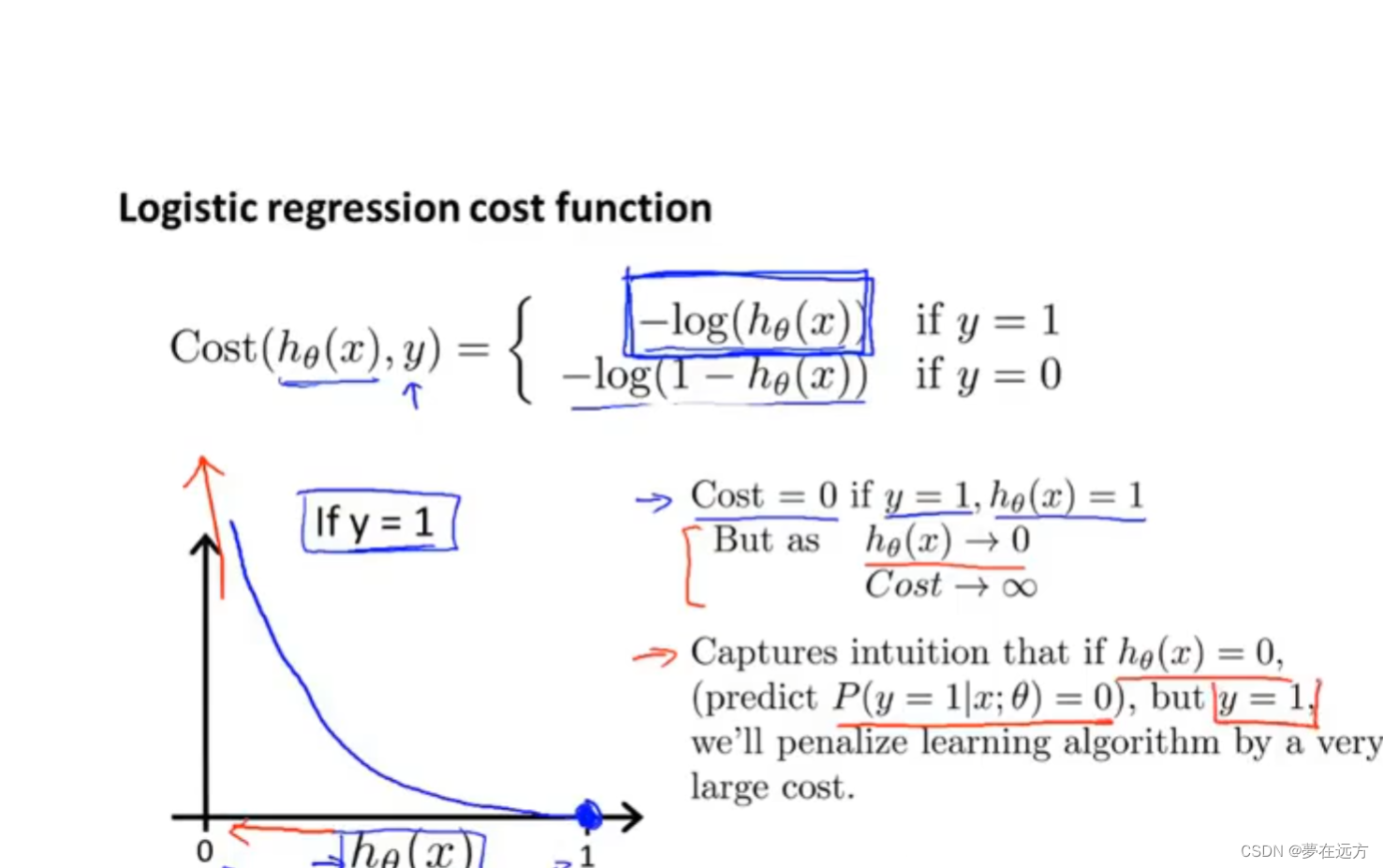

当y=1时:

当预测非常成功时代价函数cost为0,非常失败时即预测y趋近于0时代价函数的值将会趋近于无穷大

当y=0时:

与y=1时同理,只不过反过来

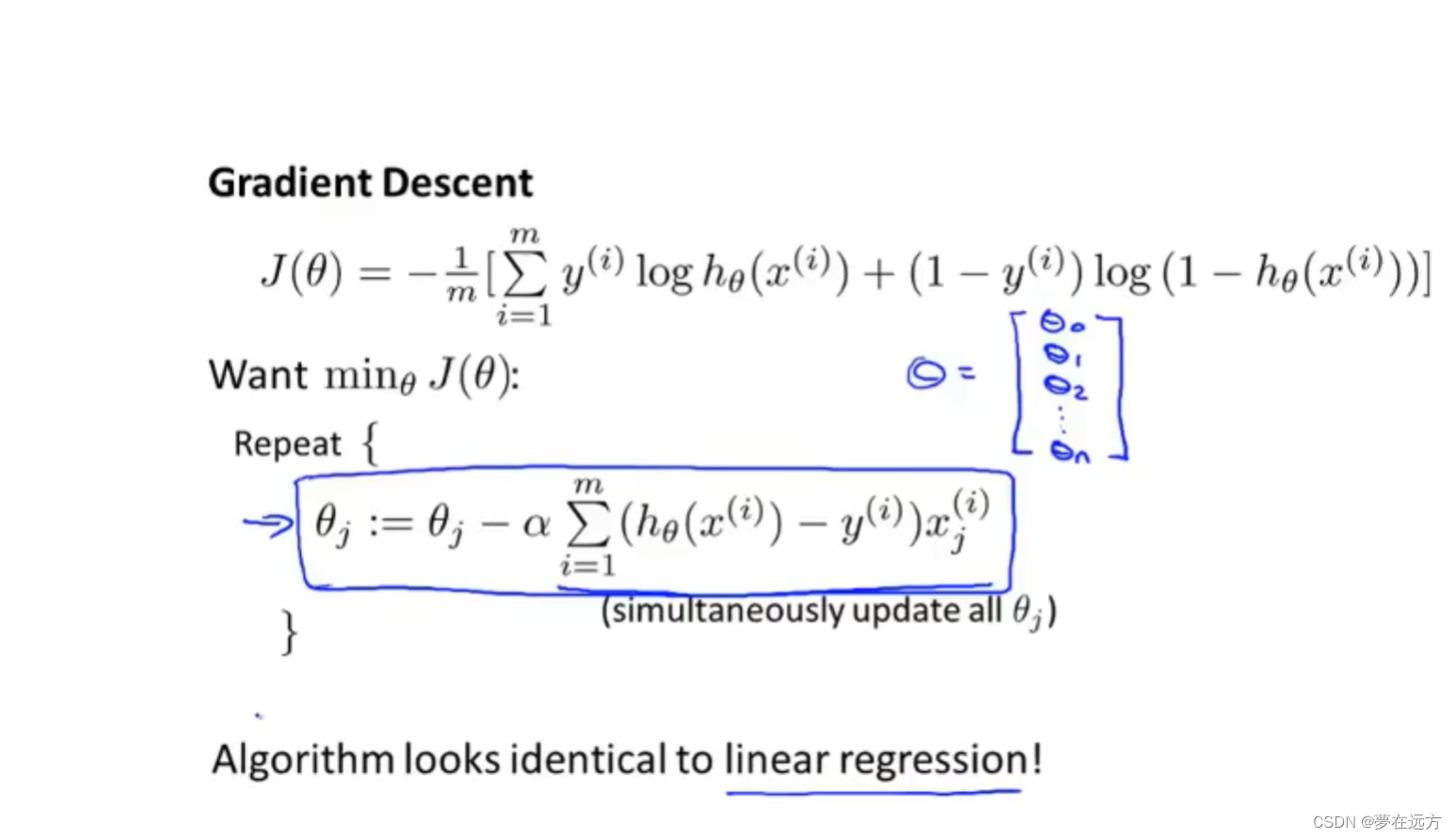

简化代价函数和梯度下降:

上面的Cost函数可以改写成如下的形式并套用梯度下降的模板,不过因为h(x)的定义改变,所以逻辑回归和线性回归还是不同的

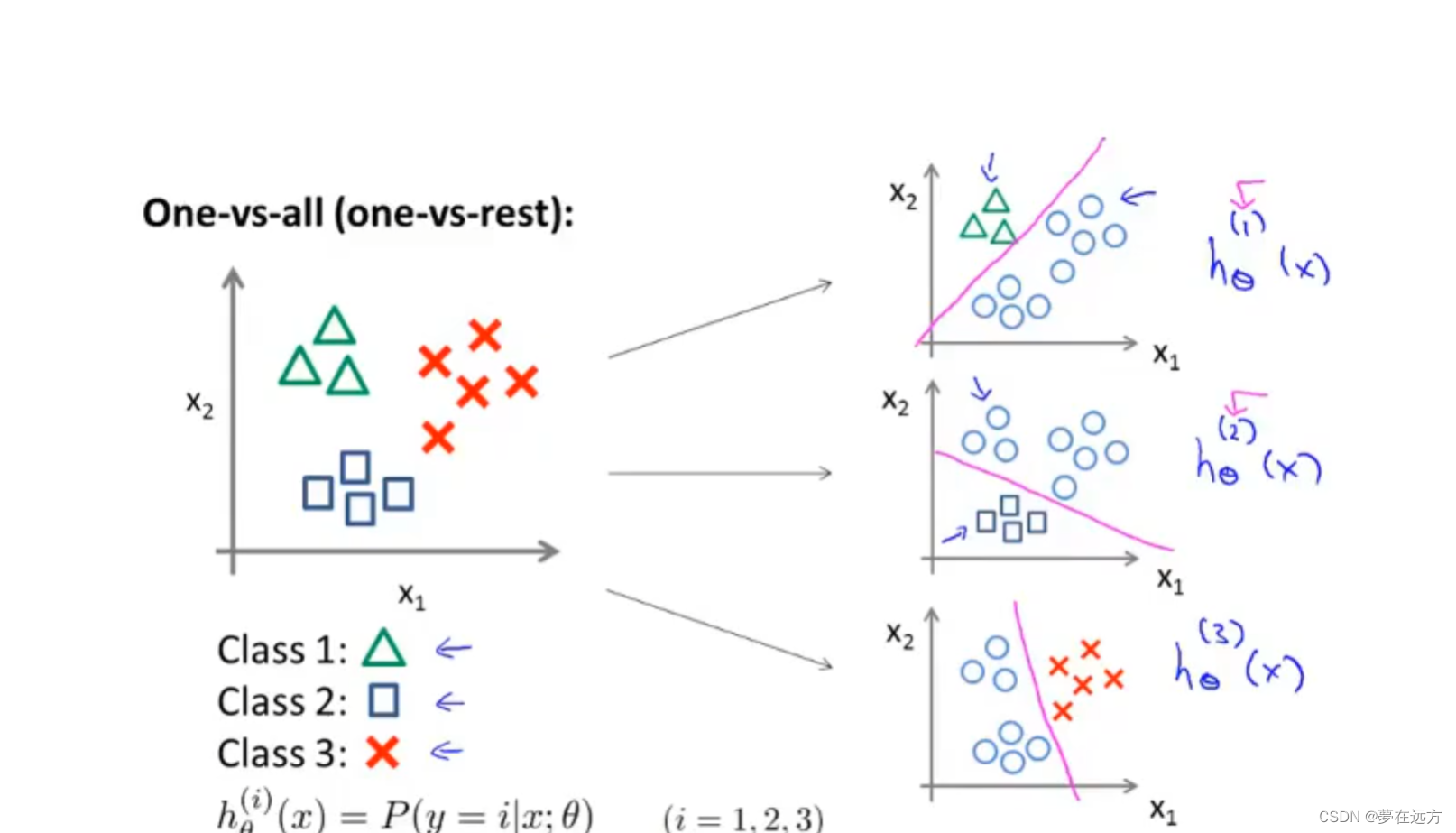

多类别分类的问题:

如下图所示是一个包含三个类的问题,我们将其分为三个二元分类的问题,也就是拟合三个分类器,用来尝试估计出当给定x和时,y=i的概率

总结一下,我们训练一个逻辑回归分类器,预测i类别y=i的概率,最后为了做出预测,我们给出一个新的输入值x,期望获得预测,我们要做的就是在三个分类器中输入运行x,选择出三个分类器中可信度最高的,效果最好的那个分类器,无论i值多少,我们都能得到一个最高的概率值,我们预测的y就是那个值

2399

2399

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?