文章目录

- 博主精品专栏导航

- 第三章、项目实战

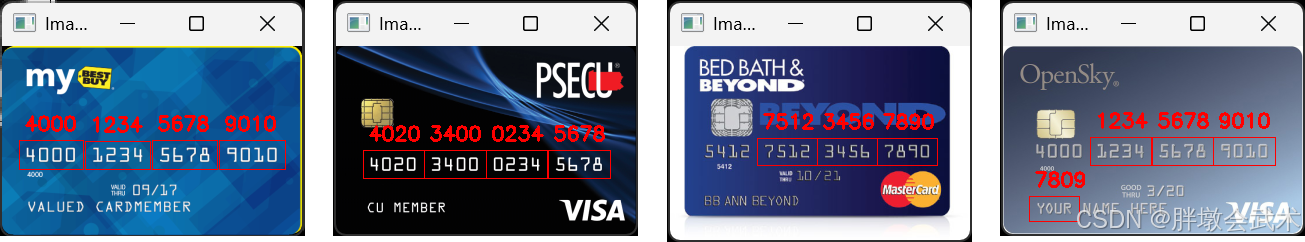

- (一)银行卡号识别 —— cv2.morphologyEx()、cv2.getStructuringElement()、cv2.threshold()、cv2.findContours()、cv2.drawContours()、cv2.boundingRect()

- (二)文档扫描与OCR识别 —— cv2.getPerspectiveTransform()、cv2.warpPerspective()

- (三)答题卡识别与判卷 —— cv2.putText()、cv2.countNonZero()

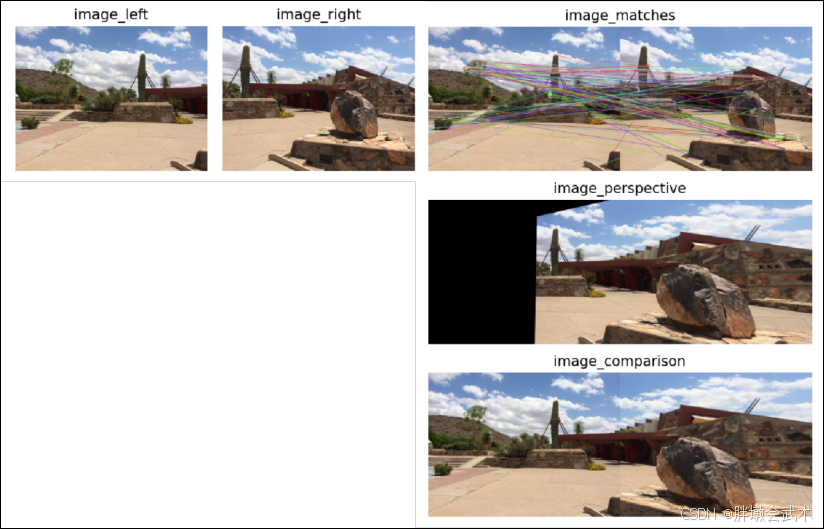

- (四)全景拼接 —— detectAndDescribe()、matchKeypoints()、cv2.findHomography()、cv2.warpPerspective()、drawMatches()

- (五)图像分类(DNN) —— cv2.dnn.blobFromImage()、cv2.dnn.blobFromImages()

- (六)背景减法(实时目标识别) —— cv2.createBackgroundSubtractorMOG2()

- (七)光流估计(实时目标跟踪) —— cv2.goodFeaturesToTrack()、cv2.calcOpticalFlowPyrLK()

- (八)图像分割

- (九)图像增强:灰度反转、对比度拉伸、对比度和亮度增强、指数变换、伽马变换、对数变换

- (十)噪声模拟:均匀噪声、高斯噪声、椒盐噪声、泊松噪声、瑞利噪声、伽马噪声、乘性噪声

- (十一)基于核函数的卷积操作:滤波器、形态学变化、边缘检测算子

- (十二)添加水印

- 第零章、环境配置

- 第一章、图像的基本操作

- 第二章、图像的高级操作

- 2.0、主程序判断:if __ name __ == ' __ main __ '

- 2.1、通道分离 + 通道合并 —— cv2.split() + cv.merge()

- 2.2、边缘填充 —— cv2.copyMakeBorder()

- 2.3、图像融合 —— cv2.add() + cv2.addWeighted()

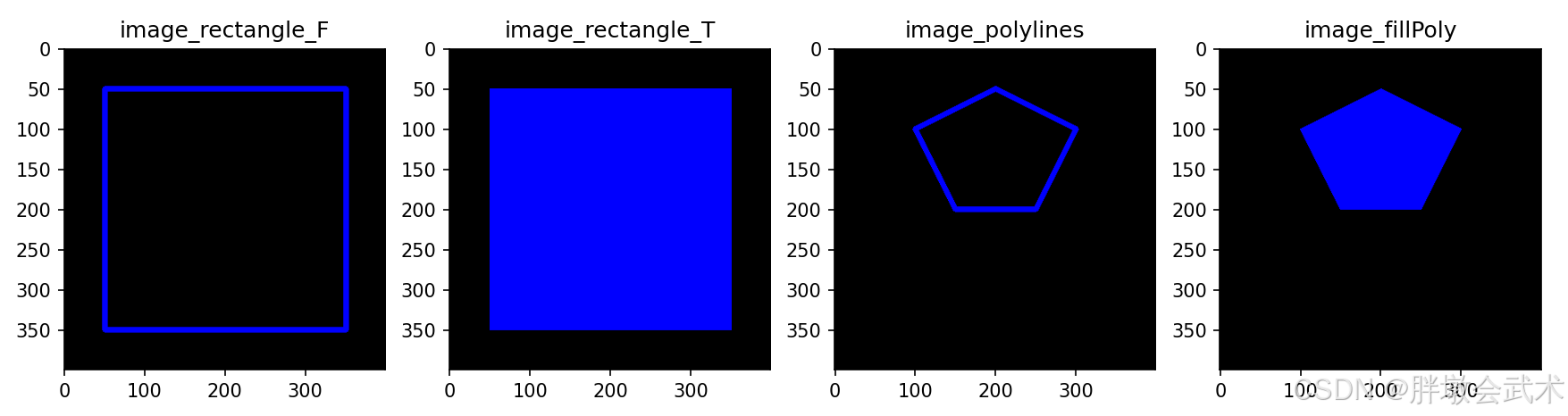

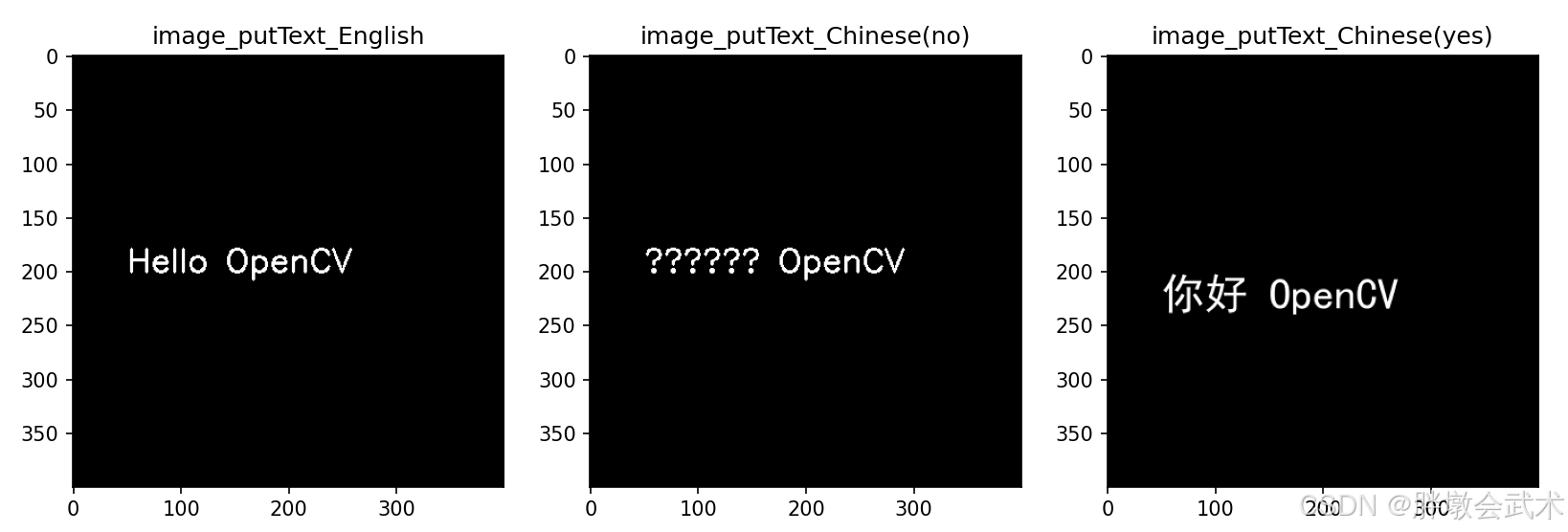

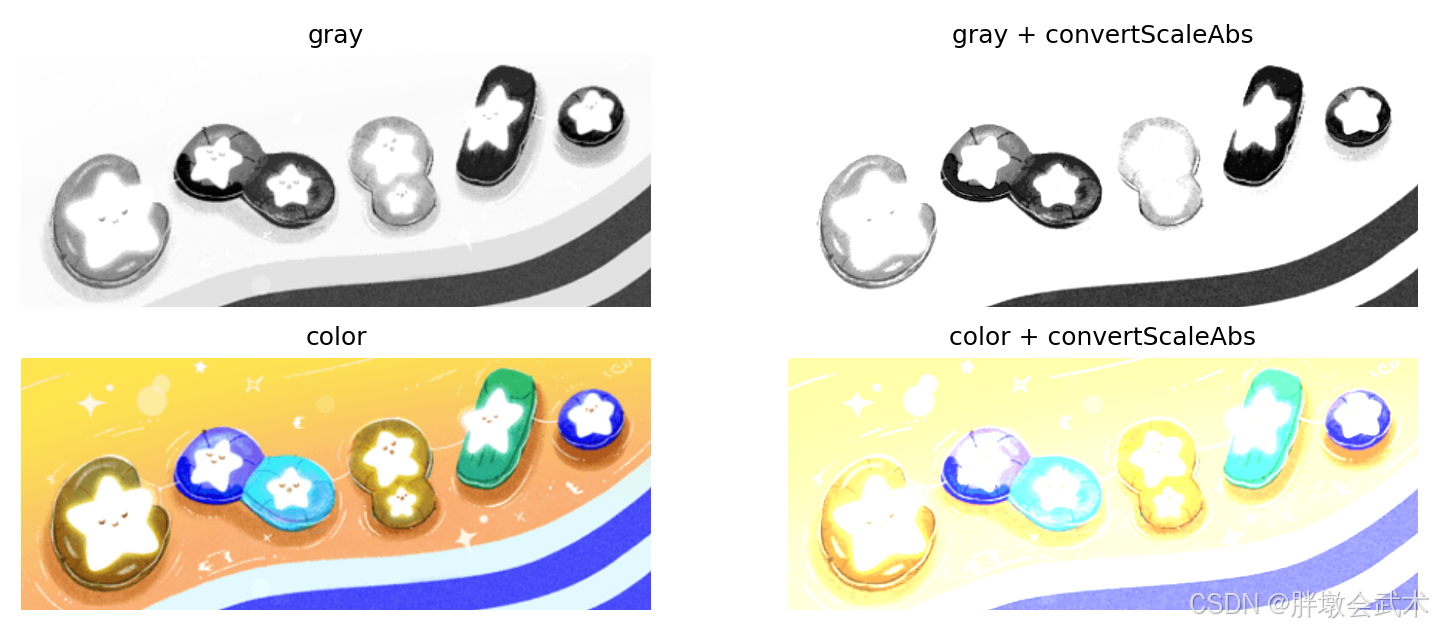

- 2.4、对比度和亮度调整 —— cv2.convertScaleAbs()

- 2.5、色彩空间转换 —— cv2.cvtColor()

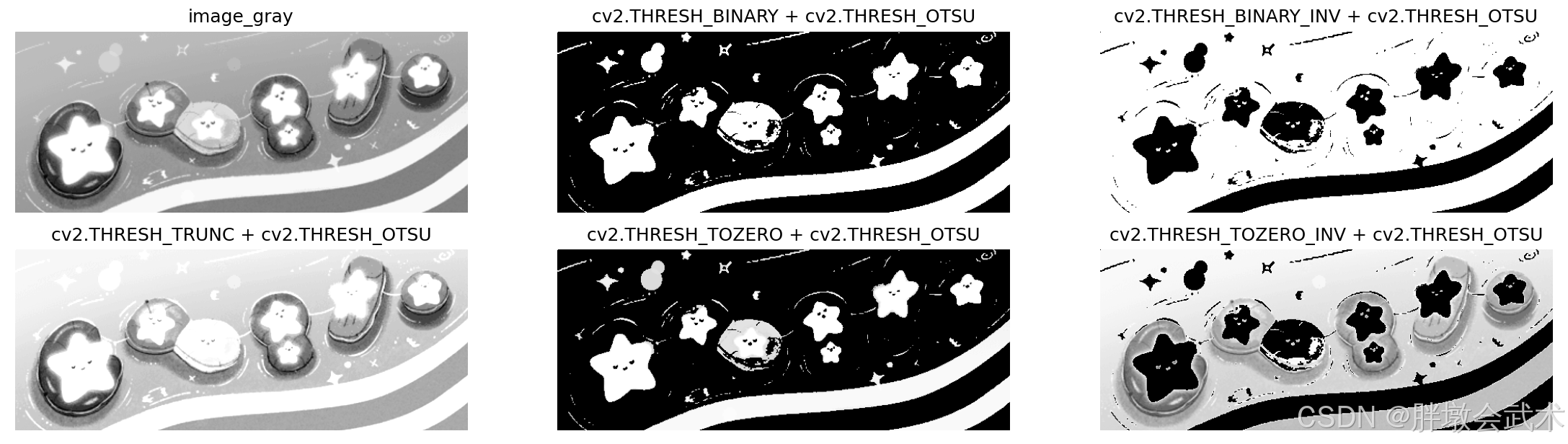

- 2.6、阈值处理

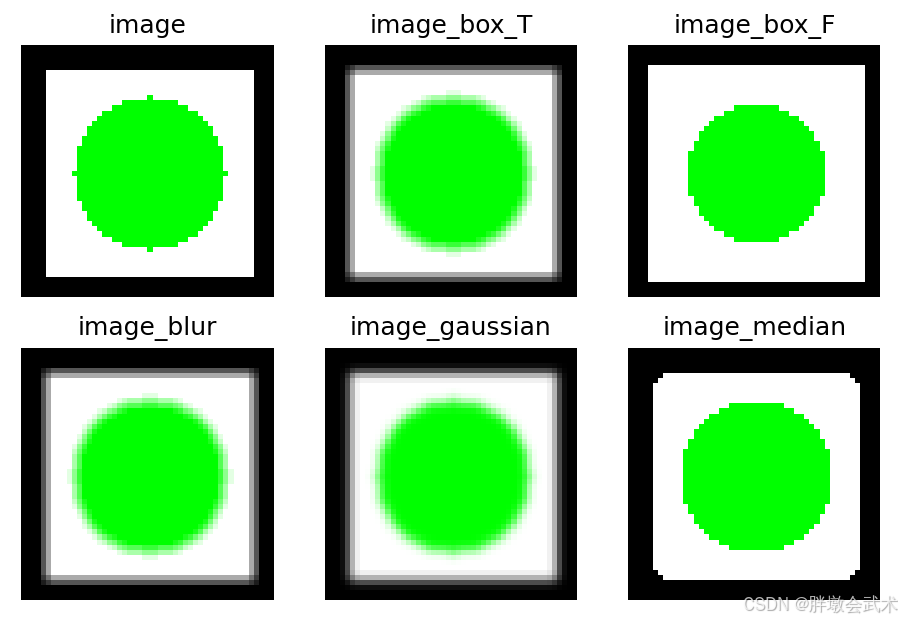

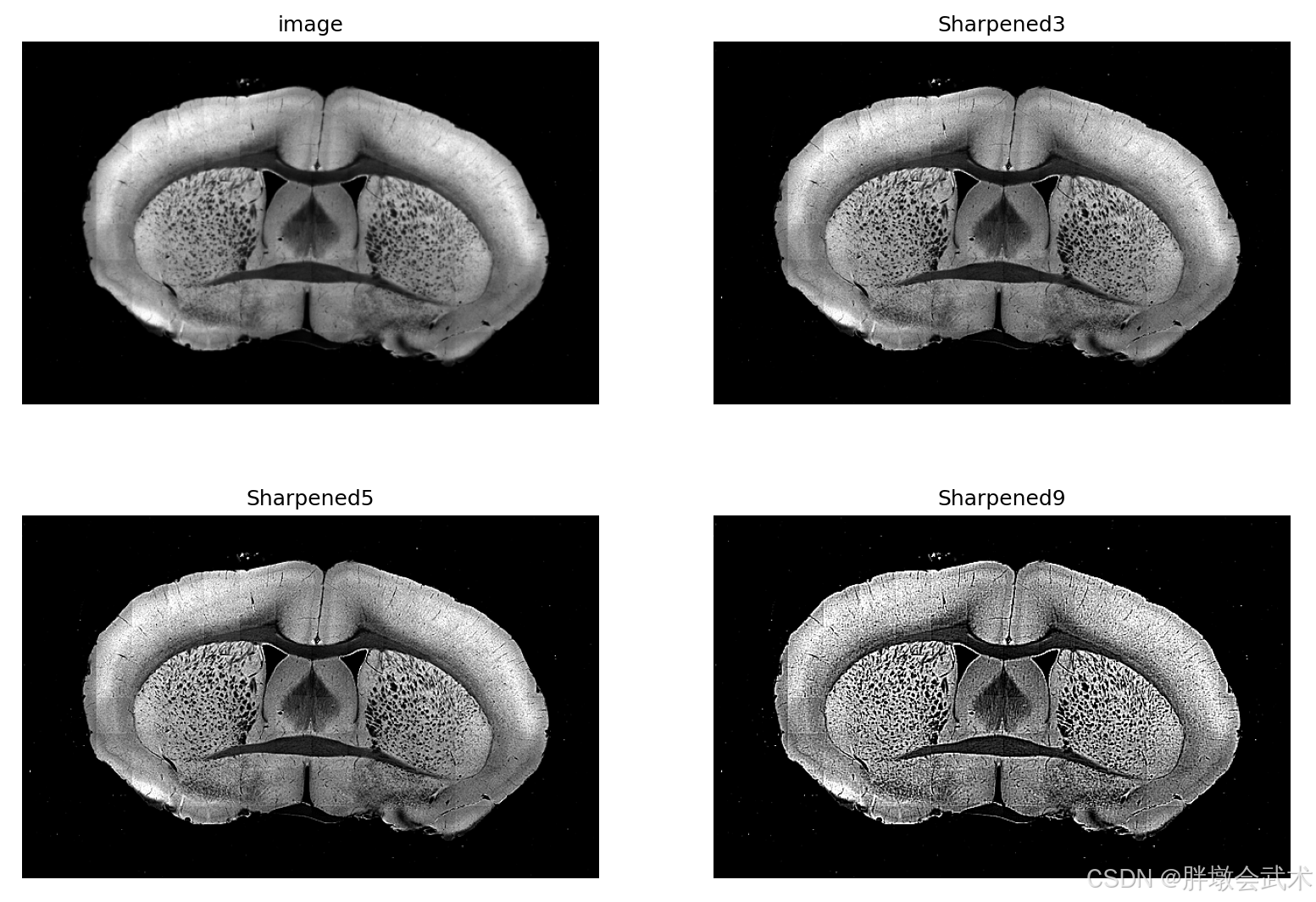

- 2.7、滤波器

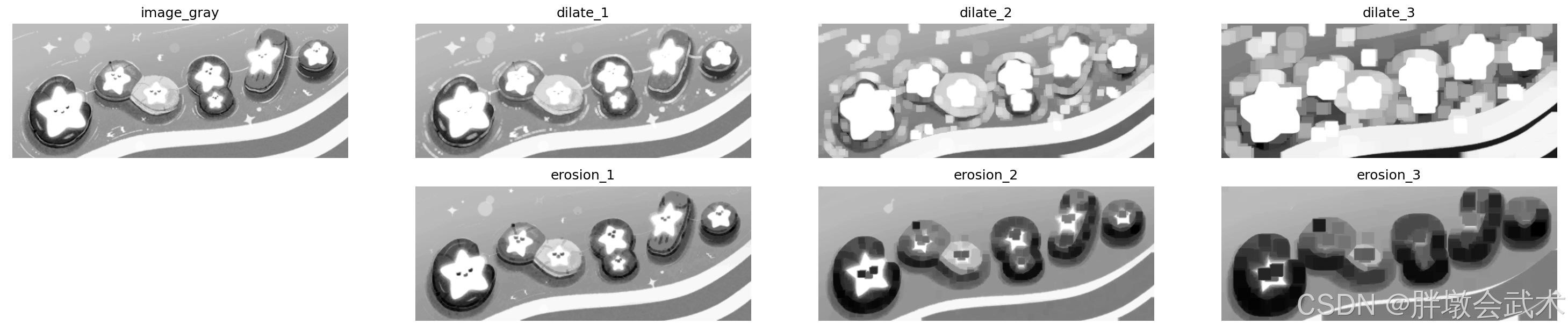

- 2.8、腐蚀与膨胀(迭代次数) —— cv2.erode() + cv2.dilate()

- 2.9、形态学变化(腐蚀 + 膨胀 + 开运算 + 闭运算 + 梯度计算 + 顶帽 + 黑帽) —— cv2.morphologyEx()

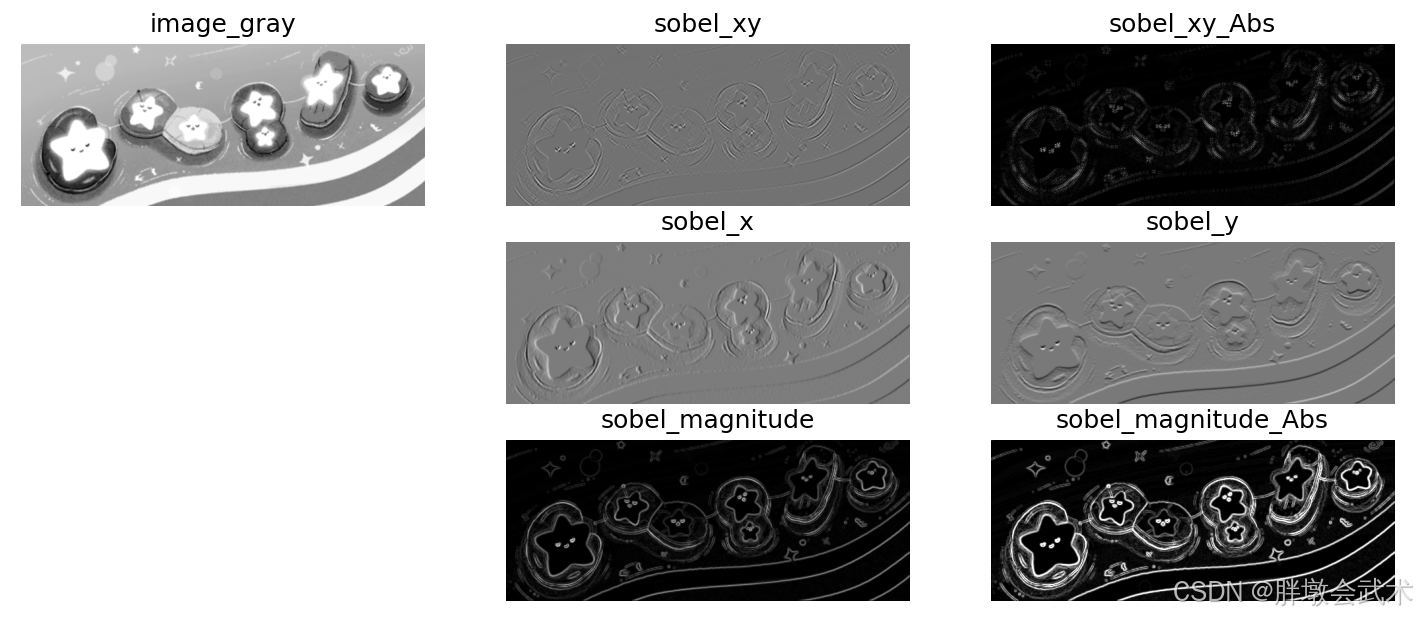

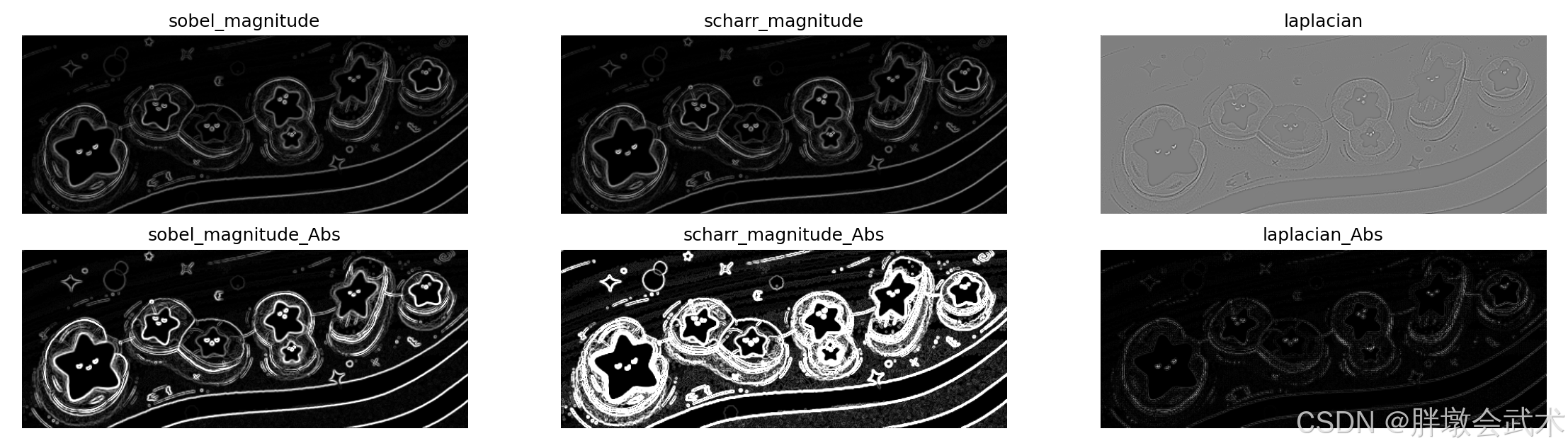

- 2.10、边缘检测算子 —— cv2.sobel()、cv2.Scharr()、cv2.Laplacian()、cv2.Canny()

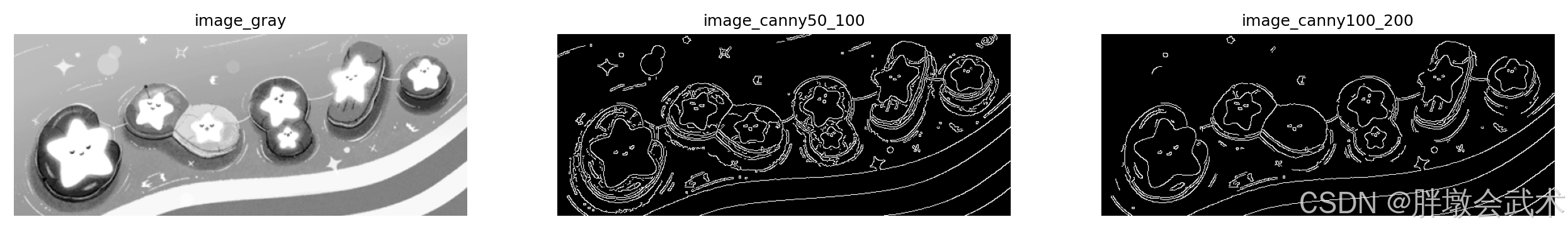

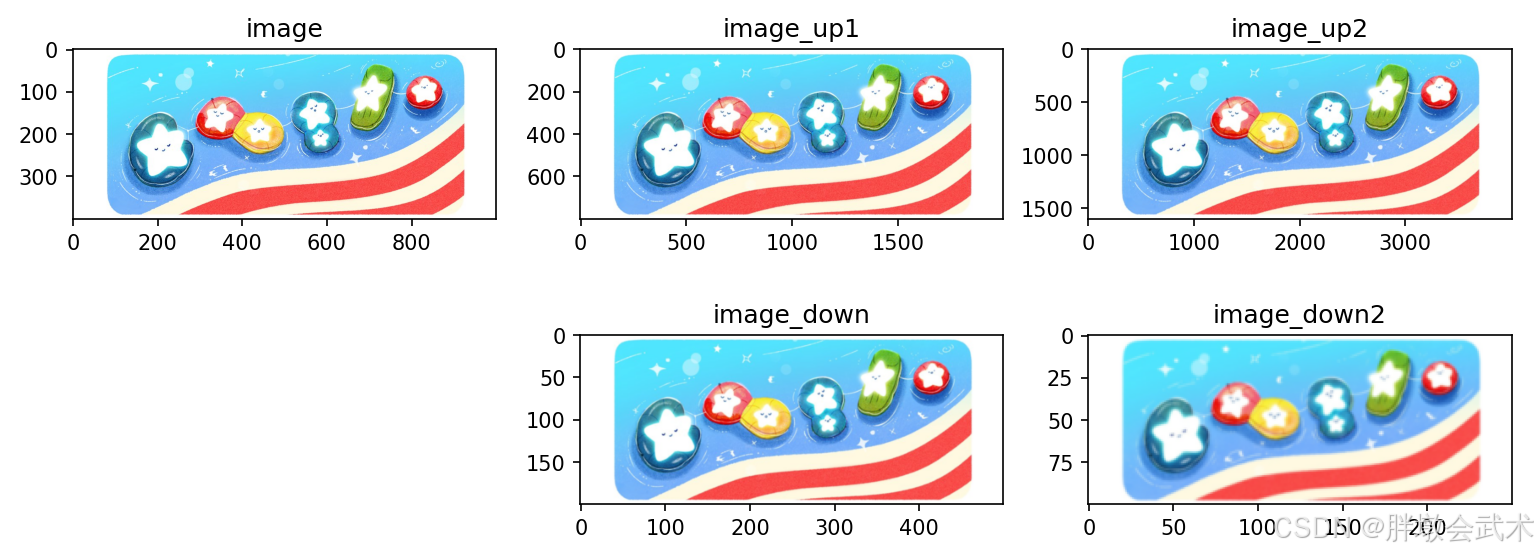

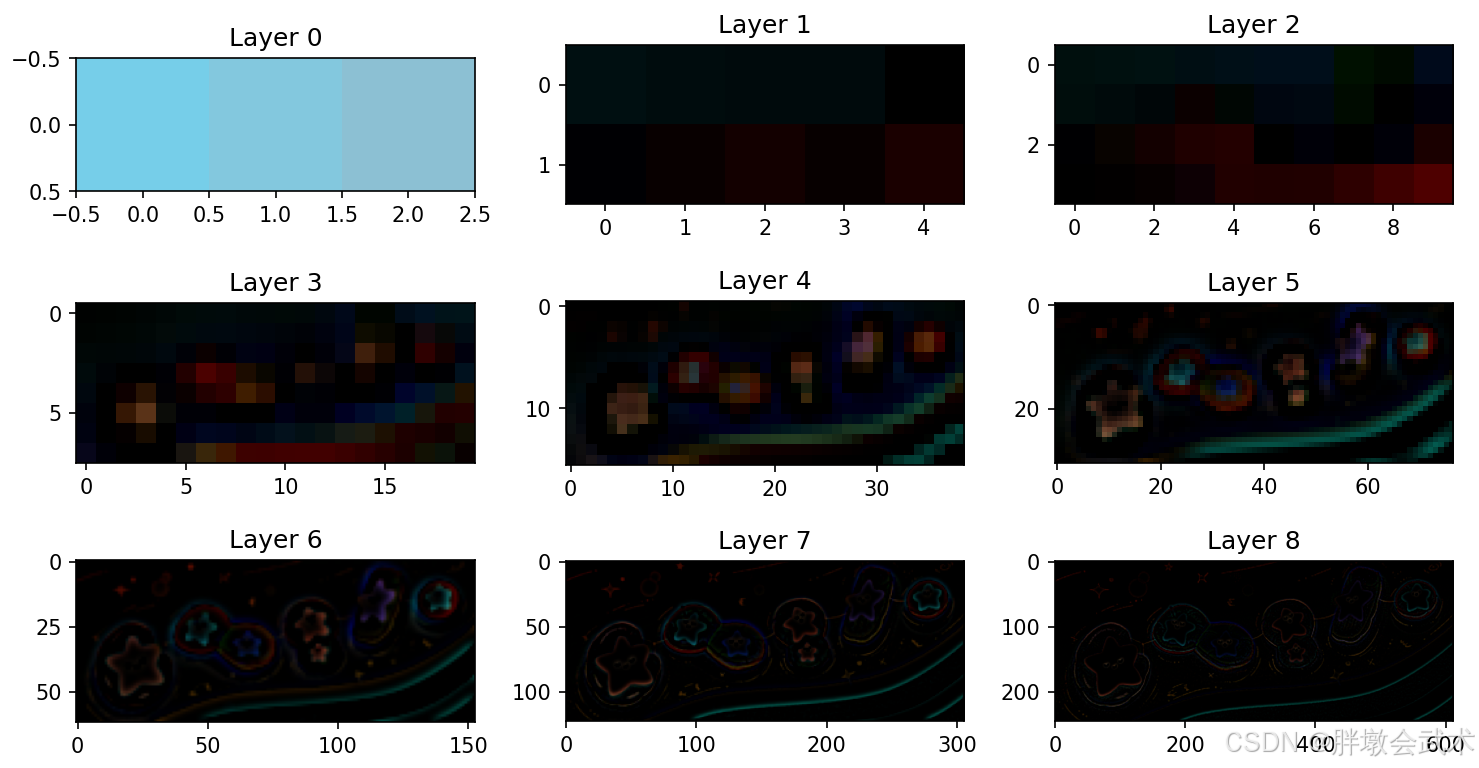

- 2.11、图像金字塔

- 2.12、轮廓检测

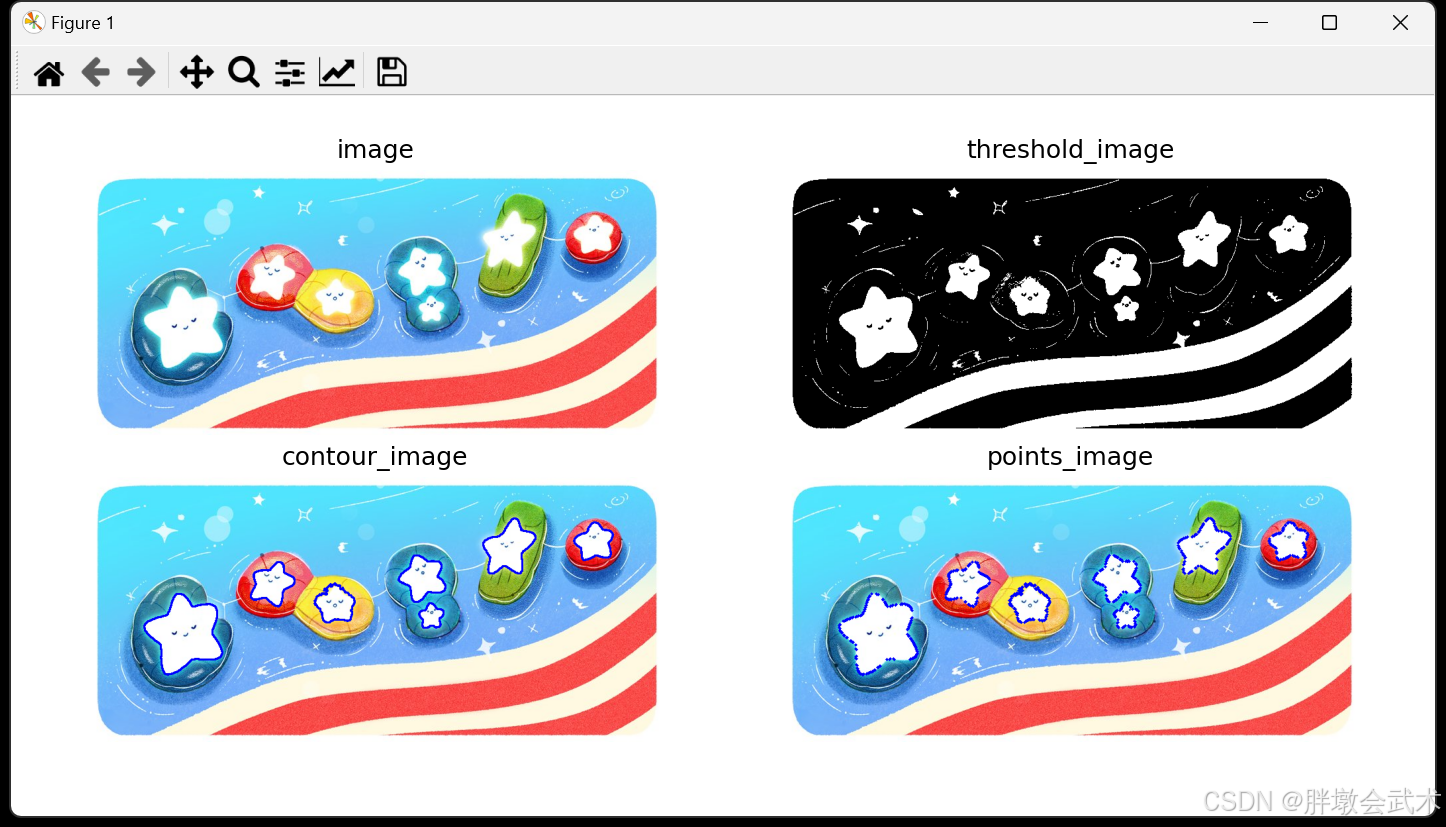

- (1)提取轮廓 + 绘制轮廓 —— cv2.findContours()、cv2.drawContours()

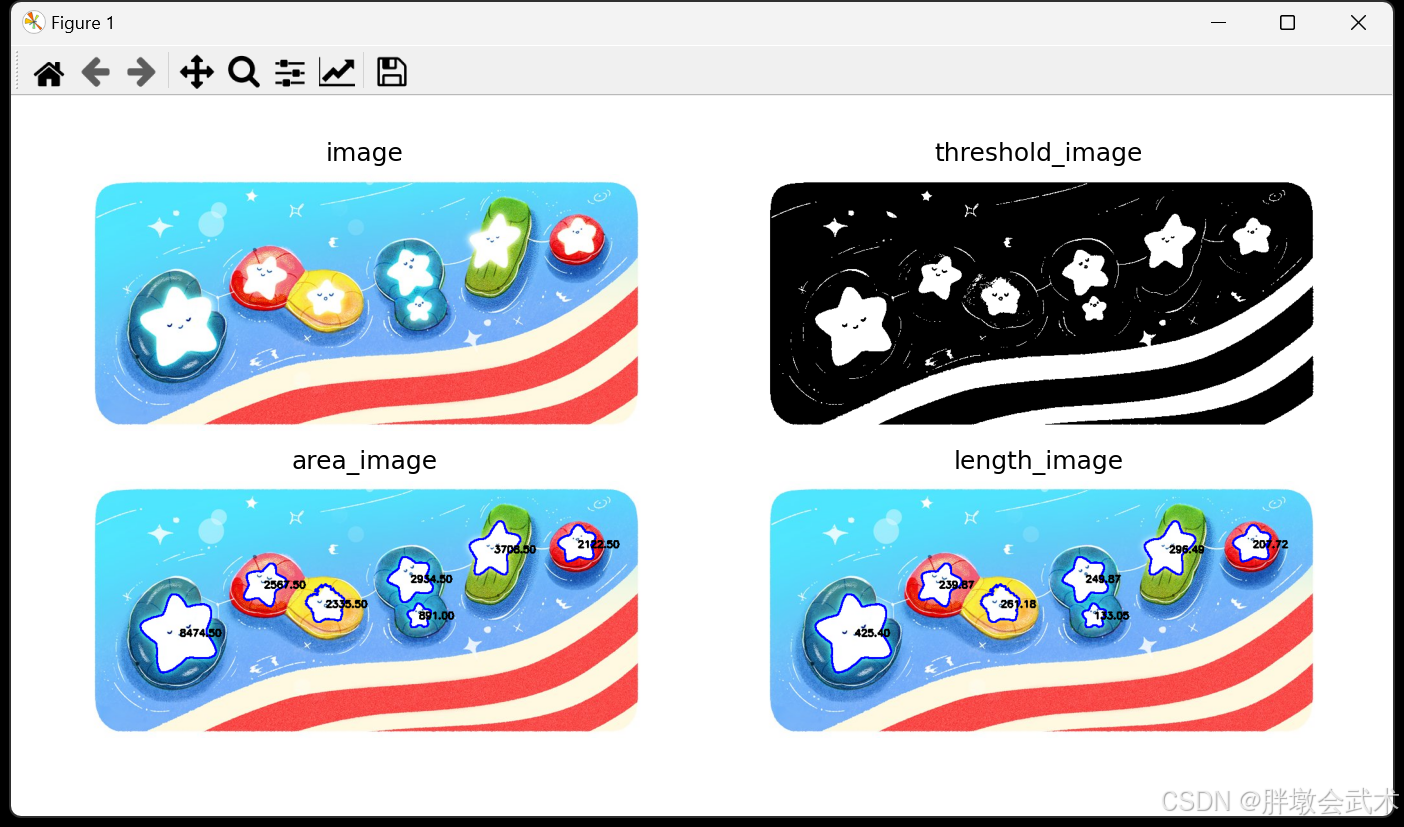

- (2)轮廓的基本属性(轮廓面积 + 轮廓周长) —— cv2.contourArea()、cv2.arcLength()

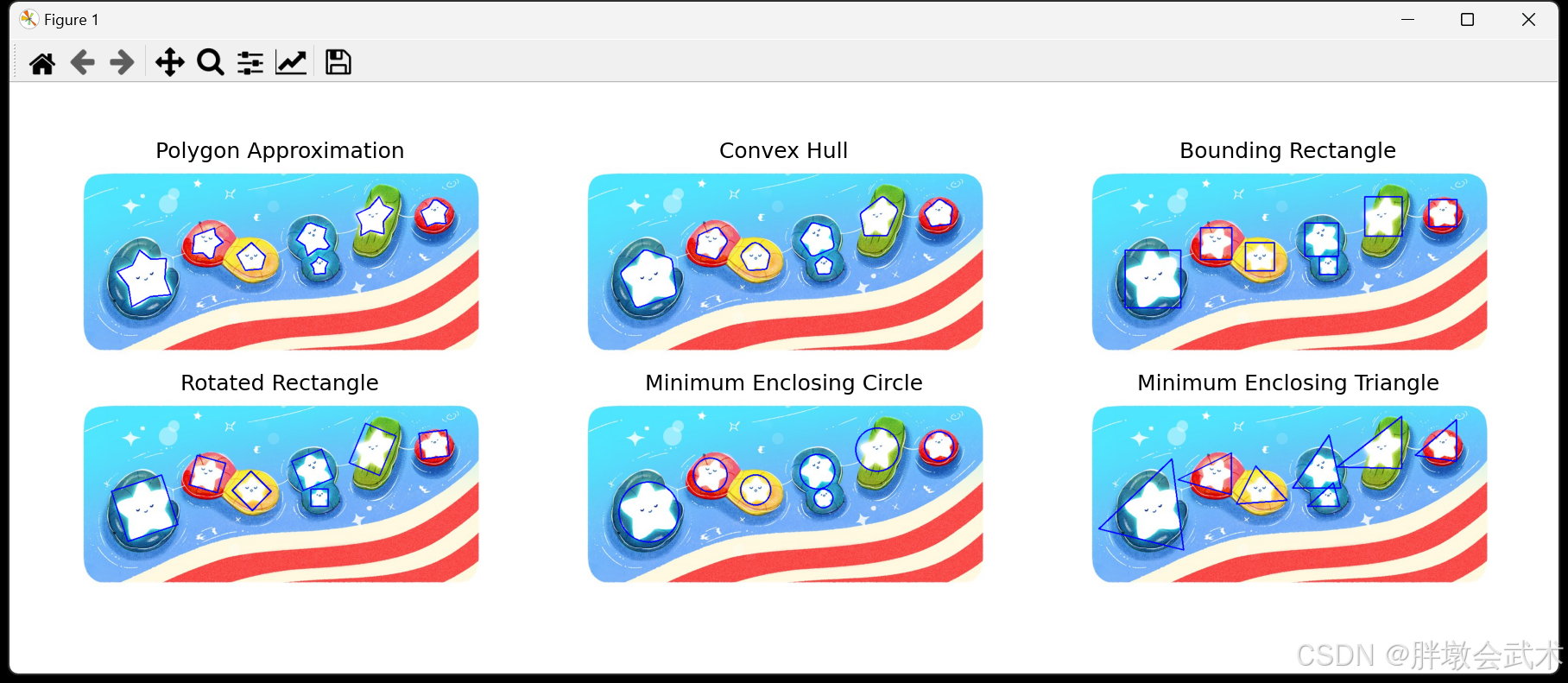

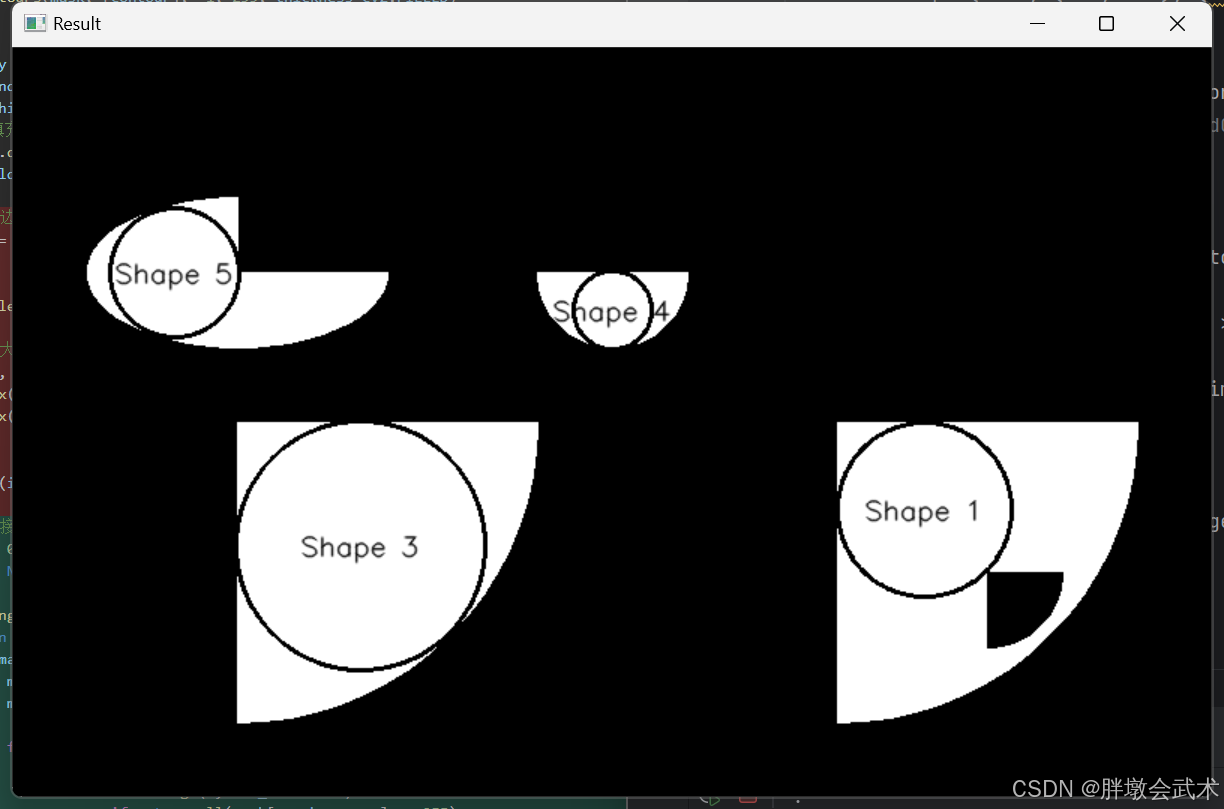

- (3)轮廓的外接边界框(多边形近似 + 凸包 + 最小外接矩形 + 最小旋转外接矩形 + 最小外接圆 + 最小外接三角形) —— cv2.approxPolyDP()、cv2.convexHull()、cv2.boundingRect()、cv2.minAreaRect()、cv2.minEnclosingCircle()、cv2.minEnclosingTriangle()

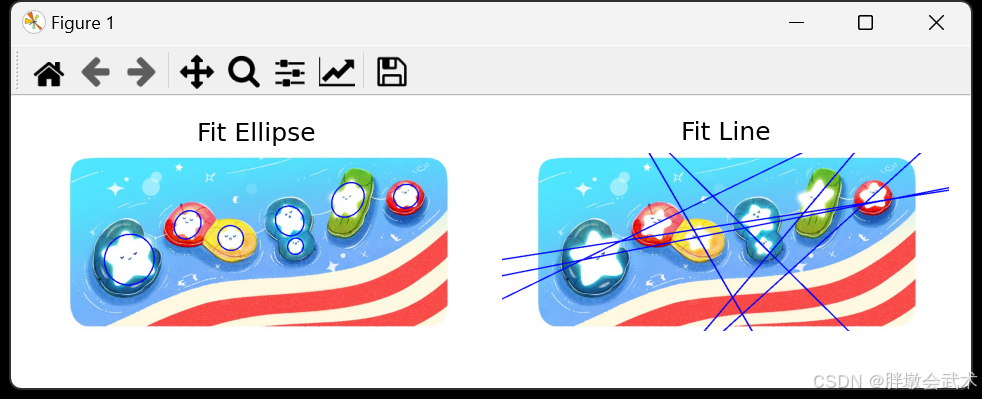

- (4)轮廓的最优拟合(拟合椭圆 + 拟合直线) —— cv2.fitEllipse()、cv2.fitLine()

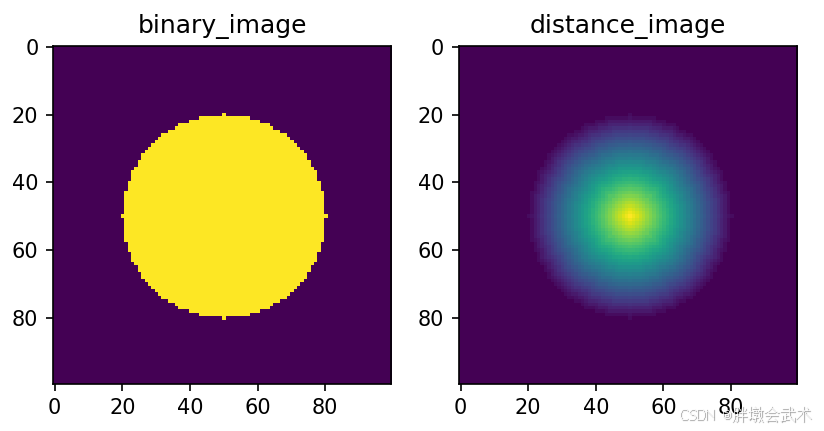

- (5)轮廓的最大内接圆(自定义实现)

- 2.13、模板匹配 —— cv2.matchTemplate()、cv2.minMaxLoc()

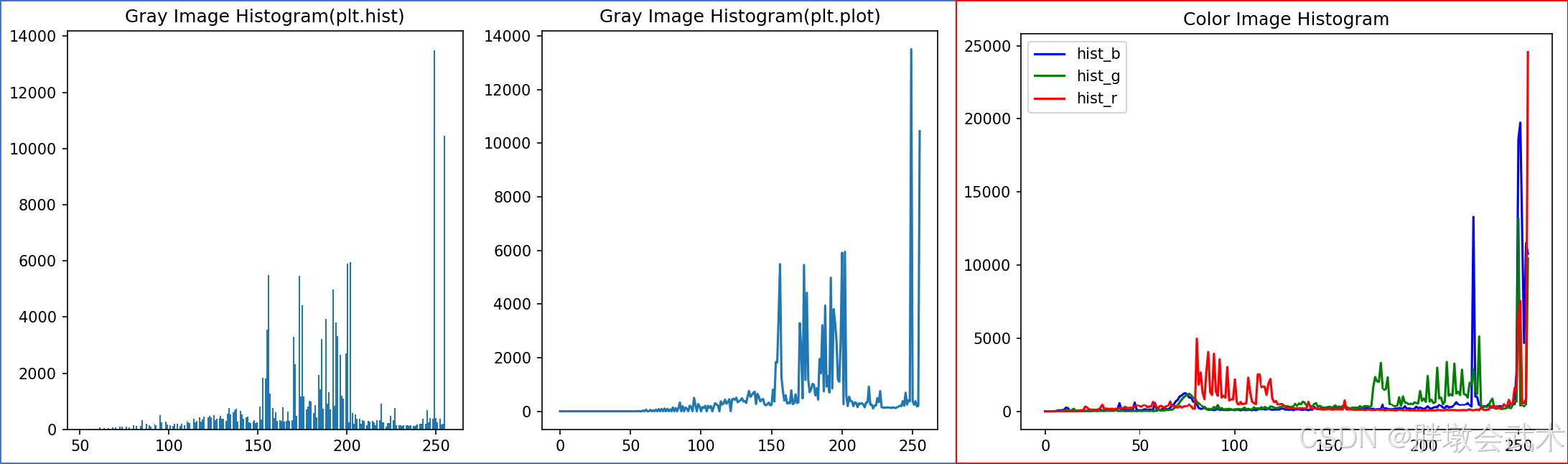

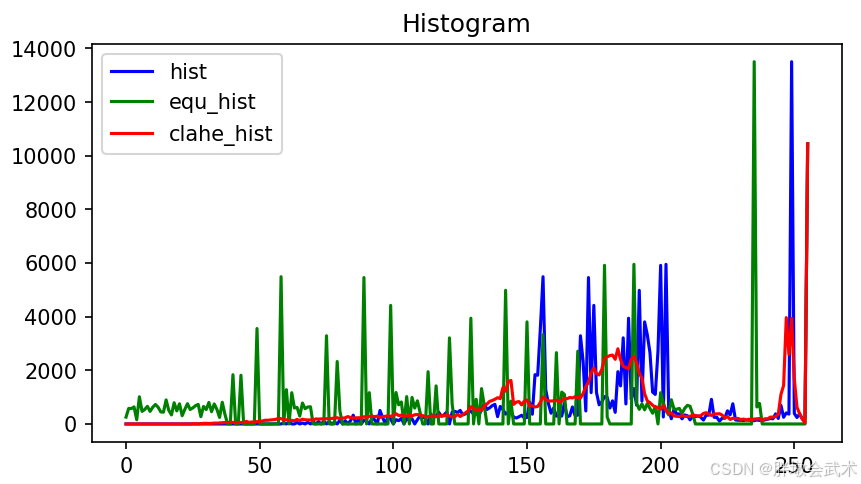

- 2.14、直方图 + 直方图均衡化 + 自适应 —— cv2.calcHist()、cv2.equalizeHist()、cv2.createCLAHE()

- 2.15、傅里叶变换 + 低通滤波 + 高通滤波 —— cv2.dft()、cv2.idft()、np.fft.fftshift()、np.fft.ifftshift()、cv2.magnitud()

- 2.16、Harris角点检测 —— cv2.cornerHarris() + cv2.KeyPoint() + cv2.drawKeypoints()

- 2.17、SIFT尺度不变特征检测 —— cv2.xfeatures2d.SIFT_create()、sift.detectAndCompute()、cv2.drawKeypoints()

- 2.18、暴力特征匹配 —— cv2.BFMatcher_create()、bf.match()、bf_knn.knnMatch()、cv2.drawMatches()

- 2.19、特征点检测器 + 特征点描述符

- 2.20、几何变换

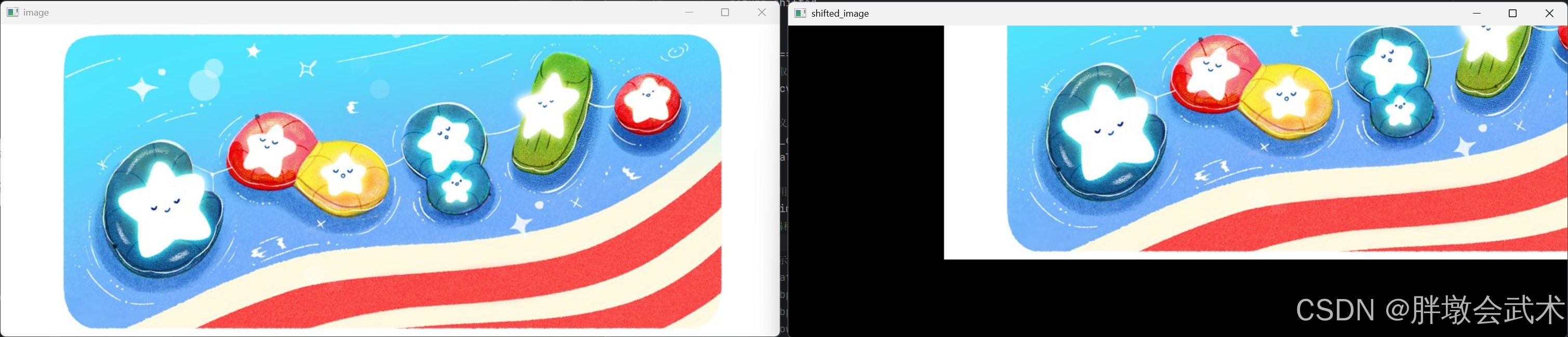

- (0)图像平移 - 上下左右(自定义实现)

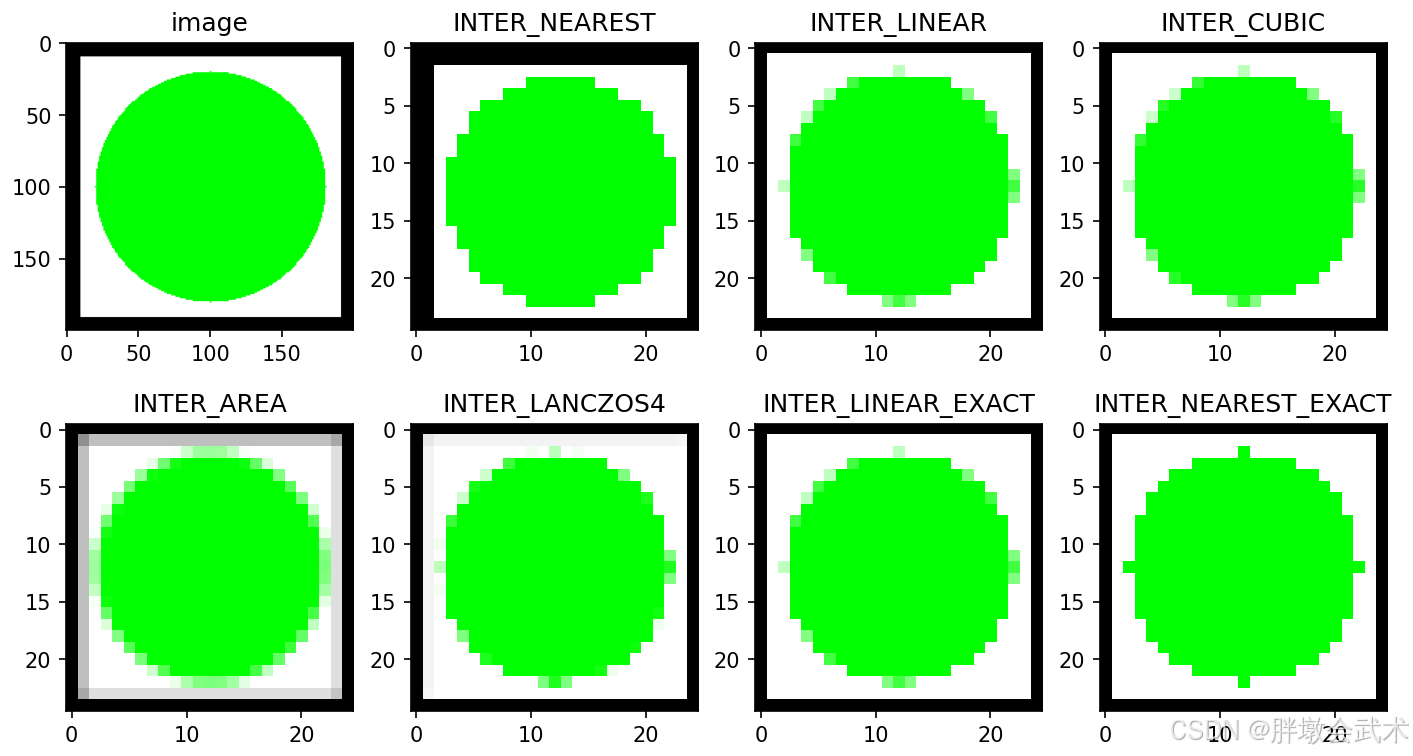

- (1)图像缩放 —— cv2.resize()

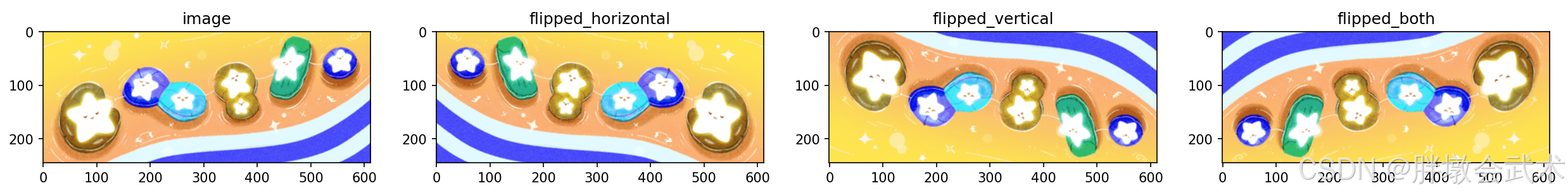

- (2)图像翻转 —— cv2.flip()

- (3)图像旋转 —— cv2.rotate()

- (4)图像转置 —— cv2.transpose()

- (5)图像重映射 —— cv2.remap():扭曲 + 缩放 / 平移 / 旋转 / 翻转 / 变换

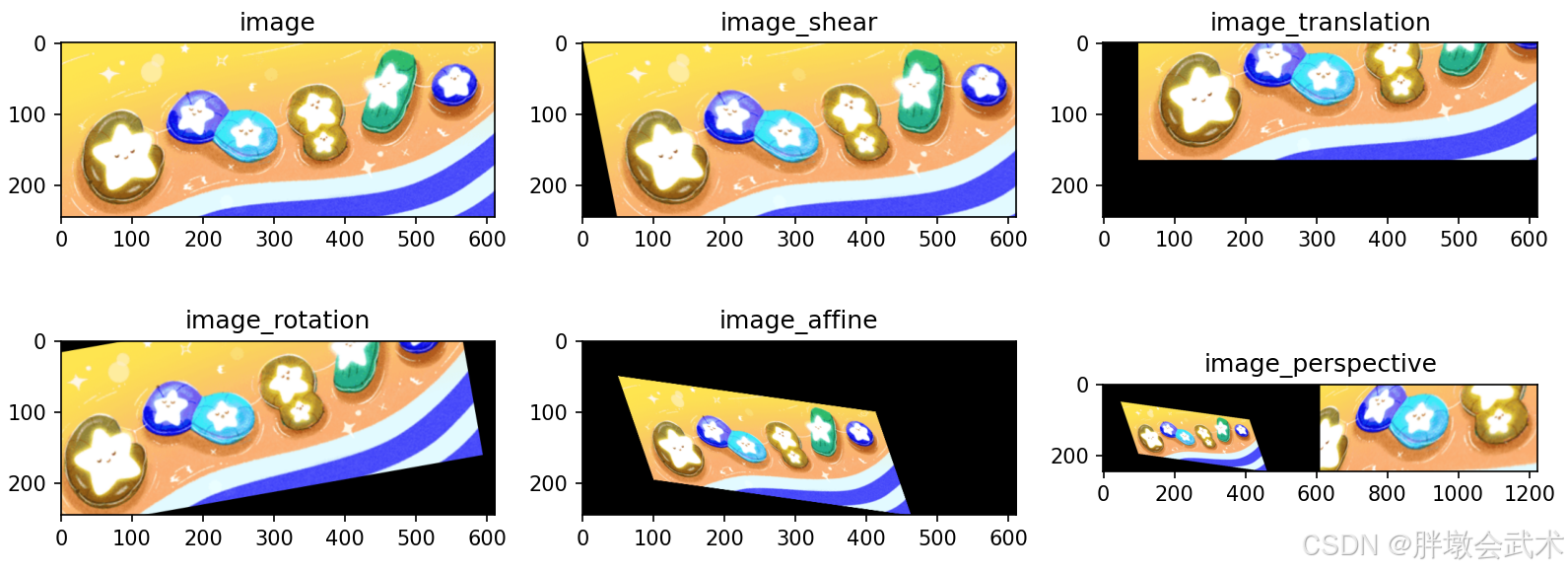

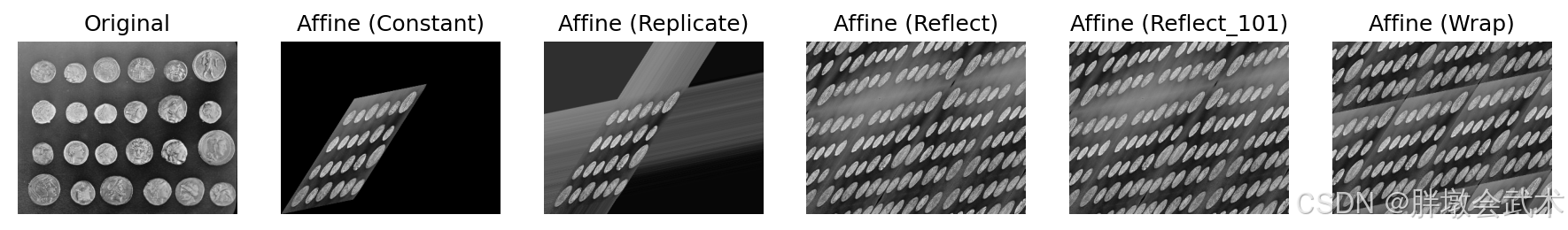

- (6)图像错切 + 图像平移 + 图像旋转 + 仿射变换 + 透视变换 —— np.float32() + cv2.getRotationMatrix2D() + cv2.getAffineTransform() + cv2.getPerspectiveTransform() + cv2.warpAffine() + cv2.warpPerspective()

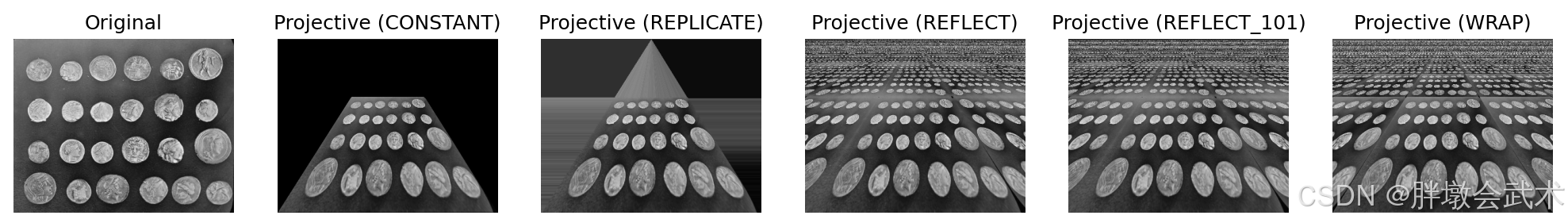

- (7)投影变换

博主精品专栏导航

第三章、项目实战

(一)银行卡号识别 —— cv2.morphologyEx()、cv2.getStructuringElement()、cv2.threshold()、cv2.findContours()、cv2.drawContours()、cv2.boundingRect()

数据下载:模板图像+银行卡图像

银行卡号识别的详细步骤

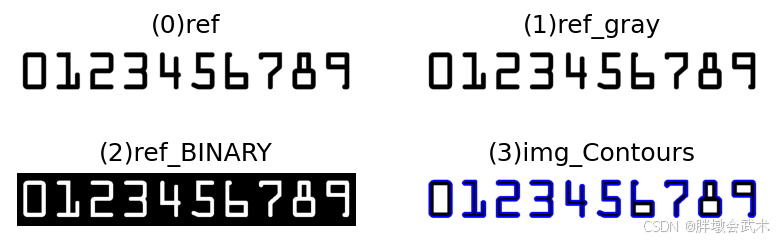

- (1)提取模板图像中每个数字(0~9)

- 11、读取模板图像、灰度化、二值化

- 22、轮廓检测、绘制轮廓、轮廓排序

- 33、提取模板图像的所有轮廓(每一个数字)

- (2)提取银行卡的所有轮廓

- 11、读取卡图像、灰度化、顶帽运算、sobel算子、闭运算、二值化、二次膨胀+腐蚀

- 22、轮廓检测、绘制轮廓

- (3)提取银行卡《四个数字一组》轮廓,然后每个轮廓与模板的每一个数字进行匹配,得到最大匹配结果,并在原图上绘制结果

- 11、在所有轮廓中,识别出《四个数字一组》的轮廓(共有四个),并进行阈值化、轮廓检测和轮廓排序

- 22、在《四个数字一组》中,提取每个数字的轮廓以及坐标,并进行模板匹配得到最大匹配结果

- 33、在原图像上,用矩形画出《四个数字一组》,并在原图上显示所有的匹配结果

备注:传统图像处理的硬伤,需要根据实际情况(不同类型的银行卡)调整处理策略。

import numpy as np

import cv2 # opencv读取图像默认为BGR

import matplotlib.pyplot as plt # matplotlib显示图像默认为RGB

def sort_contours(cnt_s, method="left-to-right"):

"""排序轮廓(从左到右或者从上到下)"""

reverse = False

ii_myutils = 0

# 判断排序方式

if method == "right-to-left" or method == "bottom-to-top":

reverse = True

if method == "top-to-bottom" or method == "bottom-to-top":

ii_myutils = 1

# 获取每个轮廓的外接矩形,并按指定方向排序

bounding_boxes = [cv2.boundingRect(cc_myutils) for cc_myutils in cnt_s]

(cnt_s, bounding_boxes) = zip(*sorted(zip(cnt_s, bounding_boxes), key=lambda b: b[1][ii_myutils], reverse=reverse))

return cnt_s, bounding_boxes

def resize(image, width=None, height=None, inter=cv2.INTER_AREA):

"""调整图像尺寸"""

dim_myutils = None

(h_myutils, w_myutils) = image.shape[:2]

# 若没有指定宽度或高度,直接返回原图像

if width is None and height is None:

return image

if width is None:

r_myutils = height / float(h_myutils)

dim_myutils = (int(w_myutils * r_myutils), height)

else:

r_myutils = width / float(w_myutils)

dim_myutils = (width, int(h_myutils * r_myutils))

resized = cv2.resize(image, dim_myutils, interpolation=inter)

return resized

def extract_template(image):

"""(1)提取模板图像中每个数字(0~9)"""

ref_gray = cv2.cvtColor(image, cv2.COLOR_BGR2GRAY) # 灰度化图像

ref_BINARY = cv2.threshold(ref_gray, 10, 255, cv2.THRESH_BINARY_INV)[1] # 二值化图像

refCnts, hierarchy = cv2.findContours(ref_BINARY.copy(), cv2.RETR_EXTERNAL, cv2.CHAIN_APPROX_SIMPLE) # 找到轮廓

####################################################################################################

img_Contours = image.copy()

cv2.drawContours(img_Contours, refCnts, -1, (0, 0, 255), 3) # 绘制轮廓

# 绘制图像

plt.subplot(221), plt.imshow(image, 'gray'), plt.title('(0)ref'), plt.axis('off')

plt.subplot(222), plt.imshow(ref_gray, 'gray'), plt.title('(1)ref_gray'), plt.axis('off')

plt.subplot(223), plt.imshow(ref_BINARY, 'gray'), plt.title('(2)ref_BINARY'), plt.axis('off')

plt.subplot(224), plt.imshow(img_Contours, 'gray'), plt.title('(3)img_Contours'), plt.axis('off')

plt.show()

####################################################################################################

# 排序所有轮廓(从左到右,从上到下)

refCnts = sort_contours(refCnts, method="left-to-right")[0]

# 提取所有轮廓

digits = {} # 保存每个模板的数字

for (index, region) in enumerate(refCnts):

(x, y, width, height) = cv2.boundingRect(region) # 得到轮廓(数字)的外接矩形的左上角的(x, y)坐标、宽度和长度

roi = ref_BINARY[y:y + height, x:x + width] # 获得外接矩形的坐标

roi = cv2.resize(roi, (57, 88)) # 将感兴趣区域的图像(数字)resize相同的大小

digits[index] = roi

return digits

def extract_card(image):

"""(2)提取银行卡的所有轮廓"""

rect_Kernel = cv2.getStructuringElement(cv2.MORPH_RECT, (9, 3))

square_Kernel = cv2.getStructuringElement(cv2.MORPH_RECT, (5, 5))

image_tophat = cv2.morphologyEx(image_gray, cv2.MORPH_TOPHAT, rect_Kernel) # 礼帽运算 ———— 用于突出亮区域

image_gradx = cv2.Sobel(image_tophat, ddepth=cv2.CV_32F, dx=1, dy=0, ksize=-1) # 求x方向上的梯度

image_gradx = np.absolute(image_gradx) # 计算x方向上的梯度

(minVal, maxVal) = (np.min(image_gradx), np.max(image_gradx)) # 计算最大最小边界差值

image_gradx = (255 * ((image_gradx - minVal) / (maxVal - minVal))) # 归一化处理(0~1)

image_gradx = image_gradx.astype("uint8") # 数据类型转换

# 闭运算(先膨胀,再腐蚀)———— 将银行卡分成四个部分,每个部分的四个数字连在一起

image_CLOSE = cv2.morphologyEx(image_gradx, cv2.MORPH_CLOSE, square_Kernel)

image_thresh = cv2.threshold(image_CLOSE, 0, 255, cv2.THRESH_BINARY | cv2.THRESH_OTSU)[1] # 阈值分割

# (二次)闭运算 ———— 将四个连在一起的数字进行填充形成一个整体。

image_2_dilate = cv2.dilate(image_thresh, square_Kernel, iterations=2) # 膨胀(迭代次数2次)

image_1_erode = cv2.erode(image_2_dilate, square_Kernel, iterations=1) # 腐蚀(迭代次数1次)

image_2_CLOSE = image_1_erode

threshCnts, hierarchy = cv2.findContours(image_2_CLOSE.copy(), cv2.RETR_EXTERNAL, cv2.CHAIN_APPROX_SIMPLE) # 轮廓检测

####################################################################################################

image_Contours = image.copy()

cv2.drawContours(image_Contours, threshCnts, -1, (0, 0, 255), 3) # 绘制轮廓

# 绘制图像

plt.subplot(241), plt.imshow(cv2.cvtColor(image, cv2.COLOR_BGR2RGB)), plt.title('(0)image_card'), plt.axis('off')

plt.subplot(242), plt.imshow(cv2.cvtColor(image_gray, cv2.COLOR_BGR2RGB)), plt.title('(1)image_gray'), plt.axis('off')

plt.subplot(243), plt.imshow(cv2.cvtColor(image_tophat, cv2.COLOR_BGR2RGB)), plt.title('(2)image_tophat'), plt.axis('off')

plt.subplot(244), plt.imshow(cv2.cvtColor(image_gradx, cv2.COLOR_BGR2RGB)), plt.title('(3)image_gradx'), plt.axis('off')

plt.subplot(245), plt.imshow(cv2.cvtColor(image_CLOSE, cv2.COLOR_BGR2RGB)), plt.title('(4)image_CLOSE'), plt.axis('off')

plt.subplot(246), plt.imshow(cv2.cvtColor(image_thresh, cv2.COLOR_BGR2RGB)), plt.title('(5)image_thresh'), plt.axis('off')

plt.subplot(247), plt.imshow(cv2.cvtColor(image_2_CLOSE, cv2.COLOR_BGR2RGB)), plt.title('(6)image_2_CLOSE'), plt.axis('off')

plt.subplot(248), plt.imshow(cv2.cvtColor(image_Contours, cv2.COLOR_BGR2RGB)), plt.title('(7)image_Contours'), plt.axis('off')

plt.show()

####################################################################################################

return threshCnts

def extract_digits(image_gray, threshCnts, digits):

"""3311、识别出四个数字一组的所有轮廓(理论上是四个)"""

locs = [] # 保存四个数字一组的轮廓坐标

for (index, region) in enumerate(threshCnts): # 遍历轮廓

(x, y, wight, height) = cv2.boundingRect(region) # 计算矩形

ar = wight / float(height) # (四个数字一组)的长宽比

# 匹配(四个数字为一组)轮廓的大小 ———— 根据实际图像调整

if 2.0 < ar < 4.0:

if (35 < wight < 60) and (10 < height < 20):

locs.append((x, y, wight, height))

locs = sorted(locs, key=lambda x: x[0]) # 排序(从左到右)

"""3322、在四个数字一组中,提取每个数字的轮廓坐标并进行模板匹配"""

output_all_group = [] # 保存(所有组)匹配结果

for (ii, (gX, gY, gW, gH)) in enumerate(locs):

"""遍历银行卡的每个组(理论上是四组)"""

image_group = image_gray[gY - 5:gY + gH + 5, gX - 5:gX + gW + 5] # 坐标索引每个组图像,并将每个轮廓的结果放大一些,避免信息丢失

image_group_threshold = cv2.threshold(image_group, 0, 255, cv2.THRESH_BINARY | cv2.THRESH_OTSU)[1] # 二值化处理

digitCnts, hierarchy = cv2.findContours(image_group_threshold, cv2.RETR_EXTERNAL, cv2.CHAIN_APPROX_SIMPLE) # 获取轮廓

digitCnts_sort = sort_contours(digitCnts, method="left-to-right")[0] # 排序

"""遍历每个组中的每个数字(理论上每个组是四个数字)"""

output_group = [] # 保存(每个组)匹配结果

for jj in digitCnts_sort:

(x, y, wight, height) = cv2.boundingRect(jj) # 获取数字的轮廓

image_digit = image_group[y:y + height, x:x + wight] # 获取数字的坐标

image_digit = cv2.resize(image_digit, (57, 88)) # 图像缩放(保持与模板图像中的数字图像一致)

cv2.imshow("Image", image_digit)

cv2.waitKey(200) # 延迟200ms

"""遍历模板图像的每个数字,并计算(轮廓数字)和(模板数字)匹配分数(理论上模板的十个数字))"""

scores = [] # 计算匹配分数:(轮廓中的数字)和(模板中的数字)

for (kk, digitROI) in digits.items():

result = cv2.matchTemplate(image_digit, digitROI, cv2.TM_CCOEFF)

(_, max_score, _, _) = cv2.minMaxLoc(result) # max_score表示最大值

scores.append(max_score)

output_group.append(str(np.argmax(scores))) # 将最大匹配分数对应的数字保存下来

# 在绘制矩形 ———— 在原图上,用矩形将" 四个数字一组 "画出来(理论上共有四个矩形,对应四个组)

cv2.rectangle(image_resize, (gX - 5, gY - 5), (gX + gW + 5, gY + gH + 5), (0, 0, 255), 1)

cv2.putText(image_resize, "".join(output_group), (gX, gY - 15), cv2.FONT_HERSHEY_SIMPLEX, 0.65, (0, 0, 255), 2)

output_all_group.extend(output_group)

return "".join(output_all_group)

if __name__ == "__main__":

"""11、提取模板图像中每个数字模板(0~9)"""

image_template = cv2.imread(r'ocr_a_reference.png')

digits = extract_template(image_template)

"""22、提取信用卡的所有轮廓"""

image_card = cv2.imread(r'credit_card_01.png')

image_resize = resize(image_card, width=300)

image_gray = cv2.cvtColor(image_resize, cv2.COLOR_BGR2GRAY)

threshCnts = extract_card(image_resize)

"""33、提取银行卡" 四个数字一组 "轮廓,然后每个轮廓与模板的每一个数字进行匹配,得到最大匹配结果,并在原图上绘制结果"""

result = extract_digits(image_gray, threshCnts, digits)

print(f"识别结果: {result}")

cv2.imshow("Image", image_resize)

cv2.waitKey(0)

# -*- coding: utf-8 -*-

# 作者: 胖墩会武术

# 日期: 1994-08-21

# OpenCV图像处理: https://blog.csdn.net/shinuone/article/details/126022763

深究 Pycharm shadows name ‘xxxx’ from outer scope 警告

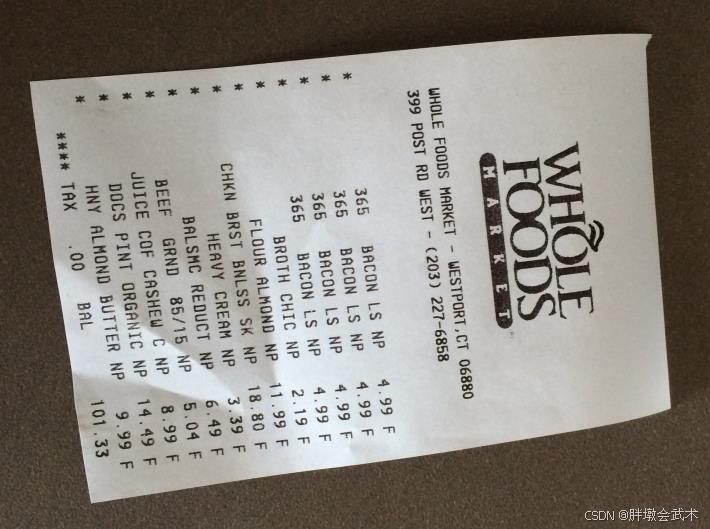

(二)文档扫描与OCR识别 —— cv2.getPerspectiveTransform()、cv2.warpPerspective()

在进行 OCR 之前,通常会进行一些图像预处理,如去噪、二值化等,来提高识别准确性。

import numpy as np

import cv2 # opencv 读取图像默认为BGR

import matplotlib.pyplot as plt # matplotlib显示图像默认为RGB

def order_points(pts):

"""对输入的四个点进行排序,返回左上、右上、右下、左下的顺序"""

rect = np.zeros((4, 2), dtype="float32")

# 按顺序找到对应坐标:左上、右上、右下、左下

s = pts.sum(axis=1)

rect[0] = pts[np.argmin(s)] # 左上

rect[2] = pts[np.argmax(s)] # 右下

diff = np.diff(pts, axis=1)

rect[1] = pts[np.argmin(diff)] # 右上

rect[3] = pts[np.argmax(diff)] # 左下

return rect

def four_point_transform(image, pts):

"""执行四点透视变换,得到矩形的透视图"""

rect = order_points(pts)

(tl, tr, br, bl) = rect

# 计算最大宽度和高度

widthA = np.sqrt(((br[0] - bl[0]) ** 2) + ((br[1] - bl[1]) ** 2))

widthB = np.sqrt(((tr[0] - tl[0]) ** 2) + ((tr[1] - tl[1]) ** 2))

maxWidth = max(int(widthA), int(widthB))

heightA = np.sqrt(((tr[0] - br[0]) ** 2) + ((tr[1] - br[1]) ** 2))

heightB = np.sqrt(((tl[0] - bl[0]) ** 2) + ((tl[1] - bl[1]) ** 2))

maxHeight = max(int(heightA), int(heightB))

# 变换后的目标坐标

dst = np.array([[0, 0], [maxWidth - 1, 0], [maxWidth - 1, maxHeight - 1], [0, maxHeight - 1]], dtype="float32")

# 计算齐次变换矩阵

M = cv2.getPerspectiveTransform(rect, dst)

# 执行透视变换

warped = cv2.warpPerspective(image, M, (maxWidth, maxHeight))

return warped

def generate_sample_image():

"""创建一个简单的图像模拟收据或文档"""

image = np.ones((600, 500, 3), dtype=np.uint8) * 255 # 创建一个白色背景的图像

pts = np.array([[50, 100], [450, 100], [400, 500], [100, 500]], np.int32) # 定义一个多边形

pts = pts.reshape((-1, 1, 2))

# 填充多边形的内部为红色

cv2.fillPoly(image, [pts], (0, 0, 255))

# 添加一些斜体文本,确保它们位于多边形内部

font = cv2.FONT_HERSHEY_SIMPLEX # 使用普通字体

cv2.putText(image, 'Sample Receipt', (150, 200), font, 1, (255, 255, 255), 2, cv2.LINE_AA) # 白色文本

cv2.putText(image, 'Total: $123.45', (180, 450), font, 1, (255, 255, 255), 2, cv2.LINE_AA) # 白色文本

return image

if __name__ == '__main__':

# input_image = generate_sample_image() # 生成图像

input_image = cv2.imread(r'receipt2.jpg') # 读取图像

cv2.imshow("image", input_image)

cv2.waitKey(0)

cv2.destroyAllWindows()

ratio = input_image.shape[0] / 500.0 # 记录图像的缩放比例

original_image = input_image.copy()

input_image = cv2.resize(original_image, (int(original_image.shape[1] * 500.0 / original_image.shape[0]), 500))

# 图像预处理:灰度化 + 高斯模糊 + 边缘检测

gray_image = cv2.cvtColor(input_image, cv2.COLOR_BGR2GRAY)

gray_image = cv2.GaussianBlur(gray_image, (5, 5), 0)

edge_detected_image = cv2.Canny(gray_image, 75, 200)

# 轮廓检测

contours, _ = cv2.findContours(edge_detected_image.copy(), cv2.RETR_LIST, cv2.CHAIN_APPROX_SIMPLE)

contours = sorted(contours, key=cv2.contourArea, reverse=True)[:5]

# 提取具有四个角的轮廓

for contour in contours:

perimeter = cv2.arcLength(contour, True)

approx_contour = cv2.approxPolyDP(contour, 0.02 * perimeter, True)

if len(approx_contour) == 4:

contour_approx = approx_contour

break

# 在原图上画出检测得到的轮廓

cv2.drawContours(input_image, [contour_approx], -1, (0, 255, 0), 2)

# 透视变换:从原图中提取文档区域

perspective_transformed_image = four_point_transform(original_image, contour_approx.reshape(4, 2) * ratio)

perspective_transformed_image = cv2.cvtColor(perspective_transformed_image, cv2.COLOR_BGR2GRAY)

scanned_document = cv2.threshold(perspective_transformed_image, 100, 255, cv2.THRESH_BINARY)[1]

scanned_document = cv2.resize(scanned_document, (int(scanned_document.shape[1] * 500.0 / scanned_document.shape[0]), 500))

# 使用Matplotlib显示图像

original_rgb = cv2.cvtColor(original_image, cv2.COLOR_BGR2RGB)

edge_detected_rgb = cv2.cvtColor(edge_detected_image, cv2.COLOR_BGR2RGB)

input_rgb = cv2.cvtColor(input_image, cv2.COLOR_BGR2RGB)

scanned_rgb = cv2.cvtColor(scanned_document, cv2.COLOR_BGR2RGB)

plt.subplot(1, 4, 1), plt.imshow(original_rgb), plt.title('Original'), plt.gca().get_xaxis().set_visible(False), plt.gca().get_yaxis().set_visible(False)

plt.subplot(1, 4, 2), plt.imshow(edge_detected_rgb), plt.title('Edged'), plt.gca().get_xaxis().set_visible(False), plt.gca().get_yaxis().set_visible(False)

plt.subplot(1, 4, 3), plt.imshow(input_rgb), plt.title('Contour'), plt.gca().get_xaxis().set_visible(False), plt.gca().get_yaxis().set_visible(False)

plt.subplot(1, 4, 4), plt.imshow(scanned_rgb), plt.title('Scanned'), plt.gca().get_xaxis().set_visible(False), plt.gca().get_yaxis().set_visible(False)

plt.show()

# -*- coding: utf-8 -*-

# 作者: 胖墩会武术

# 日期: 1994-08-21

# OpenCV图像处理: https://blog.csdn.net/shinuone/article/details/126022763

要实现文档扫描并进行 OCR(光学字符识别),需要安装Tesseract,Tesseract 是一个非常流行的开源 OCR 引擎,用于提取图像中的文本。共需要安装以下两个组件:

- (1)Tesseract 引擎:这是 OCR 引擎本身。你需要在操作系统中安装它。官网安装教程:tesseract-ocr/tesseract

- (2)Pytesseract:这是 Tesseract 的 Python 包装器,用于与 Tesseract 引擎交互。

pip install pytesseract

以下是一个简单的 OCR 示例,展示如何用 pytesseract 对图像进行 OCR 识别:

import cv2

import pytesseract

# 设置 tesseract 可执行文件的路径(如果已安装并且路径不在环境变量中)

# 对于 Windows 用户,可能需要设置 tesseract.exe 的完整路径

# pytesseract.pytesseract.tesseract_cmd = r'C:\Program Files\Tesseract-OCR\tesseract.exe'

image = cv2.imread('path_to_your_image.jpg')

gray_image = cv2.cvtColor(image, cv2.COLOR_BGR2GRAY) # 将图像转为灰度图,增加 OCR 识别的准确性

text = pytesseract.image_to_string(gray_image) # 使用 OCR 进行识别

print(f"识别的文本内容:{text}")

(三)答题卡识别与判卷 —— cv2.putText()、cv2.countNonZero()

import numpy as np

import cv2 # opencv读取图像默认为BGR

import matplotlib.pyplot as plt # matplotlib显示图像默认为RGB

def order_points(pts):

# 一共4个坐标点

rect = np.zeros((4, 2), dtype="float32")

# 按顺序找到对应坐标0123分别是 左上,右上,右下,左下

# 计算左上,右下

s = pts.sum(axis=1)

rect[0] = pts[np.argmin(s)]

rect[2] = pts[np.argmax(s)]

# 计算右上和左下

diff = np.diff(pts, axis=1)

rect[1] = pts[np.argmin(diff)]

rect[3] = pts[np.argmax(diff)]

return rect

def four_point_transform(image, pts):

# 获取输入坐标点

rect = order_points(pts)

(tl, tr, br, bl) = rect

# 计算输入的w和h值

widthA = np.sqrt(((br[0] - bl[0]) ** 2) + ((br[1] - bl[1]) ** 2))

widthB = np.sqrt(((tr[0] - tl[0]) ** 2) + ((tr[1] - tl[1]) ** 2))

maxWidth = max(int(widthA), int(widthB))

heightA = np.sqrt(((tr[0] - br[0]) ** 2) + ((tr[1] - br[1]) ** 2))

heightB = np.sqrt(((tl[0] - bl[0]) ** 2) + ((tl[1] - bl[1]) ** 2))

maxHeight = max(int(heightA), int(heightB))

# 变换后对应坐标位置

dst = np.array([[0, 0], [maxWidth - 1, 0], [maxWidth - 1, maxHeight - 1], [0, maxHeight - 1]], dtype="float32")

# 计算变换矩阵

M = cv2.getPerspectiveTransform(rect, dst) # 计算齐次变换矩阵:cv2.getPerspectiveTransform(rect, dst)

warped = cv2.warpPerspective(image, M, (maxWidth, maxHeight)) # 透视变换:(将输入矩形乘以(齐次变换矩阵),得到输出矩阵)

return warped

def sort_contours(cnts, method="left-to-right"):

reverse = False

i = 0

if method == "right-to-left" or method == "bottom-to-top":

reverse = True

if method == "top-to-bottom" or method == "bottom-to-top":

i = 1

boundingBoxes = [cv2.boundingRect(c) for c in cnts]

(cnts, boundingBoxes) = zip(*sorted(zip(cnts, boundingBoxes), key=lambda b: b[1][i], reverse=reverse))

return cnts, boundingBoxes

# 需给定每张图像对应选项的正确答案(字典:键对应行,值对应每行的答案)

ANSWER_KEY = {0: 1, 1: 4, 2: 0, 3: 3, 4: 1}

# 图像预处理

image = cv2.imread(r"images/test_01.png")

contours_img = image.copy()

gray = cv2.cvtColor(image, cv2.COLOR_BGR2GRAY) # 转换为灰度图

blurred = cv2.GaussianBlur(gray, (5, 5), 0) # 高斯滤波-去除噪音

edged = cv2.Canny(blurred, 75, 200) # Canny算子边缘检测

cnts, hierarchy = cv2.findContours(edged.copy(), cv2.RETR_EXTERNAL, cv2.CHAIN_APPROX_SIMPLE) # 轮廓检测

cv2.drawContours(contours_img, cnts, -1, (0, 0, 255), 3) # 画出轮廓(答题卡)

###################################################################

# 提取答题卡并进行透视变化

docCnt = None

if len(cnts) > 0:

cnts = sorted(cnts, key=cv2.contourArea, reverse=True) # 根据轮廓大小进行排序

for c in cnts: # 遍历每一个轮廓

peri = cv2.arcLength(c, True) # 计算轮廓的长度

approx = cv2.approxPolyDP(c, 0.02*peri, True) # 找出轮廓的多边形拟合曲线

if len(approx) == 4: # 找到的轮廓是四边形(对应四个顶点)

docCnt = approx

break

warped = four_point_transform(gray, docCnt.reshape(4, 2)) # 透视变换(齐次变换矩阵)

warped1 = warped.copy()

thresh = cv2.threshold(warped, 0, 255, cv2.THRESH_BINARY_INV | cv2.THRESH_OTSU)[1] # 0:表示系统自动判断;THRESH_OTSU:自适应阈值设置

###############################

thresh_Contours = thresh.copy()

cnts, hierarchy = cv2.findContours(thresh.copy(), cv2.RETR_EXTERNAL, cv2.CHAIN_APPROX_SIMPLE) # 找到每一个圆圈轮廓

cv2.drawContours(thresh_Contours, cnts, -1, (0, 0, 255), 3) # 画出所有轮廓

###################################################################

# 提取答题卡中所有的有效选项(圆圈)

questionCnts = [] # 提取每个选项的轮廓

for c in cnts:

(x, y, w, h) = cv2.boundingRect(c) # 获取轮廓的尺寸

ar = w / float(h) # 计算比例

if w >= 20 and h >= 20 and 0.9 <= ar <= 1.1: # 自定义设置大小(根据实际情况)

questionCnts.append(c)

questionCnts = sort_contours(questionCnts, method="top-to-bottom")[0] # 按照从上到下对所有的选项进行排序

###############################

correct = 0

for (q, i) in enumerate(np.arange(0, len(questionCnts), 5)): # 每排有5个选项

cnts = sort_contours(questionCnts[i:i + 5])[0] # 对每一排进行排序

bubbled = None

for (j, c) in enumerate(cnts): # 遍历每一排对应的五个结果

mask = np.zeros(thresh.shape, dtype="uint8") # 使用mask来判断结果(全黑:0)表示涂写答案正确

cv2.drawContours(mask, [c], -1, 255, -1) # -1表示填充

# cv_show('mask', mask) # 展示每个选项

mask = cv2.bitwise_and(thresh, thresh, mask=mask) # mask=mask表示要提取的区域(可选参数)

total = cv2.countNonZero(mask) # 通过计算非零点数量来算是否选择这个答案

if bubbled is None or total > bubbled[0]: # 记录最大数

bubbled = (total, j)

color = (0, 0, 255) # 对比正确答案

k = ANSWER_KEY[q]

# 判断正确

if k == bubbled[1]:

color = (0, 255, 0)

correct += 1

cv2.drawContours(warped, [cnts[k]], -1, color, 3) # 画出轮廓

###################################################################

# 展示结果

score = (correct / 5.0) * 100 # 计算总得分

print("[INFO] score: {:.2f}%".format(score))

cv2.putText(warped, "{:.1f}%".format(score), (10, 30), cv2.FONT_HERSHEY_SIMPLEX, 0.9, (0, 0, 255), 2)

image = cv2.cvtColor(image, cv2.COLOR_BGR2RGB) # opencv读取的格式是BGR,Matplotlib是RGB

contours_img = cv2.cvtColor(contours_img, cv2.COLOR_BGR2RGB)

plt.subplot(241), plt.imshow(image, cmap='gray'), plt.axis('off'), plt.title('image')

plt.subplot(242), plt.imshow(blurred, cmap='gray'), plt.axis('off'), plt.title('cv2.GaussianBlur')

plt.subplot(243), plt.imshow(edged, cmap='gray'), plt.axis('off'), plt.title('cv2.Canny')

plt.subplot(244), plt.imshow(contours_img, cmap='gray'), plt.axis('off'), plt.title('cv2.findContours')

plt.subplot(245), plt.imshow(warped1, cmap='gray'), plt.axis('off'), plt.title('cv2.warpPerspective')

plt.subplot(246), plt.imshow(thresh_Contours, cmap='gray'), plt.axis('off'), plt.title('cv2.findContours')

plt.subplot(247), plt.imshow(warped, cmap='gray'), plt.axis('off'), plt.title('cv2.warpPerspective')

plt.show()

# -*- coding: utf-8 -*-

# 作者: 胖墩会武术

# 日期: 1994-08-21

# OpenCV图像处理: https://blog.csdn.net/shinuone/article/details/126022763

(四)全景拼接 —— detectAndDescribe()、matchKeypoints()、cv2.findHomography()、cv2.warpPerspective()、drawMatches()

将多张具有重叠区域的图像拼接为一张无缝的全景图

import cv2

import numpy as np

class Stitcher:

def __init__(self, feature_detector='SIFT'):

# 支持不同的特征检测器

if feature_detector == 'ORB':

self.descriptor = cv2.ORB_create()

self.matcher_type = cv2.NORM_HAMMING # ORB 的匹配类型为 NORM_HAMMING

elif feature_detector == 'AKAZE':

self.descriptor = cv2.AKAZE_create()

self.matcher_type = cv2.NORM_HAMMING

else:

self.descriptor = cv2.xfeatures2d.SIFT_create()

self.matcher_type = cv2.NORM_L2 # SIFT 的匹配类型为 NORM_L2

def stitch(self, images, ratio=0.75, reprojThresh=4.0, showMatches=False):

(imageB, imageA) = images

(kpsA, featuresA) = self.detectAndDescribe(imageA)

(kpsB, featuresB) = self.detectAndDescribe(imageB)

# 检查特征描述符是否有效

if featuresA is None or featuresB is None:

print("特征点描述符无效,无法继续拼接。")

return None

M = self.matchKeypoints(kpsA, kpsB, featuresA, featuresB, ratio, reprojThresh)

if M is None:

return None

(matches, H, status) = M

image_perspective = cv2.warpPerspective(imageA, H, (imageA.shape[1] + imageB.shape[1], imageA.shape[0]))

image_comparison = image_perspective.copy()

image_comparison[0:imageB.shape[0], 0:imageB.shape[1]] = imageB

if showMatches:

image_matches = self.drawMatches(imageA, imageB, kpsA, kpsB, matches, status)

return (image_matches, image_perspective, image_comparison)

return image_perspective

def detectAndDescribe(self, image):

# gray = cv2.cvtColor(image, cv2.COLOR_BGR2GRAY) # 将彩色图片转换成灰度图

descriptor = cv2.xfeatures2d.SIFT_create() # 建立SIFT生成器

"""############################################################################

# 若OpenCV3.X,则用cv2.xfeatures2d.SIFT_create方法来实现DoG关键点检测和SIFT特征提取。

# 若OpenCV2.4,则用cv2.FeatureDetector_create方法来实现关键点的检测(DoG)。

############################################################################"""

(kps, features) = descriptor.detectAndCompute(image, None) # 检测SIFT特征点,并计算描述子

kps = np.float32([kp.pt for kp in kps]) # 将结果转换成NumPy数组

return (kps, features) # 返回特征点集,及对应的描述特征

def matchKeypoints(self, kpsA, kpsB, featuresA, featuresB, ratio, reprojThresh):

matcher = cv2.BFMatcher()

rawMatches = matcher.knnMatch(featuresA, featuresB, 2)

matches = []

for m in rawMatches:

if len(m) == 2 and m[0].distance < m[1].distance * ratio:

matches.append((m[0].trainIdx, m[0].queryIdx))

if len(matches) > 4:

ptsA = np.float32([kpsA[i] for (_, i) in matches])

ptsB = np.float32([kpsB[i] for (i, _) in matches])

(H, status) = cv2.findHomography(ptsA, ptsB, cv2.RANSAC, reprojThresh)

return (matches, H, status)

return None

def drawMatches(self, imageA, imageB, kpsA, kpsB, matches, status):

(hA, wA) = imageA.shape[:2]

(hB, wB) = imageB.shape[:2]

vis = np.zeros((max(hA, hB), wA + wB, 3), dtype="uint8")

vis[0:hA, 0:wA] = imageA

vis[0:hB, wA:] = imageB

for ((trainIdx, queryIdx), s) in zip(matches, status):

if s == 1:

ptA = (int(kpsA[queryIdx][0]), int(kpsA[queryIdx][1]))

ptB = (int(kpsB[trainIdx][0]) + wA, int(kpsB[trainIdx][1]))

cv2.line(vis, ptA, ptB, (0, 255, 0), 1)

return vis

if __name__ == '__main__':

imageA = cv2.imread('../image/scene_left.jpg')

imageB = cv2.imread('../image/scene_right.jpg')

stitcher = Stitcher(feature_detector='ORB') # 使用ORB特征

(image_matches, image_perspective, image_comparison) = stitcher.stitch([imageA, imageB], showMatches=True)

if image_comparison is not None:

cv2.imshow("image_left", imageA)

cv2.imshow("image_right", imageB)

cv2.imshow("image_matches", image_matches)

cv2.imshow("image_perspective", image_perspective)

cv2.imshow("image_comparison", image_comparison)

cv2.waitKey(0)

cv2.destroyAllWindows()

else:

print("拼接失败。")

# -*- coding: utf-8 -*-

# 作者: 胖墩会武术

# 日期: 1994-08-21

# OpenCV图像处理: https://blog.csdn.net/shinuone/article/details/126022763

(五)图像分类(DNN) —— cv2.dnn.blobFromImage()、cv2.dnn.blobFromImages()

import utils_paths

import numpy as np

import cv2

##################################################################

# 提取标签文件中每一行的内容

# (1)训练模型标签文件:"synset_words.txt"

# (2)使用open().read() :打开并读取txt文件中所有的字符串

# (3)strip() :删除字符串两端的空格

# (4)split('\n') :提取每一行的内容

rows = open("synset_words.txt").read().strip().split("\n")

##################################################################

# 提取出每行第一个空格后的字符串

# (1)对每一行的内容进行遍历,遍历之后找每一行的空格(r.find(' '))。

# (2)找到位置后让位置+1,然后r提取到+1的位置一直到最后

# (3)以所有逗号为分隔符然后删除他们,取分割的第一个值

classes = [r[r.find(" ") + 1:].split(",")[0] for r in rows]

##################################################################

# 加载Caffe所需文件

# (1)配置文件:"bvlc_googlenet.prototxt"

# (2)训练好的权重参数:"bvlc_googlenet.caffemodel"

net = cv2.dnn.readNetFromCaffe("bvlc_googlenet.prototxt", "bvlc_googlenet.caffemodel")

##################################################################

# 读取图像路径

# (1)utils_paths.py中的list_images()是提取images文件夹中所有图片的绝对路径,

# (2)将所有绝对路径作为元素组成迭代器

# (3)使用sorted()进行排序。 这个是字符串之间的排序:先比首字母,再比第二个字母,都相同时比长度。

imagePaths = sorted(list(utils_paths.list_images("images/")))

##################################################################

# (单个)图像预测

image = cv2.imread(imagePaths[0]) # 先读取第0张图片

resized = cv2.resize(image, (224, 224)) # 保持训练模型与测试模型数据大小相同

blob = cv2.dnn.blobFromImage(resized, 1, (224, 224), (104, 117, 123))

print("First Blob: {}".format(blob.shape))

net.setInput(blob) # 输入数据

preds = net.forward() # 前向传播得到结果(向量形式)

# 排序,取分类可能性最大的 ———— 该Imagenet是一个千分类模型,它会有1000个值对应1000个分类的概率

# np.argsort()是从小到大排序,故逆序[::-1],然后取第一个值(最大值的索引)

idx = np.argsort(preds[0])[::-1][0]

# 获取要写的内容:(1)该索引对应的标签值(2)pred[0]的值,乘以100,然后保留其两位小数,最后在后面加个百分号

text = "Label: {}, {:.2f}%".format(classes[idx], preds[0][idx] * 100)

# 将要写的内容写在未经处理的图片上

cv2.putText(image, text, (5, 25), cv2.FONT_HERSHEY_SIMPLEX, 0.7, (0, 0, 255), 2)

# 显示预测结果

cv2.imshow("Image", image)

cv2.waitKey(0)

##################################################################

##################################################################

# 预测(其余的所有图) ———— 方法与上述一样,但数据是一个batch。

images = [] # 定义一个空列表存图

# 处理除第0张外的所有图片

for p in imagePaths[1:]:

image = cv2.imread(p)

image = cv2.resize(image, (224, 224))

images.append(image)

blob = cv2.dnn.blobFromImages(images, 1, (224, 224), (104, 117, 123))

print("Second Blob: {}".format(blob.shape))

net.setInput(blob) # 输入数据

preds = net.forward() # 前向传播得到结果(向量形式)

# 首先读进来图,之后找到对应预测结果中最大的,然后写上标签与概率

for (i, p) in enumerate(imagePaths[1:]): # i是序号,p是图片路径

image = cv2.imread(p)

idx = np.argsort(preds[i])[::-1][0]

text = "Label: {}, {:.2f}%".format(classes[idx], preds[i][idx] * 100)

cv2.putText(image, text, (5, 25), cv2.FONT_HERSHEY_SIMPLEX, 0.7, (0, 0, 255), 2)

cv2.imshow("Image", image)

cv2.waitKey(0)

"""#####################################################################################################################

# 函数功能:将单张图像转换为 blob 格式。

# 函数说明:cv2.dnn.blobFromImage(image, scalefactor=1.0, size=(0, 0), mean=(0, 0, 0), swapRB=True, crop=False)

# 参数说明:

# image:输入的图像,可以是 numpy 数组,通常是 cv2.imread() 加载的图像。

# scalefactor:缩放因子,图像像素值会乘以该因子(默认值为 1.0)。通常用于归一化,比如设置为 1/255 将像素值归一化到 [0, 1]。

# size:输出图像的尺寸(宽,高),例如 (224, 224)。指定后图像会被调整到这个大小。

# mean:均值,用于均值减法,通常是一个包含 BGR 三个通道均值的元组(如 (104, 117, 123))。

# swapRB:是否交换 R 和 B 通道,默认值为 True,适用于从 BGR 转换为 RGB。

# crop:是否裁剪图像。如果为 True,则会在缩放后裁剪以匹配目标大小。

# 返回参数:

# 返回一个四维张量(NCHW 格式),即 [1, C, H, W],其中:

# 1 是批量大小。

# C 是通道数(通常为 3,即 RGB)。

# H 和 W 是图像的高度和宽度。

#####################################################################################################################"""

"""#####################################################################################################################

# 函数功能:将多张图像同时转换为 blob 格式。

# 函数说明:cv2.dnn.blobFromImages(images, scalefactor=1.0, size=(0, 0), mean=(0, 0, 0), swapRB=True, crop=False)

# 参数说明:

# images:包含多张图像的列表或数组(如 [img1, img2, ...])。

# scalefactor:缩放因子,图像像素值会乘以该因子(默认值为 1.0)。通常用于归一化,比如设置为 1/255 将像素值归一化到 [0, 1]。

# size:输出图像的尺寸(宽,高),例如 (224, 224)。指定后图像会被调整到这个大小。

# mean:均值,用于均值减法,通常是一个包含 BGR 三个通道均值的元组(如 (104, 117, 123))。

# swapRB:是否交换 R 和 B 通道,默认值为 True,适用于从 BGR 转换为 RGB。

# crop:是否裁剪图像。如果为 True,则会在缩放后裁剪以匹配目标大小。

# 返回参数:

# 返回一个四维张量 [N, C, H, W],其中:

# N 是图像数量。

# C 是通道数。

# H 和 W 是图像的高度和宽度。

#####################################################################################################################"""

# -*- coding: utf-8 -*-

# 作者: 胖墩会武术

# 日期: 1994-08-21

# OpenCV图像处理: https://blog.csdn.net/shinuone/article/details/126022763

(六)背景减法(实时目标识别) —— cv2.createBackgroundSubtractorMOG2()

OpenCV提供了演示数据:https://github.com/opencv/opencv/tree/master/samples/data

"""##########################################################################

背景建模是实时目标识别中一个非常关键的技术,它通过创建并不断更新背景模型来从视频流中提取出动态变化的物体(即前景目标)。

(1)通过背景建模(使用高斯混合模型cv2.createBackgroundSubtractorMOG2)来提取视频中的前景目标

(2)形态学操作去除噪声

(3)轮廓检测识别动态物体

常用于监控、视频分析等领域,用于检测视频中的运动物体。

##########################################################################"""

import cv2

# 视频文件路径

video_path = r"D:\opencv-master\opencv-master\samples\data\vtest.avi"

cap = cv2.VideoCapture(video_path) # 初始化视频捕捉对象

# 检查视频是否成功打开

if not cap.isOpened():

print(f"Error: Unable to open video file at {video_path}")

exit()

# 创建背景减除器 (MOG2) 用于提取前景

fgbg = cv2.createBackgroundSubtractorMOG2(history=500, varThreshold=16, detectShadows=True)

# 定义形态学操作结构元素

kernel = cv2.getStructuringElement(cv2.MORPH_ELLIPSE, (3, 3))

# 主循环,逐帧处理视频

while True:

ret, frame = cap.read() # 读取视频帧

if not ret:

print("Failed to grab frame or video ended.")

break

# 获取前景掩码(背景0,前景1)

fgmask = fgbg.apply(frame)

# 形态学开运算,去除噪声

fgmask = cv2.morphologyEx(fgmask, cv2.MORPH_OPEN, kernel)

# 查找前景中的轮廓

contours, _ = cv2.findContours(fgmask, cv2.RETR_EXTERNAL, cv2.CHAIN_APPROX_SIMPLE)

# 遍历轮廓并绘制矩形框

for contour in contours:

perimeter = cv2.arcLength(contour, True) # 计算轮廓的周长

if perimeter > 188: # 根据轮廓周长过滤掉小物体

x, y, w, h = cv2.boundingRect(contour) # 获取外接矩形

cv2.rectangle(frame, (x, y), (x + w, y + h), (0, 255, 0), 2) # 绘制矩形框

# 显示当前帧和前景掩码

cv2.imshow('Frame', frame) # 当前帧图像

cv2.imshow('Foreground Mask', fgmask) # 当前运动目标的前景掩码

# 按 'Esc' 键退出

if cv2.waitKey(10) & 0xFF == 27:

break

# 释放资源并关闭所有窗口

cap.release()

cv2.destroyAllWindows()

"""#############################################################################################

# 函数功能:创建一个背景建模器,用于从视频流中分离前景与背景。

# 函数说明:cv2.createBackgroundSubtractorMOG2(history=500, varThreshold=16, detectShadows=True)

# 参数说明:

# history:用于计算背景模型的历史帧数。默认为500帧,表示背景模型根据过去500帧数据进行更新。较大的值可以提高背景建模的稳定性,但会增加计算开销。

# varThreshold:用于背景建模时阈值的标准差,用于区分前景和背景。通常情况下,前景和背景之间的差异小于该阈值,且前景像素的标准差大于此阈值时会被识别为前景。默认值为16。

# detectShadows:布尔值,是否检测阴影。默认为 True,启用阴影检测。如果启用,前景对象的阴影会被识别为另一种类型的前景像素并进行处理。

# 返回值:

# 返回一个 `cv2.BackgroundSubtractorMOG2` 对象,用于对每一帧进行前景提取。

# 功能描述:

# - `cv2.createBackgroundSubtractorMOG2()` 创建一个高斯混合模型(Gaussian Mixture Model, GMM)背景减除器,常用于从视频流中提取前景物体。

# - 背景建模算法会根据时间推移不断学习视频中的背景,实时更新背景模型,并将不同于背景的部分(如运动物体)标记为前景。

# - 可以通过 `apply()` 方法应用到每一帧图像上,获取前景图像。

# - 该方法适用于光照变化较小、背景相对稳定的场景,特别用于运动检测、行人跟踪等应用。

# 常用方法:

# - `apply(frame, learningRate=None)`:对每一帧图像进行前景检测。返回一个二值图像,前景像素为白色(255),背景像素为黑色(0)。

# `learningRate` 参数控制模型更新速度(默认为 -1,表示自动调整)。

# - `getBackgroundImage()`:获取当前背景图像。返回背景图像(如果设置了阴影检测,会包括阴影区域)。

# - `getShadowThreshold()`:获取阴影检测的阈值。

#############################################################################################"""

# -*- coding: utf-8 -*-

# 作者: 胖墩会武术

# 日期: 1994-08-21

# OpenCV图像处理: https://blog.csdn.net/shinuone/article/details/126022763

(七)光流估计(实时目标跟踪) —— cv2.goodFeaturesToTrack()、cv2.calcOpticalFlowPyrLK()

OpenCV提供了演示数据:https://github.com/opencv/opencv/tree/master/samples/data

"""##########################################################################

本项目实现了基于 Lucas-Kanade光流法(Lucas-Kanade Optical Flow Method)的目标跟踪系统,能够在视频流中实时追踪运动目标。

光流方法通过分析视频帧之间像素点的运动,从而估计物体的速度和运动轨迹。

该方法主要利用了图像的连续性与时间域上的变化,计算每个角点的位移,从而进行目标的跟踪。

##########################################################################"""

import numpy as np

import cv2

# 视频路径

video_path = r"D:\opencv-master\opencv-master\samples\data\vtest.avi"

cap = cv2.VideoCapture(video_path) # 初始化视频捕捉对象

# 获取视频中的第一帧,设置为跟踪的基准帧

ret, old_frame = cap.read()

if not ret:

print("Failed to read the video.")

cap.release()

exit()

mask = np.zeros_like(old_frame) # 用于绘制轨迹图mask

color = np.random.randint(0, 255, (100, 3)) # 随机颜色用于绘制轨迹

###############################################################################################

# 利用 Shi-Tomasi角点检测算法(cv2.goodFeaturesToTrack)选择图像中的显著特征点作为跟踪的基础。

old_gray = cv2.cvtColor(old_frame, cv2.COLOR_BGR2GRAY) # 转为灰度图像

feature_params = dict(maxCorners=150, qualityLevel=0.3, minDistance=12) # ShiTomasi角点检测的参数

p0 = cv2.goodFeaturesToTrack(old_gray, mask=None, **feature_params)

###############################################################################################

while True:

ret, frame = cap.read() # 获取当前帧

if not ret:

break

###############################################################################################

# 使用 Lucas-Kanade光流法(cv2.calcOpticalFlowPyrLK)来计算特征点在相邻帧之间的位移。

frame_gray = cv2.cvtColor(frame, cv2.COLOR_BGR2GRAY) # 转为灰度图像

lk_params = dict(winSize=(15, 15), maxLevel=2) # Lucas-Kanade光流法的参数

p1, st, err = cv2.calcOpticalFlowPyrLK(old_gray, frame_gray, p0, None, **lk_params)

# 选择状态为1的特征点,表示成功跟踪的点

good_new = p1[st == 1]

good_old = p0[st == 1]

# 绘制光流轨迹

for i, (new, old) in enumerate(zip(good_new, good_old)):

a, b = new.ravel() # 当前特征点的坐标

c, d = old.ravel() # 上一帧特征点的坐标

mask = cv2.line(mask, (int(a), int(b)), (int(c), int(d)), color[i].tolist(), 2) # 绘制光流线

frame = cv2.circle(frame, (int(a), int(b)), 5, color[i].tolist(), -1) # 绘制光流点

###############################################################################################

# 将轨迹线与当前帧图像合成

img = cv2.add(frame, mask)

cv2.imshow('Optical Flow Tracking', img)

k = cv2.waitKey(50) & 0xff

if k == 27: # 按Esc键退出

break

# 更新前一帧和特征点

old_gray = frame_gray.copy()

p0 = good_new.reshape(-1, 1, 2) # 更新特征点位置

# 处理目标丢失情况:如果跟踪失败,重新检测角点

if len(good_new) < 10: # 如果跟踪的点少于10个,认为目标丢失

p0 = cv2.goodFeaturesToTrack(old_gray, mask=None, **feature_params) # 重新选择特征点

mask = np.zeros_like(frame) # 重置mask

cap.release()

cv2.destroyAllWindows()

"""#############################################################################################

# 函数功能:用于在图像中检测最好的角点特征,通常用于后续的光流估计或物体跟踪等应用。

# 函数说明:cv2.goodFeaturesToTrack(image, mask=None, maxCorners=100, qualityLevel=0.3, minDistance=7, blockSize=3)

# 参数说明:

# image:输入图像,必须为灰度图像(单通道)。

# mask:可选的掩膜图像,指定在何处寻找角点。如果为None,则在整个图像上寻找角点。

# maxCorners:要检测的最大角点数目。默认值为100,表示最多返回100个角点。

# qualityLevel:角点质量的阈值,取值范围为 [0, 1],表示角点的最小质量。值越大,返回的角点越“好”。默认值为0.3。

# minDistance:检测到的角点之间的最小距离。如果两个角点距离小于此值,则认为它们是重复的。默认值为7。

# blockSize:用于计算角点的邻域大小。默认值为3。

# 返回值:

# 返回一个包含角点位置的 NumPy 数组,数组大小为 (N, 1, 2),其中 N 是检测到的角点数量,每个角点的坐标为 (x, y)。

# 功能描述:

# - `cv2.goodFeaturesToTrack()` 使用 Shi-Tomasi 角点检测算法检测图像中的“最佳”角点,适用于跟踪和运动分析等应用。

# - 该算法通过计算局部图像区域的自相关矩阵,并通过其特征值来评估区域的稳定性,选择“最强”的角点。

# - 检测到的角点是图像中变化最强的部分,因此通常包含了显著的物体边缘或角落信息。

# 常用应用:

# - 在光流估计中,使用检测到的角点来追踪运动。

# - 用于物体跟踪、场景重建等应用中。

#############################################################################################"""

"""#############################################################################################

# 函数功能:用于计算两个连续图像帧之间的稀疏光流(Optical Flow),通过金字塔Lucas-Kanade方法(Pyramidal Lucas-Kanade method)跟踪特征点的运动。

# 函数说明:cv2.calcOpticalFlowPyrLK(prevImg, nextImg, prevPts, nextPts=None, winSize=(21, 21), maxLevel=3,

# criteria=(cv2.TERM_CRITERIA_EPS | cv2.TERM_CRITERIA_COUNT, 30, 0.03), flags=0, minEigThreshold=1e-4)

# 参数说明:

# prevImg:前一帧图像,必须为灰度图像。

# nextImg:后一帧图像,必须为灰度图像。

# prevPts:前一帧中的特征点位置,必须为形状为 (N, 1, 2) 的 NumPy 数组,N 是特征点的个数。

# nextPts:返回的特征点的新位置,必须为形状为 (N, 1, 2) 的 NumPy 数组。如果没有给出,函数将会返回空。

# winSize:搜索窗口大小,默认为 (21, 21),即 21x21 像素的窗口。较大的窗口可能会导致计算较慢。

# maxLevel:金字塔的最大层数,默认为3,表示使用三层金字塔进行光流计算。较大的值可以提高精度,但会增加计算时间。

# criteria:用于停止迭代的条件。可以设置为 cv2.TERM_CRITERIA_EPS 或 cv2.TERM_CRITERIA_COUNT。

# 默认为 (cv2.TERM_CRITERIA_EPS | cv2.TERM_CRITERIA_COUNT, 30, 0.03),表示最多迭代 30 次或者直到光流计算的误差小于 0.03。

# flags:标志位,默认为 0,表示不使用任何特殊的标志。可以设置为 cv2.OPTFLOW_USE_INITIAL_FLOW 等。

# minEigThreshold:最小特征值的阈值,用于筛选特征点。默认值为 1e-4。

# 返回值:

# nextPts:特征点的新位置。

# status:一个布尔数组,指示每个特征点是否成功计算了光流,1 表示成功,0 表示失败。

# err:每个特征点的光流估计误差。

# 功能描述:

# - `cv2.calcOpticalFlowPyrLK()` 使用Lucas-Kanade方法计算连续两帧图像之间的光流。通过追踪前一帧图像中的特征点位置来估计它们在后一帧中的位置。

# - 该方法基于图像金字塔算法,通过在不同分辨率下计算光流,可以提高对快速运动物体的跟踪精度。

# - 常用于视频中的目标跟踪、光流估计、运动检测等任务。

# - `prevPts` 和 `nextPts` 都是 (N, 1, 2) 形式的数组,其中 N 是角点数量,每个点的格式是 (x, y),表示像素坐标。

# 常用应用:

# - 在视频中跟踪移动物体。

# - 计算图像的运动场(Optical Flow)。

# - 进行图像稳像或目标跟踪。

#############################################################################################"""

# -*- coding: utf-8 -*-

# 作者: 胖墩会武术

# 日期: 1994-08-21

# OpenCV图像处理: https://blog.csdn.net/shinuone/article/details/126022763

图文详解 OpenCV中光流以及视频特征点追踪(稀疏光流追踪+ 优化版稀疏光流追踪+密集光流追踪)

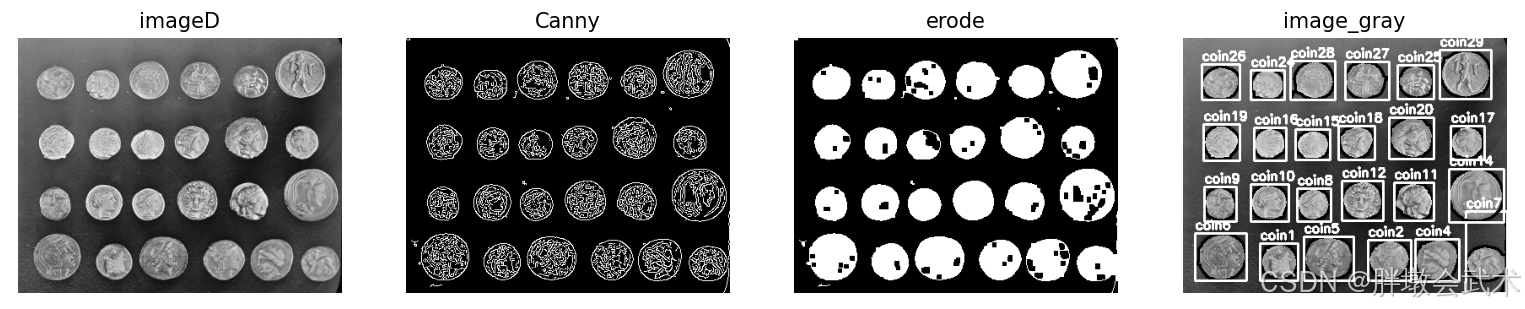

(八)图像分割

基于深度学习的图像分割(综述):Image Segmentation Using Deep Learning:A Survey

基于深度学习的医生图像分割(综述):Medical image segmentation using deep learning: A survey

import skimage

import numpy as np

import cv2

import matplotlib.pyplot as plt

# (1)加载图像(硬币图像)

image = skimage.data.coins()

image_gray = image.copy()

# (2)图像处理

# image_blurred = cv2.GaussianBlur(image_gray, (5, 5), 0) # 高斯滤波

edges = cv2.Canny(image_gray, 50, 150) # 边缘检测

kernel = np.ones((3, 3), np.uint8) # 初始化卷积核(np.ones: 生成一个数值全为1的3x3数组)

dilate = cv2.dilate(edges, kernel, iterations=2) # 膨胀

erode = cv2.erode(dilate, kernel, iterations=2) # 腐蚀

# (3)轮廓检测

# _, image_threshold = cv2.threshold(image_gray, 120, 255, cv2.THRESH_BINARY) # 二值化

# _, image_threshold = cv2.threshold(image, 0, 255, cv2.THRESH_BINARY + cv2.THRESH_OTSU)

contours, _ = cv2.findContours(erode, cv2.RETR_EXTERNAL, cv2.CHAIN_APPROX_SIMPLE) # 轮廓检测

for index, contour in enumerate(contours):

area = cv2.contourArea(contour) # 计算轮廓的面积

print(f"area{index}:{area}")

if 100 < area: # 过滤小轮廓.可根据实际情况调整阈值

cv2.drawContours(image_gray, [contour], -1, (0, 255, 0), 2) # 绘制轮廓

x, y, w, h = cv2.boundingRect(contour) # 计算轮廓的边界框

cv2.rectangle(image_gray, (x, y), (x + w, y + h), (255, 0, 0), 2) # 绘制矩形框

label = f'coin{index}'

cv2.putText(image_gray, label, (x, y - 5), cv2.FONT_HERSHEY_SIMPLEX, 0.5, (255, 255, 255), 2)

# (4)显示结果

plt.subplot(141), plt.imshow(image, cmap='gray'), plt.axis('off'), plt.title('imageD')

plt.subplot(142), plt.imshow(edges, cmap='gray'), plt.axis('off'), plt.title('Canny')

plt.subplot(143), plt.imshow(erode, cmap='gray'), plt.axis('off'), plt.title('erode')

plt.subplot(144), plt.imshow(image_gray, cmap='gray'), plt.axis('off'), plt.title('image_gray')

plt.show()

(九)图像增强:灰度反转、对比度拉伸、对比度和亮度增强、指数变换、伽马变换、对数变换

(十)噪声模拟:均匀噪声、高斯噪声、椒盐噪声、泊松噪声、瑞利噪声、伽马噪声、乘性噪声

https://blog.csdn.net/shinuone/article/details/146089291

(十一)基于核函数的卷积操作:滤波器、形态学变化、边缘检测算子

https://blog.csdn.net/shinuone/article/details/146592095

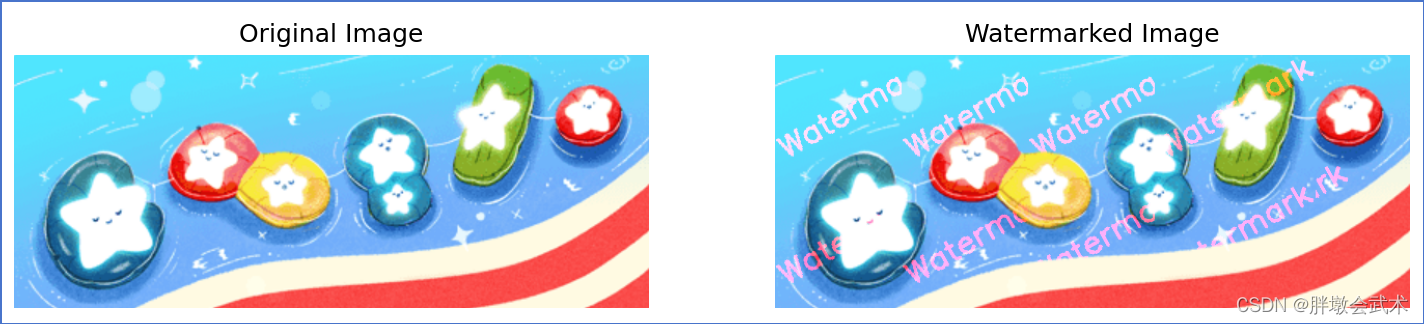

(十二)添加水印

import cv2

import numpy as np

import matplotlib.pyplot as plt

def add_text_watermark(image_path, text, output_path, visualization_result=True, save_result=True,

count=1, layout=(1, 1), angle=0, font=cv2.FONT_HERSHEY_SIMPLEX,

font_scale=1, color=(0, 0, 255), thickness=2, opacity=0.3):

"""

在图像上添加文本水印

Args:

image_path (str): 输入图像的文件路径

text (str): 水印文本

output_path (str): 输出带水印的图像文件路径

visualization_result (bool): 是否在完成后可视化结果,默认为 True

save_result (bool): 是否保存结果,默认为 True

count (int): 水印的数量,默认为 1

layout (tuple): 水印布局,默认为 (1, 1)

angle (float): 水印旋转角度,默认为 0

font (int): 字体,默认为 cv2.FONT_HERSHEY_SIMPLEX

font_scale (float): 字体缩放因子,默认为 1

color (tuple): 水印颜色,默认为黑色 (0, 0, 0)

thickness (int): 字体线条粗细,默认为 2

opacity (float): 水印透明度,默认为 0.3

"""

# 加载图像

image = cv2.imread(image_path)

# 创建一个原始图像的副本,用于添加水印

image_watermarked = image.copy()

"""根据旋转后的水印大小调整水印比例"""

# 获取文字边界框大小

text_size = cv2.getTextSize(text, font, font_scale, thickness)[0]

# 根据文字大小创建水印

watermark = np.zeros((text_size[1], text_size[0], 3), dtype=np.uint8)

cv2.putText(watermark, text, (0, text_size[1] - 2), font, font_scale, color, thickness)

# 旋转水印

(w, h) = text_size

(cX, cY) = (w // 2, h // 2)

M = cv2.getRotationMatrix2D((cX, cY), angle, 1.0)

cos = np.abs(M[0, 0])

sin = np.abs(M[0, 1])

nW = int((h * sin) + (w * cos))

nH = int((h * cos) + (w * sin))

M[0, 2] += (nW / 2) - cX

M[1, 2] += (nH / 2) - cY

rotated_watermark = cv2.warpAffine(watermark, M, (nW, nH))

# 计算布局的步长

step_x = image.shape[1] // layout[1]

step_y = image.shape[0] // layout[0]

# 添加水印到图像

for i in range(layout[0]):

for j in range(layout[1]):

x_offset = j * step_x

y_offset = i * step_y

for k in range(count):

x_pos = x_offset + k * rotated_watermark.shape[1]

y_pos = y_offset + k * rotated_watermark.shape[0]

if x_pos + rotated_watermark.shape[1] <= image.shape[1] and y_pos + rotated_watermark.shape[0] <= image.shape[0]:

# 使用cv2.addWeighted函数将水印添加到图像上

image_watermarked[y_pos:y_pos + rotated_watermark.shape[0], x_pos:x_pos + rotated_watermark.shape[1]] = \

cv2.addWeighted(src1=image[y_pos:y_pos + rotated_watermark.shape[0], x_pos:x_pos + rotated_watermark.shape[1]], alpha=1.0,

src2=rotated_watermark, beta=opacity, gamma=0)

# 可视化结果

if visualization_result:

# 转换颜色通道顺序(OpenCV默认为BGR,Matplotlib默认为RGB)

image_rgb = cv2.cvtColor(image, cv2.COLOR_BGR2RGB)

image_watermarked_rgb = cv2.cvtColor(image_watermarked, cv2.COLOR_BGR2RGB)

# 创建图像窗口

fig, axes = plt.subplots(1, 2, figsize=(12, 6))

# 在第一个子图中绘制原始图像

axes[0].imshow(image_rgb)

axes[0].set_title('Original Image')

axes[0].axis('off')

# 在第二个子图中绘制带水印的图像

axes[1].imshow(image_watermarked_rgb)

axes[1].set_title('Watermarked Image')

axes[1].axis('off')

plt.show() # 显示图像

# 保存结果

if save_result:

cv2.imwrite(output_path, image_watermarked)

if __name__ == '__main__':

image_path = r'image.jpg'

output_path = r'output.jpg'

text = 'Watermark'

add_text_watermark(image_path, text, output_path,

visualization_result=True, save_result=False,

count=50, layout=(2, 5), angle=30, color=(0, 0, 255), opacity=1.0)

第零章、环境配置

conda create --name py39 -y

conda activate py39

conda install python==3.9

pip install opencv-python==4.5.1.48

pip install opencv-contrib-python==4.5.1.48

第一章、图像的基本操作

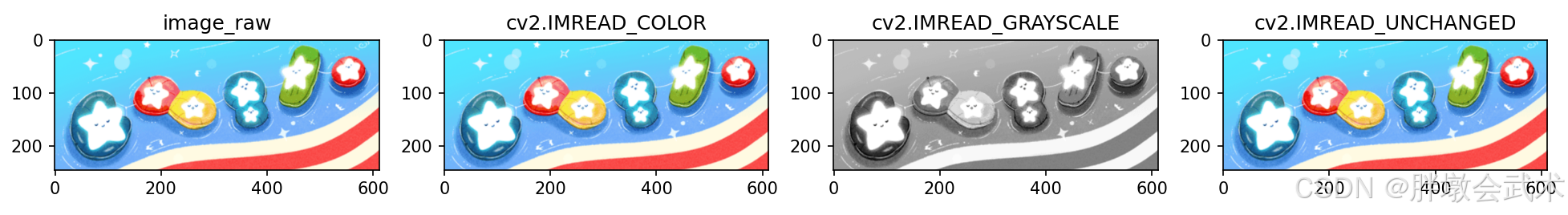

1.1、图像操作(读取 + 显示 + 保存) —— cv2.imread() + cv2.imshow() + cv2.imwrite()

(1)(在同一个窗口)同时显示多张图 plt.subplot()

(2)cv2.imshow()和plt.imshow()的区别

"""#####################################################################

# cv2是 opencv 在 python 中的缩写;

#

# Matplotlib 是一个 Python 库,用于绘制图形和图表。

# Matplotlib 中的 pyplot 模块,可以控制线条样式,字体属性,格式化轴等功能。

# 且支持各种各样的图形绘制,如直方图,条形图,功率谱,误差图等。

#####################################################################"""

import cv2 # opencv 读取图像默认为BGR

import matplotlib.pyplot as plt # matplotlib显示图像默认为RGB

image_path = r'image.jpg'

######################################################################################

# 读取图像

image = cv2.imread(image_path) # 默认为彩色图像

image_color = cv2.imread(image_path, cv2.IMREAD_COLOR)

image_gray = cv2.imread(image_path, cv2.IMREAD_GRAYSCALE)

image_unchanged = cv2.imread(image_path, cv2.IMREAD_UNCHANGED)

######################################################################################

# 保存图像

cv2.imwrite('image_gray.jpg', image_gray)

######################################################################################

# 显示图像

cv2.imshow('image', image)

cv2.imshow('cv2.IMREAD_COLOR', image_color)

cv2.imshow('cv2.IMREAD_GRAYSCALE', image_gray)

cv2.imshow('cv2.IMREAD_UNCHANGED', image_unchanged)

cv2.waitKey(1000) # 延迟一秒后自动关闭图像

cv2.destroyAllWindows() # (同时)摧毁所有图窗

######################################################################################

# 两者都可以,但需要注意图像格式为RGB,plt显示图像为RGB,而opencv读取图像为BGR。

plt.subplot(141), plt.imshow(cv2.cvtColor(image, cv2.COLOR_BGR2RGB)), plt.title('image_raw')

plt.subplot(142), plt.imshow(cv2.cvtColor(image_color, cv2.COLOR_BGR2RGB)), plt.title('cv2.IMREAD_COLOR')

plt.subplot(143), plt.imshow(image_gray, cmap='gray'), plt.title('cv2.IMREAD_GRAYSCALE')

plt.subplot(144), plt.imshow(cv2.cvtColor(image_unchanged, cv2.COLOR_BGR2RGB)), plt.title('cv2.IMREAD_UNCHANGED')

plt.show()

plt.imshow(cv2.cvtColor(image, cv2.COLOR_BGR2RGB))

plt.colorbar()

plt.show()

"""####################################################################################################################

# 函数功能:读取图像(图像格式为RGB,但OpenCV读取图像的默认格式为BGR)

# 函数说明:image = cv2.imread(filename, flags=cv2.IMREAD_COLOR)

# 参数说明:

# filename: 图像路径(若路径错误,则返回None,但不报错),支持多种图像格式:

# - .jpg 常见的压缩图片格式,支持有损压缩和无损压缩,文件体积小,广泛使用。

# - .jpeg 和 .jpg 类似,主要用于图片存储与传输。

# - .png 支持无损压缩,并支持透明通道(Alpha 通道)。

# - .bmp 位图格式,不压缩,文件体积大,适合高精度图像存储。

# - .tiff 高质量图像格式,支持多种压缩方式(如无损 LZW 压缩)。

# - .webp 新型格式,支持高压缩比及透明通道,适用于网络传输。

# - .ppm 一种简单的图像格式,主要用于便携图形文件的存储。

# - .pgm 灰度图像的便携格式,与 .ppm 类似。

# - .pbm 二值图像的便携格式,与 .ppm 类似。

# - .sr Sun Raster 格式。

# - .ras Sun Raster 格式。

# flags: 读取模式

# - cv2.IMREAD_COLOR(1) 加载彩色图像(忽略 Alpha 通道)。

# - cv2.IMREAD_GRAYSCALE(0) 加载灰度图像。

# - cv2.IMREAD_UNCHANGED(-1) 加载原始图像,包括图像的 alpha 通道(透明度)。

# 返回参数:

# 返回一个 Numpy 数组 image,表示读取的图像。

############################################################

# 在Python中,'r' 是一个标志,用来指示字符串是原始字符串(raw string)。原始字符串会忽略其中的转义字符,反而会将反斜杠 '\' 视为普通字符。

############################################################

# 文件命名规范:

# (1)不能出现中文

# (2)不能出现空格

# (3)使用英文字母、数字、下划线或连字符,作为文件或文件夹名,以避免兼容性问题。

############################################################

# 路径表示方法 ———— 注意路径分隔符在Windows系统中是反斜杠('\'),但为了避免转义问题,通常建议使用斜杠('/')或原始字符串(r'...')。

# 绝对路径:path = r'F:/py/image.jpg'

# 相对路径:path = r'image.jpg' # 同级目录(脚本文件和资源文件在同一目录下)

# path = r'./image.jpg' # 同级目录(脚本文件和资源文件在同一目录下) ———— ./ 表示当前目录,但可以省略。

# path = r'../image.jpg' # 上级目录(资源文件在脚本所在目录的上一级) ———— ../ 表示上一级目录

############################################################

# 在Python中,反斜杠 '\' 是一个转义字符,用来表示一些特殊的字符

# (1)'\n': 表示换行符

# (2)'\t': 表示制表符tab

# (3)'\\': 表示单个反斜杠

####################################################################################################################"""

"""####################################################################################################################

# 函数功能:保存图像

# 函数说明:cv2.imwrite(filename, img, params=None)

# 参数说明:

# filename: 要保存的目标文件的路径。

# img: 要保存的图像数据,可以是 Numpy 数组。

# params: 可选参数,用于指定保存图像的额外参数,例如 JPEG 图像的压缩质量。

# 返回参数:

# 如果成功保存图像,则返回 True;否则返回 False。

####################################################################################################################"""

"""####################################################################################################################

# 函数功能:显示图像

# 函数说明:cv2.imshow(winname, image)

# 参数说明:

# winname: 窗口的名称,用于标识窗口。

# image: 要显示的图像,可以是灰度图像或彩色图像,表示为一个 Numpy 数组。

#

# 备注: (1)在显示图像之后,一般会调用 cv2.waitKey() 函数来等待用户按下键盘,否则窗口会立即关闭。

# (2)窗口会自适应图像大小

# (3.1)若指定多个不同的窗口名称,则显示多幅图像;

# (3.2)若指定多个相同的窗口名称,则后一个图像会覆盖前一个图像,从而只产生一个(连续)窗口。如:视频

####################################################################################################################"""

"""########################################################################

# -*- coding: utf-8 -*-

# 作者: 胖墩会武术

# 日期: 1994-08-21

# OpenCV图像处理: https://blog.csdn.net/shinuone/article/details/126022763

# 版权所有 (C) 1994 胖墩会武术

#

# 本文件遵循开源协议,使用、修改、分发时请遵循以下条款:

# 1. 保留本文件头信息,包含版权声明、作者信息及出处。

# 2. 转载或发布衍生作品时,必须注明原作者及出处。

# 3. 未经作者许可,不得用于商业用途。

########################################################################"""

1.2、显示多幅图像

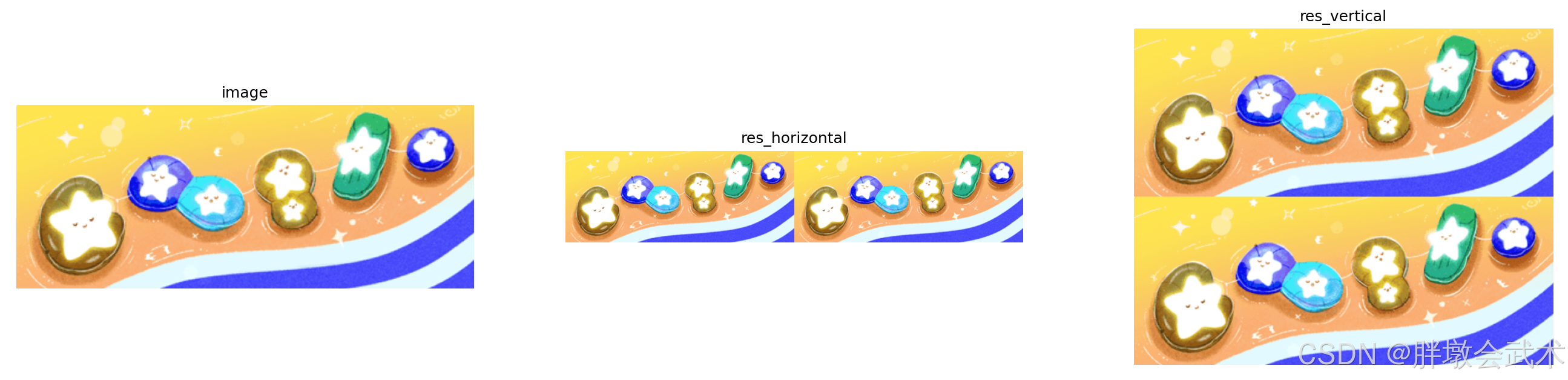

1.2.1、堆叠图像(numpy 水平 + 垂直) —— np.hstack() + np.vstack()

import numpy as np

import cv2 # opencv读取图像默认为BGR

import matplotlib.pyplot as plt # matplotlib显示图像默认为RGB

image = cv2.imread(r"image.jpg")

res_horizontal = np.hstack((image, image)) # 水平方向堆叠图像

res_vertical = np.vstack((image, image)) # 竖直方向堆叠图像

plt.subplot(1, 3, 1), plt.imshow(image), plt.title('image'), plt.axis('off')

plt.subplot(1, 3, 2), plt.imshow(res_horizontal), plt.title('res_horizontal'), plt.axis('off')

plt.subplot(1, 3, 3), plt.imshow(res_vertical), plt.title('res_vertical'), plt.axis('off')

plt.show()

# 常用于数据拼接和组合

"""#############################################################################################

# 函数功能:沿水平方向将数组进行堆叠。

# 函数说明:np.hstack(tup)

# 参数说明:

# tup:一个包含要堆叠的数组的元组或列表。所有输入数组必须具有相同的形状,除了要堆叠的轴(即列数可以不同)。

# 返回值:

# 返回一个新的数组,包含输入数组在水平方向上堆叠的结果。

#############################################################################################"""

"""#############################################################################################

# 函数功能:沿垂直方向将数组进行堆叠。

# 函数说明:np.vstack(tup)

# 参数说明:

# tup:一个包含要堆叠的数组的元组或列表。所有输入数组必须具有相同的形状,除了要堆叠的轴(即行数可以不同)。

# 返回值:

# 返回一个新的数组,包含输入数组在垂直方向上堆叠的结果。

#############################################################################################"""

# -*- coding: utf-8 -*-

# 作者: 胖墩会武术

# 日期: 1994-08-21

# OpenCV图像处理: https://blog.csdn.net/shinuone/article/details/126022763

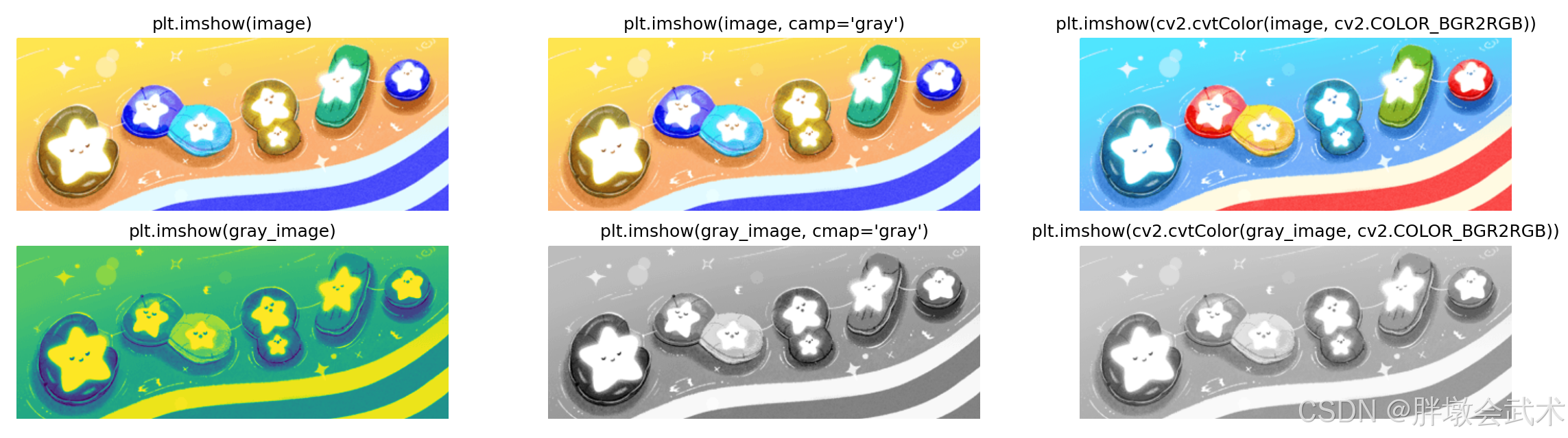

1.2.2、显示图像(matplotlib 在同一个图窗中) —— plt.imshow()

OpenCV读取图像默认为 BGR 格式,matplotlib显示图像默认为RGB。

- 如果图像是彩色图像,但直接使用 plt.imshow(image, cmap=‘gray’),则 plt.imshow 仍然会显示为彩色,因为数据未被正确转换为灰度格式。

- 如果图像是灰度图像,但在使用 plt.imshow 时没有指定 cmap=‘gray’,则 plt.imshow 会将该灰度图像作为 RGB 图像来处理。

import cv2 # opencv读取图像默认为BGR

import matplotlib.pyplot as plt # matplotlib显示图像默认为RGB

image = cv2.imread(r"image.jpg")

gray_image = cv2.imread('image.jpg', cv2.IMREAD_GRAYSCALE)

plt.subplot(2, 3, 1), plt.imshow(image), plt.title("plt.imshow(image)"), plt.axis('off')

plt.subplot(2, 3, 2), plt.imshow(image, cmap='gray'), plt.title("plt.imshow(image, camp='gray')"), plt.axis('off')

plt.subplot(2, 3, 3), plt.imshow(cv2.cvtColor(image, cv2.COLOR_BGR2RGB)), plt.title("plt.imshow(cv2.cvtColor(image, cv2.COLOR_BGR2RGB))"), plt.axis('off')

plt.subplot(2, 3, 4), plt.imshow(gray_image), plt.title("plt.imshow(gray_image)"), plt.axis('off')

plt.subplot(2, 3, 5), plt.imshow(gray_image, cmap='gray'), plt.title("plt.imshow(gray_image, cmap='gray')"), plt.axis('off')

plt.subplot(2, 3, 6), plt.imshow(cv2.cvtColor(gray_image, cv2.COLOR_BGR2RGB)), plt.title("plt.imshow(cv2.cvtColor(gray_image, cv2.COLOR_BGR2RGB))"), plt.axis('off')

plt.show()

"""#############################################################################################

# 函数功能:用于显示图像或矩阵数据,并自动将其展示在一个窗口中。

# 函数说明:plt.imshow(image, cmap=None, norm=None, interpolation=None, origin=None, extent=None, filternorm=True, filterrad=4.0, resample=None, url=None, **kwargs)

# 参数说明:

# image:要显示的图像或矩阵数据,通常是二维或三维数组。对于彩色图像,通常是一个三维数组(高度 x 宽度 x 通道)。

# cmap:用于映射图像颜色的颜色图(colormap),可以为字符串类型的预定义颜色映射名称,如 "gray", "hot", "viridis" 等。

# 如果为 None,默认使用数据类型决定颜色映射。

# norm:用于归一化图像数据的方式,通常为 `matplotlib.colors.Normalize` 类型。用于控制图像色阶的显示。

# interpolation:插值方法,用于图像缩放的插值方式,常见的有:

# - 'nearest':最近邻插值

# - 'bilinear':双线性插值

# - 'bicubic':双三次插值

# - 'spline36':三次样条插值

# - 'hanning'、'hamming'、'hermite' 等其他方法

# origin:设置显示图像时的原点位置。常用值包括:

# - 'upper':图像从上方开始显示

# - 'lower':图像从下方开始显示

# extent:设置图像显示区域的范围,四个数值:`[xmin, xmax, ymin, ymax]`,用于图像显示时的坐标轴限制。

# filternorm:布尔值,指定是否对图像进行归一化处理。

# filterrad:浮动值,控制滤波器的半径。

# resample:布尔值,指定是否启用图像重采样。

# url:设置图像链接,适用于使用网络图像的情况。

# **kwargs:其他 `imshow` 支持的参数,例如 `alpha`、`aspect` 等。

# 返回值:

# 返回一个包含图像对象的句柄(`AxesImage`),可以进一步修改图像显示的属性。

#############################################################################################"""

# -*- coding: utf-8 -*-

# 作者: 胖墩会武术

# 日期: 1994-08-21

# OpenCV图像处理: https://blog.csdn.net/shinuone/article/details/126022763

1.3、视频操作(读取 + 显示 + 获取属性) —— cv2.VideoCapture() + cv2.VideoWriter + cap.get

OpenCV提供了演示数据:https://github.com/opencv/opencv/tree/master/samples/data

"""

(1)点击空格键暂停视频播放,再次点击空格键继续播放。

(2)按 Esc 键退出程序

"""

import cv2

# (1)读取视频

video_path = r"D:\opencv-master\opencv-master\samples\data\vtest.avi"

cap = cv2.VideoCapture(video_path) # 初始化视频捕捉对象

# (2)检查视频是否可以打开

if not cap.isOpened():

print("Error: Could not open video.")

exit()

# (3)获取视频属性

frame_width = int(cap.get(cv2.CAP_PROP_FRAME_WIDTH)) # 获取视频宽度

frame_height = int(cap.get(cv2.CAP_PROP_FRAME_HEIGHT)) # 获取视频高度

frame_count = int(cap.get(cv2.CAP_PROP_FRAME_COUNT)) # 总帧数

fps = cap.get(cv2.CAP_PROP_FPS) # 帧率

fourcc = cv2.VideoWriter_fourcc(*'XVID') # 指定视频编码格式

# (4)初始化 VideoWriter

output_path = r"output_video.avi" # 保存路径

isColor = True # 保存图像为灰度图还是彩色图

out = cv2.VideoWriter(filename=output_path, fourcc=fourcc, fps=fps, frameSize=(frame_width, frame_height), isColor=isColor)

# (5)读取帧 + 保存帧 + 显示帧

paused = False # 控制是否暂停播放

while True:

if not paused: # 只有在没有暂停时,才读取和显示新的一帧

ret, frame = cap.read() # 读取帧

if not ret:

print("Error: Failed to read frame or video end reached.")

break

out.write(frame) # 保存帧

cv2.imshow('Video', frame) # 显示帧

## 为什么会产生视频效果? ———— 循环读取每一帧,并将其固定显示在同一个窗口上,则后一帧会覆盖前一帧,就产生了视频效果。

key = cv2.waitKey(100) & 0xFF # 获取按键(控制速度)

if key == 27: # 按Esc键退出

break

elif key == 32: # 按空格键暂停/继续

paused = not paused # 切换暂停状态

# (6)释放资源

cap.release()

out.release()

cv2.destroyAllWindows()

"""#############################################################################################

# 函数功能:用于打开视频文件、摄像头或其他视频设备,并从中读取视频帧。

# 函数说明:cap = cv2.VideoCapture([filename or device index])

# 参数说明:

# filename or device index:输入的视频文件路径或视频设备索引。

# - 如果是文件路径,指定要打开的影片文件(如 'video.mp4')。

# - 如果是设备索引,指定打开的摄像头,通常索引为 0 表示默认摄像头,1 表示第二个摄像头,以此类推。

# - 如果设备不可用或路径无效,函数返回失败。

# 返回值:

# 如果打开成功,返回一个 `cv2.VideoCapture` 对象,用于读取视频帧。如果失败,则返回空对象。

# 常用方法:

# 1. `cap.read()`:从视频流中读取一帧图像,返回两个值,布尔值和帧图像。如果成功读取,布尔值为 True,帧图像为读取的图像矩阵。

# 2. `cap.isOpened()`:检查视频文件或设备是否成功打开。

# 3. `cap.get(propId)`:获取视频文件的属性,例如帧宽度、高度、帧率等。

# 4. `cap.set(propId, value)`:设置视频文件的属性,如设置帧的宽度和高度等。

# 5. `cap.release()` 释放资源。

#############################################################################################"""

"""#############################################################################################

# 函数功能:用于指定视频编解码器的四字符代码(FourCC),FourCC 是一个 4 字节的代码。常用于定义视频保存时的编码格式,例如 AVI、MP4 等。

# 函数说明:fourcc = cv2.VideoWriter_fourcc(c1, c2, c3, c4)

# 参数说明:

# c1, c2, c3, c4:构成 FourCC 编解码器标识符的四个字符。常见的 FourCC 值:

# - 'XVID': OpenDivX 编解码器 文件扩展名:.avi 适用于需要良好兼容性并且对压缩效率要求不高的场景。

# - 'DIVX': DivX 编解码器 文件扩展名:.avi 适用于需要中等压缩质量和高质量视频的应用。支持逐渐下降

# - 'MJPG': Motion JPEG 编解码器 文件扩展名:.avi 或.mp4 适用于需要快速编码且每帧独立,但输出视频文件较大,缺乏帧间压缩。

# - 'MP4V': MPEG-4 编解码器 文件扩展名:.mp4 适用于需要中等压缩效果和较好兼容性的应用,尤其是在较老的设备上使用。

# - 'H264': 高级视频编码标准 文件扩展名:.mp4 适用于需要高压缩效率、文件较小且质量较高的场景。H264 是最常用的现代视频编码标准。

# 返回值:

# 返回一个整数,表示对应的 FourCC 编解码器标识符。

#############################################################################################"""

"""#############################################################################################

# 函数功能:用于创建一个视频写入对象,方便将帧数据保存为视频文件。

# 函数说明:out = cv2.VideoWriter(filename, fourcc, fps, frameSize, isColor=True)

# 参数说明:

# filename:字符串,保存视频的文件名及路径。例如 'output.avi'。

# fourcc:编码器的四字符代码,使用 `cv2.VideoWriter_fourcc()` 创建。

# fps:每秒帧数(帧率),指定视频播放的帧速率。

# frameSize:元组,表示视频帧的宽度和高度,例如 (640, 480)。

# isColor:布尔值,是否保存为彩色视频。默认值为 True(彩色),若为 False,则保存为灰度视频。

# 返回值:

# 返回一个 cv2.VideoWriter 对象,用于向视频文件写入帧。

# 使用步骤:

# 1. 使用 `fourcc = cv2.VideoWriter_fourcc()` 创建编码器标识符。

# 2. 调用 `out = cv2.VideoWriter` 创建视频写入对象。

# 3. 使用 `out.write(frame)` 方法将帧写入视频。

# 4. 调用 `out.release()` 释放资源。

#############################################################################################"""

# -*- coding: utf-8 -*-

# 作者: 胖墩会武术

# 日期: 1994-08-21

# OpenCV图像处理: https://blog.csdn.net/shinuone/article/details/126022763

1.4、图窗事件

1.4.1、窗口设置 —— cv2.namedWindow() + cv2.resizeWindow() + cv2.moveWindow() + cv2.setWindowProperty()

import cv2

window_name = 'projector' # 图窗标题

cv2.namedWindow(window_name, cv2.WINDOW_KEEPRATIO) # 创建命名窗口

cv2.resizeWindow(window_name, 10, 20) # 自定义窗口大小

cv2.moveWindow(window_name, 100, 200) # 设置窗口位置

cv2.setWindowProperty(window_name, cv2.WND_PROP_TOPMOST, 1) # 设置窗口属性(控制窗口总在最前面)

image = cv2.imread('image.jpg') # 读取图像

cv2.imshow(window_name, image) # 显示图像

cv2.waitKey(0) # 等待输入任意键

cv2.destroyAllWindows() # 摧毁所有图窗

"""#############################################################################################

# 函数功能:创建一个窗口,指定窗口名称。窗口可以显示图像,并且可以设置窗口的大小、标志等属性。

# 函数说明:cv2.namedWindow(winname, flags=cv2.WINDOW_NORMAL)

# 参数说明:

# winname:窗口的名称,字符串类型,用于指定窗口的名称。

# flags:窗口的标志,控制窗口的大小、显示模式等。常用标志有:

# cv2.WINDOW_NORMAL:允许调整窗口大小。

# cv2.WINDOW_AUTOSIZE:窗口大小根据图像的尺寸自动调整(不能手动调整大小)。

# cv2.WINDOW_FREERATIO:窗口的宽高比不固定,能够自由调整。

# cv2.WINDOW_KEEPRATIO:窗口的宽高比保持一致。

# cv2.WINDOW_OPENGL 窗口创建的时候会支持OpenGL

# cv2.WINDOW_GUI_EXPANEDE 创建的窗口允许添加工具栏和状态栏。

# cv2.WINDOW_GUI_NORMAL 创建没有状态栏和工具栏窗口。

# cv2.WINDOW_AUTOSIZE 窗口大小自动适应图片大小,并且不可手动更改。

# 返回值:

# 无返回值。此函数仅创建指定的窗口。

#############################################################################################"""

"""#############################################################################################

# 函数功能:调整已创建的窗口大小。

# 函数说明:cv2.resizeWindow(winname, width, height)

# 参数说明:

# winname:窗口的名称,字符串类型,必须是已经创建的窗口的名称。

# width:窗口的宽度,整数类型,单位为像素。

# height:窗口的高度,整数类型,单位为像素。

# 返回值:

# 无返回值。该函数直接修改指定窗口的大小。

#############################################################################################"""

"""#############################################################################################

# 函数功能:移动窗口到指定的位置。

# 函数说明:cv2.moveWindow(winname, x, y)

# 参数说明:

# winname:窗口的名称,字符串类型,必须是已经创建的窗口的名称。

# x:窗口左上角的水平位置,整数类型,单位为像素。

# y:窗口左上角的垂直位置,整数类型,单位为像素。

# 返回值:

# 无返回值。该函数直接将指定窗口移动到目标位置。

#############################################################################################"""

"""#############################################################################################

# 函数功能:设置窗口的属性,例如窗口的透明度、是否固定大小等。

# 函数说明:cv2.setWindowProperty(winname, prop_id, value)

# 参数说明:

# winname:窗口的名称,字符串类型,必须是已经创建的窗口的名称。

# prop_id:窗口属性的标识符,常用值有:

# cv2.WND_PROP_FULLSCREEN:控制窗口是否为全屏。值可以是:

# - cv2.WINDOW_NORMAL:窗口为普通大小

# - cv2.WINDOW_FULLSCREEN:窗口全屏

# cv2.WND_PROP_AUTOSIZE:控制窗口大小是否自动调整,值为:

# - 0:不自动调整

# - 1:自动调整

# cv2.WND_PROP_TOPMOST:控制窗口是否总在最前面,值为:

# - 0:不总是最前

# - 1:总是最前

# cv2.WND_PROP_VISIBLE:控制窗口是否可见,值为:

# - 0:不可见

# - 1:可见

# value:设置的属性值,类型根据不同的属性标识符而变化。

# 返回值:

# 返回设置成功的值,通常为设置的属性值(成功时通常为 `value` 本身)。

#############################################################################################"""

# -*- coding: utf-8 -*-

# 作者: 胖墩会武术

# 日期: 1994-08-21

# OpenCV图像处理: https://blog.csdn.net/shinuone/article/details/126022763

1.4.2、窗口关闭 —— cv2.waitKey() + cv2.destroyAllWindows()

"""#############################################################################################

# 函数功能:等待用户按下键盘按键,函数返回按下的键的ASCII值或其他特定的键值。

# 函数说明:cv2.waitKey([delay])

# 参数说明:

# delay:等待的时间,单位为毫秒。如果 `delay` 为正数,函数会等待指定的时间(毫秒);如果为 0,函数会无限期等待直到用户按下按键。

# - delay > 0:等待指定的毫秒数,函数返回按下的键的ASCII值。

# - delay = 0:无限期等待用户按键,直到用户按下任意键,函数返回按下的键的ASCII值。

# - delay = -1:表示一直等待,通常和按键事件配合使用。

# 返回值:

# 返回按下的键的 ASCII 值,或者如果没有按键按下,则返回 -1。

# 如果用户按下了某些特定的键(例如,'Esc'),可以根据其返回值进行特定处理。

# 功能描述:

# - cv2.waitKey 用于等待键盘输入,通常在使用 `imshow()` 展示图像后调用,用于暂停程序并等待用户的操作。

# - 如果没有按键,且设置了 `delay > 0`,函数会在指定的毫秒后返回 -1;如果用户按下了某个键,函数返回对应的键的ASCII值。

# - 可以配合 `cv2.destroyAllWindows()` 使用,在用户按键后关闭所有窗口。

#############################################################################################"""

"""#############################################################################################

# 函数功能:关闭所有由 OpenCV 创建的窗口。

# 函数说明:cv2.destroyAllWindows()

# 参数说明:

# 此函数没有参数。

# 返回值:

# 无返回值。

# 功能描述:

# - `cv2.destroyAllWindows` 会关闭当前程序中所有通过 `cv2.imshow` 或 `cv2.namedWindow` 打开的窗口。

# - 通常与 `cv2.waitKey()` 配合使用,在用户按下某个键后关闭所有窗口。

# - 即使没有打开窗口,调用此函数也不会报错。

# 注意事项:

# - 在调用此函数之前,应确保程序已经完成所有窗口相关的操作。

# - 如果需要关闭特定窗口,可以使用 `cv2.destroyWindow(windowName)`。

#############################################################################################"""

# -*- coding: utf-8 -*-

# 作者: 胖墩会武术

# 日期: 1994-08-21

# OpenCV图像处理: https://blog.csdn.net/shinuone/article/details/126022763

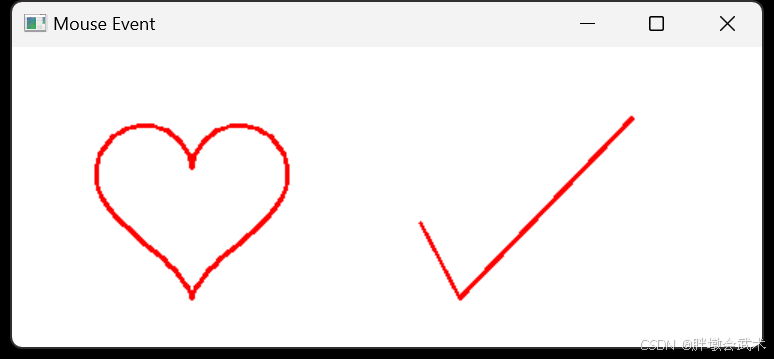

1.4.3、鼠标事件 —— cv2.setMouseCallback

import time

import cv2

import numpy as np

last_time = 0 # 初始化上次时间

def mouse_callback(event, x, y, flags, param):

"""回调函数,用来处理鼠标事件"""

global last_time

# 处理鼠标移动事件

if event == cv2.EVENT_MOUSEMOVE:

current_time = time.time() # 获取当前时间

# 如果距离上次事件超过3秒,则打印并更新last_time

if current_time - last_time > 3:

print(f"Mouse moved to ({x}, {y})")

last_time = current_time # 更新上次触发时间

# 处理鼠标左键按下事件

elif event == cv2.EVENT_LBUTTONDOWN:

print(f"Left button clicked at ({x}, {y})")

# 处理鼠标左键释放事件

elif event == cv2.EVENT_LBUTTONUP:

print(f"Left button released at ({x}, {y})")

# 处理鼠标右键按下事件

elif event == cv2.EVENT_RBUTTONDOWN:

print(f"Right button clicked at ({x}, {y})")

# 处理鼠标右键释放事件

elif event == cv2.EVENT_RBUTTONUP:

print(f"Right button released at ({x}, {y})")

# 处理鼠标中键按下事件

elif event == cv2.EVENT_MBUTTONDOWN:

print(f"Middle button clicked at ({x}, {y})")

# 处理鼠标中键释放事件

elif event == cv2.EVENT_MBUTTONUP:

print(f"Middle button released at ({x}, {y})")

# 处理鼠标左键双击事件

elif event == cv2.EVENT_LBUTTONDBLCLK:

print(f"Left button double clicked at ({x}, {y})")

# 处理鼠标右键双击事件

elif event == cv2.EVENT_RBUTTONDBLCLK:

print(f"Right button double clicked at ({x}, {y})")

# 处理鼠标中键双击事件

elif event == cv2.EVENT_MBUTTONDBLCLK:

print(f"Middle button double clicked at ({x}, {y})")

# 处理鼠标滚轮事件

elif event == cv2.EVENT_MOUSEWHEEL:

if flags > 0:

print(f"Mouse wheel moved up at ({x}, {y})")

else:

print(f"Mouse wheel moved down at ({x}, {y})")

# 处理鼠标横向滚轮事件

elif event == cv2.EVENT_MOUSEHWHEEL:

if flags > 0:

print(f"Mouse horizontal wheel moved right at ({x}, {y})")

else:

print(f"Mouse horizontal wheel moved left at ({x}, {y})")

if __name__ == "__main__":

image = 255 * np.ones(shape=(500, 500, 3), dtype=np.uint8)

cv2.imshow("Mouse Event", image)

# 设置鼠标事件回调

cv2.setMouseCallback("Mouse Event", mouse_callback)

cv2.waitKey(0)

cv2.destroyAllWindows()

"""##########################################################################

# 函数功能:设置鼠标事件回调函数 ———— 它允许用户为窗口设置一个回调函数,当在该窗口上触发鼠标事件时,回调函数会被调用。

# 函数说明:cv2.setMouseCallback(windowName, MouseCallback, param=None)

# 输入参数:

# windowName: 窗口名称,指定用于设置回调的窗口。

# MouseCallback: 鼠标响应回调函数,当鼠标事件发生时会自动调用该函数。

# param: 传递给回调函数的额外参数,默认为 None。

##########################################################################"""

"""##########################################################################

# 函数功能:鼠标事件回调函数 ———— 这是一个用户自定义的函数,用于处理鼠标事件。

# 函数说明:MouseCallback(int event, int x, int y, int flags, *userdata)

# 输入参数:

# event: 鼠标事件类型,表示鼠标的不同操作(如点击、移动、双击等)。常见的事件类型包括:

# (1) cv2.EVENT_MOUSEMOVE = 0 鼠标移动

# (2) cv2.EVENT_LBUTTONDOWN = 1 左键按下

# (3) cv2.EVENT_RBUTTONDOWN = 2 右键按下

# (4) cv2.EVENT_MBUTTONDOWN = 3 中键按下

# (5) cv2.EVENT_LBUTTONUP = 4 左键释放

# (6) cv2.EVENT_RBUTTONUP = 5 右键释放

# (7) cv2.EVENT_MBUTTONUP = 6 中键释放

# (8) cv2.EVENT_LBUTTONDBLCLK = 7 左键双击

# (9) cv2.EVENT_RBUTTONDBLCLK = 8 右键双击

# (10) cv2.EVENT_MBUTTONDBLCLK = 9 中键双击

# (11) cv2.EVENT_MOUSEWHEEL = 10 滚轮滑动(滚动方向:向上滚动时通常是负值,向下滚动时是正值)

# (12) cv2.EVENT_MOUSEHWHEEL = 11 横向滚轮滑动(较少使用)

# x, y: 鼠标在窗口中的位置,表示鼠标事件发生时的坐标。

# flags: 鼠标按键和键盘修饰符,用于传递额外的信息(如 Ctrl、Shift 或 Alt)。常见的标志包括:

# (1) cv2.EVENT_FLAG_LBUTTON = 1 左键按下标志。与 EVENT_LBUTTONDOWN 一起使用。

# (2) cv2.EVENT_FLAG_RBUTTON = 2 右键按下标志。与 EVENT_RBUTTONDOWN 一起使用。

# (3) cv2.EVENT_FLAG_MBUTTON = 4 中键按下标志。与 EVENT_MBUTTONDOWN 一起使用。

# (4) cv2.EVENT_FLAG_CTRLKEY = 8 Ctrl 键按下标志

# (5) cv2.EVENT_FLAG_SHIFTKEY = 16 Shift 键按下标志

# (6) cv2.EVENT_FLAG_ALTKEY = 32 Alt 键按下标志

# userdata: 可选参数,可用于传递额外的自定义数据给回调函数(例如图像对象等)。

#

# 鼠标事件组合(示例)

# cv2.EVENT_LBUTTONDOWN + cv2.EVENT_FLAG_CTRLKEY 表示鼠标左键按下时同时按下了 Ctrl 键。

# cv2.EVENT_LBUTTONUP + cv2.EVENT_FLAG_ALTKEY 表示鼠标左键松开时按下了 Alt 键。

##########################################################################"""

# -*- coding: utf-8 -*-

# 作者: 胖墩会武术

# 日期: 1994-08-21

# OpenCV图像处理: https://blog.csdn.net/shinuone/article/details/126022763

(1)鼠标 - 绘制线条

import cv2

import numpy as np

def love_path(image):

# 计算爱心形状的路径

heart_points = []

for t in np.linspace(0, 2 * np.pi, 100): # 生成100个点,点数可以根据需要调整

x = 16 * np.sin(t) ** 3

y = 13 * np.cos(t) - 5 * np.cos(2 * t) - 2 * np.cos(3 * t) - np.cos(4 * t)

heart_points.append((int(120 + x * 4), int(100 - y * 4))) # 缩放并平移

# 使用直线连接这些点

for i in range(len(heart_points) - 1):

cv2.line(image, heart_points[i], heart_points[i + 1], (0, 0, 255), 2)

def mouse_callback(event, x, y, flags, param):

"""回调函数,用来处理鼠标事件"""

global ix, iy, drawing, image

# 鼠标左键按下时

if event == cv2.EVENT_LBUTTONDOWN:

drawing = True # 开始绘制

ix, iy = x, y # 记录按下位置

# image = 255 * np.ones(shape=(500, 500, 3), dtype=np.uint8) # 在按下时在图像上清除以前的内容

# 鼠标移动时

elif event == cv2.EVENT_MOUSEMOVE:

if drawing: # 如果正在绘制

# 在按下位置和当前鼠标位置之间画线

temp_image = image.copy() # 防止直接修改图像

cv2.line(temp_image, (ix, iy), (x, y), (0, 0, 255), 2) # 红色线条

cv2.imshow("Mouse Event", temp_image) # 显示更新后的图像

# 鼠标左键释放时

elif event == cv2.EVENT_LBUTTONUP:

drawing = False # 结束绘制

# 在最终位置绘制线条

cv2.line(image, (ix, iy), (x, y), (0, 0, 255), 2) # 红色线条

cv2.imshow("Mouse Event", image) # 显示最终图像

if __name__ == "__main__":

# (1)初始化变量

drawing = False # 是否在绘制线条

ix, iy = -1, -1 # 鼠标按下位置

image = 255 * np.ones(shape=(200, 500, 3), dtype=np.uint8) # 创建一个空白的窗口

love_path(image) # 初始化一个图形

cv2.imshow("Mouse Event", image) # 显示图像(当做一个画布Canvas)

# (2)设置鼠标事件回调

cv2.setMouseCallback("Mouse Event", mouse_callback)

cv2.waitKey(0)

cv2.destroyAllWindows()

# -*- coding: utf-8 -*-

# 作者: 胖墩会武术

# 日期: 1994-08-21

# OpenCV图像处理: https://blog.csdn.net/shinuone/article/details/126022763

(2)鼠标 - 绘制矩形

"""#########################################################################

# 功能:矩形涂鸦画板

# 描述:鼠标左键按下拖动绘制矩形,鼠标左键弹起时完成绘制

# (1)按' c '键清空画板

# (2)按' ESC '键退出

#########################################################################"""

import numpy as np

import cv2

from random import randint

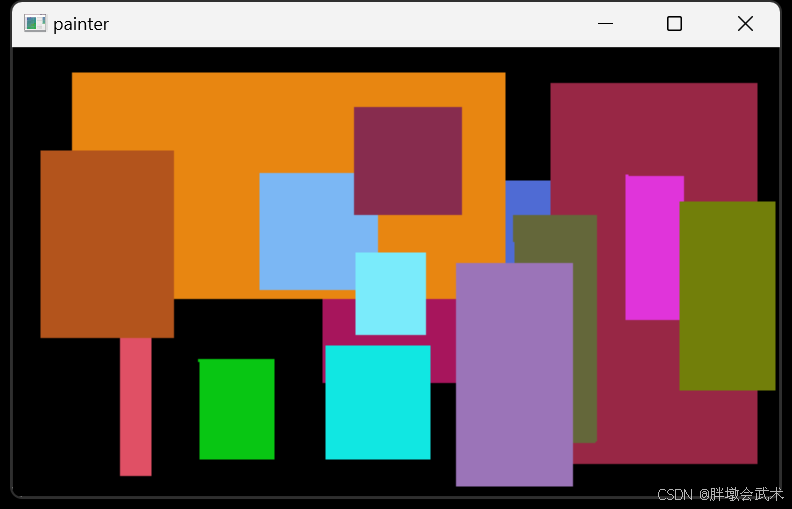

class Painter:

def __init__(self) -> None:

self.mouse_is_pressed = False

self.last_pos = (-1, -1)

self.width = 300

self.height = 512

self.img = np.zeros((self.width, self.height, 3), np.uint8)

self.window_name = 'painter'

self.color = None

def run(self):

print('画板,拖动鼠标绘制矩形框,按ESC退出,按c键清空画板')

cv2.namedWindow(self.window_name)

cv2.setMouseCallback(self.window_name, lambda event, x, y, flags, param: self.on_draw(event, x, y, flags, param))

while True:

cv2.imshow(self.window_name, self.img)

k = cv2.waitKey(1) & 0xFF

if k == ord('c'): # 按' c '键清空画板

self.clean() # (调用自定义函数):清除画板

elif k == 27: # 按' ESC '键退出

break

cv2.destroyAllWindows()

def on_draw(self, event, x, y, flags, param):

# TODO(You): 请正确实现画板事件响应,完成功能

# 触发左键按下 -> 触发鼠标移动 -> 开始画矩形 -> 触发左键抬起 -> 终止画矩形

pos = (x, y) # 鼠标按下的位置坐标

if event == cv2.EVENT_LBUTTONDOWN: # 触发左键按下

self.mouse_is_pressed = True

self.last_pos = pos

elif event == cv2.EVENT_MOUSEMOVE: # 触发鼠标移动

if self.mouse_is_pressed == True: # 判断鼠标是否按下

self.begin_draw_rectangle(self.last_pos, pos) # (调用自定义函数):开始画矩形

elif event == cv2.EVENT_LBUTTONUP: # 触发左键抬起

self.end_draw_rectangle(self.last_pos, pos) # (调用自定义函数):终止画矩形

self.mouse_is_pressed = False

def clean(self):

cv2.rectangle(self.img, (0, 0), (self.height, self.width), (0, 0, 0), -1)

def begin_draw_rectangle(self, pos1, pos2):

if self.color is None: # 设置颜色(每个矩形的颜色都随机)

self.color = (randint(0, 256), randint(0, 256), randint(0, 256)) # 随机生成三通道颜色

cv2.rectangle(self.img, pos1, pos2, self.color, -1)

def end_draw_rectangle(self, pos1, pos2):

self.color = None

if __name__ == '__main__':

p = Painter() # 类的实例化

p.run() # 调用类函数

# -*- coding: utf-8 -*-

# 作者: 胖墩会武术

# 日期: 1994-08-21

# OpenCV图像处理: https://blog.csdn.net/shinuone/article/details/126022763

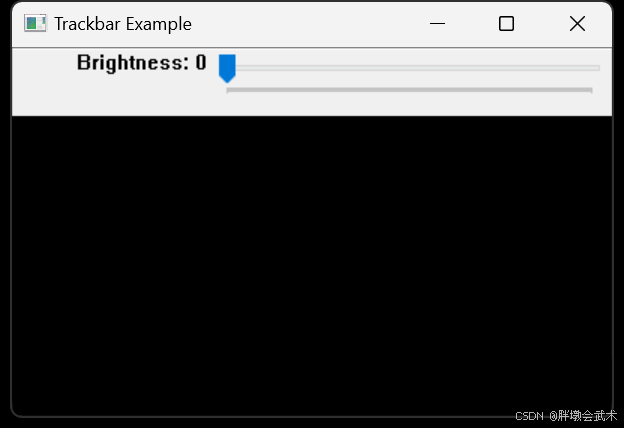

1.4.4、滑动条 —— cv2.createTrackbar()、cv2.getTrackbarPos()

import cv2

import numpy as np

def on_trackbar(val):

"""回调函数,用来处理滑动条变化事件"""

current_value = cv2.getTrackbarPos("Brightness", "Trackbar Example") # 获取当前滑动条的值

print(f"当前滑动条值:{current_value}")

if __name__ == '__main__':

image = np.zeros((200, 400, 3), dtype=np.uint8)

cv2.imshow("Trackbar Example", image) # 创建窗口

cv2.createTrackbar("Brightness", "Trackbar Example", 0, 255, on_trackbar) # 创建滑动条

cv2.waitKey(0)

cv2.destroyAllWindows()

"""#########################################################################

# 功能说明:创建一个滑动条控件,放置在指定的窗口中,并绑定一个回调函数。———— 当滑动条的值变化时,回调函数会被触发。

# 函数说明: cv2.createTrackbar(Track_name, img, min, max, TrackbarCallback)

# 输入参数:

# Track_name: 滑动条的名称,必须是一个字符串

# img: 滑动条所在的窗口或画布

# min: 滑动条的最小值

# max: 滑动条的最大值

# TrackbarCallback:当滑动条值变化时,被调用的回调函数。此函数必须接受一个参数,表示滑动条当前的值。

#########################################################################"""

"""#########################################################################

# 功能说明:获取滑动条的值

# 函数说明:value = cv2.getTrackbarPos(Track_name, img)

# 输入参数:

# Track_name: 滑动条的名称

# img: 滑动条所在的窗口或画布

# 输出参数:

# 当前滑动条所在位置的数值(整数)

#########################################################################"""

# -*- coding: utf-8 -*-

# 作者: 胖墩会武术

# 日期: 1994-08-21

# OpenCV图像处理: https://blog.csdn.net/shinuone/article/details/126022763

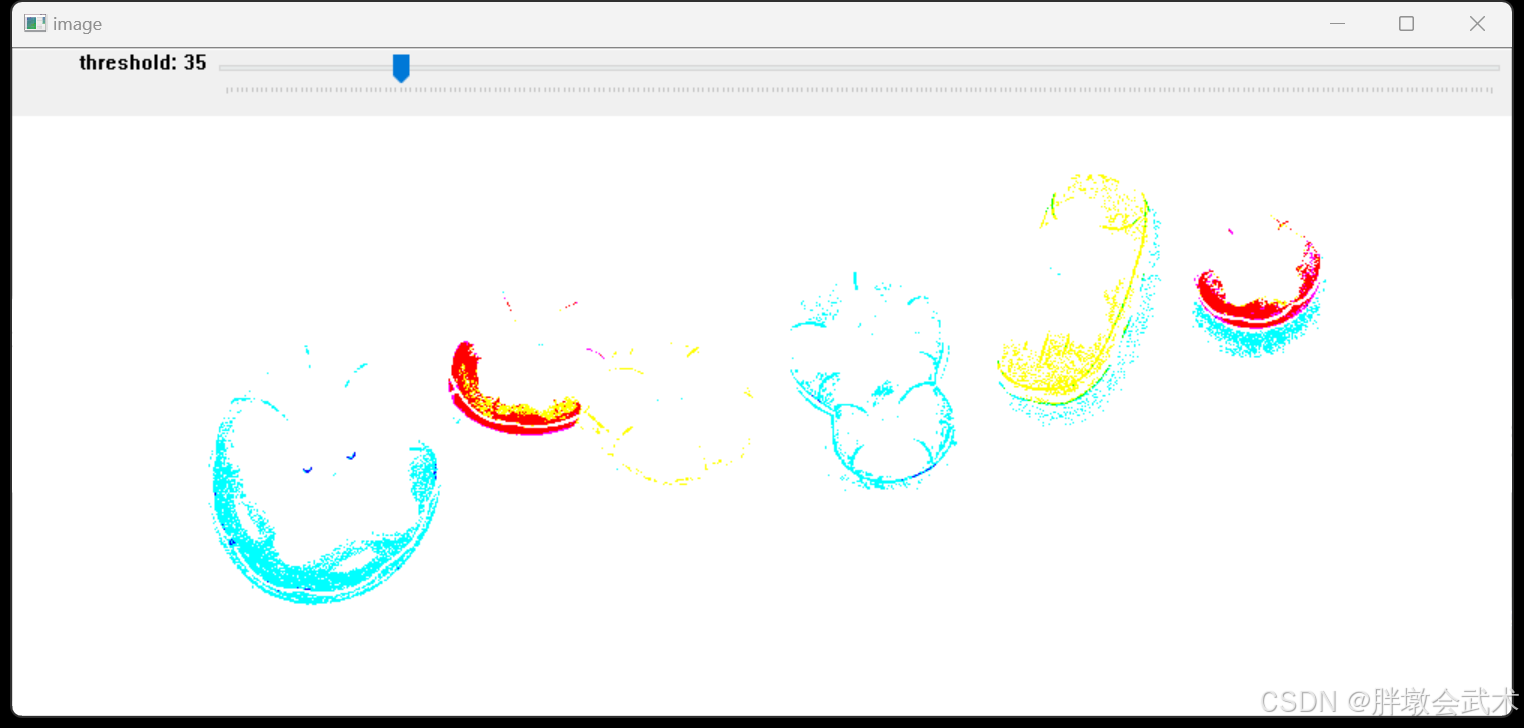

(1)动态二值化图像

import cv2

image = cv2.imread('image.jpg')

cv2.imshow('image', image) # 创建窗口

cv2.createTrackbar('threshold', 'image', 0, 255, lambda x: None) # 创建阈值滑动条

while True:

threshold_value = cv2.getTrackbarPos('threshold', 'image') # 获取滑动条的阈值

threshold_image = cv2.threshold(image, threshold_value, 255, cv2.THRESH_BINARY)[1] # 阈值图像

cv2.imshow('image', threshold_image)

if cv2.waitKey(1) == 27: # Esc退出

break

cv2.destroyAllWindows()

# -*- coding: utf-8 -*-

# 作者: 胖墩会武术

# 日期: 1994-08-21

# OpenCV图像处理: https://blog.csdn.net/shinuone/article/details/126022763

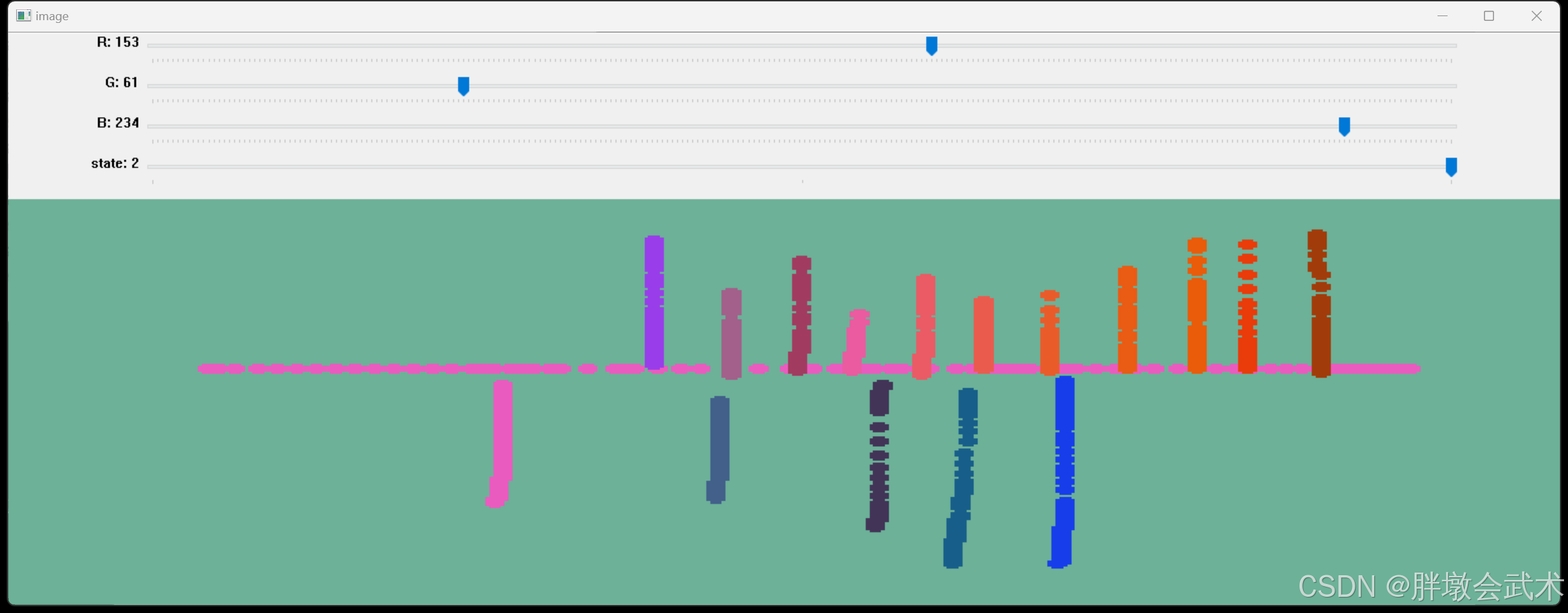

(2)RGB调色板

"""#########################################################################

# (1)滑动条控制R、G、B的值

# (2)开关按钮switch

# 0:画板清除(全黑)

# 1:画板调色(显示当前RGB对应的颜色)

# 2:图形调色(先设置线条颜色,然后绘制图形。注意:选择不一样的线条颜色和画板背景颜色)

#########################################################################"""

import cv2

import numpy as np

def nothing(x):

pass

def mouse_callback(event, x, y, flags, param):

if flags == cv2.EVENT_FLAG_LBUTTON and event == cv2.EVENT_MOUSEMOVE:

cv2.circle(image, (x, y), 1, [b, g, r], 2)

if __name__ == '__main__':