本文主要介绍Dropout及延伸下来的一些方法,以便更深入的理解。

想要提高CNN的表达或分类能力,最直接的方法就是采用更深的网络和更多的神经元,即deeper and wider。但是,复杂的网络也意味着更加容易过拟合。于是就有了Dropout,大部分实验表明其具有一定的防止过拟合的能力。

1- Dropout

最早的Dropout可以看Hinton的这篇文章

《Improving neural networks by preventing co-adaptation of feature Detectors》

从文章的名字我们就可以先对Dropout的工作原理有个猜测:过拟合意味着网络记住了训练样本,而打破网络固定的工作方式,就有可能打破这种不好的记忆。

Ok,我们直接来看什么是Dropout:

需要注意的是:论文中Dropout被使用在全连接层之后,而目前的caffe框架中,其可以使用在各种层之后。

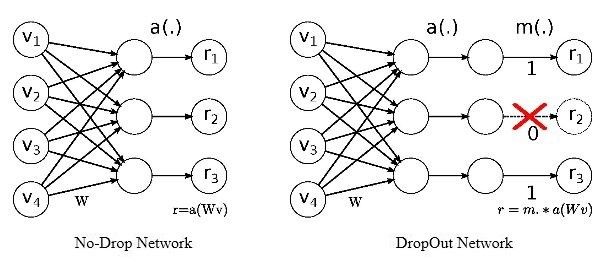

如上图左,为没有Dropout的普通2层全连接结构,记为 r=a(Wv),其中a为激活函数。

如上图右,为在第2层全连接后添加Dropout层的示意图。即在 模 型 训 练 时 随机让网络的某些节点不工作(输出置0)

本文详细解析了Dropout和DropConnect两种防止神经网络过拟合的技术。Dropout通过在训练过程中随机关闭神经元来防止网络过度依赖特定特征,而DropConnect则是随机置零权重,增加随机性。实验表明,两者都能有效防止过拟合,但Dropout应用更为广泛。

本文详细解析了Dropout和DropConnect两种防止神经网络过拟合的技术。Dropout通过在训练过程中随机关闭神经元来防止网络过度依赖特定特征,而DropConnect则是随机置零权重,增加随机性。实验表明,两者都能有效防止过拟合,但Dropout应用更为广泛。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

772

772

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?