导读

在可变形注意力中为不同尺度的特征设置不同的采样点数,提出了一种可选的离散采样算子来替代 RT-DETR 中特有的 grid_sample 算子,提出了动态数据增强和自适应超参数定制,以在不损失速度的情况下提升性能。

摘要

在本报告中,我们介绍了RT-DETRv2,这是一种改进的实时检测Transformer(RT-DETR)。RT-DETRv2 在先前的实时检测器 RT-DETR 的基础上进行了改进,并引入了一系列灵活性和实用性的优化方案,同时优化了训练策略以实现性能提升。为了提高灵活性,我们建议在可变形注意力中为不同尺度的特征设置不同的采样点数,从而实现解码器的选择性多尺度特征提取。为了增强实用性,我们提出了一种可选的离散采样算子来替代 RT-DETR 中特有的 grid_sample 算子,相比 YOLOs,这消除了通常与 DETRs 相关的部署限制。对于训练策略,我们提出了动态数据增强和自适应超参数定制,以在不损失速度的情况下提升性能。源代码和预训练模型将在 https://github.com/lyuwenyu/RT-DETR 上提供。

1、介绍

目标检测是一项基本的视觉任务,涉及在图像中识别和定位物体。其中,实时目标检测是一个重要的领域,并且有着广泛的应用,例如自动驾驶(Atakishiyev 等人 [2024])。在过去几年的发展中,YOLO 检测器(Redmon 和 Farhadi [2017, 2018],Bochkovskiy 等人 [2020],Glenn [2022],Xu 等人 [2022],Li 等人 [2023],Wang 等人 [2023],Glenn [2023],Wang 等人 [2024a,b])无疑是该领域中最负盛名的框架。这是因为 YOLO 检测器在性能和速度之间取得了合理的平衡。

RT-DETR(Zhao 等人 [2024])的出现为实时目标检测开辟了一条新的技术途径,打破了该领域对 YOLO 的依赖。RT-DETR 提出了一种高效的混合编码器来替代 DETR(Carion 等人 [2020])中的标准 Transformer 编码器,通过解耦多尺度特征的尺度内交互和跨尺度融合显著提高了推理速度。为进一步提升性能,RT-DETR 提出了不确定性最小化查询选择机制,通过显式优化不确定性向解码器提供高质量的初始查询。此外,RT-DETR 提供了多种检测器尺寸并支持灵活的速度调整,无需重新训练即可适应各种实时场景。RT-DETR 是一种全新的端到端实时检测器,标志着 DETR 家族的重大进步。

在本报告中,我们介绍了 RT-DETRv2,这是一种改进的实时检测 Transformer。这项工作基于最近的 RT-DETR 并在 DETR 家族内部引入了一系列灵活性和实用性的优化选项,同时优化了训练策略以实现更好的性能。具体而言,RT-DETRv2 建议在可变形注意力模块中为不同尺度的特征设置不同的采样点数,以实现解码器的选择性多尺度特征提取。在增强实用性方面,RT-DETRv2 提供了一个可选的离散采样算子来替换原始的 grid_sample 算子,后者是 DETRs 特有的,从而消除了通常与检测 Transformer 相关的部署限制。此外,RT-DETRv2 优化了训练策略,包括动态数据增强和自适应超参数定制,旨在提升性能的同时不损失速度。实验结果表明,RT-DETRv2 为 RT-DETR 提供了一个改进的基线,增加了灵活性和实用性,提出的训练策略优化了性能和训练成本。

2、方法

RT-DETRv2 的框架与 RT-DETR 保持一致,仅对解码器中的可变形注意力模块进行了修改。

2.1 框架

不同尺度下不同的采样点数量。当前的 DETRs 使用可变形注意力模块(Zhu 等人 [2020])来缓解由多尺度特征组成的长输入序列带来的高计算开销。RT-DETR 解码器保留了这个模块,并在每个尺度上定义了相同的采样点数量。我们认为这种约束忽略了不同尺度特征之间的固有差异,限制了可变形注意力模块的特征提取能力。因此,我们提出为不同尺度设置不同的采样点数量,以实现更灵活高效的特征提取。

离散采样。为了提高 RT-DETR 的实用性并使其在各种环境中可用,我们专注于比较 YOLOs 和 RT-DETR 的部署要求,其中 RT-DETR 专用的 grid_sample 运算符限制了其广泛应用。因此,我们提出一个可选的 discrete_sample 运算符来替换 grid_sample,从而去除 RT-DETR 的部署限制。具体来说,我们在预测的采样偏移量上执行四舍五入操作,省去了耗时的双线性插值。然而,四舍五入操作是非可微的,所以我们关闭用于预测采样偏移量的参数梯度。在实践中,我们首先使用 grid_sample 运算符进行训练,然后在微调阶段将其替换为 discrete_sample 运算符。对于推理和部署,模型采用 discrete_sample 运算符。

2.2 训练方案

动态数据增强。为了使模型具备强大的检测性能,我们提出了动态数据增强策略。考虑到检测器在早期训练期间的泛化能力较差,我们应用更强的数据增强,而在后期训练期间则降低其强度,使检测器适应目标域的检测。具体来说,我们在早期阶段保持 RT-DETR 的数据增强策略,而在最后两个epoch中关闭 RandomPhotometricDistort、RandomZoomOut、RandomIoUCrop 和 MultiScaleInput。

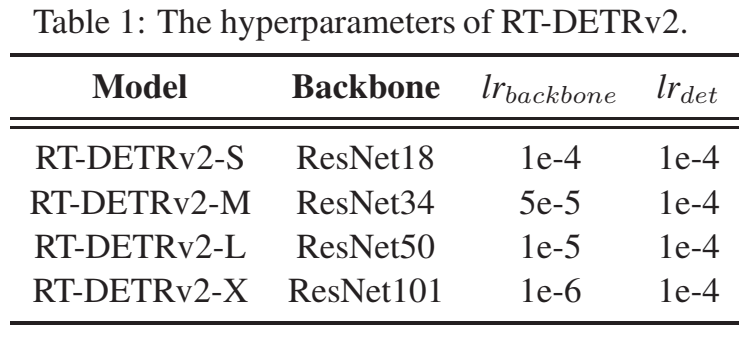

自适应超参数定制。我们还观察到不同尺寸的缩放 RT-DETR 模型使用相同的优化器超参数进行训练,导致其性能不佳。因此,我们提出了针对缩放 RT-DETR 的自适应超参数定制方法。考虑到轻量级检测器(如 ResNet18 [He 等人 2016])预训练主干网络的特征质量较低,我们提高了其学习率。相反地,大型检测器(如 ResNet101 [He 等人 2016])预训练主干网络具有更高的特征质量,我们降低了其学习率。

3、实验

3.1 实现细节

与 RT-DETR 一样,我们使用在 ImageNet 上预训练的 ResNet(He 等人 [2016])作为主干网络,并使用 AdamW 优化器(Loshchilov 和 Hutter [2018])以批量大小为 16 来训练 RT-DETRv2,并应用指数移动平均(EMA),其中 ema_decay = 0.9999。对于可选的离散采样,我们首先使用 grid_sample 运算符进行 6 倍预训练,然后使用 discrete_sample 运算符进行 1 倍微调。对于自适应超参数定制,超参数如表 1 所示,其中 lr 表示学习率。

3.2 评估

RT-DETRv2 在 COCO(Lin 等人 [2014])的 train2017 数据集上进行训练,并在 COCO 的 val2017 数据集上进行验证。我们报告了标准的 AP 指标(在 0.50 至 0.95 之间以 0.05 的步长均匀采样的 IoU 阈值上取平均值),以及在实际场景中常用的 APval 50。

3.3 结果

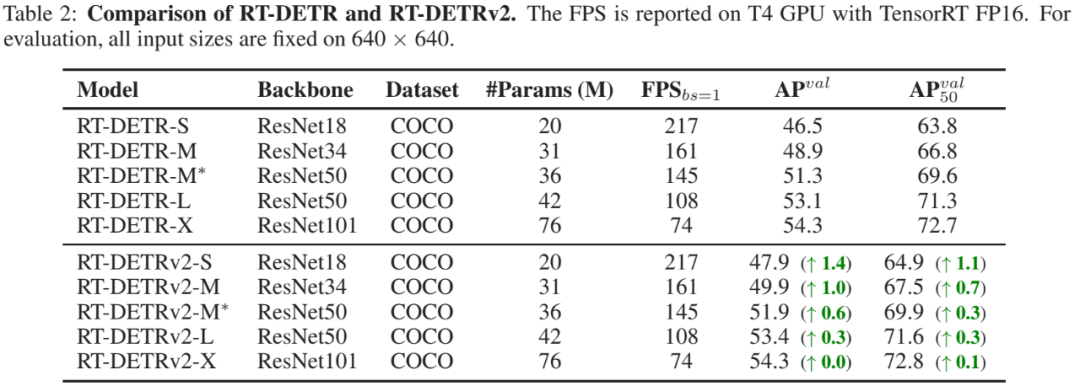

与 RT-DETR(Zhao 等人 [2024])的对比结果如表 2 所示。RT-DETRv2 在不同规模的检测器上表现优于 RT-DETR,且速度没有损失。

3.4 消融实验

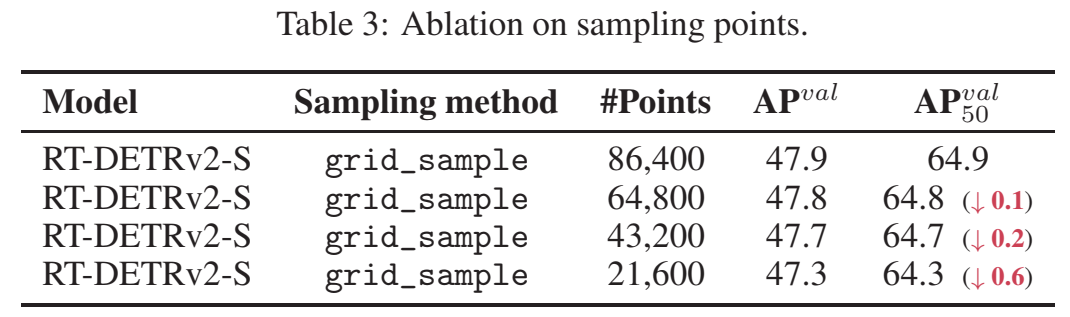

关于采样点的消融研究。我们对网格采样(grid_sample)操作符的总采样点数量进行了消融研究。总采样点数量计算公式为 num_head × num_point × num_query × num_decoder,其中 num_point 表示每个网格中每个尺度特征的采样点之和。研究结果表明,减少采样点的数量并不会导致性能的显著下降,详见表 3。这意味着在大多数工业场景中,实际应用不太会受到影响。

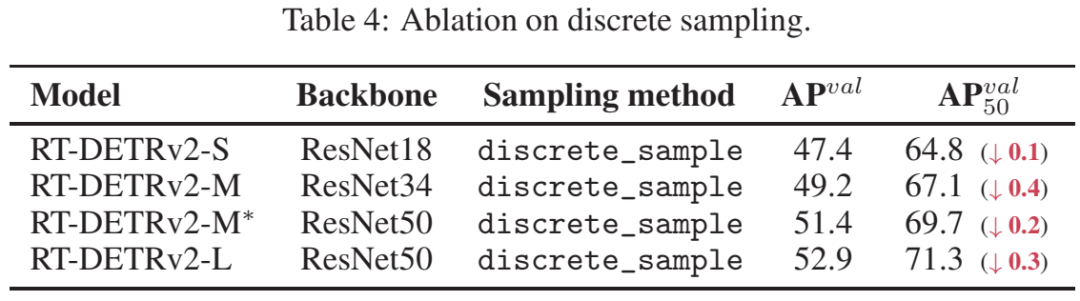

关于离散采样的消融研究。然后,我们移除了网格采样(grid_sample),并替换成离散采样(discrete_sample)进行消融研究。结果表明,这一操作不会导致 APval 50 的显著下降,但确实消除了 DETRs 的部署限制,详见表 4。

4、结论

在本报告中,我们提出了改进的实时检测Transformer RT-DETRv2。RT-DETRv2 引入了一系列无需额外成本的优化方法,以提高 RT-DETR 的灵活性和实用性,通过优化训练策略实现了性能的提升而没有损失速度。我们希望本报告能够为 DETR 系列模型提供见解,并拓展 RT-DETR 的应用范围。

请长按或扫描二维码关注本公众号

喜欢的话,请给我个在看吧!

1521

1521

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?