Dropout(丢弃)

首先需要讲一下过拟合,训练一个大型网络时,因为训练数据有限,很容易出现过拟合。过拟合是指模型的泛化能力差,网络对训练数据集的拟合能力很好,但是换了其他的数据集,拟合能力就变差了。

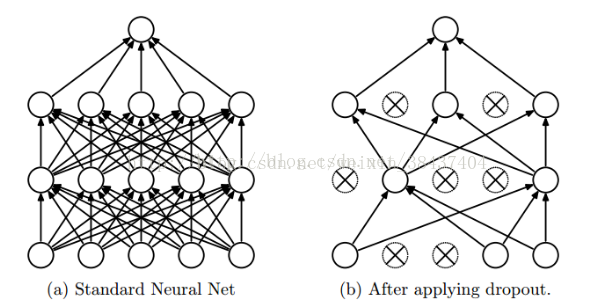

在训练深层网络模型时,按照一定的概率,暂时将神经元丢弃,得到一个更加简单的网络模型,即每一个batch训练的网络模型都是不一样的,都是原始网络的子集,这些子网络共享权值,与原始网络的层数、参数数目相等。这样,每一个神经元在网络中出现都是独立的,不会依赖其他神经元。不同的batch训练得到更多的子网络,提高了网络模型的泛化能力,可以防止过拟合。

由上图可以看出,(a)是原始神经网络,(b)是

本文探讨了深度学习中过拟合的问题,重点介绍了Dropout技术作为防止过拟合的有效手段。通过在训练过程中随机丢弃部分神经元,Dropout能创建多个子网络,增强模型的泛化能力。在测试阶段,所有子网络的输出按概率加权平均,以提高预测精度。实验发现,dropout率为0.5时效果最佳,但可能延长模型的收敛时间。

本文探讨了深度学习中过拟合的问题,重点介绍了Dropout技术作为防止过拟合的有效手段。通过在训练过程中随机丢弃部分神经元,Dropout能创建多个子网络,增强模型的泛化能力。在测试阶段,所有子网络的输出按概率加权平均,以提高预测精度。实验发现,dropout率为0.5时效果最佳,但可能延长模型的收敛时间。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

3009

3009

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?