研究图上的异常检测~

表示学习入门萌新~

跪求指点交流~

1.介绍

GNN由一个迭代的过程组成,传播节点的状态直至平衡,紧接着跟着一个神经网络,基于状态产生输出。目前的方法分成了2类,基于谱的方法和非基于谱的方法。

一方面,基于谱的方法有很大成功,在【Bruna et al. (2014)】卷积操作被定义在傅里叶域,通过计算图拉普拉斯矩阵的特征值,导致计算密集以及没有了cnn那种局部的过滤器。[ Henaff et al. ]提出了一种参数化的普过滤器,来让他们可以局部考虑。【, Kipf & Welling 】提出通过通过计算图的拉普拉斯矩阵的切比雪夫来近似过滤器。最后kf把操作限制在了一步。

非谱聚类的方法:直接在空间亲近的邻居执行操作。重大的挑战在于维护一个操作算子,可以处理不同大小的邻居,像cnn那样。包括为每个节点学习一个矩阵,利用转移矩阵的幂次去定义,GraphSage 用inductive的方法计算节点表示,通过采样固定数目的邻居,然后执行操作,大规模上表现很好。

attention在越来越多领域表现很好。

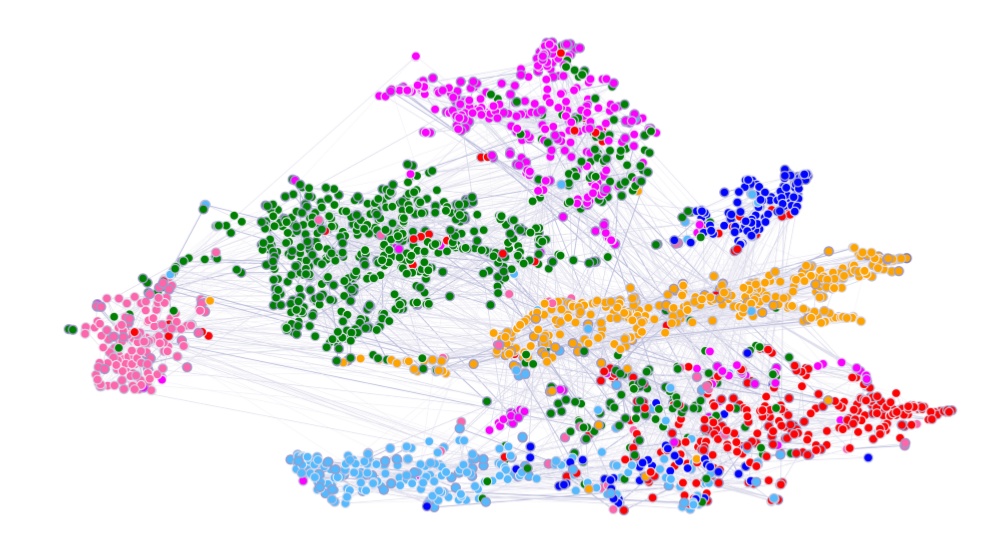

基于以上工作:提出了基于注意力的结构来在图结构上做分类。想法是在图中,通过拓展邻居信息,计算节点的隐层表示。

特点。

1.快速。(计算上下文重要性的时候,

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

3万+

3万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?