文章目录

颠覆认知: 你是否认为开发AI应用需要编程能力?现在,DeepSeek + Dify 打破这一认知,通过 Dify 的拖拽式界面,任何人都能轻松开发出符合企业需求的AI应用!

神操作: 无论是开发 智能客服、合同审查工具、还是 竞品分析仪,都可以通过 Dify 快速搭建。上传Excel表格,系统自动生成数据报告,接入微信或其他平台,马上打造一个24小时在线的问答机器人。

实际案例: 某律所通过 Dify + DeepSeek,仅用了 3天 就开发出了一个“法律条款检索系统”,新人律师的工作效率提升了 200%!通过零代码开发,他们在短时间内完成了AI应用的部署,节省了大量的开发成本。

一、Docker下载和安装

1. 下载Docker

打开官网链接:https://www.docker.com/ 点击Download Docker Desktop选择“Download for Windows - AMD64”下载

2. 安装Docker

一路下一步,双击”Docker Desktop Installer.exe”自动安装完成。

3. 配置Docker 镜像路径

,打开“Docker Desktop”软件然后配置镜像地址,点击”Settings”—“Resources”—”Advanced”先配置镜像存储位置Disk image location例如存储路径:“E:\Docker\DockerDesktopWSL”

4. 配置Docker 下载镜像源

再点击“Docker Engine”配置,用途是解决拉取镜像失败的情况,新增配置如下:

直接复制覆盖即可

{

"builder": {

"gc": {

"defaultKeepStorage": "20GB",

"enabled": true

}

},

"experimental": false,

"registry-mirrors": [

"https://dockerpull.org",

"https://docker.1panel.dev",

"https://docker.foreverlink.love",

"https://docker.fxxk.dedyn.io",

"https://docker.xn--6oq72ry9d5zx.cn",

"https://docker.zhai.cm",

"https://docker.5z5f.com",

"https://a.ussh.net",

"https://docker.cloudlayer.icu",

"https://hub.littlediary.cn",

"https://hub.crdz.gq",

"https://docker.unsee.tech",

"https://docker.kejilion.pro",

"https://registry.dockermirror.com",

"https://hub.rat.dev",

"https://dhub.kubesre.xyz",

"https://docker.nastool.de",

"https://docker.udayun.com",

"https://docker.rainbond.cc",

"https://hub.geekery.cn",

"https://docker.1panelproxy.com",

"https://atomhub.openatom.cn",

"https://docker.m.daocloud.io",

"https://docker.1ms.run",

"https://docker.linkedbus.com"

]

}

5. 重启Docker服务

点击右下角【Apply & restart】,等待完成即可。

二、Ollama 下载、安装

本地部署DeepSeek + Ollama 小白也能轻松搞定!

三、Dify 下载和安装

3.1. Dify下载

Dify项目github地址:https://github.com/langgenius/dify

下载链接:https://github.com/langgenius/dify/archive/refs/heads/main.zip

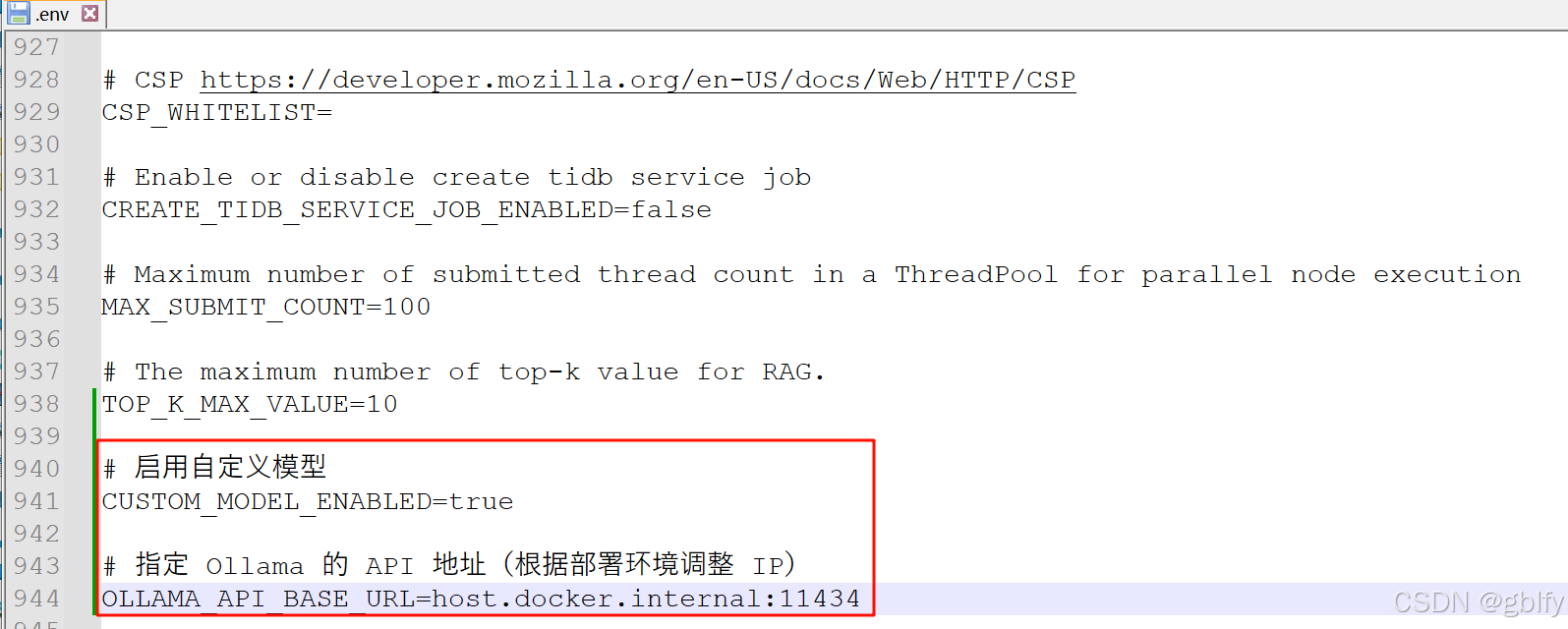

3.2. Dify 配置

解压dify-main.zip包,重命名dify-main名称为dify

将dify\docker目录下的.env.example文件重命名为.env

编辑.env文件,在最后添加2行配置

# 启用自定义模型

CUSTOM_MODEL_ENABLED=true

# 指定 Ollama 的 API 地址(根据部署环境调整 IP)

OLLAMA_API_BASE_URL=host.docker.internal:11434

3.3. Dify 安装

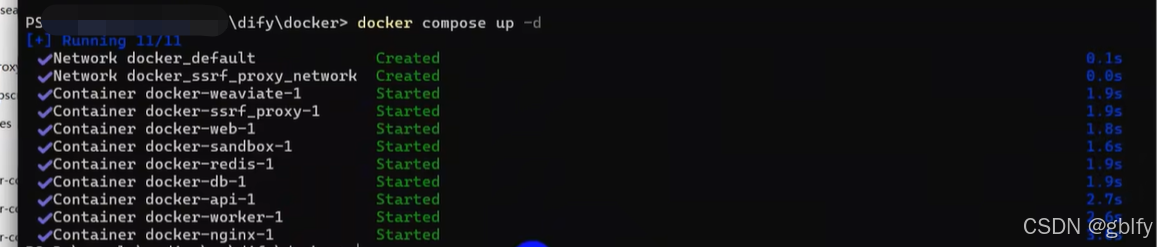

然后在“docker”文件夹下的空白处右击”在终端中打开”会弹出“windows powershell”窗口,在命令行中键入“docker compose up -d”拉取镜像依赖环境

docker compose up -d

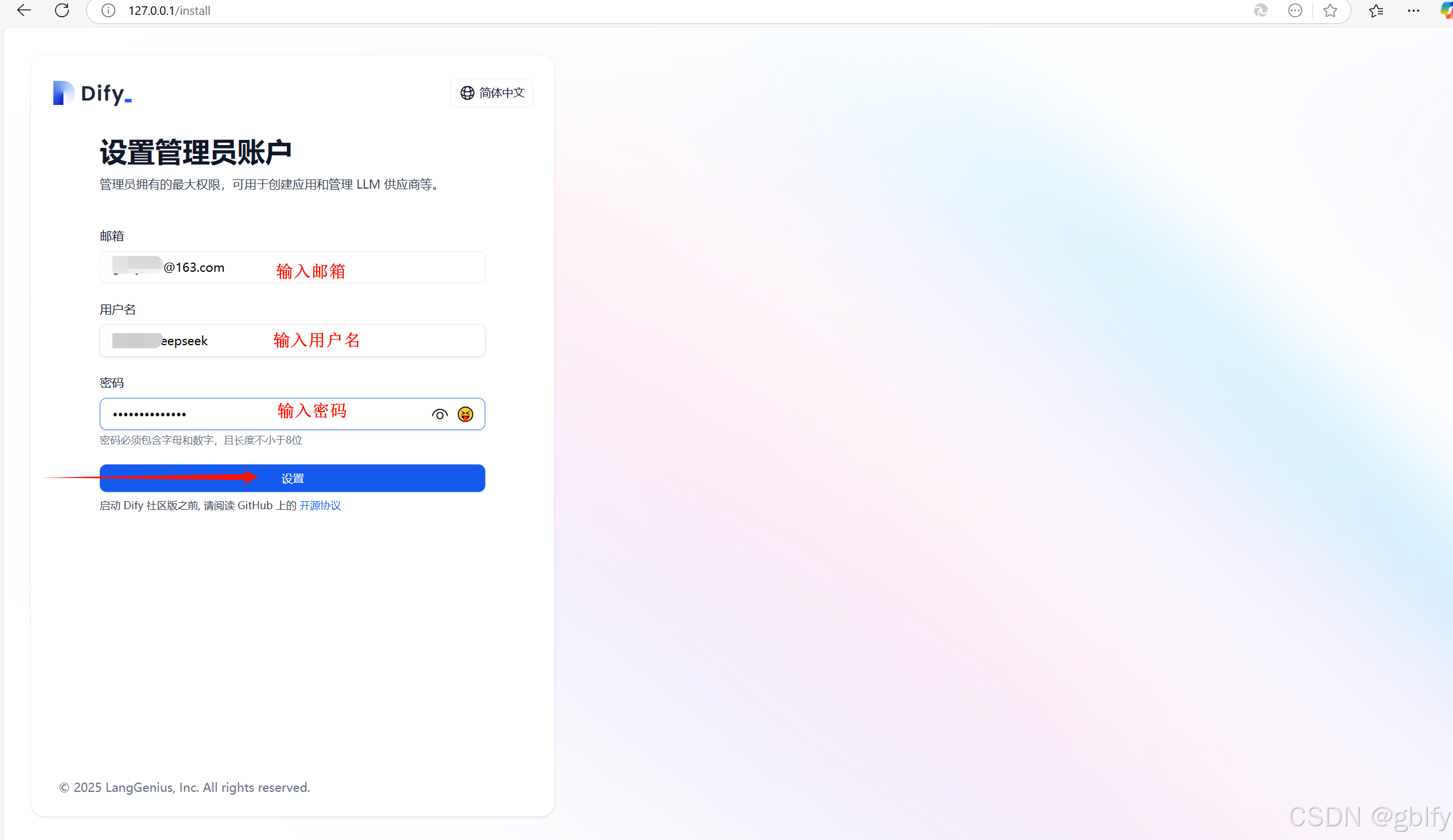

3.4. Dify创建账号

http://127.0.0.1/install

登录

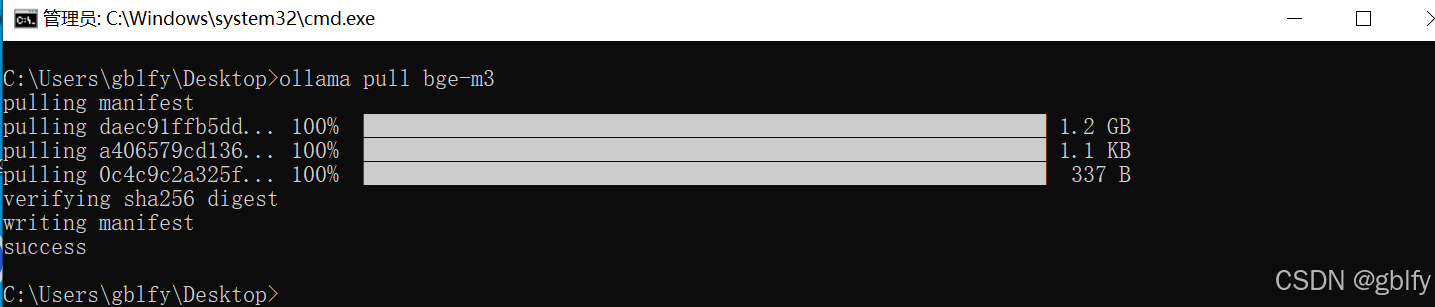

四、Embedding模型下载

拉取“embedding”模型—”bge-m3”,打开网址:

https://ollama.com/library/bge-m3 点击复制“ollama pull bge-m3”置于命令行中按键盘“回车”拉取模型完成

ollama pull bge-m3

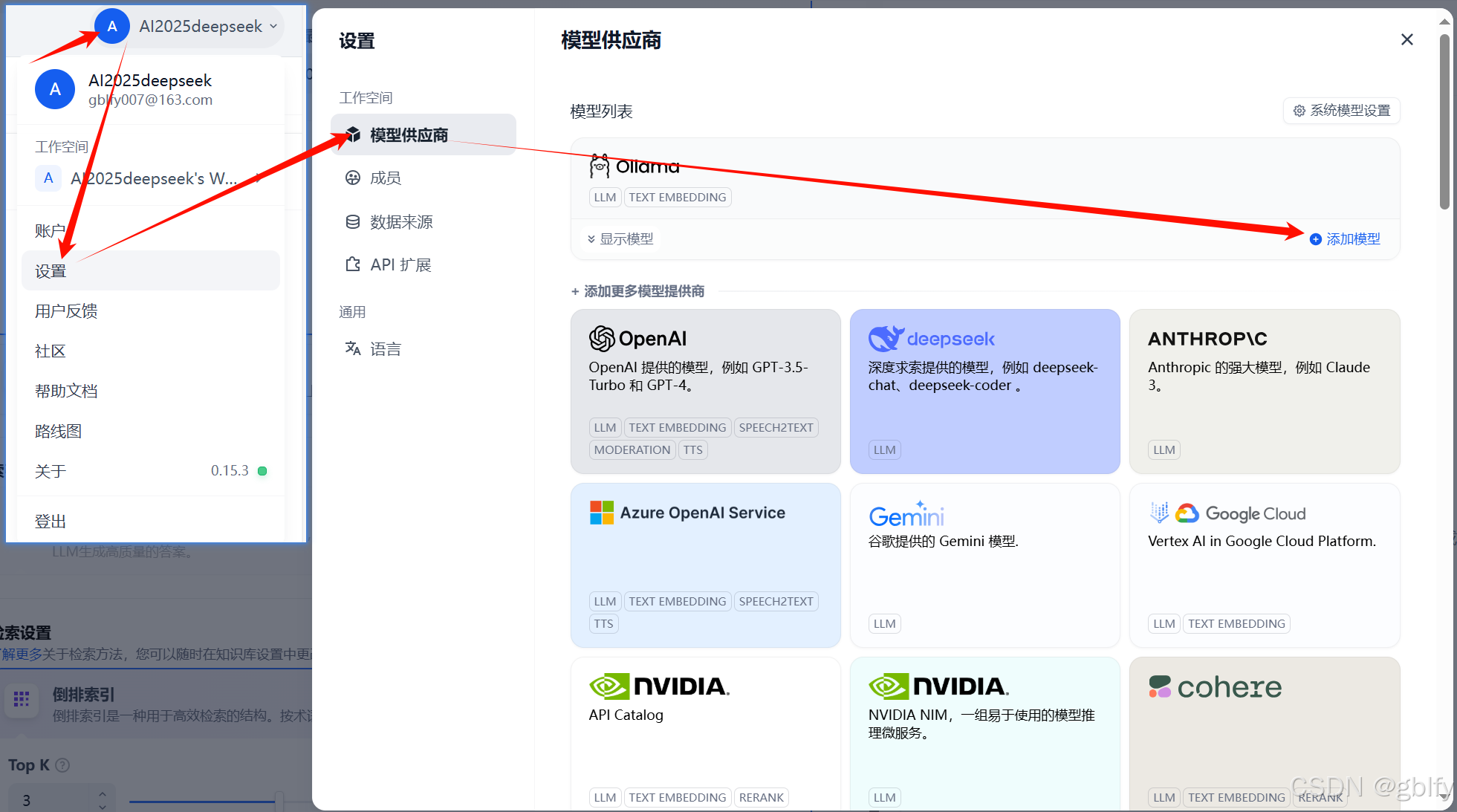

五、Dify 关联 DeepSeek (本地)

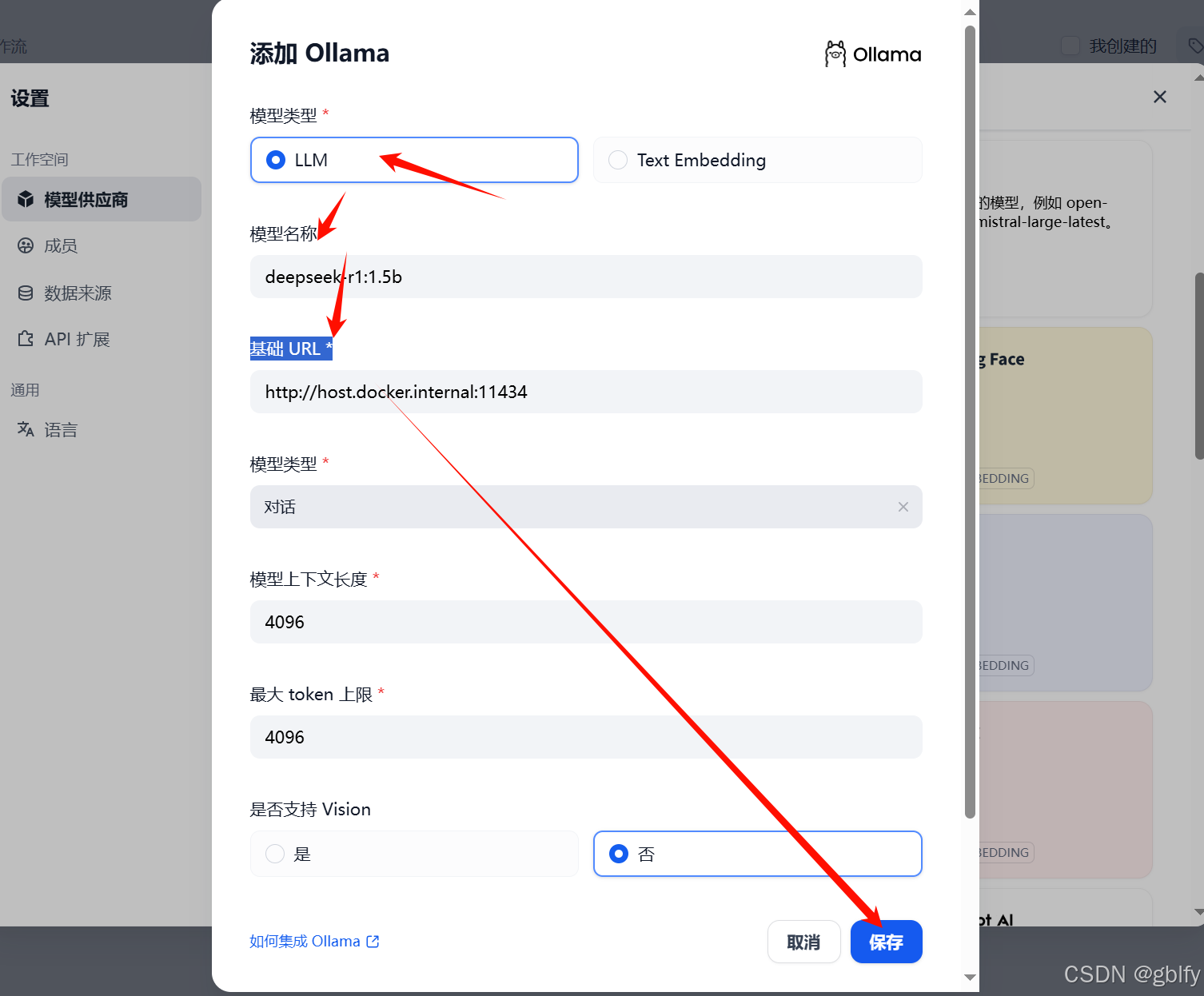

5.1. 配置 DeepSeek R1模型

模型名称:deepseek-r1:1.5b

基础 URL:http://host.docker.internal:11434

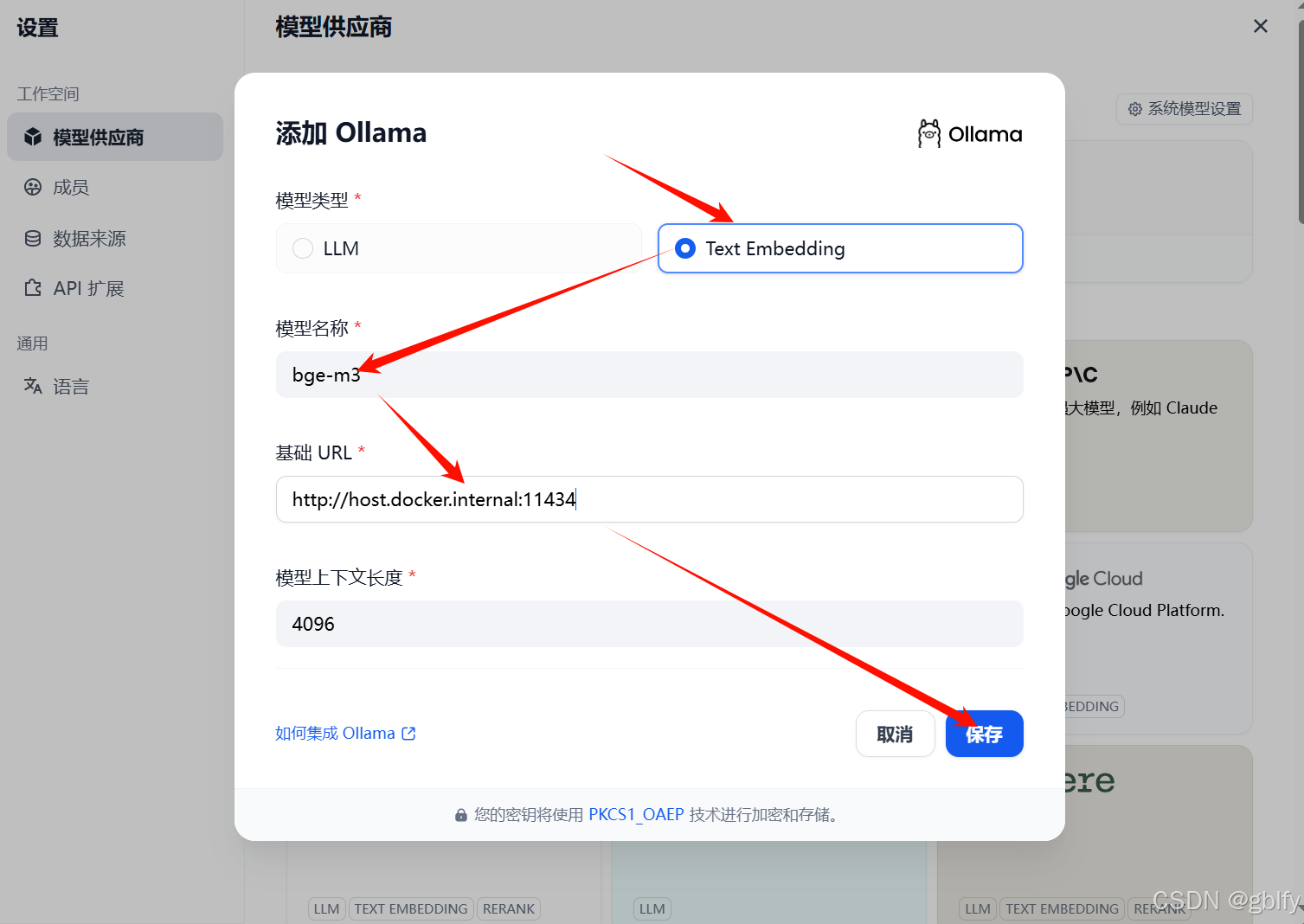

5.2. 配置embedding模型

继续配置embedding模型

模型名称:bge-m3

基础 URL:http://host.docker.internal:11434

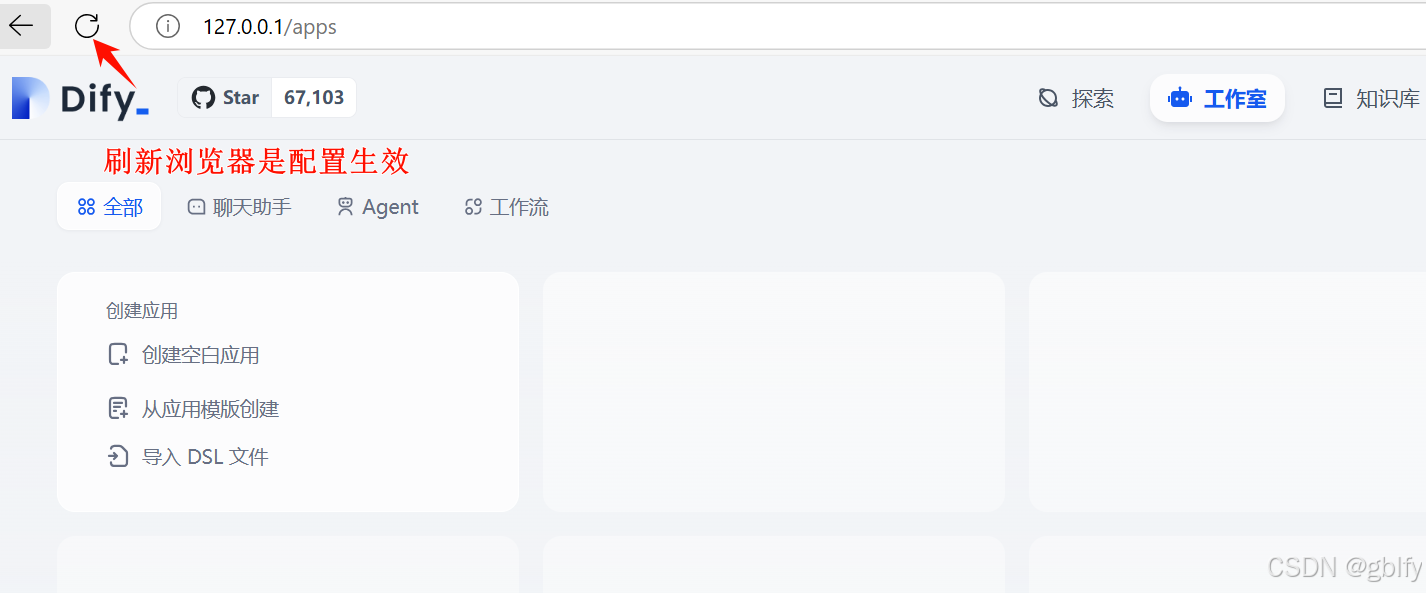

5.3. 刷新浏览器,是配置生效

验证是否成功勾选DeepSeek模型

六、创建应用

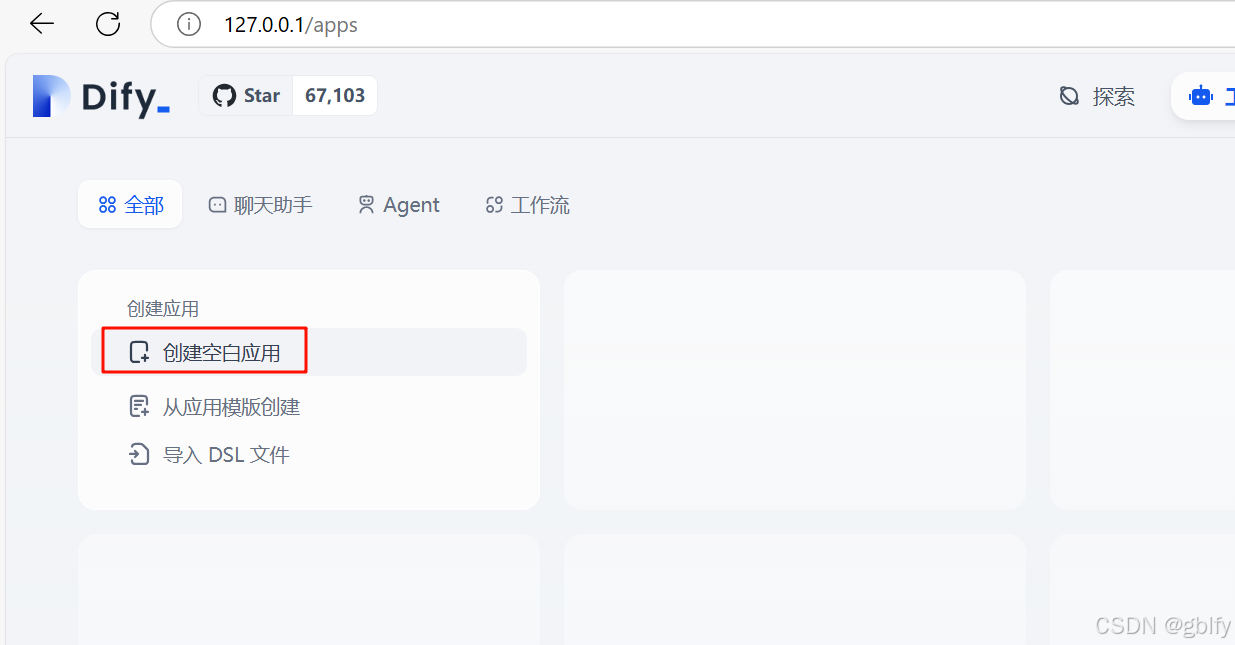

6.1. 创建空白应用

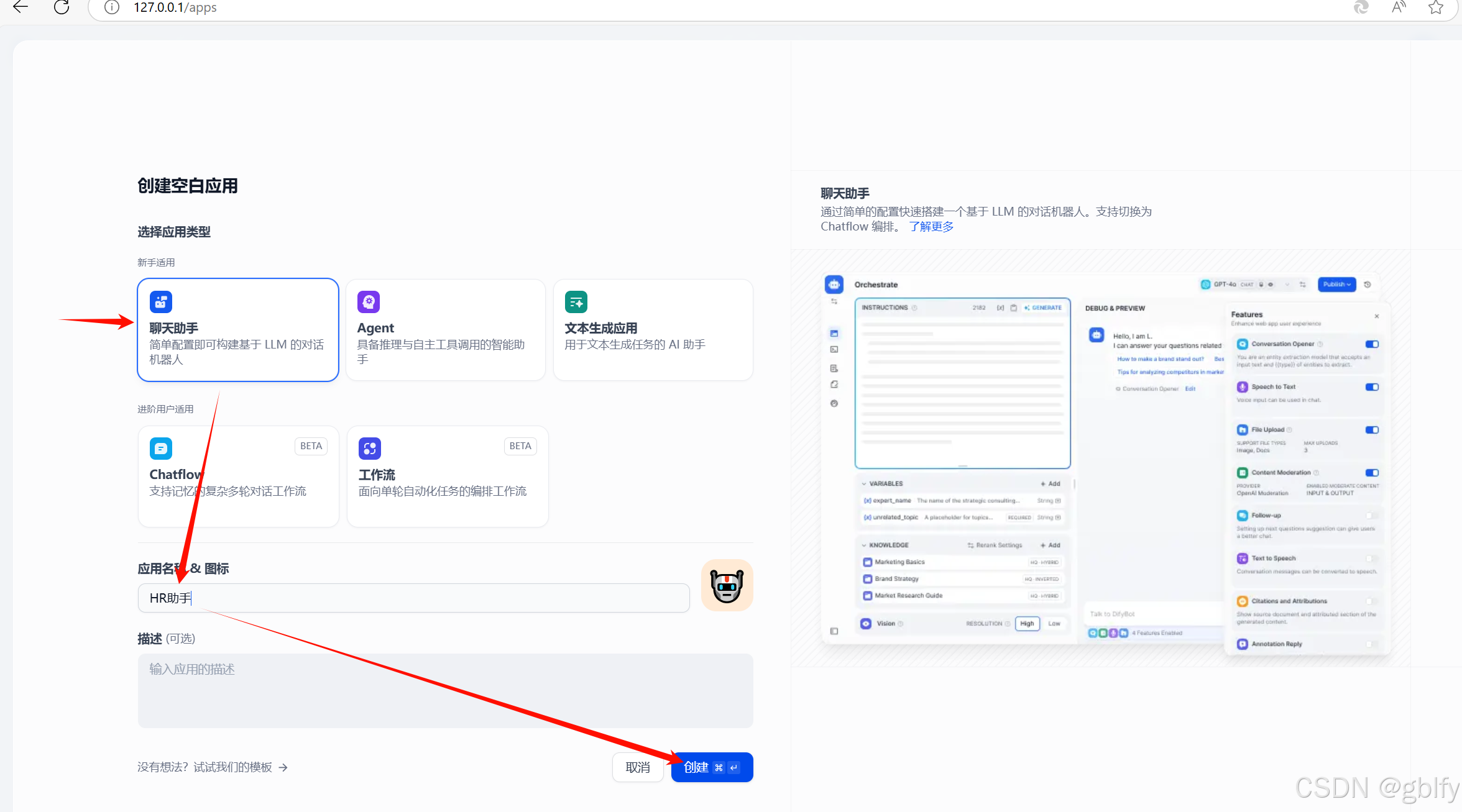

6.2. 设置应用名称

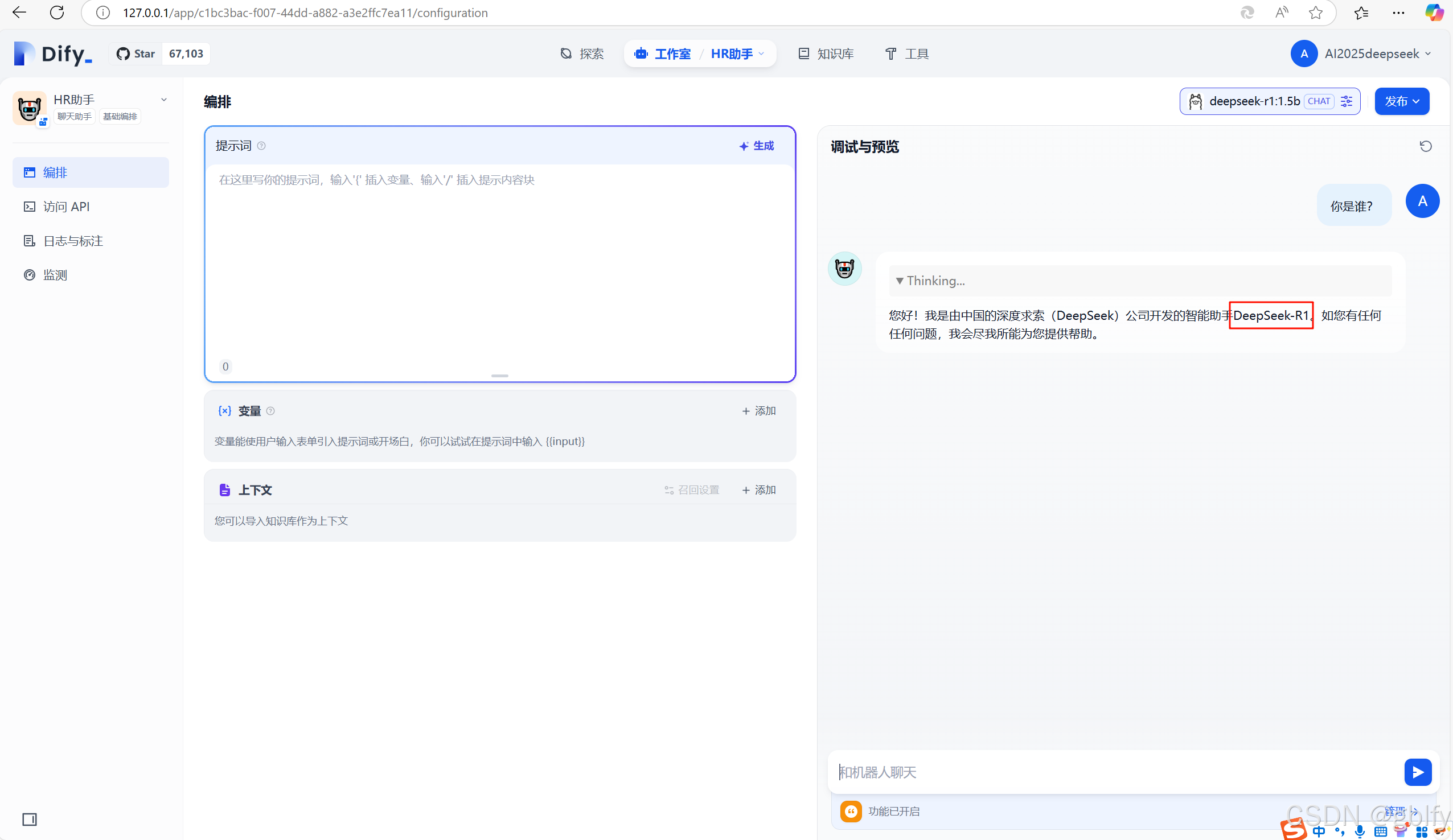

6.3. 体验DeepSeek 模型服务

七、创建知识库

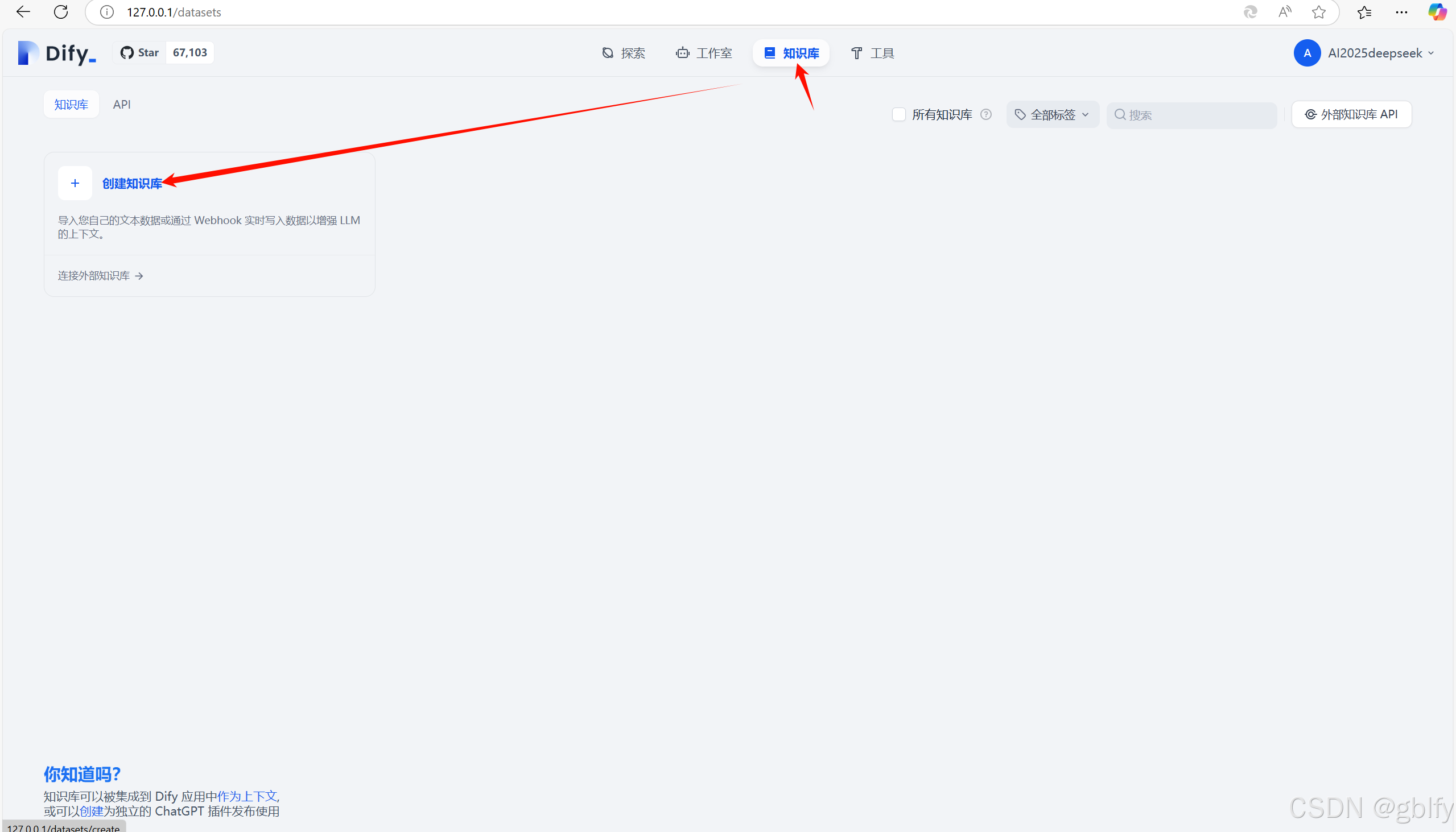

7.1. 创建知识库

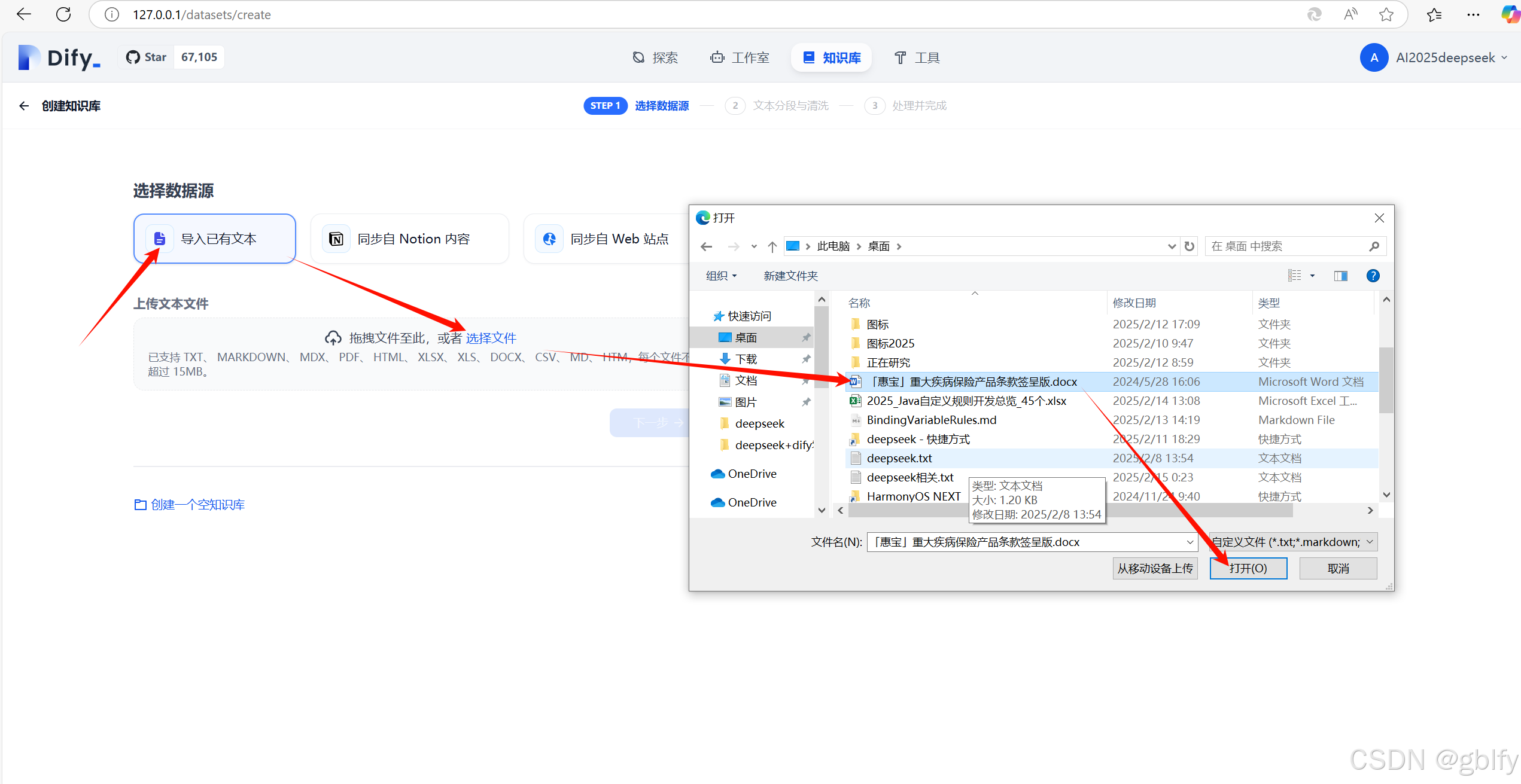

7.2. 上传文件到知识库

点击下一步

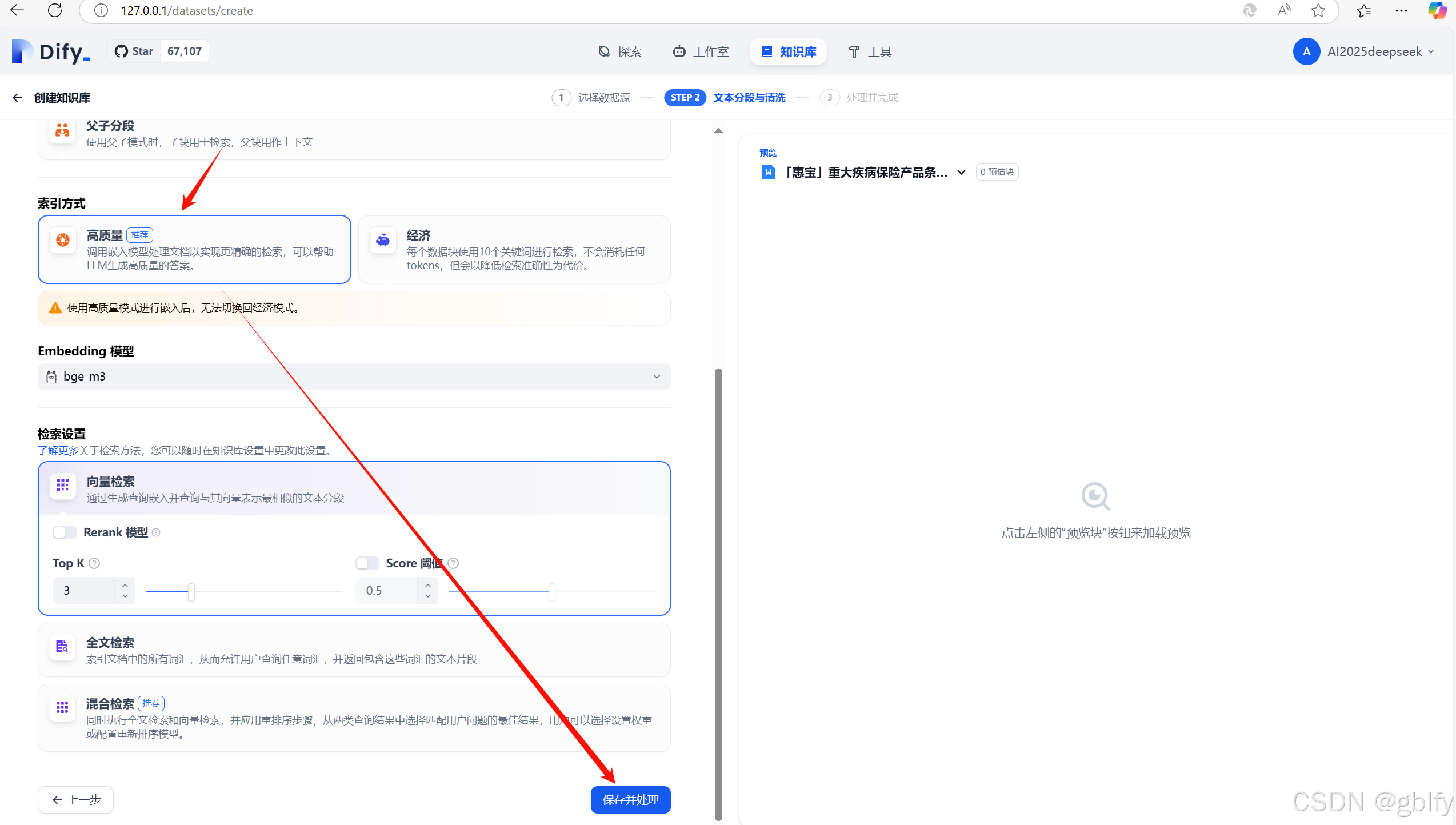

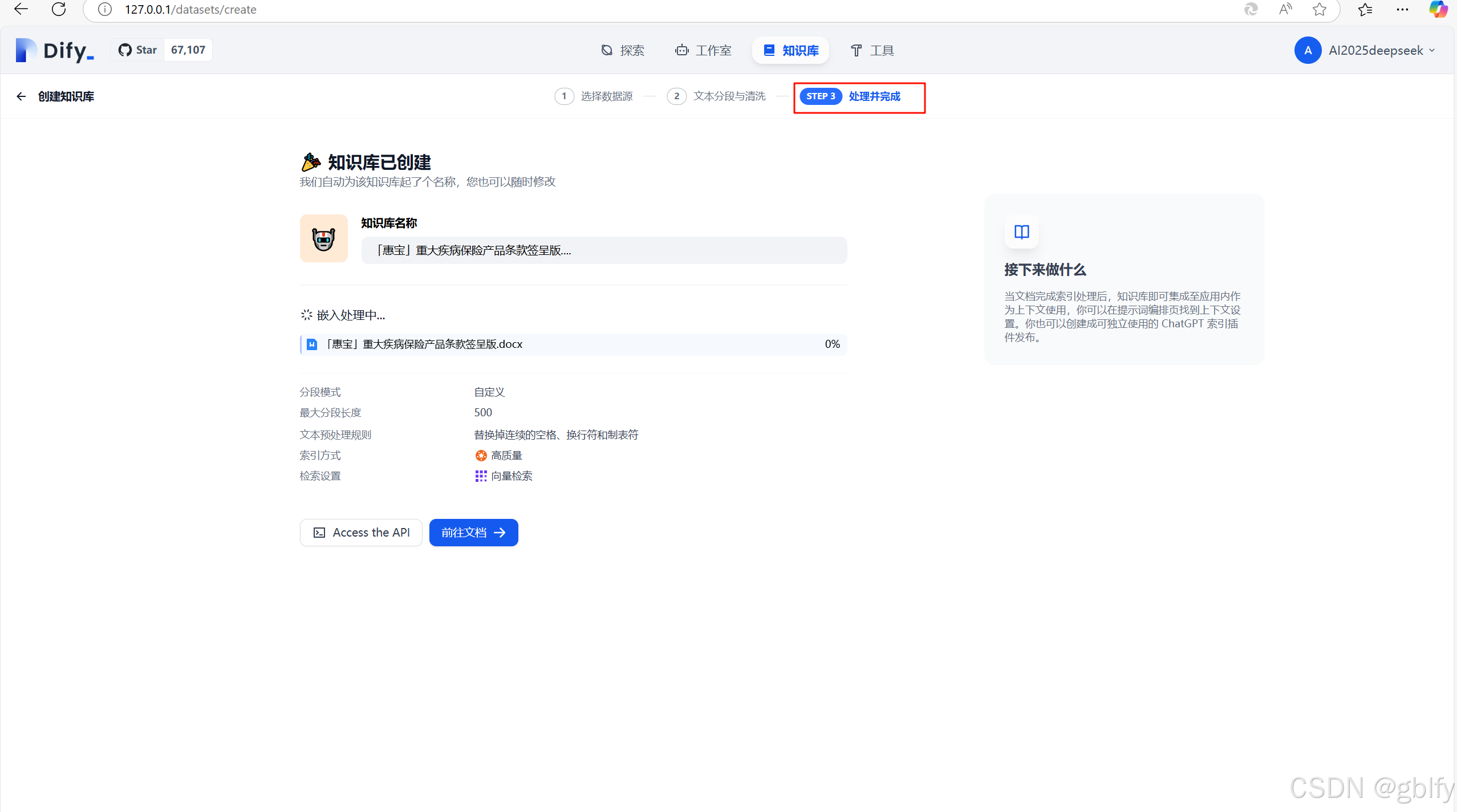

7.3. 文件向量化化并加载到知识库

7.4. 查验加载进度

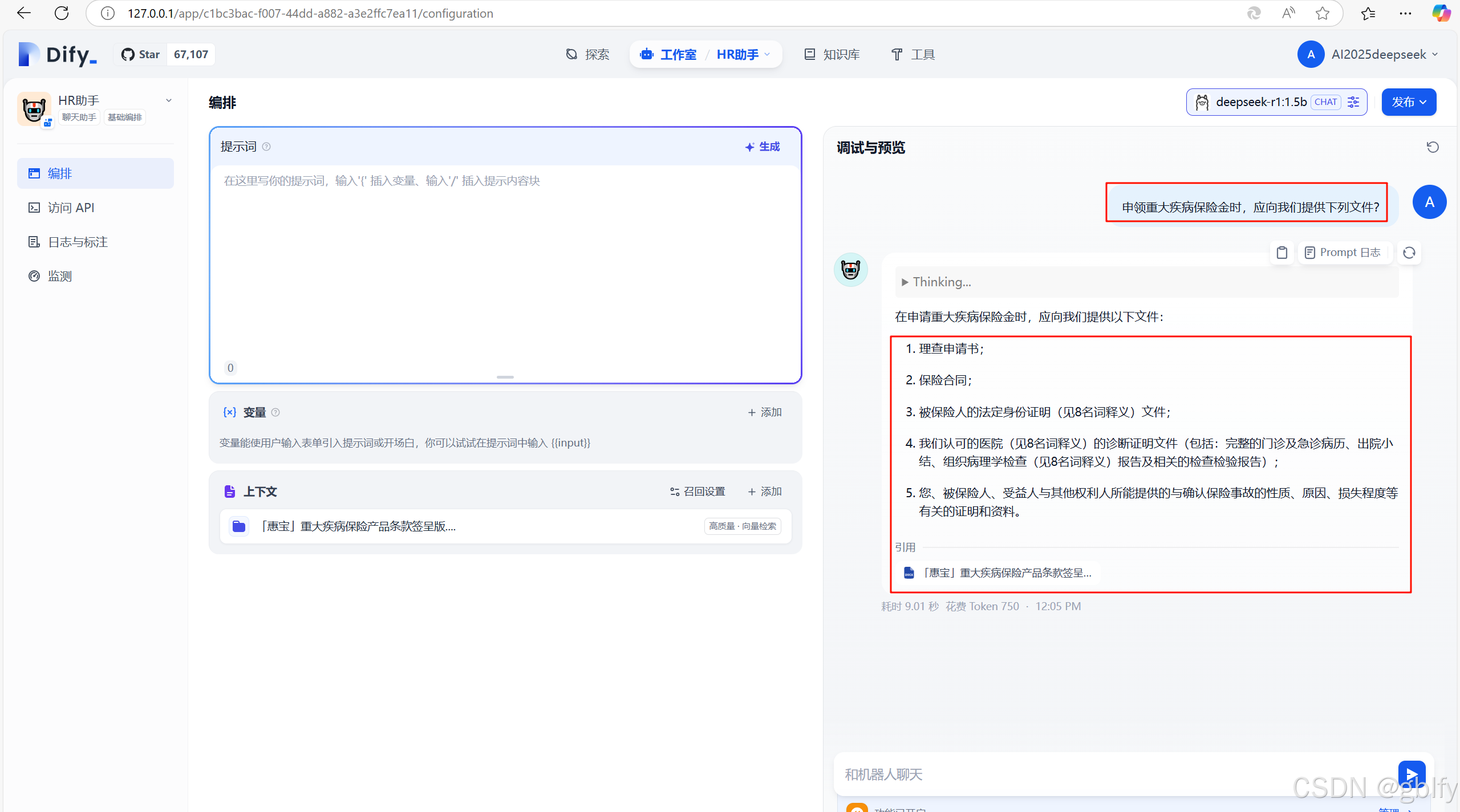

7.5. 体验 DeepSeek 本地私有AI知识库服务

答案是正确的。

八、Dify 集成DeepSeek(在线)

8.1. 注册账号

①先去官网注册账号:https://platform.deepseek.com/sign_in

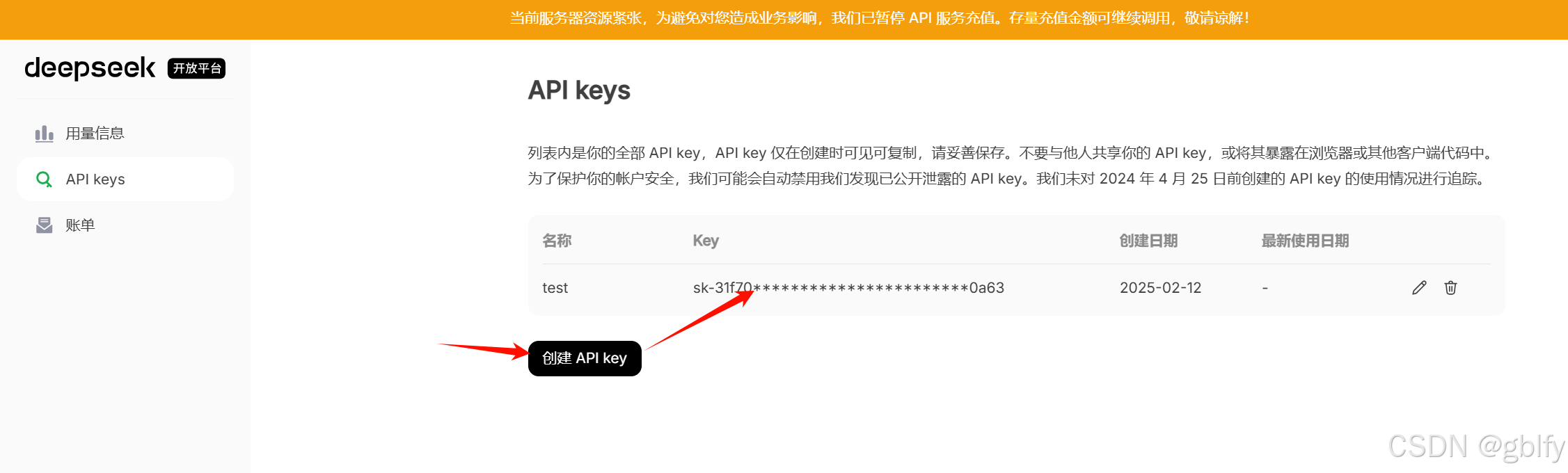

8.2. 创建API密钥,并复制

8.3. 配置DeepSeek API密钥

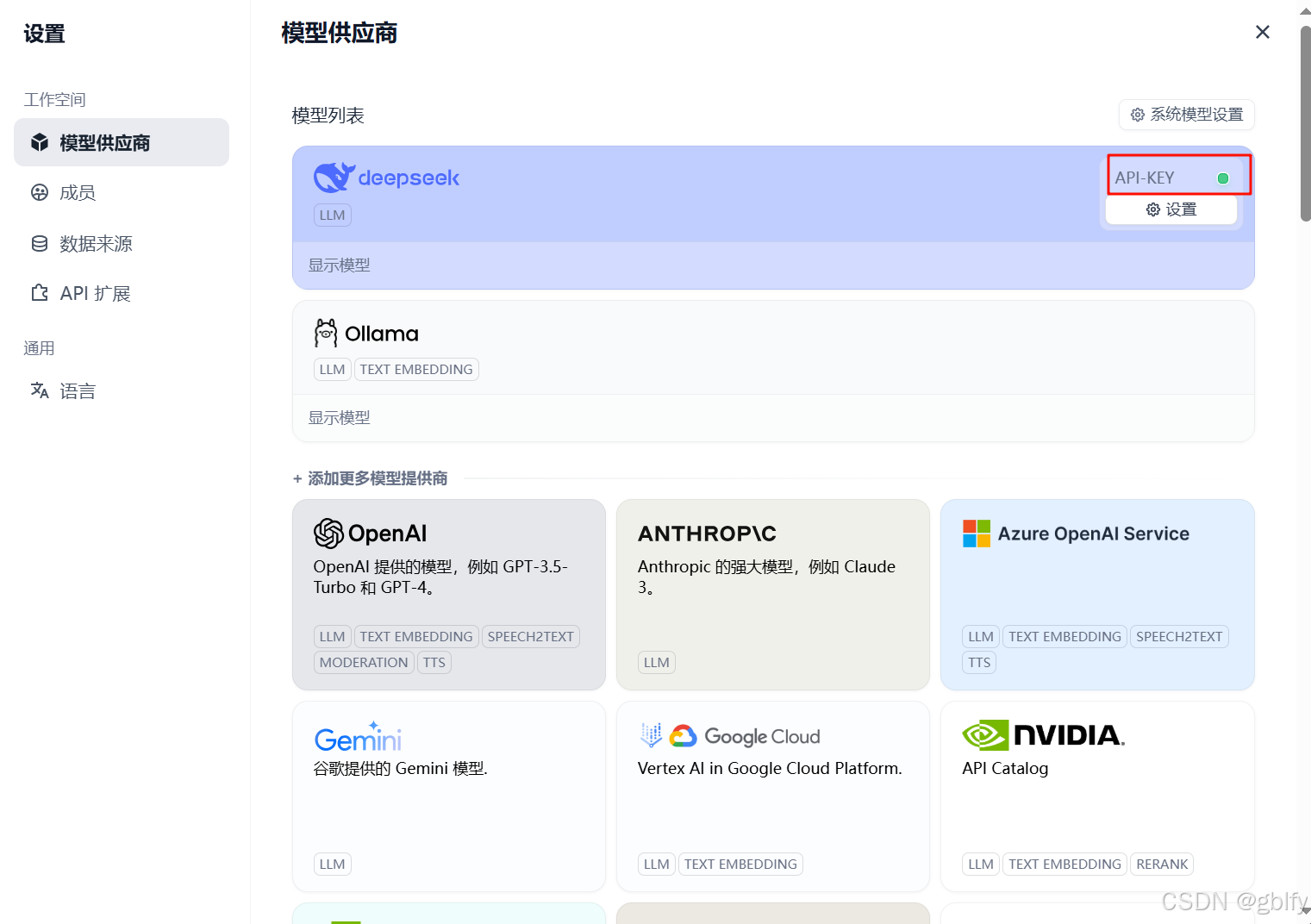

8.4. 查验api状态

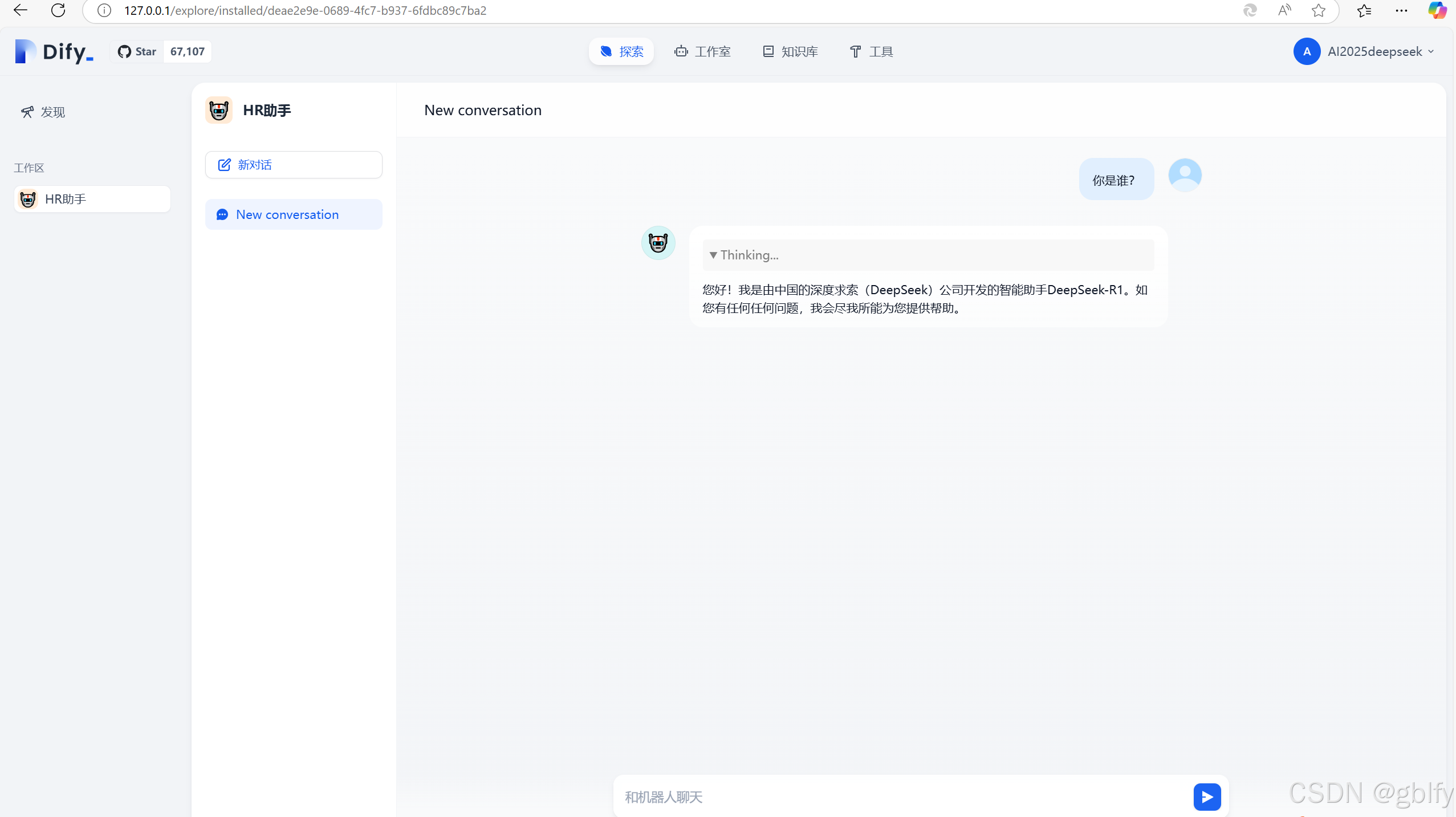

8.5. 体验DeepSeek 模型服务

3739

3739

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?