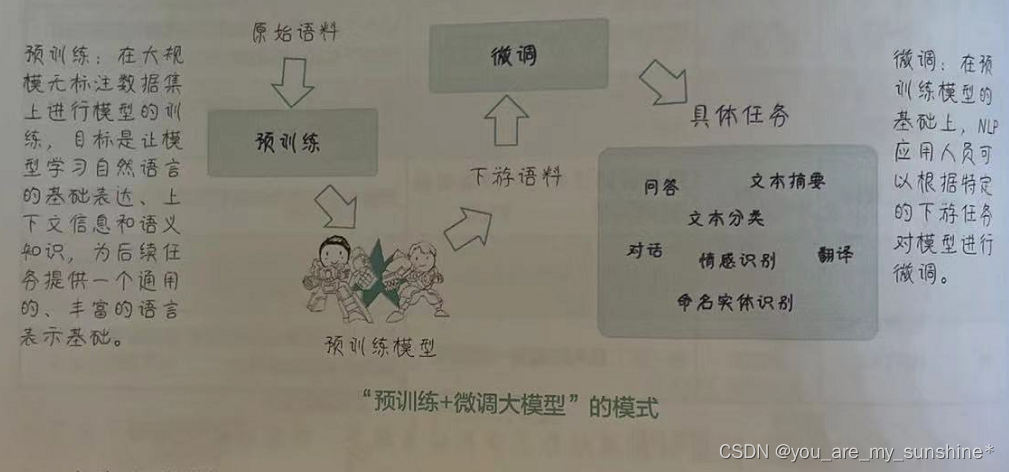

“预训练+微调大模型”的模式

经过预训练的大模型所习得的语义信息和所蕴含的语言知识,很容易向下游任务迁移。NLP应用人员可以根据自己的需要,对模型的头部或者部分参数进行适应性的调整,这通常涉及在相对较小的有标注数据集上进行有监督学习,让模型适应特定任务的需求。这就是对预训练模型的微调(Fine-tuning,有时也译为精调)。微调过程相对于从头训练一个模型要快得多,且需要的数据量也要少得多,这使得NLP 应用人员能够更高效地开发和部署各种NLP解决方案。

这种“预训练+微调大模型”的模式优势明显。首先,预训练模型能够将大量的通用语言知识迁移到各种下游任务上,作为应用人员,我们不需要自己寻找语料库,从头开始训练大模型,这减少了训练时间和数据需求。

以提示/指令模式直接使用大模型

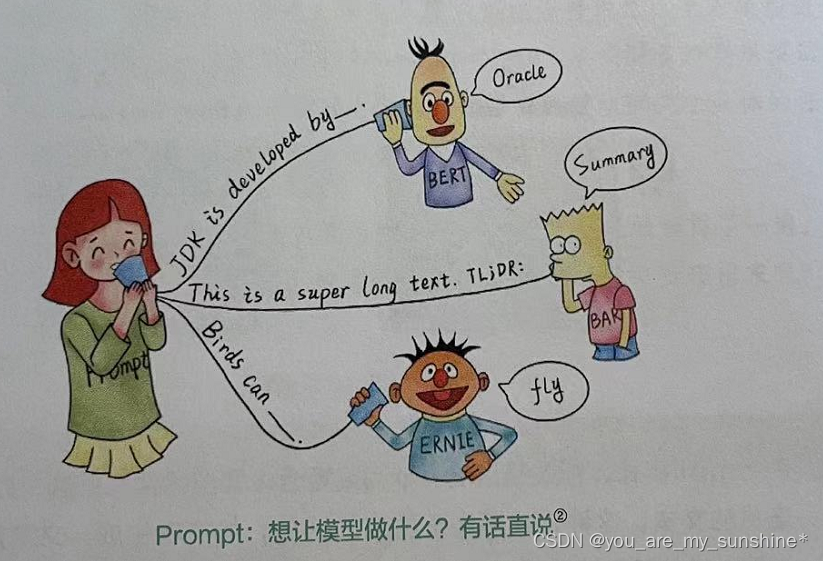

近年来,随着GPT这种生成式大型预训练模型的突飞猛进,“预训练+微调大模型”的使用模式有被一种称为“提示”( Prompt)或者说“指令”(Instruct)的使用模式所取代的趋势。

Prompt模式和Instruct模式都基于这样一种思想:在训练阶段,这些模型通过学习大量的文本数据,掌握了语言的结构、语法和一定程度的语义知识。那么,在应用阶段,通过在输入中提供恰当的信息和指导,可以引导大型预训练模型(如GPT-3)生成相关性更强且更有用的输出。这种方法可以看作与模型进行一种“对话”,用户提供输入(Prompt或Instruct),然后模型根据输入生成相应的输出。

大模型本身就是知识库,里面蕴含了你所需要的信息,不一定非得微调才能解决问题,但是你得知道怎么才能把它里面的知识“调”出来。

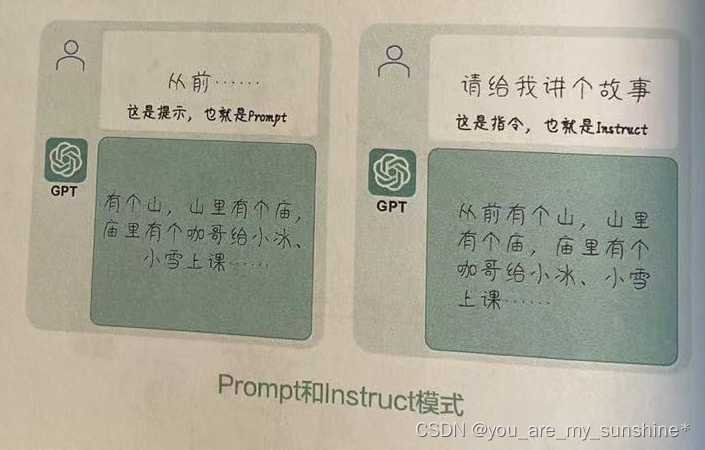

Prompt和Instruct这两种模式的不同之处

Prompt和Instruct模式

- Prompt 模式:输入通常是一个词或短语,模型需要根据这个提示生成自然且连贯的文本。这种方式适用于生成式任务,如文本生成、文章摘要等。

- Instruct 模式:输入是一条明确的指令,要求模型完成特定任务。这种方式适用于那些需要明确指示的任务,如回答问题、解释概念等。

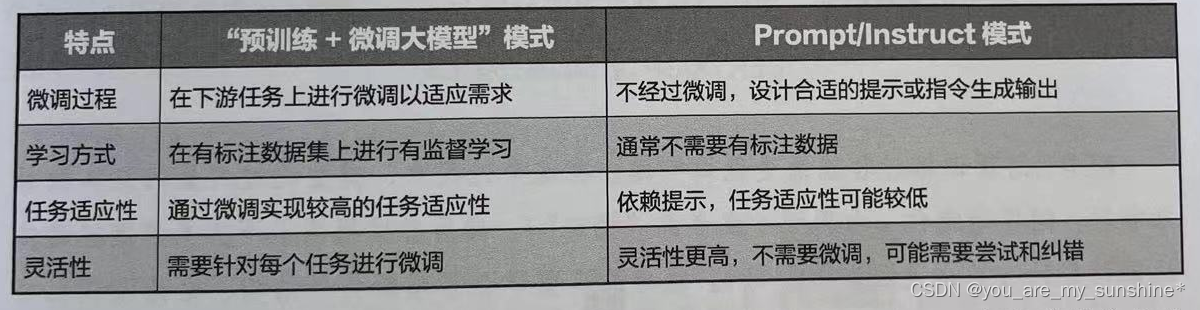

“预训练+微调大模型”模式和Prompt/Instruct模式的异同

小结

- 预训练+微调大模型”模式通过在特定任务上对模型进行微调,使模型更加精确地适应任务需求;

- Prompt/Instruct模式则直接利用预训练模型的生成能力,通过设计合适的提示来解决问题。

选择哪种模型取决于具体的任务需求、可用数据,以及具体的任务对精确性和灵活性的需求。

学习的参考资料:GPT图解

本文探讨了预训练大模型的微调策略和近年来兴起的提示/指令模式,两种方法在适应任务需求和生成准确性上各有优劣,选择取决于具体任务、数据和需求。

本文探讨了预训练大模型的微调策略和近年来兴起的提示/指令模式,两种方法在适应任务需求和生成准确性上各有优劣,选择取决于具体任务、数据和需求。

2503

2503

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?