1、指数移动平均(Exponential Moving Average)EMA概念和作用:

模型权重在最后的n步内,会在实际的最优点处抖动,所以我们取最后n步的平均,能使得模型更加的鲁棒。相比对权重变量直接赋值而言,移动平均得到的值在图像上更加平缓光滑,抖动性更小,不会因为某次的异常取值而使得滑动平均值波动很大。

作用是使得模型在测试数据上更加健壮,有更好的鲁棒性,在一定程度上提高最终模型在测试数据上的表现(例如accuracy、FID、泛化能力...)。

根据“https://github.com/zheng-yuwei/enhanced-UGATIT”上说的是:ema可以大幅提高模型稳定性和FID

在整个过程中,我们在训练的时候使用原始的权重,只有在test的时候才使用shadow weights。

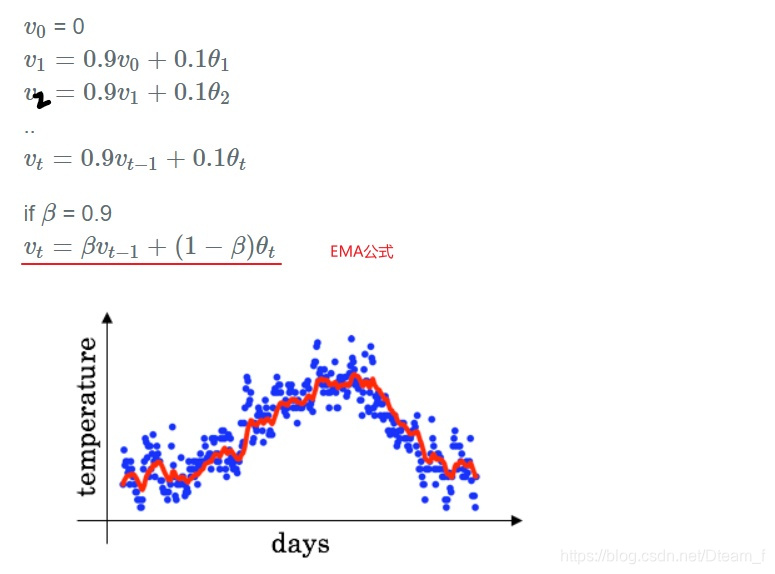

2、EMA在深度学习上的计算方法:

![]()

:前 t -1 次更新的所有参数平均数,也称为“ 影子权重(shadow weights)”。

:t 时刻的模型权重weights。

:是一个常数,我们认为它是一个调节取前多少次参数平均的“权重参数”,在代码中一般写为decay,一般设为0.9-0.999。

Vt 和 β 的关系:

Andrew Ng在Course 2 Improving Deep Neural Networks中讲到,EMA可以近似看成过去 1/(1−β) 个时刻 V 值的平均。所以:

| β = 0.9 | 1/(1−β) = 10 | Vt 表示取前10次权重的平均数据 |

| β = 0.5 | 1/(1−β) = 2 | Vt 表示取前2次权重的平均数据 |

| β = 0.999 | 1/(1−β) = 1000 | Vt 表示取前1000次权重的平均数据 |

那么就是 β 越大,表示考虑2前 N-1 天/次的影响越大,而考虑当前第N天的影响越小。

3、代码实现

为什么update影子权重Vt的时候直接使用下面公式,按理说Vt-1不应该是前t-1次权重的平均值吗?

![]()

其实你看下下面的公式计算,就可以知道,我们只需要按照公式直接计算就可以了,每次的结果会叠加,所以就不需要求前t-1次权重的平均值,因为它是迭代进行的,而不是直接求出最后的。

class EMA():

def __init__(self, model, decay):

self.model = model

self.decay = decay

self.shadow = {}

self.backup = {}

# 得到 shadow weights,它是model weight的deepcocy值

def register(self):

for name, param in self.model.named_parameters():

if param.requires_grad:

self.shadow[name] = param.data.clone()

# 更新 shadow weights

def update(self):

for name, param in self.model.named_parameters():

if param.requires_grad:

assert name in self.shadow

new_average = (1.0 - self.decay) * param.data + self.decay * self.shadow[name]

self.shadow[name] = new_average.clone()

# 使用 shadow weights

def apply_shadow(self):

for name, param in self.model.named_parameters():

if param.requires_grad:

assert name in self.shadow

self.backup[name] = param.data

param.data = self.shadow[name]

# 应用原来的 weights 进行训练

def restore(self):

for name, param in self.model.named_parameters():

if param.requires_grad:

assert name in self.backup

param.data = self.backup[name]

self.backup = {}

# 初始化EMA

ema = EMA(model, 0.999)

ema.register()

# 训练过程中,更新完参数后,同步 update shadow weights

def train():

# 使用shadow weights(第t-1次的model的参数) 和 优化器更新后的model参数(第t次model的参数),

optimizer.step()

# 更新

ema.update()

# eval前,apply shadow weights;eval之后,恢复原来模型的参数

def evaluate():

# eval前

ema.apply_shadow()

# eval之后

ema.restore()

【炼丹技巧】指数移动平均(EMA)的原理及PyTorch实现 - 知乎

EMA(指数移动平均)及其深度学习应用_深度学习ema-CSDN博客

3623

3623

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?