RTFN: A robust temporal feature network for time series classification

原文链接:https://www.sciencedirect.com/science/article/pii/S0020025521003820

一、主要内容

提出鲁棒时间特征网络(RTFN),用于时间序列分类中的特征提取,其中包含一个时间特征网络(TFN)和一个基于长短期记忆(LSTM)的注意力网络(LSTMaN)。

鲁棒性在异常情况下的生存能力,简单来说就是对变化数据的容忍性。

TFN是具有多个卷积层的残差结构,并用作局部特征提取网络以从数据中挖掘足够的局部特征。

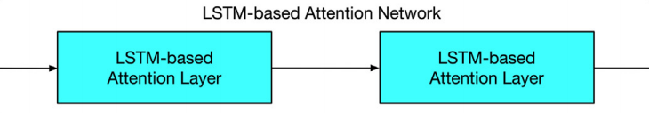

LSTMaN由两个相同的层组成,其中注意力和LSTM网络是混合的。该网络充当关系提取网络,以发现从不同数据位置提取的特征之间的内在联系。

可用于监督和无监督作为特征提取器和编码器。

二、注意力机质(补充)

注意力机制可以让一个神经网络能够只关注其输入的一部分信息,它能够选择特定的输入。

注意力网络能使输入向量之间的作用方式是相乘,因此可以拟合更复杂的函数模型。它有很多种,下面介绍的是soft attention

该模型学习关注图像的特定部分,同时生成描述该部分的单词。

总之,注意力网络可以捕捉特定的信息。

三、RTFN的网络架构

1.RTFN框架

级联:从先前提取的较低层特征中显示较高层的多尺度特征。

注意力层:有助于补偿TFN忽略的表示形式的损失。

2.卷积神经块(Conv1D)

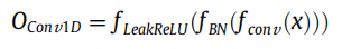

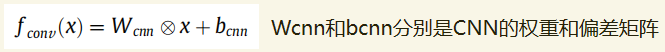

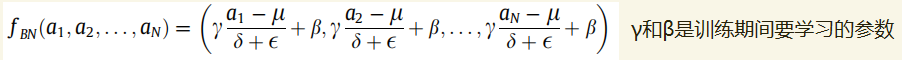

Conv1D块由一维CNN模块,批量处理模块,LeakReLU激活函数组成,定义为

①CNN模块:用于从输入中探索本地特征

②批量处理模块:归一化消除了内部协变量偏移,从而确保了更快的训练过程此外,它在监管分类和非监管聚类中对提出的模型进行了正则化,并增强了其局部特征提取能力

③LeakReLU激活函数:ReLU只考虑正数,而该函数可正负数以减少数据传输过程中功能的损失

3.基于LSTM的关注层(LSTMaN)

由两个相同的LSTMaN组成。第一层用于从输入中提取基本关系,而第二层负责挖掘输入之间的复杂关系。通过扩展先前获得的关系的细节,第二层比第一层有助于提取隐藏在数据中的更复杂的正则化。

其中LSTM-Q/-K/-V分别用于获取查询/键/值矩阵的LSTM函数

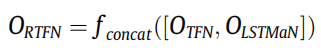

4.将TFN获取的局部特征和LSTMaN获取的全局关系串联起来得到整个框架的输出

其中Otfn,Olstman分别为时间特征网络(TFN)和基于LSTM的关注层(LSTMaN)所得的输出矩阵

四、基于RTFN的监督结构(RTFN+分类网络)

Dropout:在每次训练时随机丢弃一定的神经元可防止过拟合

全连接层:分类器

SoftMax:归一化

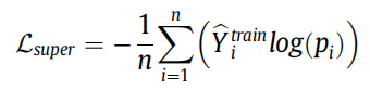

使用交叉熵函数来计算地面真相标签及其对应的预测结果Lsuper之间的平均差

五、基于RTFN的无监督聚类(RTFN的编码器,解码器+K-means算法)

RTFN:负责从输入中获取尽可能多的有用表示

解码器:由四个完全连接的层组成,有助于重建RTFN捕获的功能

K-means:充当无监督分类器

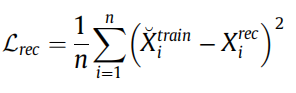

损失函数为均方误差

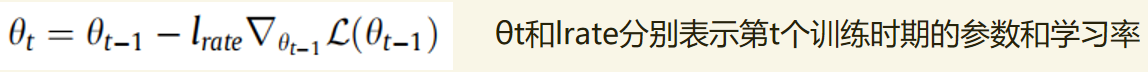

无论监督或无监督,目的都是找到最佳参数θ让L最小

六、阅读总结

我只看了这些框架网络的大概实现,还没细看后面的实验与分析,太多了QwQ,没有wps会员手动翻译太费时间了。

我感觉整篇文章的重点就是在讲他们提出的鲁棒时间特征网络(RTFN),对于监督无监督的实验我还没去了解,感兴趣的朋友可以去看看原文。

文章的结论

在提出的RTFN中,时态特征网络负责提取局部特征,而基于LSTM的注意力网络则发现从数据中学到的表示之间的内在联系。实验结果表明,提出的RTFN在监督分类和无监督聚类中均取得了不错的性能。具体而言,与监督分类社区的最新结果相比,拟议的基于RTFN的监督算法在UCR2018档案中的85个单变量数据集中的39个和UEA2018档案中的30个多元数据集中的15个中表现最佳。特别是,拟议的RTFN在20个“长”单变量数据集案例中赢得了11个。当考虑所有36个数据集时,我们基于RTFN的无监督算法表现第二好。最后,实验结果还表明,RTFN具有强大的潜力可嵌入其他学习框架中,以处理现实世界中各个领域的时间序列问题。

1058

1058

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?